Palantir 說軍方自己決定 AI 打擊

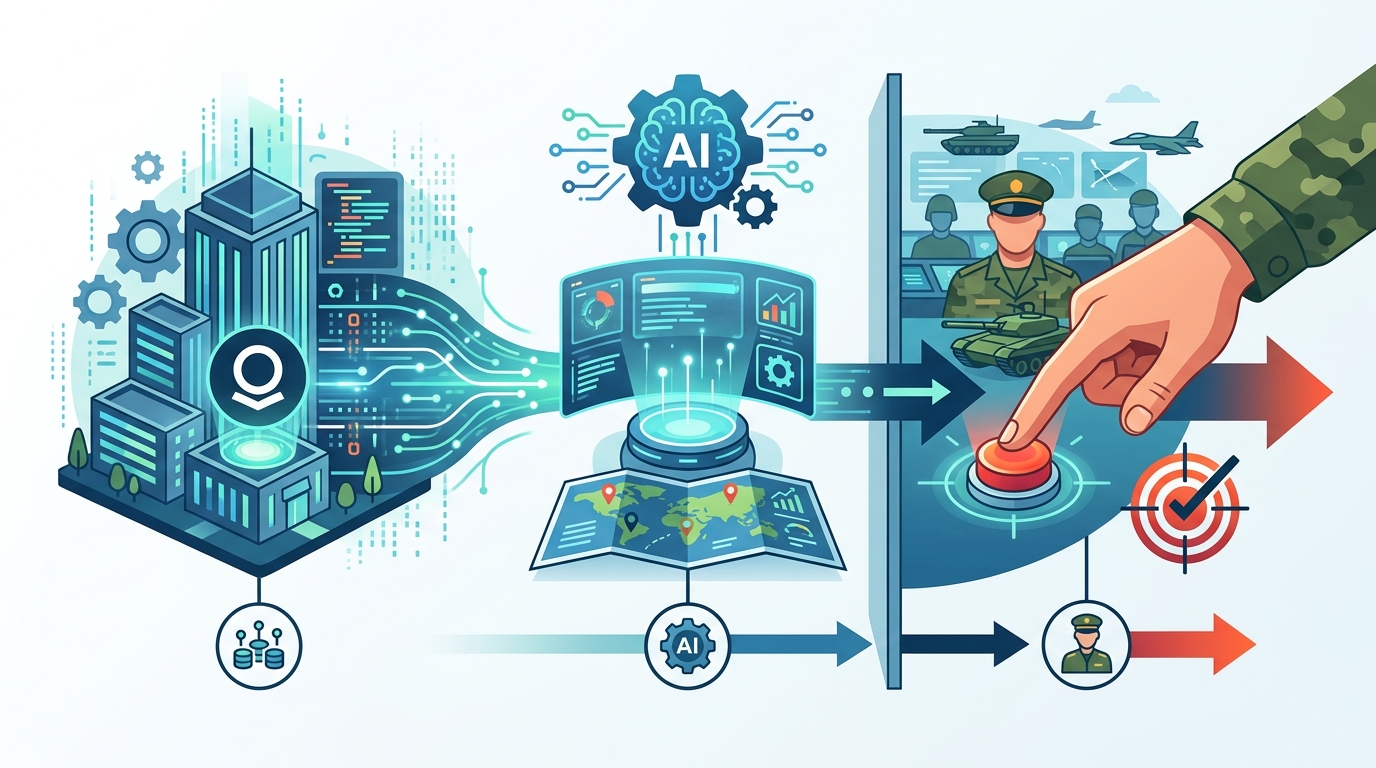

Palantir 英國主管主張,AI 打擊決策該由軍方負責,不是供應商。從 Maven、Claude 到平民風險,這場爭論正變得更尖銳。

Palantir 的防務軟體,已經摸到現代戰爭最敏感的地方。它幫忙決定,什麼目標先打,什麼資訊先看。這件事很硬,也很燙手。

問題是,AI 不是單純的資料工具。當它進到戰場,速度就是壓力。Palantir 的 Maven Smart System 被包裝成決策支援。可是一旦有人真的照著它的建議開火,責任算誰的?

這次爭議又被 Anthropic Claude 離開 Maven 計畫推高。美國國防部在 2 月說,要逐步停用 Claude。原因很直接。Anthropic 不想讓模型碰自主武器和監控用途。英國 Palantir 負責人 Louis Mosley 則把球丟回軍方,說最後決定本來就該由軍方承擔。

Maven 到底在做什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

Maven 不是什麼科幻武器。它是 2017 年由五角大廈啟動的計畫。目標很務實,就是把戰場資料整理快一點。衛星影像、無人機畫面、情報訊號,全丟進系統,讓參謀少花時間翻資料。

講白了,它想縮短「看到」到「出手」之間的時間。這在戰場上很重要。因為拖 1 小時,可能就多 1 次移動、多 1 次掩護、多 1 次失手。軍方愛這種東西,不難理解。

Palantir 的說法也很標準。它強調 Maven 是輔助層,不是自動射擊系統。Mosley 接受 BBC 訪問時說,最後還是人做決定。系統只是把原本很慢的資訊整理,變成可操作的建議。

- Maven 在 2017 年由五角大廈啟動。

- 它會吃進衛星、無人機、情報資料。

- Palantir 說最後打不打,還是人決定。

- 美國國防部在 2 月說要停用 Claude。

人類在迴路裡,真的夠嗎

「human in the loop」這句話,聽起來很安心。機器提案,人類拍板。理論上很合理。問題是,戰場不是會議室。當時間很趕,審核就容易變成點頭。

Queen Mary University of London 的 Prof Elke Schwarz 直接點破這件事。她擔心的不是單次誤判,而是整個流程把人訓練成太依賴軟體。你看久了,反而不太會質疑它。

“If there’s a risk of killing and you co-opt a lot of your critical thinking to software that will take care of these things for you, then you just become reliant on the software,” said Prof Elke Schwarz of Queen Mary University of London. “It’s a race to the bottom.”

這句話很刺,但我覺得很準。AI 不用完全自動化,也能改變戰爭。只要它把判斷時間壓得夠短,人就可能只剩蓋章功能。那還叫審核嗎?我看比較像流程化背書。

Mosley 的回應也很典型。他說政策歸軍方管,不是供應商管。法律上,這話很安全。道德上,就沒那麼輕鬆了。因為只要模型加速了 kill chain,供應商真的能說自己只是賣軟體嗎?

數字一擺出來,壓力就更大

BBC 的報導提到,自 2 月 28 日後,美國已發動超過 11,000 次對伊朗的打擊。很多目標據稱是由 Maven 找出來的。這不是試驗室規模。這是高頻率、真實世界、會死人的使用場景。

伊朗官方還說,Minab 的一所學校在開戰首日遭到空襲,造成 168 人死亡,其中約 110 人是兒童。這種數字一出來,AI 是否參與目標辨識,就不再只是技術討論,而是責任追問。

美國眾議員 Sara Jacobs 也要求更嚴格的規則。她的意思很直白。AI 工具不夠可靠,而且操作員可能會過度相信它。這句話放在軍事場景,殺傷力很高。

- BBC 報導稱,2 月 28 日後已超過 11,000 次打擊。

- 伊朗稱 Minab 學校空襲造成 168 人死亡。

- 伊朗稱其中約 110 名死者是兒童。

- Reuters 指出,Maven 近期成了正式 program of record。

Claude 離場,代表什麼

Claude 從 Maven 退出,不只是換一個模型而已。這代表 AI 模型供應商,開始對軍事用途畫線。尤其是自主武器和監控,這兩個詞現在很敏感。

Anthropic 的態度很清楚。它不想讓 Claude 進到那種用途。這種選擇不一定好賺,卻很有訊號。因為一旦一家大模型公司拒絕,其他廠商也會被問:你們要不要接?接到哪裡算停?

這對 OpenAI、Microsoft,還有其他做 LLM 的公司,都不是小事。因為今天你賣的是分析工具,明天就可能被拿去做作戰流程。企業常說用途由客戶決定,但真到了戰場,這句話就很難站得住。

幾個差異可以直接看:

- Claude 曾接入 Maven,後來因自主武器與監控用途退出。

- Maven Smart System 仍主打決策支援與資料整合。

- 五角大廈把 Maven 做成長期計畫,不像短期試點。

- 模型商開始設限,軍方卻還想要更快的分析流程。

所以真正的問題不是 AI 能不能看圖找目標。它當然可以。問題是,當工具把速度拉高,軍方還有沒有足夠時間說不?

這場爭論,其實很像軟體治理

這件事表面上是軍事新聞。骨子裡,卻很像軟體治理問題。誰定義用途,誰負責風險,誰能停用模型,誰能稽核輸出。這些問題,台灣做 AI 的人其實也躲不掉。

因為現在很多 AI 產品都在走同一條路。先說自己只是輔助,再慢慢進到高風險流程。今天是客服,明天是審核,後天可能就碰到安全、金融、醫療,甚至國防。每一步都說只是支援,但每一步都在改變決策節奏。

我覺得這篇新聞最刺的地方,在於它把責任切分得很漂亮,卻也很冷。供應商說是軍方決定,軍方說是系統建議。可是一旦出事,受害者不會在乎你們的合約怎麼寫。他們只會問,誰讓這個系統上線的?

接下來,重點會落在規則

接下來幾個月,我會盯三件事。第一,Maven 的採購文件怎麼寫。第二,模型商會不會繼續對軍事用途設限。第三,國會和法院會不會開始要求更細的審計紀錄。這三件事,會比任何行銷稿都重要。

如果 AI 真的進到高風險決策,最少要有可追溯紀錄、人工覆核時間、以及明確拒絕權。沒有這些,所謂 human-in-the-loop 只是口號。你如果是做產品、做平台、做資料系統的人,現在就該問自己:你的軟體,會不會哪天也被推進同一個位置?