技術研究

AI 研究論文、突破性進展與技術深度分析。從學術發表到影響 AI 未來的實驗室研究成果。

LLMbda 演算替 AI 代理人立安全規則

這篇論文用形式化演算描述 LLM 代理人的對話與資訊流,目標是把隔離、保密與完整性變成可證明的安全規則。

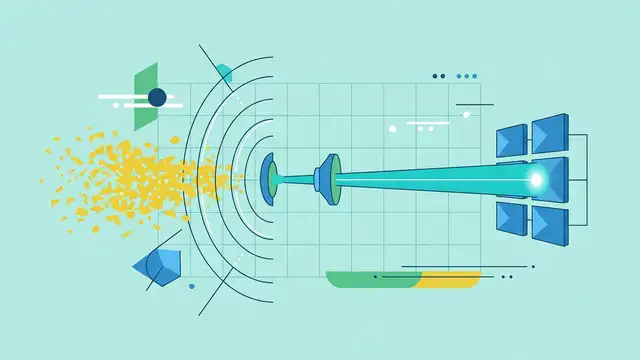

更簡單的毫米波波束域去噪器

這篇論文提出一個低複雜度的毫米波 massive MIMO 波束域去噪方法,結合低解析度 ADC 雜訊模型與硬體友善設計,目標是讓演算法更適合 FPGA 落地。

為什麼 AI 基準賽在資安領域的勝利,應該讓防守方警醒

AI 資安基準的進展已顯示自主攻擊能力正在追上防守方的規劃速度,這不是實驗室新聞,而是防線時間被壓縮的警訊。

為什麼 Linux 安全需要「補丁浪潮」思維

Linux 安全已進入補丁浪潮時代,團隊必須把快速修補當成預設,而不是例外。

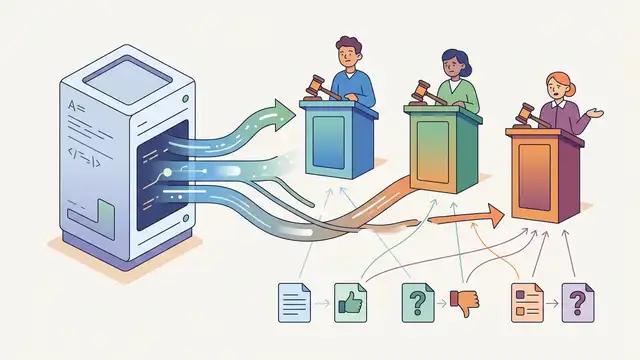

LLM 評審也會不穩

這篇論文做了一個壓力測試工具,檢查 LLM 當評審時,會不會因為格式、改寫、篇幅或標籤翻轉而判斷不一致。

黑箱 LLM 排程更聰明了

這篇論文用「預測輸出長度」來改善黑箱 LLM 推論排程,想在看不到模型內部的情況下,減少排隊摩擦、提升大規模服務效率。

AISafetyBenchExplorer:AI 安全基準地圖

AISafetyBenchExplorer 把 195 個 AI 安全 benchmark 做成可查的目錄,重點不是比誰分數高,而是揭露測量碎片化與治理薄弱的問題。

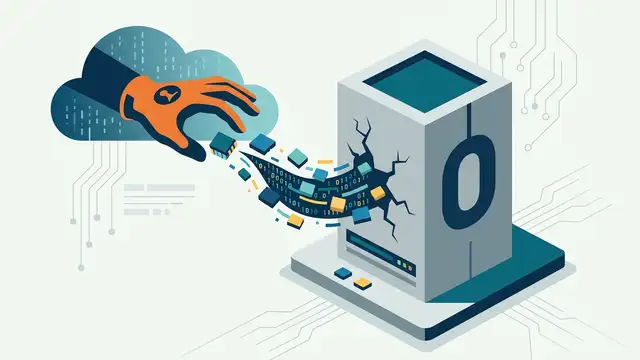

Ollama 漏洞可遠端洩漏記憶體

Ollama 出現 CVE-2026-7482,遠端攻擊者可透過惡意 GGUF 檔讀出程序記憶體,可能外洩金鑰、提示詞與使用者資料。

為什麼程式碼基準測試終於開始說實話

BenchLM 的程式碼排行榜顯示,真正有用的訊號只剩 LiveCodeBench 與 SWE-bench Pro;HumanEval 已經不適合拿來選模型。

Pion 用正交變換鎖住權重譜

Pion 是一種新的 LLM 優化器,改用左右正交變換更新權重,盡量保留奇異值不變。這篇論文主打的是訓練時維持矩陣譜結構,而不是只追求一般的加法式梯度更新。

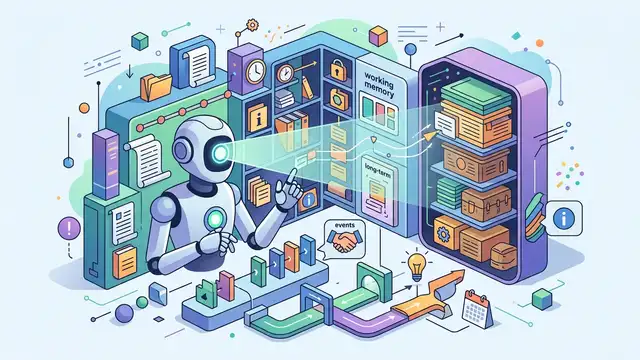

LongMemEval-V2:測 agent 長期記憶

LongMemEval-V2 用 451 題測試 agent 能否記住 Web 環境經驗,而不只是使用者歷史;結果顯示以 coding agent 蒐證的記憶法準確率最高,但延遲也更高。

AlphaGRPO 讓多模態模型學會自我修正

AlphaGRPO 把可驗證、可拆解的獎勵訊號加進多模態模型訓練,讓模型能推理、修正輸出,並在不靠 cold-start 的情況下提升生成表現。

為什麼 LLM agents 正在變成真正的漏洞獵手

LLM agents 已經不只是寫程式工具,它們開始能在真實系統中找出有價值的漏洞,而且這件事正在改變資安研究的分工方式。

為什麼 GPT-5.5 應該成為 2026 年的預設寫碼 LLM

GPT-5.5 應該成為 2026 年的預設寫碼 LLM,因為它在公開基準的綜合表現領先,最適合作為團隊的能力上限。

自動化 LLM Agent 的記憶怎麼設計

這篇綜述整理自主 LLM agent 的記憶怎麼設計、怎麼評估、怎麼用,重點放在機制選擇與仍未解決的問題。

政策不變性檢驗 LLM 安全判官

這篇論文主張,LLM 安全判官不能只看準確率,還要測政策不變性,才能檢查它是否真的懂規則、而不是被措辭帶著走。

SAGA 讓 AI Agent 排程看懂工作流

SAGA 主張 GPU 排程不該把 AI agent 的每次 LLM 呼叫拆開看,而是要把一連串請求當成同一個工作流來排。

PARNESS:把自動化研究做成可續跑流程

PARNESS 把自動化科學研究做成可變流程、全文索引與跨次執行記憶的 harness,重點是讓研究代理不再只跑一次就結束。

AI 代理能幫忙做 LLM 服務嗎

VibeServe 在問一個很實際的問題:AI 代理能不能幫忙打造客製化的 LLM serving 系統。可惜目前提供的摘要筆記沒有公開 benchmark 細節。

為什麼 Agentic RAG 比 Static RAG 更適合真實工作

Agentic RAG 在複雜、多步驟查詢上明顯優於 static RAG,但代價是更高成本與更嚴格的控制需求。

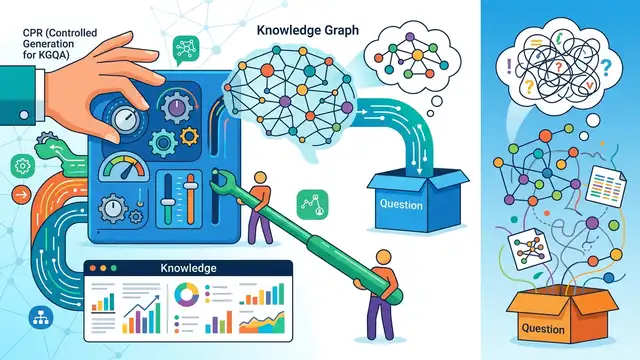

CPR 讓 KGQA 更可控

CPR 把 conformal calibration 放到 KGQA 的推理路徑層級,目標是讓答案集合更小、覆蓋率更穩定,提升可部署性。

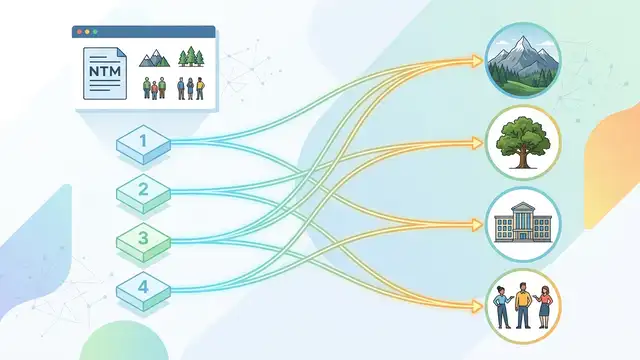

NTM 讓 4 步生成保留精確似然

NTM 把少步生成改寫成精確似然的 flow 模型,主打四步就能產生不錯的文字生成影像結果,同時保留可訓練、可分析的機率式框架。

AutoTTS讓LLM自己找推理策略

AutoTTS把 test-time scaling 變成環境搜尋問題,讓 LLM 在推理時自動找出更省算力的策略,而不是靠人手調 heuristics。

Microsoft GoalCover 找出微調缺口

Microsoft Research 的 GoalCover 會在微調前找出資料缺口,並在 Qwen-3-14B 的金融摘要任務上提升 reward 分數。

BAMI 不重訓也能修 GUI 定位偏差

BAMI 用推論階段的調整,降低 GUI grounding 在高解析與複雜介面中的精準度偏差與歧義偏差,主打不重訓也能提升定位準確率。

UniPool:共享 MoE 專家池

UniPool 把 MoE 的分層專家改成全域共享池,減少重複參數,並在五個 LLaMA 規模模型上改善驗證損失。

ActCam 讓鏡頭和動作一起控

ActCam 用零樣本方式,同時控制影片生成中的角色動作與攝影機路徑,重點是不必重新訓練新模型。

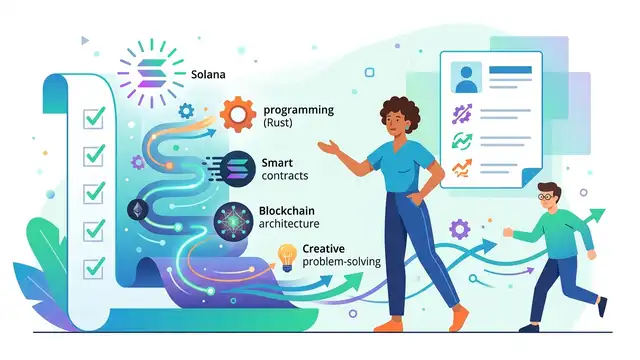

為什麼 Solana 開發者招募不該再把技能當成靜態清單

Solana 開發者招募應把技能視為會移動的目標,而不是固定的檢查表。

Grok 幫忙找出五個不等式

這篇短篇數學筆記寫的是 Grok 參與發現五個新不等式,之後再由作者親自驗證;重點不在工具本身,而在 AI 輔助探索能不能幫研究者更快找到可證明的結果。

LLM 學到文法了嗎?

這篇研究用線性 probe 讀取語言模型隱藏層,發現模型對「文法正確性」有獨立於字串機率的訊號,但在語意合理性上仍不如 likelihood。