NTM 讓 4 步生成保留精確似然

NTM 把少步生成改寫成精確似然的 flow 模型,主打四步就能產生不錯的文字生成影像結果,同時保留可訓練、可分析的機率式框架。

NTM 把少步生成變成可保留精確似然的 flow 模型,目標是用四步完成高品質生成。

少步生成一直是生成模型的現實需求。步數越少,延遲越低,成本也越好控。問題是,很多原本為「很多小步」設計的方法,一旦硬壓成幾個大步,模型假設就會開始鬆動。這篇論文就是在處理這個落差。

論文 Normalizing Trajectory Models for 4-Step Generation 提出的 NTM,想把少步生成拉回到一個更完整的機率式框架裡。它不是只追求更快,而是要在快的同時,保留 exact likelihood 這種對訓練與分析都很重要的特性。

這點很關鍵。因為很多少步方法雖然能加速,但常常是靠 distillation、consistency training 或 adversarial objective 之類的技巧換來速度。代價是,它們會逐漸離開原本以 likelihood 為核心的生成建模方式。NTM 的主張,就是把這條路重新接回來。

這篇論文想解的痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

Diffusion 類方法的強項,在於它們很適合做很多次細小的去噪更新。可是一旦你想把整個生成流程壓縮成少數幾次轉換,原本的設計前提就不再那麼穩。這不是單純把步數調小而已,而是模型整個運作邏輯都要跟著改。

對開發者來說,這個痛點很直接。你想要更低 latency、更高 throughput、更低推論成本,但又不想犧牲模型的可解釋性、可訓練性,甚至是和其他機率模型對接時的便利性。少步生成與 likelihood-based training 之間,長期都有這種拉扯。

NTM 的切入點,就是試著讓這兩件事可以同時成立。它不是把生成過程硬改成另一種完全不同的黑盒,而是把每一步都設計成能維持 exact-likelihood 的 flow 式轉換。換句話說,它想要的是「少步」,不是「少了數學基礎」。

NTM 到底怎麼運作

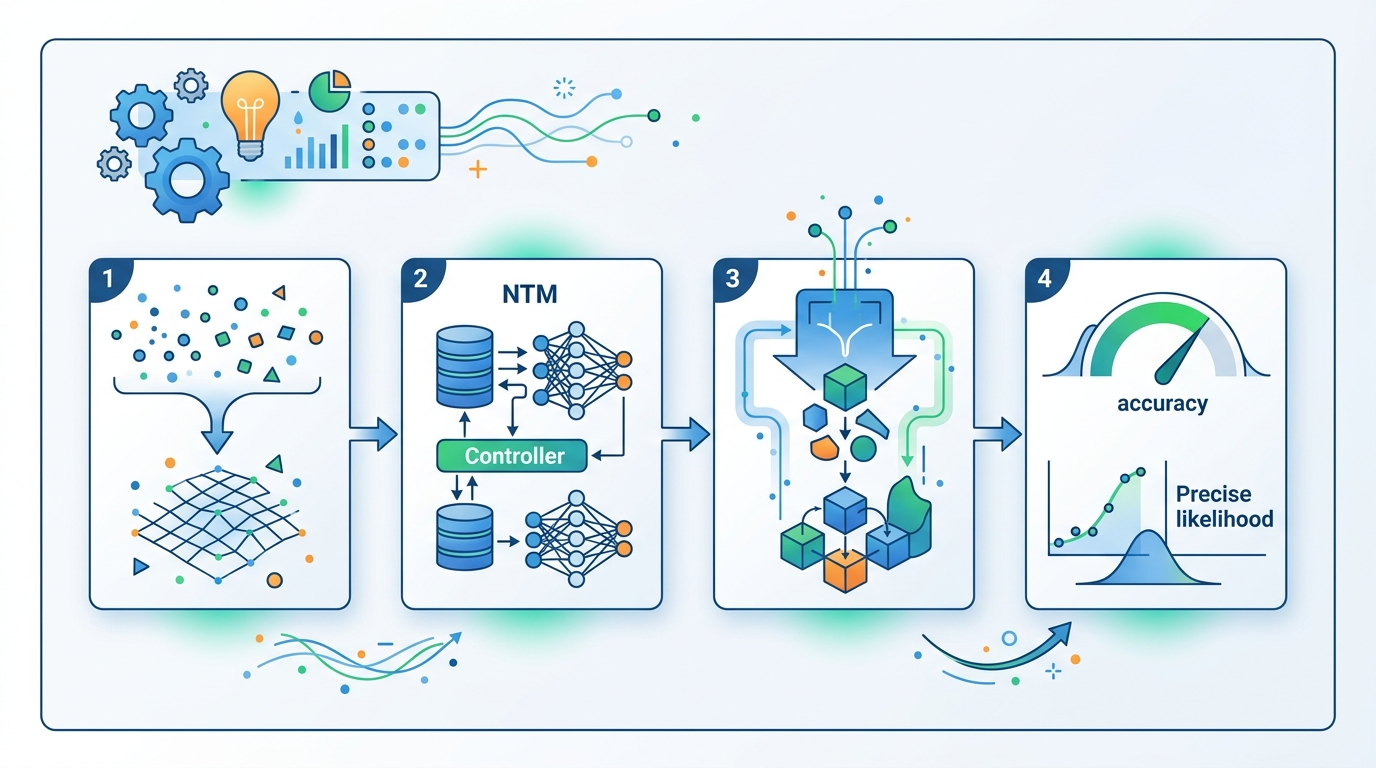

NTM 的核心做法,是把每個 reverse step 建模成一個 expressive conditional normalizing flow。白話一點說,它不把生成看成一連串近似去噪,而是看成一段段可訓練、可反推、而且能算精確 likelihood 的流式轉換。

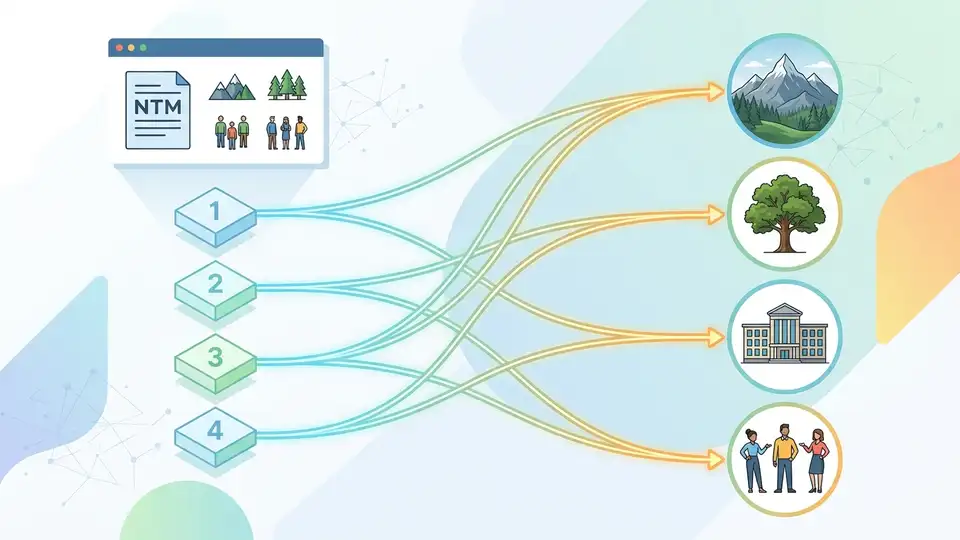

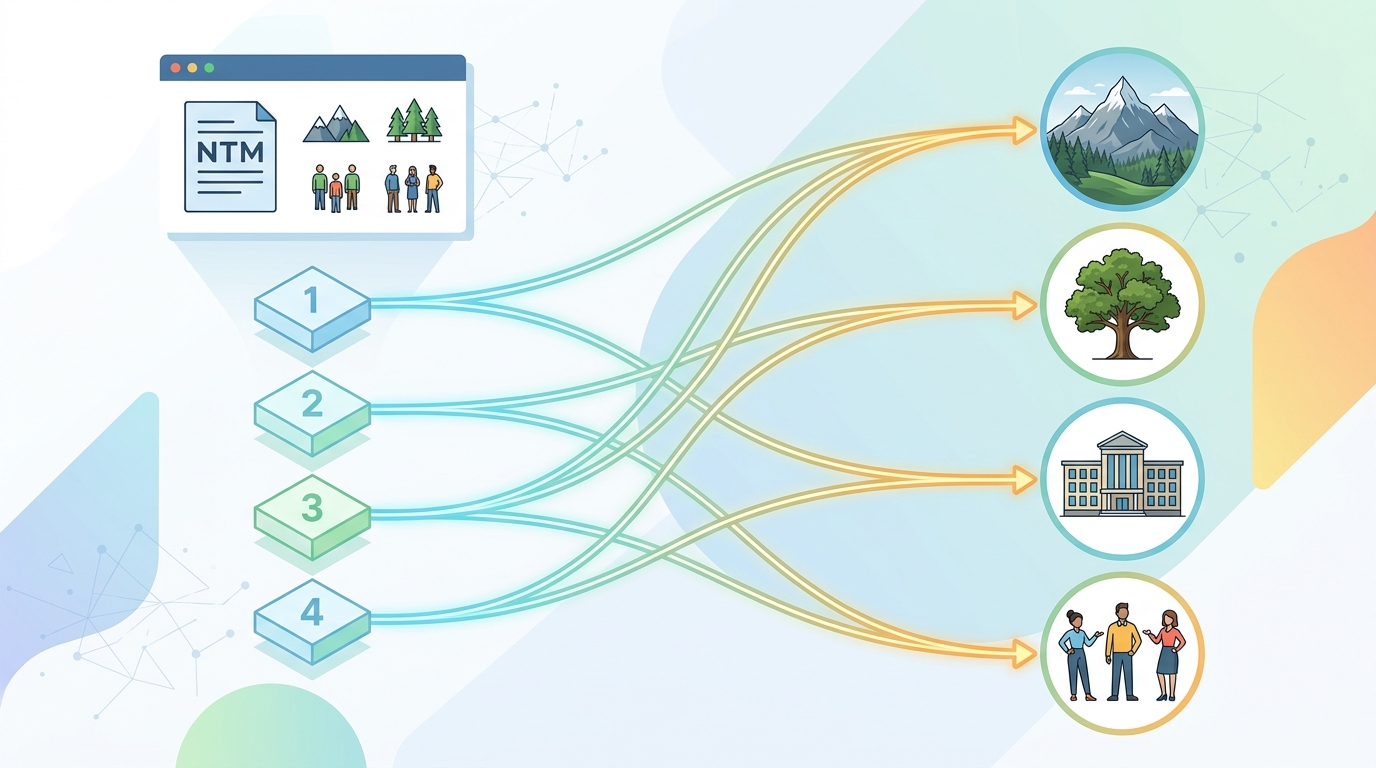

這裡有兩個層次。第一個是 step-level 的表達力,也就是單一步要夠強,能處理局部變換。第二個是 trajectory-level 的規劃,也就是整條生成軌跡不能只顧眼前一步,還要有全局協調。論文描述的架構,是在每個 step 裡放入 shallow invertible blocks,同時再用一個 deep parallel predictor 去處理整體軌跡。

這種拆法的意義很明確:局部與全局分工。不是叫單一模組同時負責所有事,而是讓可逆模組處理每一步的細節,讓軌跡預測器負責更長程的生成規劃。對少步生成來說,這種分層很合理,因為每一步都變得更貴,也更重要。

論文還提到,NTM 可以從零開始訓練,也可以用 pretrained flow-matching models 初始化。這代表它不一定要求團隊完全重來。如果你本來就在做 flow-based 或 diffusion-adjacent 的流程,這種初始化路徑會比較實際,至少不是把既有資產整個丟掉。

另一個值得注意的設計,是 self-distillation。因為 NTM 擁有 exact trajectory likelihood,它可以用自己的 score 去訓練一個輕量 denoiser,而這個 denoiser 能在四步內產生高品質樣本。也就是說,模型可以自己當老師,教出一個更快的推論版本。

論文實際證明了什麼

從 abstract 能確定的結果,其實只有幾個重點,但已經很有訊號。第一,NTM 在 text-to-image benchmarks 上,能在四個 sampling steps 內達到與強力影像生成 baseline 相當,甚至更好的表現。第二,它是少數能在這種少步設定下,仍然保留 exact likelihood over the generative trajectory 的方法。

這第二點比表面上看起來更重要。很多方法的故事是「我們把速度做上來了」,但 NTM 想證明的是:你可以同時保留速度與機率式嚴謹性。對研究者來說,這代表它不只是工程優化,而是一種建模框架上的整理。

不過,這篇摘要沒有公開完整 benchmark 細節。沒有看到具體資料集名稱、數字結果、baseline 清單,也沒有完整 metric。也就是說,我們現在只能根據 abstract 來確認方向:它宣稱在文字生成影像任務上,四步就能打到很強的結果,但還不能從摘要本身讀出更細的比較。

- 目標是少步生成,不是多步去噪的簡化版。

- 每個 reverse step 都用 conditional normalizing flow 來建模。

- 保留 exact likelihood,是這篇的核心賣點之一。

- Self-distillation 讓模型能教出更輕量的四步 denoiser。

- 摘要只說明 text-to-image 的強結果,沒有公開完整 benchmark 表格。

對開發者有什麼影響

如果你在做生成式系統,步數不是學術上的小數點,而是直接影響產品成本的變數。推論步數少,通常代表延遲更低、吞吐更高、部署壓力更小。對互動式應用、批次生成、或需要控制 GPU 成本的服務來說,這差很多。

NTM 的吸引力在於,它不是單純把 sampler 壓縮,而是保留了 likelihood-based 的訓練語言。這對很多開發者會很實用,因為 likelihood 讓模型比較容易被比較、被分析,也比較容易放進需要機率基礎的工作流裡。

Self-distillation 這件事也值得注意。大模型先學到完整 trajectory,再把自己的 score 轉成一個更輕的 denoiser,這種做法很像把訓練與部署切成兩層。你可以先用較重的模型把品質推上去,再用較快的版本承接推論。這對實務部署是很有吸引力的路線。

但也要講清楚,摘要沒有說明這套方法的工程成本。因為它同時用了 invertible blocks、trajectory predictor、exact likelihood training,推測起來實作與訓練複雜度不會太低。這不一定是缺點,但會影響它在真實專案裡的採用門檻。

還有哪些限制與待解問題

先講最直接的限制:摘要沒有給完整數字。沒有 benchmark table,就很難判斷它到底比哪些方法強、強多少、在哪些條件下更穩。這對想評估導入價值的工程團隊來說,資訊還不夠。

第二個問題是泛化範圍。摘要明確提到 text-to-image benchmarks,但沒有說其他模態是否同樣適用。少步生成在不同任務上常常會遇到不同瓶頸,所以現在還不能直接把它當成通用替代方案。

第三個問題是訓練與部署成本。理論上 exact likelihood 很漂亮,但漂亮不等於便宜。若模型內部結構更複雜,訓練時間、記憶體使用、以及實作維護成本都可能上升。摘要沒有提供這些資訊,所以這部分仍是空白。

但即便如此,NTM 的方向還是很清楚:它在嘗試把少步生成從「速度優先、理論退讓」的路線,拉回到「速度與機率式建模可以兼得」的路線。對關心生成模型實作的人來說,這是一個值得持續追的方向。

如果後續論文正文補上更完整的 benchmark、消融實驗與計算成本,這篇方法的定位會更清楚。就目前摘要來看,它已經不是單純的加速技巧,而是一次把少步生成重新形式化的嘗試。

一句話看懂這篇的重點

NTM 想證明,少步生成不一定要放棄 exact likelihood;它可以用 conditional normalizing flow 把四步生成做得又快、又能維持機率式框架。