BAMI 不重訓也能修 GUI 定位偏差

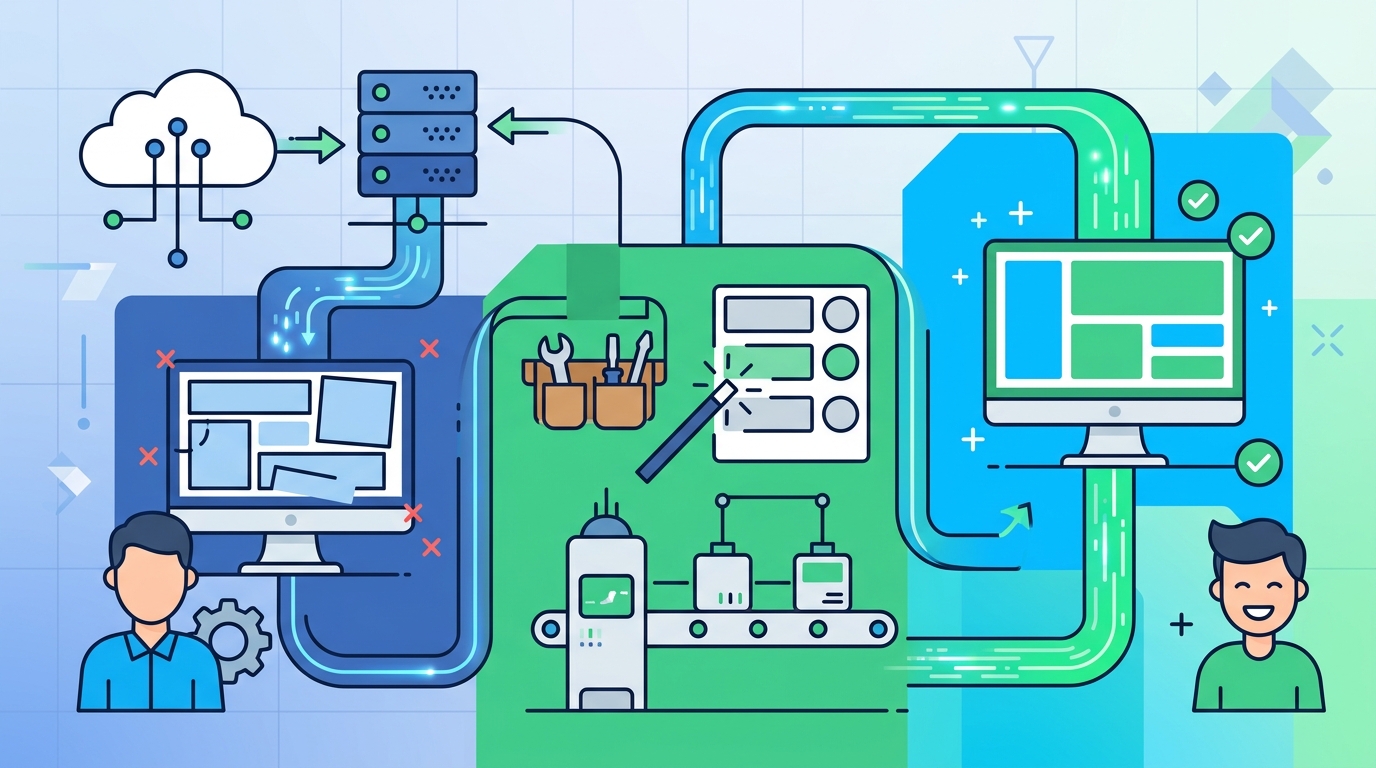

BAMI 用推論階段的調整,降低 GUI grounding 在高解析與複雜介面中的精準度偏差與歧義偏差,主打不重訓也能提升定位準確率。

BAMI 是一種不重訓的 GUI grounding 方法,透過推論階段調整來減少高解析與複雜介面造成的定位偏差。

GUI grounding 做的事很單純:看著畫面,判斷該點哪裡、拖哪裡、操作哪個元件。真正麻煩的是,畫面一旦變得很密、解析度很高,或是按鈕和欄位長得很像,模型就容易判錯。這篇論文想處理的,就是這種在真實介面裡很常見、但又很難靠直覺修掉的失誤。

論文標題是 BAMI: Training-Free Bias Mitigation in GUI Grounding。它的重點不是再訓練一個更大的模型,而是想辦法在推論時把模型帶偏的地方拉回來。對已經把 GUI grounding 模型放進工具鏈、或正在做介面自動化的開發者來說,這種做法的吸引力很直接:不用重跑訓練流程,也可能拿到更好的結果。

這篇在解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

作者把 GUI grounding 的失敗,拆成兩種偏差:precision bias 和 ambiguity bias。前者跟高解析畫面有關。畫面越大、細節越多,模型越容易在定位上失準。後者則是介面本身太複雜、太擁擠,讓模型很難分辨到底哪個元素才是正確目標。

這個拆法比單純說「模型在困難截圖上表現不好」更有用。因為它把問題對準到兩個具體來源:一個是解析度與定位精度的問題,一個是候選目標太多、太像的問題。也就是說,作者不是把失敗歸咎於模型整體能力不足,而是認為可以從推論流程下手,針對不同偏差做修正。

論文背景提到像 ScreenSpot-Pro 這類困難基準,現有 GUI grounding 模型在這裡容易卡關。這也符合很多開發者的實務經驗:不是模型完全不懂畫面,而是在密集介面、相似元件、細小目標這些場景裡,命中率會掉得很明顯。

BAMI 到底怎麼運作

先說結論:BAMI 是 training-free,也就是不需要更新模型權重,不需要重新收集一套新標註資料來重訓。這一點很重要,因為它把問題從「重新打造模型」改成「改善模型怎麼被用」。

作者先提出一個叫做 Masked Prediction Distribution,簡稱 MPD attribution 的方法,用來做錯誤歸因。原始摘要沒有展開完整演算法細節,但從描述可以看出,MPD 的角色是協助辨識模型錯在哪裡,並把前面提到的兩種偏差凸顯出來。換句話說,它像是一個診斷工具,先看清楚偏差來源,再決定怎麼修。

在這個診斷之上,作者再提出 Bias-Aware Manipulation Inference,也就是 BAMI 本體。它在推論階段做兩件事:coarse-to-fine focus 和 candidate selection。前者的意思是先粗略縮小範圍,再逐步細化定位;後者則是先處理候選元件的排序或篩選,再做最後的 grounding 判定。

這種流程其實很符合工程實務。當畫面太複雜時,直接要求模型一次命中精準座標,常常只會讓錯誤放大。先縮小搜尋空間,再處理相似候選,通常比硬碰硬更穩。BAMI 做的事,就是把這個思路變成一個可重複使用的方法。

摘要沒有提供完整的實作步驟,所以我們不能把它想成某種已公開細節很完整的標準模組。比較準確的說法是:它提供了一個以推論為核心的偏差緩解框架,重點在於如何引導模型避開高解析與歧義帶來的錯誤。

論文實際證明了什麼

根據摘要,作者做了大量實驗,結果顯示 BAMI 可以在 training-free 的前提下,明顯提升多個 GUI grounding 模型的準確率。摘要也提到,他們做了 ablation studies,表示這個方法在不同參數設定下具有一定穩定性。

目前摘要裡唯一明確公開的數字,是 TianXi-Action-7B 在 ScreenSpot-Pro 上的表現:套用 BAMI 之後,accuracy 從 51.9% 提升到 57.8%。這代表 5.9 個百分點的增幅。對一個不需要重訓的推論方法來說,這個提升算是相當有感。

不過,這裡也要講清楚限制。摘要沒有公開完整 benchmark 細節,所以我們不知道它在其他資料集、其他模型家族、或不同類型介面上的完整表現。也沒有看到 latency、推論成本、或額外計算負擔的數字。對部署來說,這些資訊都很重要,但在目前提供的來源裡沒有寫出來。

另外,摘要雖然說「multiple GUI grounding models」與「various parameter configurations」,但沒有逐一列名,也沒有給出每個設定的具體結果。因此,若要評估它是不是能穩定複製到不同產品場景,還需要看論文全文才知道。

- 不需要重訓,主打推論階段修正。

- 鎖定兩種偏差:precision bias 與 ambiguity bias。

- 用 MPD attribution 做錯誤歸因。

- 在 ScreenSpot-Pro 上,TianXi-Action-7B 從 51.9% 提升到 57.8%。

- 摘要提到 ablation studies,顯示方法對參數設定有一定穩健性。

對開發者有什麼影響

如果你在做 GUI agent、桌面自動化、或任何需要從螢幕畫面找元件的系統,BAMI 的價值在於它提供了一條「先別重訓」的路。很多時候,重訓不是不能做,而是成本太高、流程太慢、風險太大。尤其當模型已經上線,或你沒有完整訓練管線的控制權時,能在推論端做改善,通常更容易落地。

這篇論文也提供了一個很實用的故障分析角度。當模型在高解析、密集介面上出錯時,不一定只是「模型不夠強」。問題可能更細:是定位太追求精準,還是候選元件太多、太像,導致模型選錯。把錯誤拆成這兩類,會比籠統地說模型表現差更有助於除錯。

對產品團隊來說,這種方法也比較容易做成漸進式導入。因為它不改權重,你可以把它包在現有 pipeline 外層,先做 A/B 測試,再決定是否長期採用。若效果不理想,也比較容易回退。這些都是 training-free 方法在工程上常見的優勢。

但它的限制同樣明顯。首先,摘要沒有說明 MPD、coarse-to-fine focus、candidate selection 的完整細節,所以外部讀者還無法直接判斷實作複雜度。其次,沒有 latency 或算力開銷資訊,這代表我們還不知道它在即時互動場景裡會不會太慢。再來,摘要沒有證明它在所有 GUI 類型上都有效,所以不該把它視為萬用解法。

換句話說,BAMI 比較像是一個針對特定失誤模式的推論修正框架,而不是一個取代模型訓練的終極方案。它的訊號很清楚:有些 GUI grounding 問題,不一定要靠更多訓練資料解決,先把推論流程調順,可能就能拿到實際增益。

這篇論文的實際意義

對研究社群來說,這篇把 GUI grounding 的失敗原因講得更具體。對工程團隊來說,它提醒大家,介面理解問題不一定要從模型結構大改開始。很多時候,先處理解析度偏差和候選歧義,就能改善一大段體驗。

如果你正在做視覺型自動化,這篇最值得帶走的不是某個神奇模組,而是它的思路:把錯誤歸因做細,然後在推論階段動手。這種方法不一定每次都能帶來同樣幅度的提升,但它確實提供了一個相對低風險的優化方向。

總結來看,BAMI 把 GUI grounding 的問題從「模型準不準」改寫成「模型在什麼情境下會偏掉」,然後用不重訓的方式去修。對台灣開發者來說,這類方法特別值得關注,因為它更接近產品導入時會遇到的現實限制:時間有限、資料不夠、訓練成本高,但你還是得把準確率往上拉。