AlphaGRPO 讓多模態模型學會自我修正

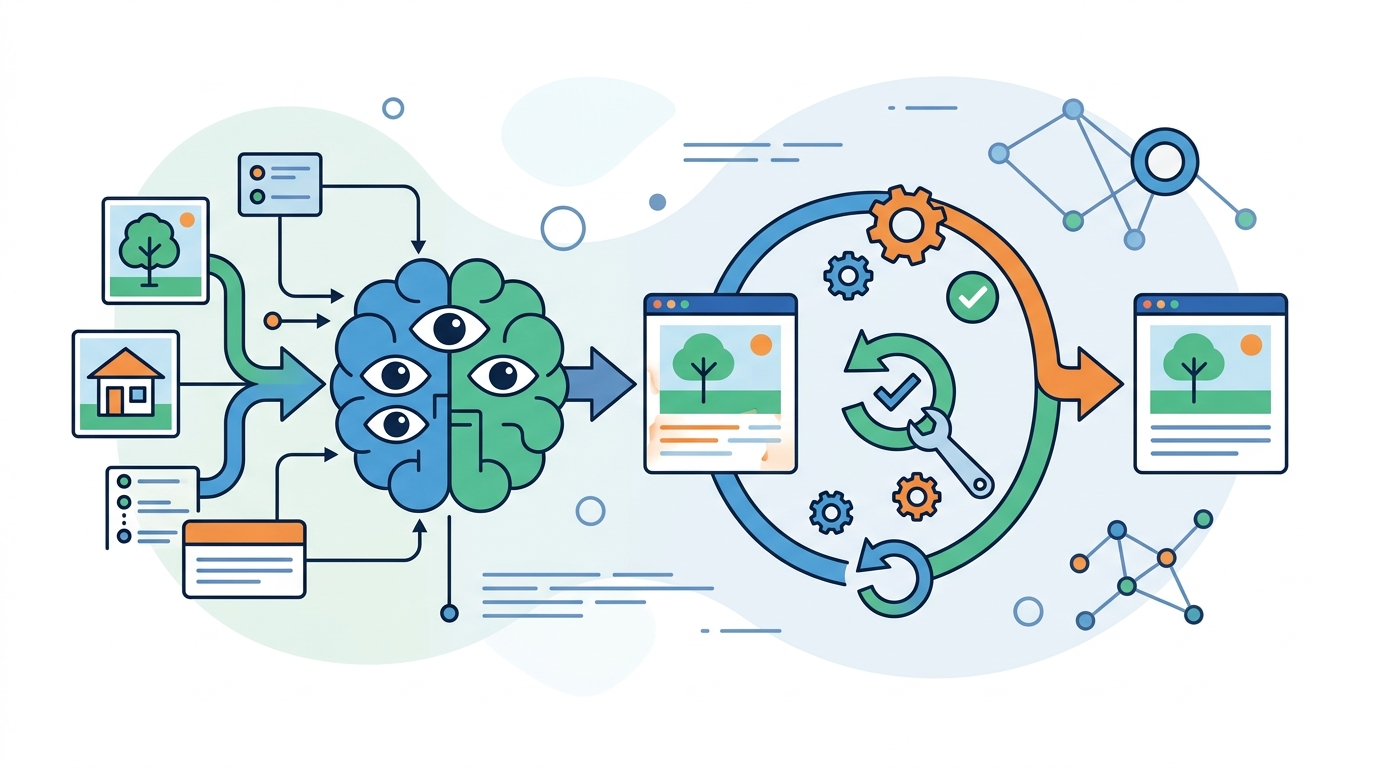

AlphaGRPO 把可驗證、可拆解的獎勵訊號加進多模態模型訓練,讓模型能推理、修正輸出,並在不靠 cold-start 的情況下提升生成表現。

AlphaGRPO 用可拆解的可驗證獎勵,讓多模態模型在生成時能推理、檢查,並自己修正錯誤。

多模態生成模型這幾年進步很快,但訓練時有個老問題一直沒解好:回饋訊號太模糊。你可以告訴模型「這張圖好不好」,卻很難精準指出它到底是主體錯了、風格歪了、構圖跑掉了,還是沒看懂使用者真正想要什麼。這篇 arXiv 論文 AlphaGRPO: Unlocking Self-Reflective Multimodal Generation in UMMs via Decompositional Verifiable Reward,就是在處理這個痛點。

作者的核心想法很直接:不要把一個複雜生成任務只壓成單一分數,而是把需求拆成一個個可檢查的小問題。這樣一來,模型拿到的監督會更穩定,也更容易看出它到底卡在哪裡。對開發者來說,這種訊號比「總分幾分」更有用,因為它比較能對應到真實除錯流程。

這篇論文想解什麼問題

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這篇研究鎖定的是 unified multimodal models,簡稱 UMMs;更具體一點,作者聚焦在 AR-Diffusion UMMs。這類模型不只是把文字變成圖片,還要能理解隱含意圖、維持和使用者需求一致,甚至在輸出不對時自己修正。問題是,這些能力很難用單一獎勵值來訓練。

如果模型只收到一個整體分數,它很可能不知道自己到底哪裡做錯。是主體不對?是風格不對?還是布局不符合要求?對多模態任務來說,這種不清楚的回饋很致命,因為一個 prompt 常常同時包含好幾個限制條件。作者把這件事視為監督問題:你要模型進步,就得先給它可靠、看得懂的回饋。

另外,這篇方法還有一個很實際的設計目標:不要先走一個額外的 cold-start 階段。也就是說,它希望直接透過後續訓練提升模型,而不是先做一段前置流程再進入強化學習。這對工程上很重要,因為多一個階段通常就代表更多資料處理、更長訓練管線,還有更多維運成本。

從這個角度看,AlphaGRPO 不只是想把模型做得更強,而是想把訓練訊號做得更像人類 debug:先拆問題,再逐項檢查,最後看整體有沒有對齊需求。

AlphaGRPO 的方法到底怎麼運作

AlphaGRPO 把 Group Relative Policy Optimization,也就是 GRPO,套用到 AR-Diffusion UMMs 上。真正的關鍵不只是 optimizer,而是它怎麼設計 reward。論文提出 Decompositional Verifiable Reward,簡稱 DVReward,目的就是把原本容易飄的回饋,變成更結構化、更可驗證的監督訊號。

流程大致是這樣:先由一個 LLM 把使用者需求拆成一組原子化的語意與品質問題。這些問題要夠細,才有辦法一題一題檢查。接著再由一個通用 MLLM 來評估這些問題,給出可驗證、也比較容易解釋的回饋。換句話說,模型不是只被問「整體好不好」,而是被問「這幾個關鍵點有沒有做到」。

這種設計和傳統 holistic scoring 最大的差別,在於它把失敗原因攤開來看。單一分數會把很多錯誤混在一起,但拆解後的問題可以告訴你,模型是在哪一段失手。對多模態生成來說,這很重要,因為 prompt 裡常常同時有主體、風格、品質、結構、內容一致性等多重要求。

作者也把這個方法描述成能喚醒模型的兩種能力:一是 reasoning text-to-image generation,也就是在生成時主動推理隱含意圖;二是 self-reflective refinement,也就是模型能診斷自己輸出和需求之間的落差,然後做修正。這不是單純把圖做漂亮,而是讓模型在生成過程中更會「想」,也更會「改」。

如果用白話講,AlphaGRPO 的訓練方式不是只教模型「答案長什麼樣」,而是教它「怎麼檢查自己有沒有答對」。這種差異,對需要高一致性的多模態系統很關鍵。

論文實際證明了什麼

從摘要來看,作者做了大量實驗,而且結果是正向的。論文指出,AlphaGRPO 在多個多模態生成 benchmark 上都有穩健改善,包括 GenEval、TIIF-Bench、DPG-Bench 和 WISE。除此之外,它在 GEdit 這類編輯任務上也有明顯提升,而且即使模型沒有針對編輯任務訓練,仍然能看到進步。

不過,這裡有個很重要的限制:摘要沒有公開完整 benchmark 數字,所以我們無法只靠這份來源判斷提升幅度有多大,也不能知道不同資料集、不同任務類型或不同模型規模之間,改善分布是不是一致。換句話說,方向是清楚的,量化細節則沒有在摘要裡展開。

即便如此,結果的意義還是很明確。若一個主要面向生成的訓練方法,也能讓未直接訓練過的 editing 任務變好,這通常代表它學到的不是某個單一任務技巧,而是更一般的內在對齊能力。作者的說法也呼應這一點:self-reflective reinforcement 可以利用模型本來就有的理解能力,去引導更高保真度的生成。

這件事值得注意,因為它暗示模型不是只在學「怎麼拿高分」,而是在學「怎麼發現自己哪裡和需求不一致」。對多模態系統來說,這種能力常常比單次輸出更重要,因為真實產品流程裡,輸出不對時往往要能快速修正,而不是每次都重抽一次。

對開發者有什麼影響

如果你在做多模態產品,這篇論文提供的是一個很實用的工程思路:把監督訊號做成可拆解、可驗證、也比較好 debug 的形式。這種做法特別適合那些 prompt 裡塞了很多要求的任務,因為單一 reward 太粗,根本不夠看。

它也指向一種更進階的自我修正流程。如果模型真的能判斷自己哪裡偏離了需求,那你就有機會把一些人工後處理、外部校正步驟,往前收進模型訓練裡。對需要大量品質控管的生成管線來說,這會很有吸引力。

更大的訊息其實是:訓練訊號的設計,可能和模型規模一樣重要。這篇論文不是在說「多給一點 reward 就會更好」,而是在說「reward 要設計得夠清楚、夠結構化」。對做 multimodal alignment 的團隊來說,這個差別很大,因為更可解釋的獎勵,通常也更容易追查失敗原因。

從實作角度看,這種方法也比較像把評測邏輯前移到訓練階段。你不是等模型出錯後才人工檢查,而是先把錯誤拆成可檢查的條件,讓模型在訓練時就學會對照。這種設計如果做得好,對產品迭代速度會有幫助。

但它也有明顯限制

先講最直接的:摘要沒有 benchmark 數字,所以我們無法從這份資料知道提升到底有多大,也不能確認是否達到某個實務上有感的門檻。對研究新聞來說,這不是小事,因為很多方法看起來方向對,實際幅度卻可能差很多。

另外,摘要也沒有說清楚模型大小、訓練成本,或 LLM 與 MLLM 這套 reward pipeline 在實務上有多貴。這代表工程導入時仍有不少未知數。尤其是當你要先把 prompt 拆成原子問題,再讓另一個模型去評估,整體系統複雜度一定會上升。

還有一個沒被回答的問題,是 DVReward 的泛化能力。摘要提到它在幾個 benchmark 和編輯任務上有效,但沒有說它在更開放式、更模糊、或不同多模態領域的 prompt 下會不會一樣穩。這點對產品很關鍵,因為真實使用者的需求通常比 benchmark 更亂。

最後,方法本身也隱含一個敏感點:原子化拆解做得好不好,會直接影響 reward 品質。如果拆解不準,後面的可驗證評估就可能跟著偏掉。也就是說,這套方法雖然更結構化,但它不是魔法,還是很吃前端分解與判定的品質。

結論

AlphaGRPO 的重點,是把多模態生成的回饋從「一個總分」改成「一組可驗證的細項」。它用 GRPO 搭配 DVReward,讓 AR-Diffusion UMMs 在生成時更會推理,也更會自我修正。摘要聲稱它在多個生成 benchmark 和編輯任務上都有改善,而且不需要 cold-start 階段。

對開發者來說,這篇論文最值得帶走的不是某個單點技巧,而是一個訓練觀念:當任務本身是多條件、多約束、又很難一句話評分時,獎勵設計本身就是產品能力的一部分。多模態對齊如果是瓶頸,也許該先檢查的不是模型有沒有更大,而是回饋有沒有更聰明。

- 它鎖定的是 AR-Diffusion unified multimodal models。

- 它用 GRPO 搭配 Decompositional Verifiable Reward 來訓練。

- 摘要提到 GenEval、TIIF-Bench、DPG-Bench、WISE 與 GEdit 上有改善。

- 摘要沒有提供完整數字,所以無法從原文判斷提升幅度。

如果你在做多模態生成、編輯或對齊,這篇論文給的訊號很清楚:把 reward 拆細,可能比單純把模型訓更久更有效。