為什麼 AI 程式助理需要更嚴的治理,而不是全面封殺

AI 程式助理值得用,但前提是更嚴格的治理、審查與安全控制,而不是一刀切封禁。

AI 程式助理值得採用,但前提是納入更嚴格的安全治理與審查控制。

我支持 AI 程式助理,但前提是資安團隊對它的使用有否決權。

我支持導入,是因為商業理由已經很清楚。開發者被重複工作淹沒,交期越來越緊,技術債又卡在管理層平常看不到的地方。程式助理可以先寫測試、解釋舊程式、提出重構建議,還能幫資淺工程師在不等資深同事的情況下先往前推。Microsoft 在 2025 年提到,已有 1500 萬名開發者使用 GitHub Copilot,這表示它早就不是噱頭。生產力提升是真實的,假裝沒這回事,只會逼公司走向影子使用,最後更難管。

第一個論點:生產力收益是真實的,而且不小

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

AI 程式助理最擅長處理那些耗時、但不一定創造高價值的工作。樣板碼、文件落差、重複性的測試骨架、舊系統導讀,這些都是拖慢交付、消耗工程師耐性的來源。當工具先產出第一版,資深工程師就能把時間花在架構與判斷,而不是瑣碎勞動。軟體團隊失敗,不只因為想法差,也常因為摩擦累積太多。

最有力的證據不是宣傳,而是採用規模。GitHub Copilot 的使用量說明,工程師是用鍵盤做選擇,不是用簡報做選擇。當同類工具被數百萬開發者日常使用,問題就不再是「有沒有用」,而是「組織有沒有能力治理」。拒絕工具不會保住安全,只會保住低效率,還讓人私下繞過政策。

第二個論點:資安風險是結構性的,不是表面瑕疵

資安團隊的反對不是杞人憂天,因為風險不只是 AI 寫出一個錯誤函式。真正的問題是,產出速度遠快於審查能力,控制縫隙就這樣出現了。模型可能建議沒人想要的依賴套件,資淺工程師可能把敏感資訊貼進提示詞,生成的程式也可能因為看起來很完整就被放行。最後,組織得到的不是更聰明的流程,而是更快的錯誤。

供應鏈風險更不能忽視。Snyk 曾提到 2026 年 2 月一個案例,AI 程式工具的 issue triage bot 被串成供應鏈攻擊路徑。這類案例之所以重要,是因為它把風險具體化了。問題不在模型本身有多邪惡,而在 AI 輔助工作流一旦缺少來源追蹤、紀錄與依賴審查,爆炸半徑就會被放大。

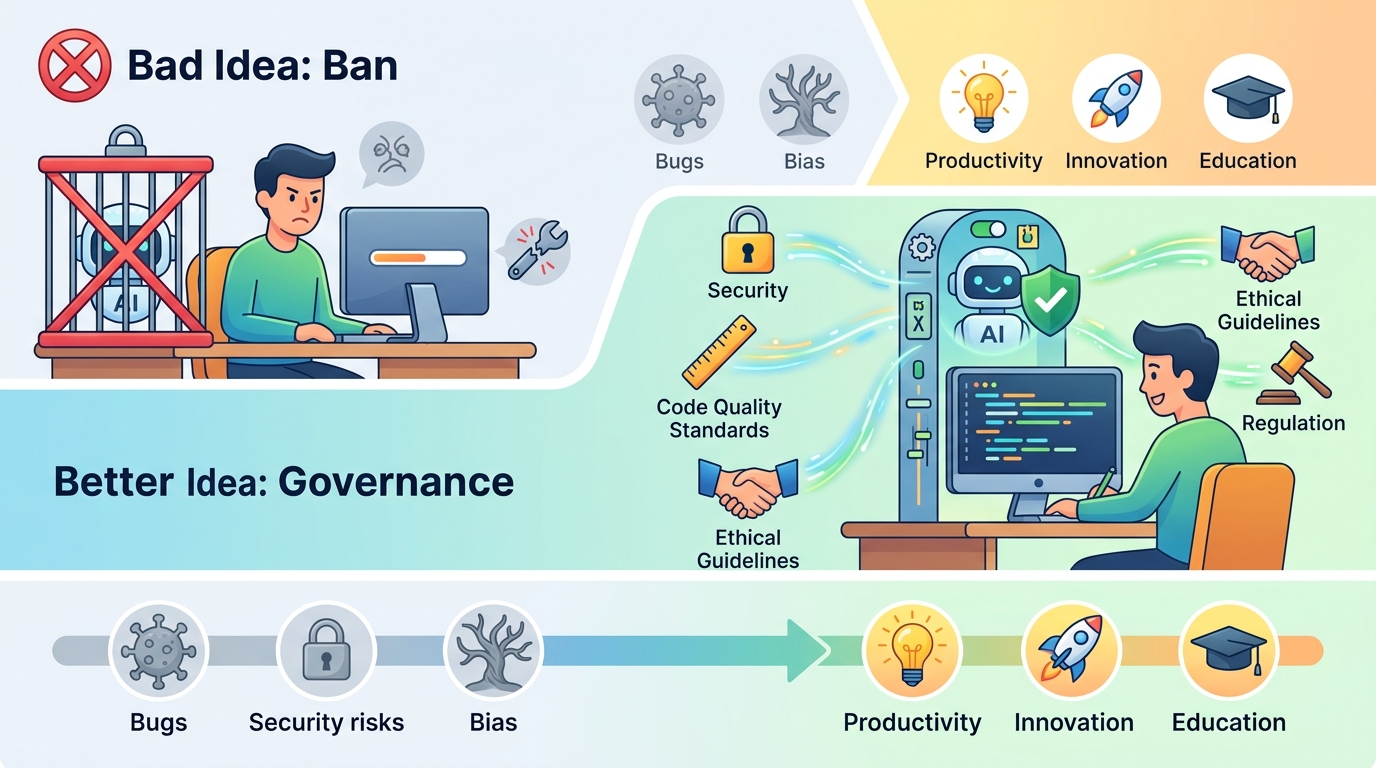

反方可能怎麼說

最強的反方論點很簡單:AI 程式助理已經嵌進開發流程,如果再加上一堆治理,速度優勢就會被吃掉。每個提示都要檢查、每個輸出都要多一層審核、每個用途都要先核准,工具就會變成官僚成本。資安團隊本來就忙著追雲端、身分與供應鏈風險,要他們逐筆管制 AI 輔助變更,聽起來只會造成塞車與反感。

這個擔憂是真的,所以全面封殺才是壞答案。但反駁更強:選項不是速度對安全,而是受控速度對隱形風險。如果你不先定義哪些情境能用、工具能看哪些資料、哪些程式碼區塊不能碰、合併前要留下什麼證據,開發者照樣會用。結果不是更快交付加上更少檢查,而是更快交付加上看不見的風險。

你能做什麼

如果你是工程師、PM 或創辦人,把 AI 程式助理當成生產系統,不要當成福利。先放行低風險場景,例如測試生成、文件輔助與程式解釋;秘密管理、驗證流程、加密邏輯、受監管資料路徑與敏感基礎設施程式,沒有明確審查規則就別碰。要求提示詞衛生、依賴掃描、紀錄留存與真人簽核。最重要的是,讓資安在設計階段就進來。治理如果在採用之後才補上,你不是在管理 AI 輔助開發,你是在跟它談判。