NVIDIA GTC 2026 重點拆解

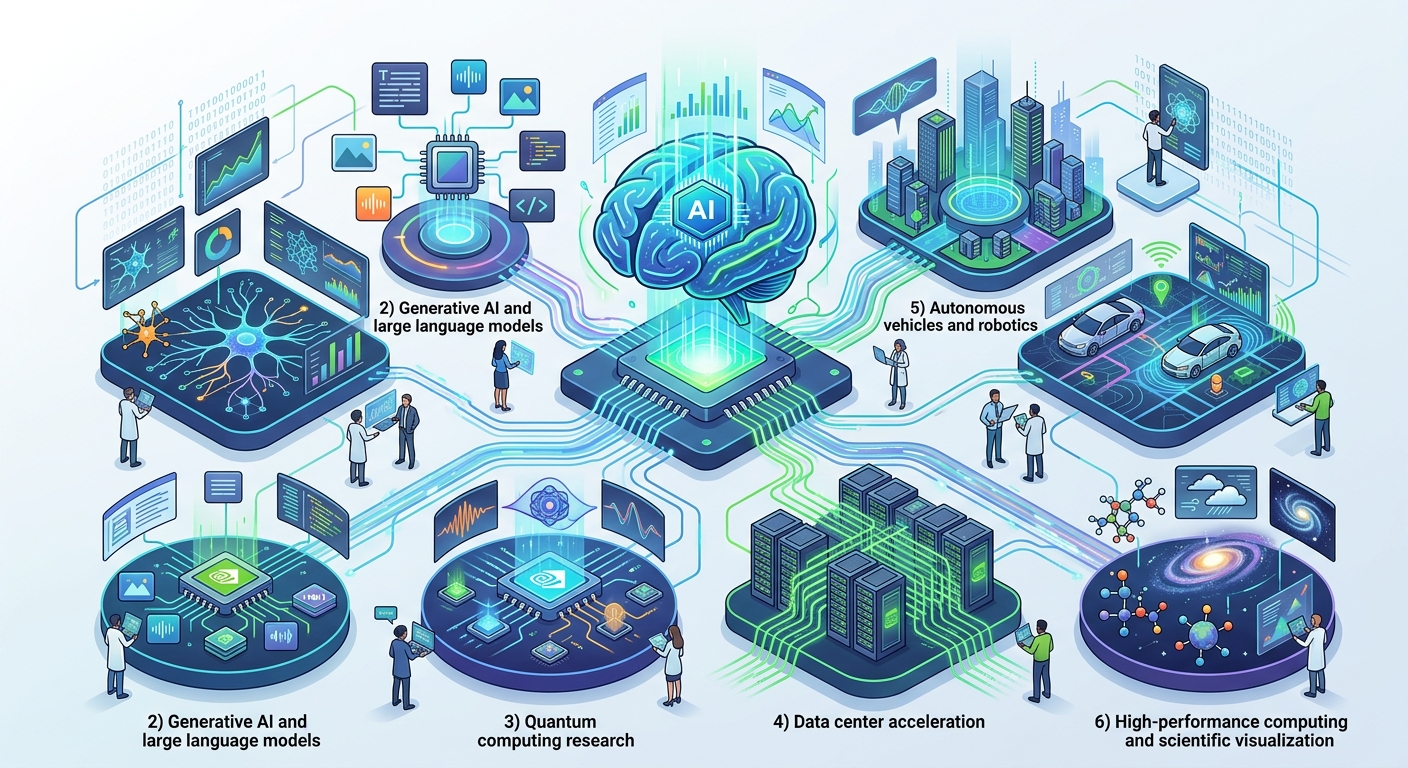

NVIDIA 在 GTC 2026 一口氣端出 1,000 場 session、2,000 位講者,還把 AI 工廠、推論基礎設施、Agent 平台與實體 AI 全部綁成一套銷售方案。這場大會重點不是單一 GPU,而是從晶片到軟體的整包系統。

NVIDIA 今年的 GTC 2026,場面真的很大。Jensen Huang 在聖荷西台上直接丟出數字,超過 1,000 場 session、2,000 位講者,還有 450 多家贊助商。光看這些數字,你就知道這不是單純的開發者大會,比較像一場把整個 AI 產業鏈叫來開會的超大型業務場合。

但講白了,真正重要的不是機器人跳舞,也不是 AI 生成的音樂回顧。這次 GTC 的核心訊息很直接:NVIDIA 要賣的早就不是單顆 GPU,而是一整套 AI 工廠。從晶片、伺服器、網路、儲存、模擬,到 Agent 執行環境,它想全包。

如果你是台灣做資料中心、企業軟體、系統整合,甚至做邊緣運算的人,這次 GTC 很值得看。因為 NVIDIA 已經把產品敘事從「買卡」改成「買整個 AI 基礎設施」,而且這套話術看起來不是說說而已。

GTC 2026 真正主角是 AI 工廠

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

Jensen Huang 這次的主軸很明白,就是 AI factory。你可以把它理解成新一代資料中心,但它不是傳統雲端機房的延伸,而是專門為模型訓練、推論、Agent 執行和模擬打造的生產線。NVIDIA 想賣的是這整條線,不是裡面某一個零件。

這次最醒目的平台是 Vera Rubin。NVIDIA 把它定義成給 agentic AI 用的 full-stack computing platform。這種講法很有意思,因為它不是在比單顆晶片跑分,而是在強調 CPU、GPU、記憶體、網路、儲存和軟體是一起設計的。對大客戶來說,這比單項規格更有吸引力。

Vera Rubin 的組成也刻意講得很完整。NVIDIA 說它涵蓋 7 顆晶片、5 套 rack-scale system,外加 1 套 supercomputer design,還有新的 Vera CPU 與 BlueField-4 STX 儲存架構。這種包法很像在告訴客戶:你不要自己拼,我這裡有整套參考答案。

Huang 還丟出一個很大的商業數字。他說 2025 到 2027 年之間,他看到至少 1 兆美元的營收機會。我覺得這句話有點業務腔,但也很誠實。因為這說明 NVIDIA 為什麼一直往網通、儲存、參考架構、模擬工具和資料中心藍圖擴張。單賣 GPU,天花板比較低。整包賣,單案金額才會夠大。

- GTC 2026 有超過 1,000 場 session。

- 現場有超過 2,000 位講者。

- 活動贊助商超過 450 家。

- Vera Rubin 涵蓋 7 顆晶片與 5 套 rack-scale system。

還有一個容易被忽略的點,是 DSX。NVIDIA 這次推出 Vera Rubin DSX AI Factory reference design、Omniverse DSX Blueprint,還有 DSX Air。意思很明白,連你還沒開始蓋機房前,它就想先進場。先幫你模擬,再幫你規劃,最後連實際部署都包進來。

對雲端服務商、模型公司,或大型企業來說,這很有吸引力。因為現在組一個大型叢集,成本不是幾百萬美元而已,常常是上億美元起跳。只要設計錯一層,後面維運就會很痛。NVIDIA 現在賣的其實是「少踩坑」的保險。

CUDA 還是 NVIDIA 最硬的護城河

今年剛好是 CUDA 20 週年。Jensen Huang 在 keynote 花了不少時間回頭講這段歷史。老實說,這不是懷舊而已,而是在提醒市場,NVIDIA 今天能從繪圖晶片一路吃到人工智慧,靠的不是只有硬體,還有一整層別人很難追上的軟體生態。

很多人講 NVIDIA,第一反應都是 GPU 很快。這沒錯,但只講一半。真正麻煩的是,CUDA 已經深深卡進研究、訓練、推論、科學運算、機器人模擬這些流程裡。你今天如果要換平台,不是換一張卡那麼簡單,而是整個軟體堆疊、工具鏈和團隊習慣都要重來。

所以 NVIDIA 現在講 full stack,底氣不是空的。因為它有 CUDA,才能把每一代新硬體都包進更大的軟體故事。從訓練框架、推論最佳化、網路通訊,到模擬環境,全部都能互相咬合。這也是為什麼競爭對手常常規格看起來不差,但實際導入還是卡卡的。

“This conference is going to cover every single layer of the five-layer cake of artificial intelligence.”

Jensen Huang,NVIDIA 執行長,GTC 2026

Jensen 在台上還特別把焦點拉回推論。他甚至直接接住分析師給 NVIDIA 的稱號,說自己是 inference king。這種講法很張揚,但背後的商業邏輯很清楚。訓練是一次性的大單,推論才是長期吃電、吃伺服器、吃 Token 成本的地方。

你可能會想問,那跟 CUDA 有什麼關係。關係很大。因為企業現在在意的,不只是某張卡每秒幾 TFLOPS,而是整個系統的 cost per token。軟體最佳化、記憶體配置、網路延遲、推論框架,全部都會影響成本。CUDA 讓 NVIDIA 可以把這些東西綁在一起賣。

更有意思的是,NVIDIA 還順手預告 Vera Rubin 之後的下一代架構 Feynman,還有 Rosa CPU、LP40、BlueField-5、CX10、Kyber 互連和光學 scale-out。名字很多,聽起來有點像在背宇宙艦隊清單。但商業訊息很簡單:它要客戶用「世代更新」的方式規劃 AI 基礎設施,而不是一次買一批伺服器就結束。

Agent 平台成了 NVIDIA 新戰場

這次另一個大主題,是 agentic AI。NVIDIA 在 GTC 上推了 OpenClaw、OpenShell 和 NemoClaw,想把 Agent 從模型展示拉到企業可部署的層級。這件事很重要,因為現在大家都在講 AI 助理,但真正能進公司內部流程的產品,卡的通常不是模型能力,而是安全、權限、資料路由和維運。

OpenClaw 被包裝成開源基底,OpenShell 是企業內部安全部署的 runtime,NemoClaw 則負責政策控管、隱私路由和網路護欄。這三個名字看起來有點中二,但拼起來其實就是一套企業 Agent 平台。NVIDIA 不想把這層市場全讓給 OpenAI、Anthropic 或各種 SaaS 新創。

Jensen 還說,每家公司現在都需要一套 OpenClaw strategy。這句話聽起來很像在下指導棋,但也反映出 NVIDIA 的判斷:企業內部 Agent 會是接下來 12 到 24 個月最實際的採購項目之一。因為它可以直接碰到客服、法務、內部知識庫、IT 支援和銷售流程。

- OpenClaw 被定位為個人與企業 Agent 的開源基礎。

- OpenShell 主打企業內部安全部署。

- NemoClaw 處理政策、隱私與網路護欄。

- GTC 現場還辦了 build-a-claw 活動,時間是 3 月 16 日到 3 月 19 日。

當然,台上有些說法還是有點浮誇。像 OpenClaw 被形容成「人類史上最受歡迎的開源專案」,這種話我覺得聽聽就好。你真的要比 Git、Linux、Python,這句話很難站得住腳。GTC 本來就有表演成分,這部分不用太認真。

但更實際的地方,在於 NVIDIA 正在把 Agent 跟自己的基礎設施綁死。你如果用它的 runtime、政策控管、隱私路由,再加上它的推論加速和伺服器,那整個系統就很難拆。這招很聰明。因為錢不一定要從聊天機器人訂閱來賺,從部署、維運和長期推論流量來賺,反而更穩。

NVIDIA 也擴大了 Nemotron Coalition,涵蓋語言、視覺、機器人、自駕、生物和氣候等 6 類模型家族。這表示它不打算只押單一通用模型,而是把模型做成產業套件。對企業來說,這比一個萬能聊天機器人更容易買單,因為應用場景更明確。

實體 AI 從配角變成主線

GTC 過去幾年一直都有機器人和自駕內容,但今年的比重明顯更高。Jensen 把 physical AI 跟推論、AI 工廠並列成核心主題,這代表 NVIDIA 已經不滿足於只待在雲端資料中心。它想把觸角伸到工廠、車輛、邊緣設備和自動化系統。

台上點名的合作夥伴也很多。車廠包含 BYD、Hyundai、Nissan、Geely,還提到跟 Uber 的 ride-hailing 部署合作。工業夥伴則有 ABB、Universal Robots、KUKA。連電信業者 T-Mobile 都被拿來講,因為邊緣 AI 需要更多靠近終端的運算節點。

現場那個 Olaf demo 看起來很秀,但它不是單純動畫表演。NVIDIA 想傳達的是,角色行為、物理模擬、感知與控制,可以透過 Newton physics engine 和 Omniverse 的模擬環境整合起來。也就是說,虛擬世界不再只是展示用,而是訓練真實機器的重要場地。

- 車廠夥伴包含 BYD、Hyundai、Nissan、Geely。

- NVIDIA 提到與 Uber 合作 ride-hailing 部署。

- 工業夥伴包含 ABB、Universal Robots、KUKA。

- Omniverse 與模擬工具被定位為真實機器的訓練場。

這塊市場很難做,但如果做起來,價值很高。因為實體 AI 涉及合成資料、模擬平台、機器人模型、邊緣推論硬體和實際部署。每一層都能收錢,而且採購週期通常比雲端訓練叢集更長。對 NVIDIA 來說,這是另一條長線收入來源。

台灣供應鏈也要特別注意這段。因為只要 physical AI 真的開始放量,受益的不會只有 NVIDIA。伺服器代工、工業電腦、感測器、散熱、網通、車用電子都有機會分到單。這也是為什麼近兩年很多硬體廠都開始重新包裝自己,從 OEM 講到 AI solution partner。說真的,這種轉型有些很硬拗,但市場方向確實在那裡。

不過現實面也要看清楚。自駕、機器人、工業自動化的導入速度,通常比雲端軟體慢很多。法規、安全認證、現場整合、售後維護,沒有一個簡單。NVIDIA 這次把 physical AI 拉到中心位置,代表它準備長期投入,不是明年就要看到全面爆發。

競品壓力還在,但 NVIDIA 先贏在整合

如果只看晶片,NVIDIA 當然不是沒有對手。AMD 一直在追,Intel 也沒放棄,Google 有 TPU,AWS 有 Trainium 和 Inferentia,Microsoft 也在推自家加速器。問題在於,企業買大規模 AI 系統時,看的不是單一零件,而是整體導入難度和穩定性。

這也是 GTC 2026 最值得注意的地方。NVIDIA 幾乎把所有產品都包進同一套敘事裡。你要蓋 AI 工廠,它有參考架構。你要跑推論,它有整包軟硬體。你要做 Agent,它有 runtime 和 policy。你要做機器人,它有模擬和物理引擎。這種整合能力,現在真的沒幾家能完整對打。

我覺得短期內,最大客戶還是會繼續買 NVIDIA。因為超大規模雲端業者和模型公司,最怕的不是硬體貴,而是系統不穩、相容性差、部署拖延。當一個叢集動輒幾萬顆 GPU,任何 5% 的效率損失都很痛。這時候,買整套通常比自己混搭來得省事。

- NVIDIA 優勢在 CUDA、生態系、整體方案。

- AMD 有硬體追趕壓力,但軟體黏著度還在補。

- Google TPU 與 AWS 自研晶片主要服務自家雲端。

- 企業客戶更在意 cost per token 與部署風險。

這不代表 NVIDIA 沒風險。第一個風險是價格。它現在幾乎掌握高階 AI 基礎設施的定價權,客戶嘴上不講,心裡一定很不爽。只要替代方案成熟到某個程度,大客戶一定會想分散供應商。第二個風險是產品線越來越大,內部整合和對外溝通也會變複雜,稍微失手就可能讓客戶覺得眼花撩亂。

還有一點很現實。NVIDIA 現在講的每一層都要吃資本支出。AI 工廠、推論叢集、機器人模擬、企業 Agent 平台,沒有一個便宜。假如總體景氣轉弱,或企業開始更嚴格看 AI 投資回報,採購節奏就可能放慢。所以 GTC 台上那些華麗展示,最後還是得回到一個老問題:客戶到底能不能賺到錢。

GTC 之後,開發者和企業該看什麼

如果你是開發者,我覺得接下來 12 個月最值得觀察的,不是機器人唱歌影片有多紅,而是企業 Agent 會不會真的大量上線。因為這件事最接近可落地的商業模式。從內部知識查詢、客服自動化,到程式開發助手,這些都能直接算 ROI。

如果你是企業 IT 或平台團隊,現在該問的問題很具體。你要不要把推論系統綁在單一供應商上。你能不能接受從晶片到 runtime 都用 NVIDIA。你有沒有能力自己整合替代方案。這些問題現在不先想,等預算要編時就會很被動。

我的預測很簡單。未來一年,NVIDIA 最快看到成果的,不會是消費級聊天產品,而是大型推論叢集、企業內部 Agent 部署,還有更多實體 AI 合作案。如果到了明年 GTC,NVIDIA 能拿出這三塊更清楚的營收或客戶案例,那這次大會就不是單純產品秀,而是一張非常完整的銷售地圖。

對台灣市場來說,這也代表一個很實際的機會。從伺服器、散熱、機殼、交換器,到工業電腦和系統整合,只要 AI 基礎設施繼續往上堆,供應鏈就還有戲。你不一定要做模型公司,才吃得到這波錢。很多時候,真正穩的生意,反而是那些把機房、網路和部署搞定的人。

最後一句話。GTC 2026 告訴大家的事其實很直白:AI 競爭已經從模型展示,慢慢轉向系統整合和長期營運。誰能把硬體、軟體、資料、網路和部署串好,誰就比較有機會把帳單開出去。這件事聽起來不浪漫,但很賺錢。