標籤

CUDA

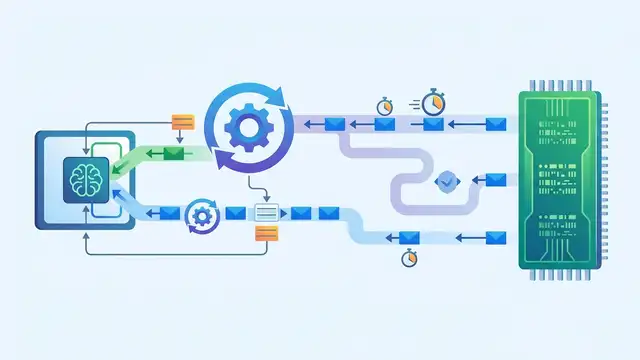

CUDA 是 NVIDIA GPU 的平行運算平台與程式模型,核心在 SM、warp、shared memory、HBM 延遲隱藏與資料搬移優化。它直接影響 AI 訓練、推論、科學模擬與高效能計算的效能上限。

8 篇文章

CUDA 架構怎麼跑:SM、核心、記憶體

CUDA GPU 把工作拆給 SM、數千個核心和分層記憶體。這篇用台灣開發者看得懂的方式,拆開它為何特別適合平行運算。

NVIDIA 論壇聊 SU(7) CUDA 晶格引擎

NVIDIA Developer Forums 一篇貼文把 7×7×7 晶格、shared memory、warp 與 bank conflict 放在一起談。重點不是 SU(7) 名字多炫,而是 CUDA 真的吃不吃這套。

Ampere 的 cp.async 怎麼藏 HBM 延遲

A100 上一次 HBM2e 載入約要 450 到 600 cycles。Ampere 的 cp.async 讓資料直進 shared memory,搭配 pipeline 把等待時間藏進計算裡。

DeepSeek 之後,NVIDIA 股價會回來嗎

DeepSeek 讓市場重新算 AI 成本,但 NVIDIA 仍握有 GPU、CUDA 與資料中心供應鏈。本文用數字、競品與產業脈絡,拆解股價能否回升。

2025 年 CUDA 為何還是強

CUDA 已經 18 年,卻仍是 NVIDIA GPU 的核心軟體堆疊。從 AI 訓練、氣象模擬到蛋白質計算,這套工具鏈為何還是開發者首選?

TurboQuant、冷啟動與 GPU Rust

TurboQuant 把 KV cache 壓到 4.6 倍,GPU state restore 盯上 32B 模型冷啟動,Rust 也更深入 CUDA 開發。

CUDA asinf() 更準,速度沒掉

NVIDIA Developer Forums 上有人替 CUDA 12.8 的 asinf() 做精度優化,指令數仍維持 26 條。這篇看它怎麼在 GPU 數學裡,硬拚準度與效能。

NVIDIA GTC 2026 重點拆解

NVIDIA 在 GTC 2026 一口氣端出 1,000 場 session、2,000 位講者,還把 AI 工廠、推論基礎設施、Agent 平台與實體 AI 全部綁成一套銷售方案。這場大會重點不是單一 GPU,而是從晶片到軟體的整包系統。