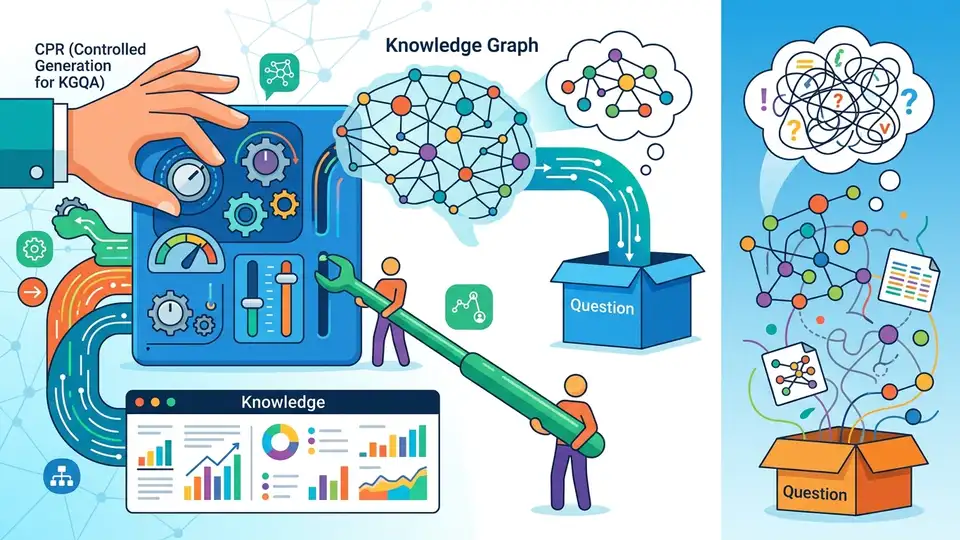

CPR 讓 KGQA 更可控

CPR 把 conformal calibration 放到 KGQA 的推理路徑層級,目標是讓答案集合更小、覆蓋率更穩定,提升可部署性。

CPR 把 conformal 校準放到 KGQA 的推理路徑層級,讓答案集合更小,也更有覆蓋保證。

知識圖譜問答(KGQA)看起來很直覺:把問題丟進去,沿著圖上的關係找答案就好。但真正難的,從來不是「有沒有答案」,而是「這個答案集合到底可不可信」。這篇 Conformal Path Reasoning for safer KGQA 直接碰這個痛點,想把可靠性從附加功能,變成方法本身的一部分。

這篇論文的重點,不是再做一個更會猜答案的 KGQA 模型,而是讓模型在回傳答案時,能同時保有 conformal prediction 想要的覆蓋保證,還不要把答案集合弄得太肥。白話一點,就是不只要答得對,還要知道自己有多有把握,而且不要動不動就丟出一大串候選結果。

這篇在解什麼問題

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

KGQA 的優勢,是答案可以綁在圖結構上,推理過程也比較能被檢查。這點比很多黑盒式 QA 模型更適合落地。但問題是,很多現有方法在「覆蓋保證」這件事上不夠穩。你可能拿到一個看起來有保證的答案集合,實際上卻太鬆、太大,或是校準得不夠可靠。

對開發者來說,這種狀況很尷尬。因為 conformal prediction 的賣點,本來就是提供一種有理論依據的方式,在「覆蓋率」和「集合大小」之間做取捨。可是一旦校準不準,保證就會失效;一旦分數不夠有區辨力,集合就會膨脹到難以使用。理論上有保證,實務上卻像在看一包候選名單。

作者在摘要裡點出兩個前人方法的問題:一個是 calibration validity,另一個是 score discriminability 不夠。CPR 就是針對這兩點設計的。

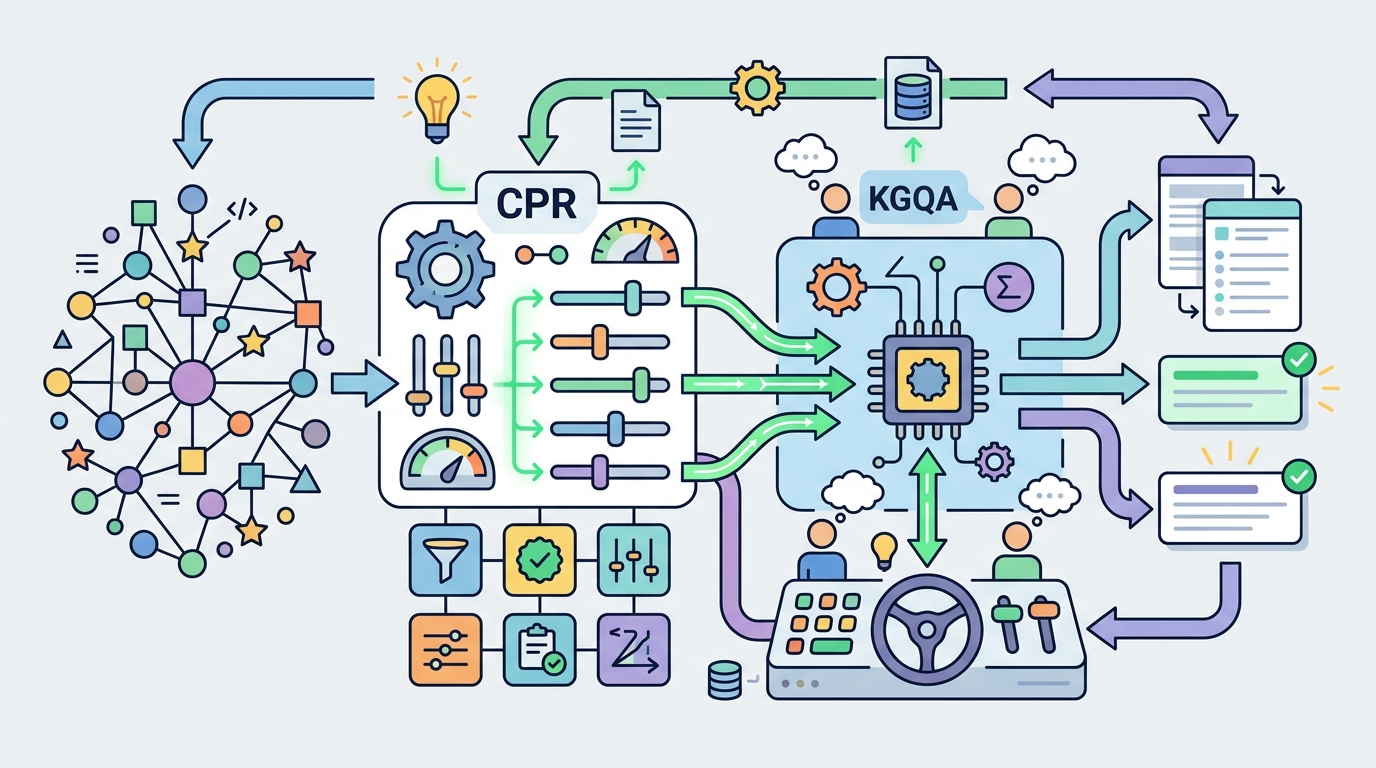

CPR 的方法怎麼運作

CPR 全名是 Conformal Path Reasoning。核心概念是把 conformal calibration 從「最後答案」往前推,改成在「路徑」層級處理。這個設計很關鍵,因為 KGQA 的答案通常不是憑空冒出來,而是經過一串圖上的關係路徑推到的。與其只看結果,不如直接看這條路徑夠不夠可信。

論文摘要描述的方法有兩個主要部件。第一個是 query-level 的 conformal calibration,但校準的對象是 path-level scores。意思是說,它不是只對最終答案打分,而是對產生答案的推理路徑做校準,並且維持 conformal prediction 需要的 exchangeability 假設。這樣做的目的,是讓統計保證還在,但校準單位更細。

第二個部件是 Residual Conformal Value Network,簡稱 RCVNet。這是一個輕量模組,用來學更好的 nonconformity score。這裡的重點很實際:在 conformal prediction 裡,分數怎麼設計,直接決定最後 prediction set 會不會太大。如果分數太粗,很多本來不該進來的候選也會被包進去;如果分數夠有區辨力,集合就能縮小。RCVNet 的任務,就是把這個分數做得更精細。

摘要還提到,RCVNet 是透過 PUCT-guided exploration 來訓練。原始摘要沒有展開完整實作細節,所以不能把它講得太滿;但從字面上看,這代表模型會用導引式探索來學哪些路徑比較有資訊量,再把這些路徑分數拿去做校準。整體邏輯很清楚:先把推理路徑找對,再把這些路徑的可信度校準好。

如果把 CPR 拆成幾個步驟,可以這樣理解:

- 先在圖上找出可能的推理路徑。

- 對路徑而不是單一答案做分數化。

- 用 RCVNet 學更有區辨力的 nonconformity score。

- 再用 conformal calibration 產生有覆蓋保證的答案集合。

- 目標是保留保證,同時把集合縮小到更實用的大小。

論文實際證明了什麼

摘要有提到實驗是在 benchmarks 上做的,但這份 raw 資料沒有列出資料集名稱,也沒有完整 benchmark 表格。所以這篇摘要沒有公開完整 benchmark 細節,無法逐一比較每個資料集的表現。

不過,摘要有給出兩個很直接的數字。相較於 conformal baselines,CPR 的 Empirical Coverage Rate 提升了 34%,同時平均 prediction set size 減少了 40%。這兩個數字很重要,因為它們剛好對應 conformal 系統最在意的兩件事:一個是有沒有把應該涵蓋的答案包進來,另一個是答案集合會不會太大。

換句話說,CPR 不是只把覆蓋率拉高,然後用更大的集合硬撐。它是同時把覆蓋率和集合大小往更好的方向推。這點很關鍵,因為很多方法只能二選一:要嘛保守到集合太大,要嘛集合小了但保證不穩。摘要裡的結果顯示,CPR ცდილ試圖把這個兩難拆掉。

作者的結論也很明確:CPR 能在維持 coverage guarantees 的前提下,產生更緊湊的 answer sets。摘要沒有宣稱它在所有 KGQA 指標上都是最強,也沒有提供 latency、記憶體成本、失敗案例或不同難度 query 的細節。所以就目前公開資訊來看,這篇的主軸是「校準與可信度」,不是全面性的 KGQA SOTA 報告。

對開發者有什麼影響

如果你在做圖資料問答、企業知識庫檢索,或任何需要 grounded answers 的系統,這篇最值得注意的點不是模型名字,而是設計思路。它把「推理路徑」當成第一級公民來處理,意思是 intermediate evidence 不是附帶資訊,而是可以被打分、校準、過濾的核心訊號。

這對實作很有啟發性。很多系統在意的是最後答案準不準,但在實際部署裡,答案集合太大也會造成成本。使用者要看一長串候選,產品體驗會變差;下游系統要再做 rerank 或人工確認,也會增加負擔。CPR 的方向,等於是在說:如果你能更精準地校準推理路徑,就有機會把答案集合縮小到更可用的範圍。

這種思路特別適合那些不能只靠「大概對」來過關的場景。像是內部搜尋、合規查詢、知識助理,或任何圖資料驅動的決策流程。因為在這些情境裡,回傳太多候選,常常跟答錯一樣麻煩。

但也要講清楚,CPR 不是萬靈丹。它改善的是 conformal side 的問題,也就是覆蓋與集合大小的平衡。它沒有消除 KGQA 本身的資料限制,例如圖譜是否完整、關係是否稀疏、query decomposition 是否正確。這些上游問題一樣會影響最終效果。

限制與還沒回答完的問題

這份摘要留下不少重要空白。首先,我們不知道它用了哪些 benchmarks。其次,也不知道在不同圖規模、不同 query 類型下,提升是否一致。再來,摘要沒有提供推理成本,所以無法判斷 path-level calibration 會不會讓 inference 變重。

另一個重點是 conformal 保證本來就有前提。論文強調要維持 exchangeability,這是合理的,但真實世界資料常常會 drift。raw 資料沒有說 CPR 在資料分佈改變時有多穩,也沒有說保證在什麼條件下會變弱。對開發者來說,這代表你不能把保證當成魔法,而要把它當成一個有條件成立的框架。

最後,RCVNet 雖然看起來是個輕量模組,但摘要沒有說它在訓練或部署上的額外成本。若你要把它放進 production pipeline,還是得看它對延遲、吞吐量、以及整體系統複雜度的影響。

總結來看,這篇論文的價值在於,它不是只把 KGQA 做得更像一般 QA,而是試著把「可信回答」這件事變成可操作的方法。對想把知識圖譜系統做得更可控的團隊來說,path-level conformal calibration 是一條值得追的路。