政策不變性檢驗 LLM 安全判官

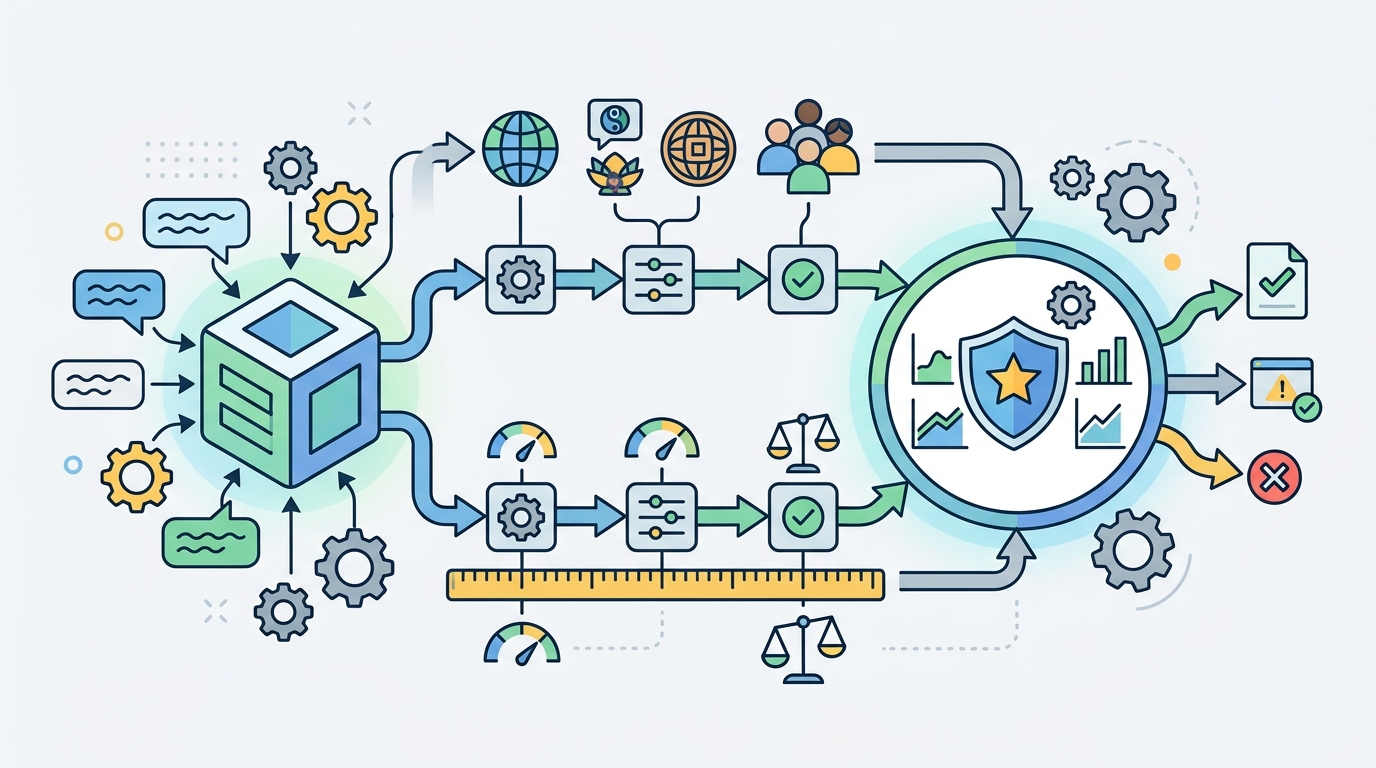

這篇論文主張,LLM 安全判官不能只看準確率,還要測政策不變性,才能檢查它是否真的懂規則、而不是被措辭帶著走。

這篇論文主張,LLM 安全判官不能只看準確率,還要測政策不變性,才能檢查它是否真的懂規則、而不是被措辭帶著走。

很多團隊在做 LLM 安全審查時,最在意的是模型能不能判對。但這篇 arXiv 論文 Beyond Accuracy: Policy Invariance as a Reliability Test for LLM Safety Judges 認為,光看 accuracy 不夠。因為一個判官就算在靜態測試集上表現不錯,也可能在政策文字改寫、格式變動,或提示詞調整後,開始出現不穩定的判斷。

作者提出的重點很直接:如果一個安全判官真的在評估「政策本身」,那麼當政策被改寫成語意等價、但表面形式不同的版本時,它的輸出應該維持一致。這不是在否定準確率,而是補上一個更貼近實務的可靠性檢查。對做 moderation、紅隊測試、或自動化評估管線的工程師來說,這種一致性很重要,因為判官一旦脆弱,後面的系統也會跟著脆弱。

這篇論文想解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這篇論文在處理一個很常見、也很容易被忽略的問題:LLM 評估分數看起來漂亮,不代表系統真的可靠。尤其是安全判官這類模型,它們的工作不是只在單一資料集上做對一次,而是要在不同政策描述、不同提示詞、不同格式下,都能維持穩定的判斷。

問題在於,很多評估方式會把「測對答案」當成唯一指標。可是在真實環境裡,政策文件會被重寫,條文會更新,產品需求也可能改變。如果判官只對某一種措辭敏感,卻無法在等價改寫後維持一致,那它就不是一個好用的控制元件,而是一個需要不停修補的風險來源。

作者的論點是,可靠性應該直接被測出來,而不是從 accuracy 推論出來。這個角度很像把問題從「模型有沒有答對」往前推一步,改成「模型是不是因為正確的理由在答題」。對安全場景來說,這個差別非常大。

Policy invariance 到底在測什麼

Policy invariance 的概念,用白話講就是:如果政策的語意沒有變,判官的判斷也不應該變。它不是要取代 accuracy,而是多加一層檢查,看看模型是不是只抓到表面線索,還是真的理解政策邏輯。

這個測試的核心精神,是把「語意等價的政策表述」當成同一件事。若兩個版本只是文字不同、意思相同,可靠的安全判官應該給出相同結論。反過來說,如果輸出跟著措辭、排版或提示風格一起飄,那就表示它可能對無關訊號太敏感。

從工程角度看,這很像在測一個控制系統能不能抵抗不必要的輸入擾動。安全判官常被放在流程前端,像是內容審核、風險分類、紅隊自動評分,甚至是內部評估基準。如果它對政策改寫很脆弱,後面的決策就很難信任。

但也要先講清楚:根據目前可見的摘要資訊,這篇沒有公開完整實驗流程。也就是說,我們無法從 raw 資料得知政策變體怎麼生成、用了哪些判官架構、或是怎麼定義「等價改寫」。論文明確提出的是一個可靠性標準,而不是摘要裡已經完整展開的實驗手冊。

論文實際證明了什麼

這部分要老實說:目前可見的摘要沒有提供完整 benchmark 數字,也沒有表格、勝率、或具體的性能提升幅度。所以不能硬講它在某個資料集上提升了多少,也不能替它補不存在的結果。

不過,這不代表這篇沒有貢獻。它真正做的事,是把評估問題重新定義。以前大家常問的是「這個判官準不準?」現在作者要你多問一句:「這個判官在政策改寫後還穩不穩?」

這種轉向很重要,因為很多模型在固定測試集上看起來沒問題,一換 prompt 或改一點政策語氣就開始飄。對安全系統來說,這種飄移不是小瑕疵,而是會直接影響治理流程的可靠性問題。政策不變性就是要把這種脆弱性提早抓出來。

換句話說,這篇論文不是在說 accuracy 不重要,而是在說 accuracy 只是一個起點。若一個 judge 只能在單一寫法下表現正常,那它的分數可能只是「條件式正確」,不是「真正穩定」。

對開發者有什麼影響

如果你在做內容審核、政策分類、風險標註,或任何需要 LLM 當安全判官的系統,這篇文章的訊息很實際:不要只把 accuracy 當作唯一門檻。你還需要檢查模型在政策文字變動下,是否仍然保持一致。

這對實務維運特別有感。真實世界的安全政策不是靜態文件。產品會改,法規會變,團隊也會重新定義哪些內容算違規。若判官對這些「不該影響語意」的改寫很敏感,工程團隊就會被迫反覆調 prompt、重寫規則、手動抽查,維護成本會一路上升。

政策不變性的價值,在於它提供一個更接近生產環境的診斷方式。你不只是在看模型有沒有答對,而是在看它是不是對「政策本身」有穩定理解。這對把 LLM 放進治理鏈路的團隊,會比單一分數更有參考性。

- 把 accuracy 當基礎指標,不要當唯一指標。

- 測試判官在語意等價政策改寫下是否保持一致。

- 注意 prompt、格式、措辭改變後是否出現脆弱行為。

- 把不一致視為可靠性問題,而不只是 benchmark miss。

限制與未解問題

這篇目前最大的限制,是摘要沒有公開完整方法與結果。從可見資料裡,我們不知道用了哪些資料集,也不知道政策等價是怎麼定義的,更不知道是否比較了多種 judge model。這些資訊如果缺席,就很難直接重現,也不容易跟其他評估方法做嚴格比較。

另一個還沒回答的問題,是政策不變性要怎麼落地到團隊流程。它應該是 pass/fail gate,還是排名指標?應該在 prompt 迭代時當診斷工具,還是上線前的品質檢查?從摘要看得出來作者把它定位成可靠性測試,但具體怎麼接到產品流程,還沒有完整公開。

即便如此,這篇論文的方向還是很清楚:安全判官的品質,不能只看它有沒有答對一次。它還要在政策重寫、格式調整、提示詞變化時,維持應有的一致性。對開發者來說,這就是一個很實際的提醒:別被單一分數騙了。

如果一個 judge 會因為不相關的文字差異就翻盤,那它在 production 裡的表現,可能比 benchmark 看起來更脆弱。這篇論文要你提早看到這件事,避免等到系統真的出問題,才發現控制層本身就不穩。

總結來說,這不是一篇在比誰分數高的論文,而是在改變我們檢查安全判官的方式。對做 LLM 安全、評估與治理的人來說,這種觀點很值得納入工具箱。