SAGA 讓 AI Agent 排程看懂工作流

SAGA 主張 GPU 排程不該把 AI agent 的每次 LLM 呼叫拆開看,而是要把一連串請求當成同一個工作流來排。

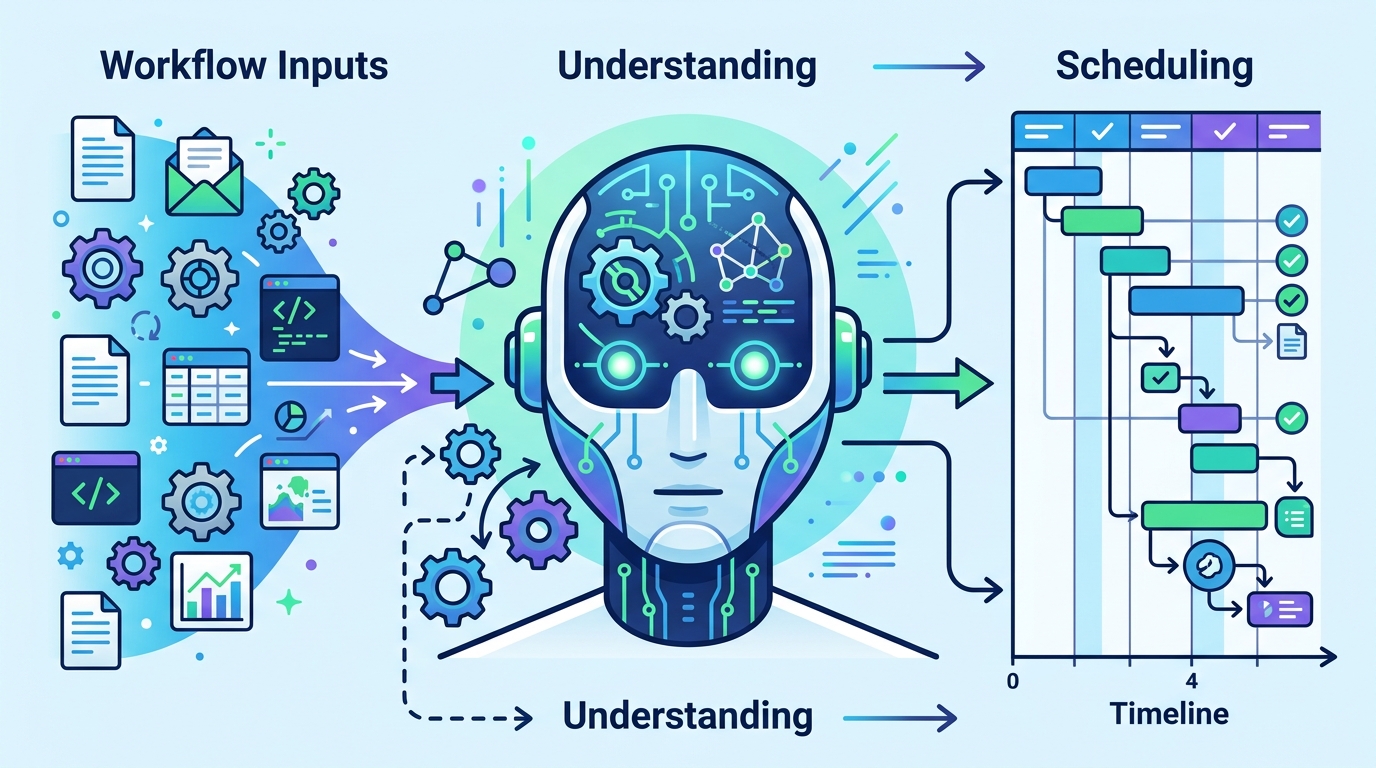

SAGA 把 AI agent 的一連串 LLM 呼叫,當成同一個可排程工作流來處理。

AI agent 的推理流程,通常不是一次模型呼叫就結束。它更像一串接一串的任務,可能在單一工作裡跑上十幾次、甚至上百次 LLM 呼叫。SAGA: Workflow-Atomic Scheduling for AI Agent Inference on GPU Clusters 這篇論文就是從這個現實出發,主張 GPU 排程器不該把每次呼叫都當成獨立請求,而是要把整個 agent 工作流一起看。

這個切法看起來只是排程細節,實際上影響很大。因為如果系統只看到單一請求,就很難理解這個 agent 背後其實有依賴關係、先後順序,還有整體任務節奏。對開發者來說,這代表你可能把資源優化在錯的單位上:看起來每次都在服務請求,但真正需要被管理的,其實是整段推理流程。

這篇論文要解的痛點是什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

論文一開始就點出核心問題:AI agent 不是單次 inference job,而是由很多 LLM 呼叫串起來的工作流。這些呼叫常常以十幾次到上百次為一個任務單位,但多數 GPU cluster 排程系統,仍然習慣把每次呼叫拆開處理。

這種設計在傳統模型服務場景下也許夠用,但放到 agent workload 就開始卡住。因為排程器如果看不到整體工作流,就無法從任務層級去理解這個 agent 真正在做什麼。SAGA 想修的,就是這個抽象層級不對齊的問題。

原始摘要沒有列出具體失敗案例,也沒有公開完整 benchmark 細節,所以我們不能替它補上數字或效果。但從論文的問題設定可以很清楚看出來:它在處理的不是「單次模型推理要不要更快」,而是「當推理變成工作流時,排程單位要不要跟著改」。

SAGA 的方法到底在做什麼

SAGA 的名字已經把方向講得很明白:workflow-atomic scheduling。白話一點,就是把整個 agent 工作流視為排程的最小單位,而不是把裡面每一次 LLM 呼叫拆成彼此無關的碎片。

這裡的 atomic,重點在「整體性」。它暗示排程器在做 GPU cluster 的配置與執行決策時,應該保住整段工作流的結構,而不是只看單一 request 的到達順序或短期負載。摘要沒有提供完整演算法,所以不能亂講它怎麼做資源分配、怎麼做佇列管理,或有沒有特定的優先權策略。但概念上可以確定的是:SAGA 想把排程從 call-level,拉回 workflow-level。

這個轉向對 agent 特別重要。因為 agent 的任務本來就有內部依賴,前一步輸出常常會影響下一步輸入。若排程器只認單一呼叫,它看到的就只是流量;若它能看懂工作流,它看到的才是任務本身。這也是為什麼論文把問題定義成「workflow-atomic」,而不是一般的 request batching 或單純的 queue optimization。

用開發者角度來看,這其實是在問一個很實際的問題:你的基礎設施到底是在服務模型呼叫,還是在服務 agent 任務?SAGA 明顯站在後者。

論文實際證明了什麼

這裡要先講清楚限制。就目前提供的摘要文字來看,沒有公開完整 benchmark 細節,也沒有列出 latency、throughput、GPU 利用率或任何量化結果。所以不能說這篇論文已經證明了某個明確的性能提升。

但這不代表它沒有貢獻。它的主要證明,是把問題定義得更準:AI agent inference 應該被視為一個工作流問題,而不是一堆孤立的請求。這個觀點本身就很重要,因為很多系統設計的失誤,都是從錯的抽象層級開始的。

換句話說,SAGA 的價值比較像是提出一個更合理的排程模型,而不是在摘要階段就端出完整性能勝利。對研究讀者來說,這是架構層的訊號;對工程團隊來說,這是提醒你現有排程策略可能沒有對準 agent workload 的真實形狀。

如果你在找「這個方法到底快多少」這類答案,這份摘要沒有給。若你在意的是「GPU cluster 應該用什麼單位來理解 agent 推理」,那這篇就已經把方向講得很明確。

對開發者有什麼影響

對做 agent 系統的人來說,這篇論文最直接的啟發是:應用層跟基礎設施層,現在看的單位不一樣。應用層看的是任務、工具調用、推理鏈;基礎設施層常看的是 request、batch 和資源佔用。SAGA 認為這兩者之間有落差,而且這個落差會隨著 agent 變複雜而放大。

這件事不是理論上的小差異。當一個任務要跑很多次 chained LLM calls,排程器如果還是用傳統單次推理的思路來處理,就可能無法正確反映整體延遲、依賴關係和資源競爭。對平台團隊來說,這意味著你可能需要重新思考:GPU scheduler 到底要不要知道 workflow context。

如果你在做多租戶 AI 服務,這種問題會更明顯。因為不同 agent 工作流會同時競爭同一批 GPU 資源,單看每次呼叫的到達與完成,未必能做出符合實際任務需求的決策。SAGA 的訊息很直接:當 AI agent 開始變成主要工作負載時,排程器也要跟著換思維。

目前還有哪些限制與開放問題

這篇摘要最大的限制,就是資訊量不夠完整。它沒有公開方法細節、沒有評估設定,也沒有結果數字,因此我們無法判斷 workflow-atomic scheduling 的實作成本、效能收益,或適用範圍。

摘要也沒有回答一些實務上很關鍵的問題。像是工作流要怎麼被辨識、怎麼被追蹤、怎麼在多個 LLM 呼叫之間維持一致性,這些都還看不到。排程器如果要知道一個 agent 的整段流程,通常就會牽涉到更多協調與狀態管理,但摘要沒有說明這部分的開銷。

另外,這個方法到底主要優化什麼,也還不清楚。是吞吐量、延遲、公平性,還是資源使用率?目前來源沒有提供。這代表它比較像一個很有方向感的系統設計提案,而不是已經被摘要證實可以直接上線的方案。

- 摘要沒有提供 benchmark 數字,所以不能推論性能提升幅度。

- 摘要沒有說明完整排程演算法,所以無法確認實作複雜度。

- 摘要沒有交代工作流辨識方式,所以部署細節仍是未知數。

- 摘要沒有列出測試場景,所以適用 workload 還要看全文。

即便如此,SAGA 還是值得關注。因為它抓到一個很可能會越來越重要的趨勢:當 AI agent 變成常態,GPU 排程就不能只看單次模型呼叫。未來真正該優化的單位,也許不是 request,而是整個工作流。

對台灣的開發者和平台工程師來說,這篇論文的重點不是某個立刻可用的工具,而是一次很明確的架構提醒。Agent 系統越成熟,底層排程越不能再用舊世界的方式理解新世界的工作負載。