AutoTTS讓LLM自己找推理策略

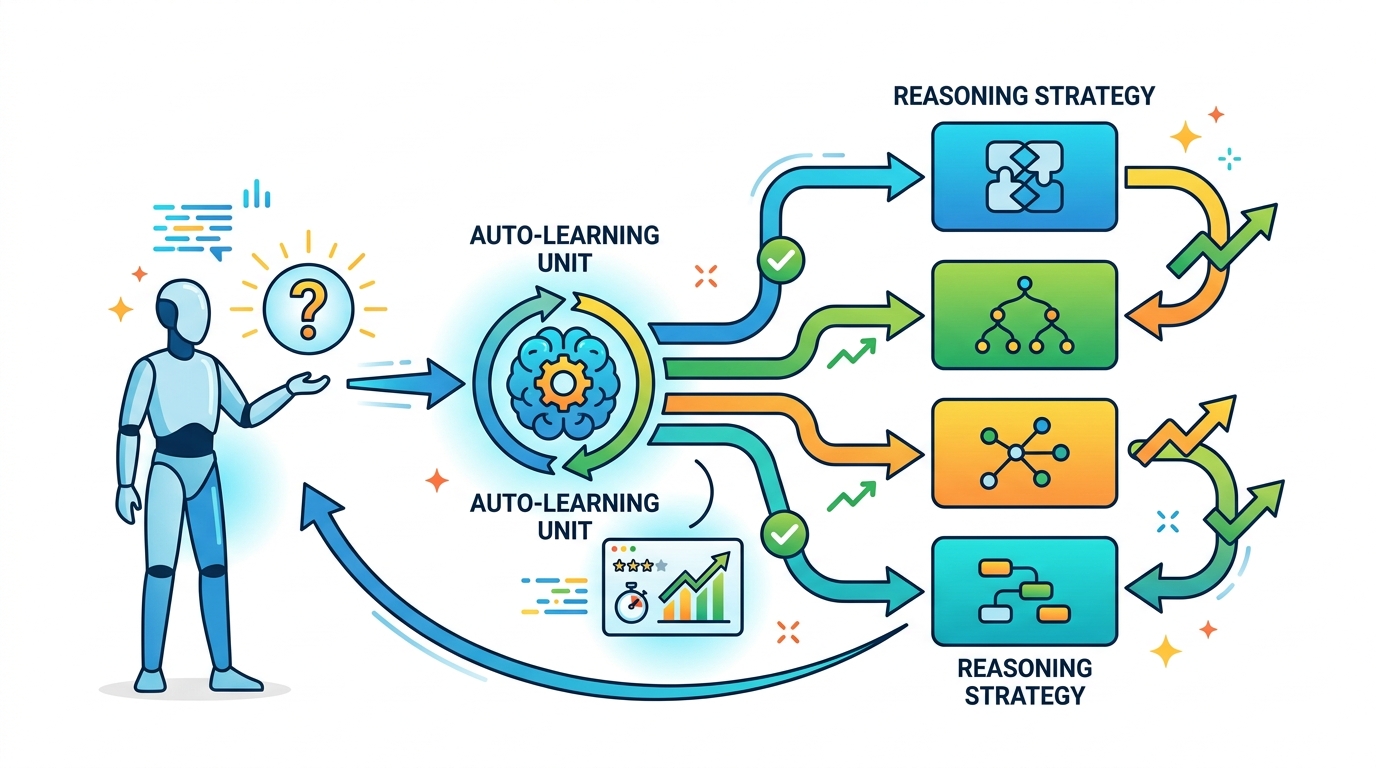

AutoTTS把 test-time scaling 變成環境搜尋問題,讓 LLM 在推理時自動找出更省算力的策略,而不是靠人手調 heuristics。

AutoTTS把 test-time scaling 變成環境搜尋問題,讓 LLM 自動找出更省算力的推理策略。

推理階段多花一點算力,語言模型常常就能答得更好。這件事在實務上很有吸引力,因為它不一定要重訓模型,只要把 inference 時的計算分配好,效果就可能往上拉。

問題也很明顯:現在很多 test-time scaling 做法,還是靠研究者手動設計。怎麼分支、怎麼延續、什麼時候探測、什麼時候剪枝、什麼時候停下來,往往都靠經驗和直覺。這篇論文想處理的,就是這個「人手調策略」的瓶頸。

論文標題是 LLMs Improving LLMs: Agentic Discovery for Test-Time Scaling。它提出 AutoTTS,把 test-time scaling 改寫成一個可以在環境裡自動搜尋的問題,而不是每一招都要研究者自己想。

這篇在補哪個洞

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

作者的起點不是懷疑 test-time scaling 沒用。相反地,論文直接把它當成一個已經有價值的方法:在推理時投入更多計算,通常能換到更好的表現。

真正的痛點在於,這些額外算力到底怎麼用,還沒有被系統化處理。論文把現況描述成大量手工設計的策略,研究者會根據直覺去定義推理模式和各種 heuristic,但這也代表很多可能的計算分配方式根本還沒被探索到。

對開發者來說,這件事很現實。推理算力貴,而且通常是線上成本。若能找到一個不用人工反覆調參、卻能維持更好 accuracy-cost tradeoff 的方法,部署時的可擴展性會高很多。

所以這篇不是在談「要不要多花算力」,而是在談「多花的算力要怎麼被更聰明地分配」。這也是 AutoTTS 的核心切入點。

AutoTTS 到底怎麼運作

AutoTTS 的重點,是把設計單位從單一 heuristic 改成一個可搜尋的環境。作者說,這個環境至少要做到兩件事:控制空間要夠可管理,回饋要夠便宜,而且要夠頻繁,搜尋才有機會跑得動。

論文裡實作的主軸是 width-depth test-time scaling。白話一點說,系統會先用預先收集好的 reasoning trajectories 和 probe signals,然後在這些資料上合成 controller。這個 controller 決定下一步要做什麼:分支、繼續、探測、剪枝,或是直接停止。

這裡最關鍵的地方,是 controller 的評估不需要每次都重新呼叫 LLM。也就是說,搜尋過程可以用比較便宜的方式反覆試,避免 discovery 階段就把推理成本燒爆。對做自動化搜尋的人來說,這一點很重要,因為它直接決定方法能不能落地。

作者還加了兩個設計來讓搜尋更好做。第一個是 beta parameterization,用來讓搜尋空間維持在可處理、而且夠細的範圍。第二個是 fine-grained execution trace feedback,讓 agent 能看見 test-time scaling program 為什麼失敗,進而提升 discovery 效率。

換句話說,AutoTTS 不是單純「讓模型自己想」。它更像是先搭一個可操作的環境,再讓系統在這個環境裡找出更好的推理控制策略。

論文實際證明了什麼

根據摘要,作者是在數學推理 benchmark 上做實驗。結果顯示,AutoTTS 找到的策略,在整體 accuracy-cost tradeoff 上,優於強而有力的手工 baseline。

這句話很重要,因為它不是在說純準確率一定更高,而是在說「同樣要考慮成本時,整體表現更好」。對實際系統來說,這通常比單看 accuracy 更有意義。因為很多時候,你不是不能再多花一點算力,而是不能無上限地花。

摘要也提到,這些自動找到的策略可以 generalize 到 held-out benchmarks 和不同 model scales。這代表它們不只是對單一測試集或單一模型尺寸過擬合,至少在論文描述裡,具備一定的可遷移性。

另一個很吸睛的結果,是搜尋成本本身不高。論文聲稱整個 search 只花了 39.9 美元和 160 分鐘。對研究方法來說,這是一個很實用的數字,因為它把 AutoTTS 描述成一個可反覆跑的自動調整流程,而不是一次性的大型離線工程。

不過,摘要沒有公開完整 benchmark 細節。它沒有給出精確的 accuracy 數字、每個資料集的分項結果,也沒有列出具體節省了多少成本。所以目前能確定的是方向與高層結論,不能從這份 raw 資料直接推到更細的量化比較。

對開發者有什麼影響

如果你在做推理型系統,這篇論文傳遞的訊號很直接:test-time scaling 可以被當成一個環境搜尋問題,而不是一組需要人工堆疊的技巧。這會讓 inference optimization 更系統化,也比較不依賴「誰比較會調 prompt」這種經驗差距。

對工程實作來說,這種思路也提醒一件事:搜尋能不能成功,往往不只看演算法,還看環境設計。你得先把控制空間做得夠小、回饋做得夠便宜,agent 才有可能在裡面找到有用的 policy。這跟很多自動化優化問題其實是同一個道理。

如果把它放到產品或系統角度看,AutoTTS 的價值不是「再發明一個更聰明的推理招式」,而是提供一條比較可擴展的路:讓模型自己在受控環境裡找出更好的推理控制方式。這對要長期維持成本與效果平衡的團隊,會比單次手工調整更有吸引力。

- 它把 test-time scaling 從手工 heuristic,改成可搜尋的環境問題。

- 它用預先收集的 reasoning trajectories 和 probe signals,避免搜尋時反覆呼叫 LLM。

- 它強調的是 accuracy-cost tradeoff,不是只追求更高準確率。

- 它在摘要中宣稱可泛化到 held-out benchmarks 和不同 model scales。

限制與還沒回答的問題

這篇摘要最明顯的限制,是它聚焦在數學推理 benchmark。這代表目前還不能直接知道,這套方法能不能同樣適用在 coding、工具使用,或更開放式的 assistant 任務。

另一個還沒拆開的問題,是成果到底有多少來自 width-depth 這個特定 formulation,又有多少來自「環境驅動 discovery」這個更大的想法。摘要沒有提供足夠細節去分辨這兩者的貢獻。

還有一個實作門檻不能忽略:方法依賴 pre-collected reasoning trajectories 和 probe signals。這表示要用 AutoTTS,不是只把模型丟進去就好,前面還要有資料管線和追蹤訊號的準備。對研究團隊或 instrumentation 做得比較完整的系統,這可能可行;但對資源較少的團隊,仍然是成本。

總結來看,這篇論文的重點很清楚:如果想把推理階段的表現再往上推,可能不能只靠人類一個個設計策略,而是要建立一個能讓策略被發現的環境。對關心模型效率、自動化推理政策、或 agentic optimization loop 的開發者來說,這是一個值得注意的方向。