SceneCritic 用符號規則評 3D 場景

SceneCritic 不看渲染圖打分,而是直接檢查 3D 室內布局的符號約束;摘要未公開完整 benchmark 數字,但作者稱它比 VLM 評審更貼近人類判斷。

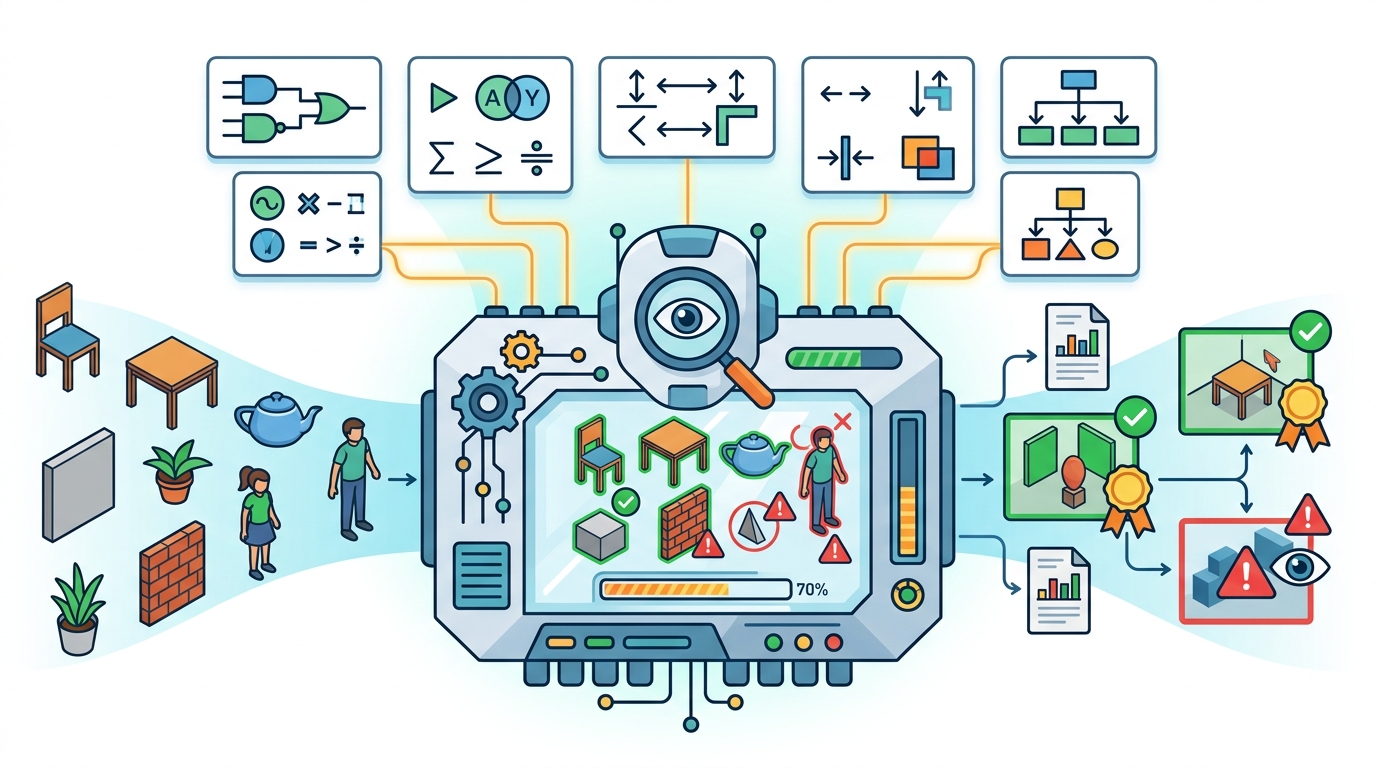

3D 室內場景生成,看起來像樣,不代表真的合理。物件可能彼此碰撞,朝向不對,或關係語意怪怪的。這篇論文 SceneCritic: A Symbolic Evaluator for 3D Indoor Scene Synthesis,想解的就是這個老問題:評分方式本身太不穩,導致你很難知道模型到底是場景做壞了,還是評審看錯了。

作者的做法很直接。不要只看渲染圖。改成直接檢查布局本身,看看它有沒有符合符號化的空間規則。這個思路對做 3D 場景生成的人很重要,因為如果評分器會因為視角、提示字句,甚至幻覺而飄來飄去,那你拿到的分數就很難拿來 debug。

SceneCritic 的核心不是「看起來像不像」,而是「結構對不對」。它把室內場景評估拉回 floor-plan level,也就是更接近結構化布局的層次,直接檢查物件之間的空間關係,而不是只對一張圖做主觀判斷。

這篇論文在修什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

現在很多 3D 室內場景系統,都是先產生 layout 或 scene graph,再往下做渲染或細化。問題是,最後的評估常常還是靠 LLM 或 VLM 去看渲染圖打分。這種流程很脆弱,因為渲染圖只是某個視角下的結果,不代表整個場景的真實結構。

對開發者來說,這會變成很麻煩的除錯地獄。你看到模型分數低,卻不知道是 layout 真有問題,還是評審被畫面角度誤導了。更糟的是,同一個場景,換個 prompt、換個視角,評分可能就變了。這讓迭代很難穩定,也很難比較不同方法到底誰比較好。

SceneCritic 的定位,就是把這個不確定性降下來。它不先問「這張圖像不像」,而是先問「這個場景在符號規則上合不合理」。

SceneCritic 到底怎麼運作

論文把 SceneCritic 描述成一個 symbolic evaluator,專門用來評估 floor-plan-level 的布局。它背後有一個結構化的空間本體 SceneOnto。這個本體不是憑空生出來的,而是作者把 indoor scene 的先驗知識,從 3D-FRONT、ScanNet 和 Visual Genome 這些資料來源中整理、聚合出來。

白話一點說,就是先把「室內場景常見的空間常識」整理成一套可推理的知識結構,再拿這套結構去檢查生成結果。這樣做的好處是,評估不只看物件有沒有出現,還會看它們放得對不對、方向對不對、關係對不對。

作者強調三種一致性:semantic coherence、orientation coherence、geometric coherence。也就是語意要通、朝向要通、幾何位置也要通。這三件事合在一起,才算是一個合理的室內布局。比起只看單一像素畫面,這種方式更像是在做結構審核。

SceneCritic 也不是只吐一個總分了事。它會產生 object-level 和 relationship-level 的評估。這代表它能指出是哪個物件出問題、哪一組關係不成立,哪些地方是對的。對工程師來說,這種輸出比單一分數更有用,因為你可以直接定位錯誤來源,而不是在黑盒子裡猜。

除了評估本身,論文還把 SceneCritic 放進一個 iterative refinement 的測試環境。這個設計是拿來觀察不同 critic 模態,會怎麼影響模型修正空間結構的過程。作者比較了三種 feedback:規則式 critic,用碰撞約束來抓問題;LLM critic,直接用文字形式看布局;以及 VLM critic,看渲染後的觀察結果。

也就是說,這篇不是只提出一個新評分器而已。它還順手拿這個評分器,去研究「不同批評方式,會怎麼改變場景細化的結果」。這讓它不只是 evaluation 工具,也是一個研究 critique loop 的實驗框架。

論文實際證明了什麼

先講限制:這份摘要沒有公開完整 benchmark 數字,所以看不到明確的 accuracy、score 或各資料集上的量化表現。也就是說,現在不能從摘要直接引用完整數字,只能根據作者在 abstract 裡給出的結論來理解結果。

但即使沒有數字,摘要還是給了幾個很明確的方向。第一,SceneCritic 跟人類判斷的對齊程度,明顯比 VLM-based evaluators 更好。這對工程實作很關鍵,因為它代表 symbolic evaluator 可能更適合拿來做 debug 與迭代,而不是單純拿渲染圖讓模型猜。

第二,作者還提到 text-only 的 LLM,在 semantic layout quality 上可以贏過 VLM。這點很值得注意。一般直覺會覺得有視覺資訊一定比較強,但在這個任務裡,layout 的文字表示反而可能是更穩的訊號。換句話說,對某些空間語意判斷,圖不一定比結構化文字更可靠。

第三,在 iterative refinement 的實驗裡,image-based 的 VLM feedback 在語意與 orientation correction 上最有效。這代表結果不是單向度地「符號一定最好、視覺一定最差」。比較合理的解讀是:不同 critic 有不同強項。符號評估更適合判斷場景是否合理,VLM 反而可能在某些修正任務上更有幫助。

這個結論其實很實用。它沒有把某一種模態神化,而是把評估和修正拆開看。當你的目標是理解場景是否符合空間常識,符號方法看起來更穩;當你的目標是推動模型往更好的方向修正,視覺回饋還是有它的價值。

對開發者有什麼影響

如果你在做 3D 場景生成,評估不是附屬品,而是產品本身的一部分。評分器不穩,模型就很難穩。SceneCritic 提供的是一種比較可控的評估層,尤其適合 floor-plan-level 的生成與細化流程。

它最大的工程價值,在於除錯。你可以直接看到物件是否碰撞、關係是否成立、朝向是否合理。這比起看一張渲染圖後再猜問題在哪裡,效率高很多。尤其當你要比較不同 refinement 方法,或判斷模型到底有沒有學到空間結構時,這種結構化回饋會更好用。

這篇論文也暗示了一個很實際的工作流:核心空間正確性,用 symbolic checks 先把關;需要修正時,再搭配視覺或語言 critic 補強。這種模組化的評估方式,比起把所有責任都丟給單一 multimodal judge,通常更容易解釋,也更容易維護。

- 先用符號規則檢查碰撞、朝向、關係

- 再用 VLM 或 LLM 做細化回饋

- 把「評估」和「修正」分開看

- 比較不同 critic 時,輸出也更容易追蹤

限制與還沒回答的問題

這篇摘要的資訊量夠提出方向,但還不夠讓人完整評估方法上限。最明顯的限制,就是沒有公開完整 benchmark 細節。摘要沒有提供具體數字,所以我們目前無法知道 SceneCritic 跟 VLM 評審之間的差距到底有多大,也無法知道 iterative refinement 的提升幅度有多少。

第二個限制是,這篇主要談的是 floor-plan-level layouts,而不是端到端的完整 3D 場景生成。也就是說,它聚焦在結構化表示的評估與修正,不是要直接取代整條生成管線。對想做完整產品的人來說,這是 pipeline 裡的一段,不是全部。

第三個問題是泛化範圍。SceneOnto 是從 3D-FRONT、ScanNet、Visual Genome 的先驗整理出來的,所以它能覆蓋多少場景,基本上還是取決於這些資料裡有哪些空間模式。摘要沒有說它在罕見室內配置、特殊物件擺法,或其他領域的表現如何。

不過,即使有這些限制,這篇論文還是把一件事講得很清楚:當任務本質上是空間推理時,直接看結構,往往比看渲染圖更可靠。對做 3D 室內場景合成的人來說,這是一個很值得參考的評估方向。

如果你正在做 scene synthesis、layout refinement,或任何需要穩定評分的多模態系統,SceneCritic 提供的不是華麗的新模型,而是更像工程底層的改良:把評審方式變得可解釋、可追蹤,也更接近人類對「場景合理性」的判斷。

總結一句話,這篇論文的重點不是讓模型看得更多,而是讓評估看得更準。這對 3D 室內場景生成來說,可能比再多一點視覺幻覺更重要。