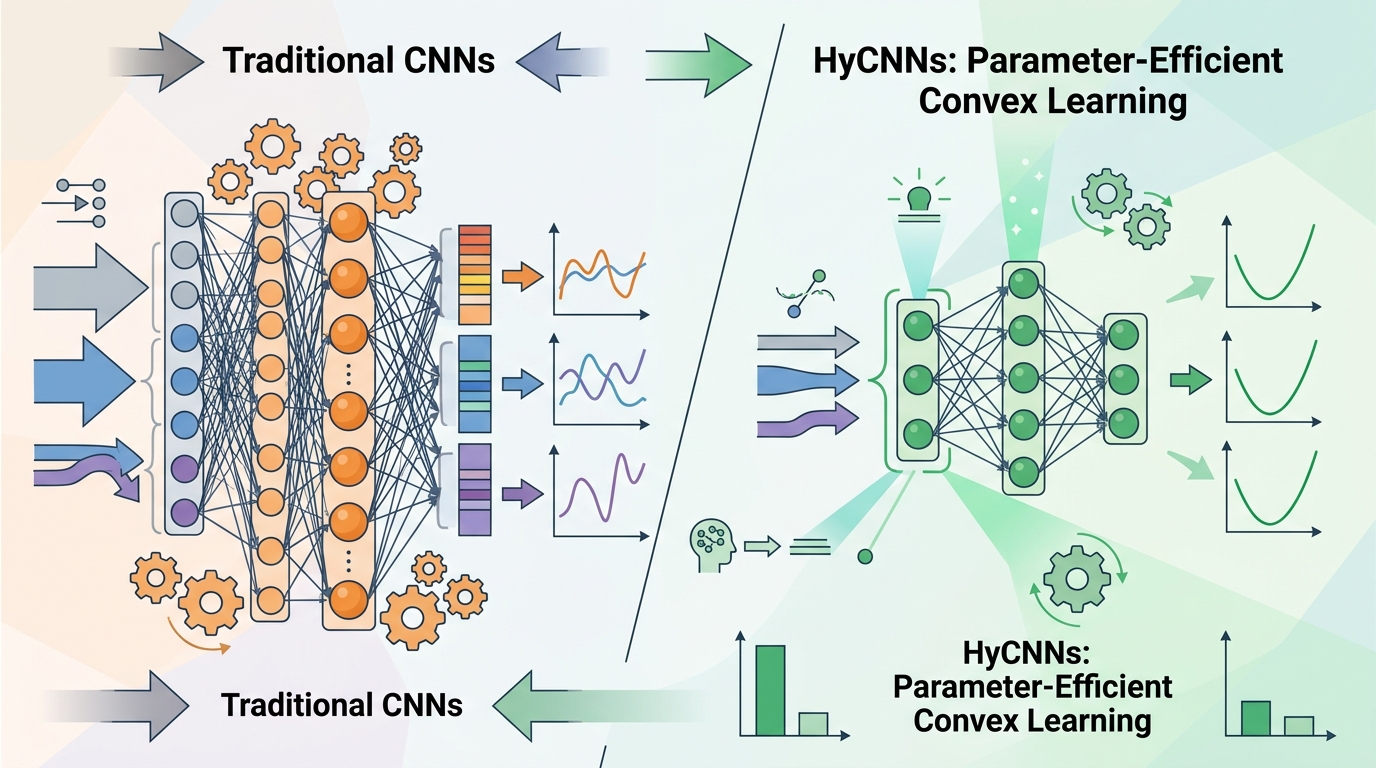

HyCNNs:更省參數的凸函數學習

HyCNNs 把 Maxout 和 ICNN 結合,主打更有效率地學凸函數,並在凸迴歸、插值與高維最適傳輸上展現優勢。

HyCNNs 是一種新的凸神經網路設計,目標是在保留凸性保證的同時,讓模型更省參數、也更容易擴展。

這篇論文處理的是一個很實際、但常被忽略的問題:有些任務不是「把資料擬合好」就夠了,模型還必須符合幾何或結構限制,其中最常見的一種就是凸性。這在 shape-constrained regression、插值,以及 optimal transport 這類問題裡都很重要。作者提出 HyCNNs(Hyper Input Convex Neural Networks),主張它能維持 input convex neural networks,也就是 ICNN 的凸性保證,同時在實作上更容易擴展,也更有效率。

對開發者來說,這種題目很有現實感。當你的模型不能亂來,必須遵守某個結構限制時,通常就得在表達能力、穩定性、參數量之間做取捨。這篇論文想做的事,就是把這個取捨往比較有利的方向推一點:讓模型既守規矩,又不要太笨重。

這篇論文想解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

ICNN 的核心價值,是把「輸入凸」這件事直接寫進模型架構裡。這樣一來,模型學到的函數天生就是凸的,不需要靠訓練後再檢查,也不用把凸性當成額外懲罰項去碰運氣。這對很多需要結構保證的場景很有吸引力,因為你要的不是單純準,而是準、而且還不能破壞數學條件。

問題在於,ICNN 雖然有保證,但不一定夠省。當目標函數比較有層次、比較複雜時,標準 ICNN 可能需要很多參數,才有辦法逼近得夠好。這篇論文直接拿二次函數當例子,指出在理論上,HyCNNs 逼近同樣精度時,所需參數量可以比 ICNN 少上指數級。這是這篇工作的主軸之一:不是只談「能不能學」,而是談「學得夠不夠有效率」。

這個差異對實務很重要。因為在結構受限的學習問題裡,模型如果太大,訓練會更難、部署會更麻煩,也更不適合拿去做大規模應用。換句話說,凸性不是唯一門檻,效率才是能不能真的用起來的關鍵。

HyCNNs 到底怎麼做

HyCNNs 把 Maxout 和 ICNN 的想法混在一起。從論文的描述來看,它保留了 ICNN 的核心精神:模型對輸入保持凸性;但同時又試圖借用 Maxout 類型的設計,讓模型表達能力更強,不會像傳統 ICNN 那樣在表達更複雜的凸形狀時卡得太死。

這裡比較像是架構層級的調整,而不是訓練技巧。也就是說,它不是靠某種額外損失函數、特殊正則化,或訓練流程來「逼」模型變凸,而是直接把凸性放進網路本體。這點很關鍵,因為它把約束從訓練結果變成設計前提,模型從一開始就被限制在正確的函數集合裡。

論文標題裡的「Hyper」也在暗示這件事:它不是單純把 ICNN 改一點點,而是想做一個更高階的模板,讓深度可以更有效地被利用。白話一點說,就是同樣要守凸性,HyCNNs 想要比傳統 ICNN 更會用層數、更會用參數。

這種設計方向對很多工程場景都合理。因為當模型需要結構保證時,最怕的就是架構太僵硬,結果只能靠堆大量參數補救。HyCNNs 想解的,就是這個「既要守規則、又要夠靈活」的矛盾。

論文實際證明了什麼

這篇論文的證據分成理論與實驗兩部分。先看理論。作者證明,對於二次函數的逼近,在達到指定精度時,HyCNNs 所需的參數量可以比 ICNN 少上指數級。這代表它在某些凸函數族上,確實有更好的表示效率。這不是小修小補,而是架構層級的差距。

再看實驗。論文在合成資料上做了 convex regression 和 interpolation 測試,結果顯示 HyCNNs 的預測表現優於既有 ICNN 和一般 MLP。這說明它不只是理論上好看,在實際學習任務裡也能拿出比較好的結果。不過,摘要沒有公開完整 benchmark 細節,所以我們看不到精確數字、資料集規模、誤差指標或訓練設定。

除了合成任務,作者也把 HyCNNs 用在高維 optimal transport,包含合成例子與 single-cell RNA sequencing 資料。摘要指出,在這些設定裡,HyCNNs 常常優於 ICNN-based neural optimal transport 方法,以及其他 baseline。這個結果很有意思,因為 optimal transport 本來就是高維、又很吃結構的問題,而凸性在這裡不是裝飾品,是影響可學性與穩定性的核心條件。

但同樣要講清楚,摘要沒有列出完整 benchmark 數字,所以我們只能說它在多個設定下表現更好,不能把它解讀成已經有全面、可重現的量化結論。這是目前可公開資訊的邊界。

- 理論上:HyCNNs 逼近二次函數時,參數效率優於 ICNN,差距可到指數級。

- 合成任務:在 convex regression 與 interpolation 上,預測表現優於 ICNN 與 MLP。

- 應用任務:在高維 optimal transport 上,對合成資料與 single-cell RNA sequencing 資料都展現競爭力。

- 比較對象:摘要明確提到 ICNN、MLP,以及其他 neural optimal transport baseline。

這對開發者有什麼影響

如果你做的是有結構限制的模型,這篇的啟發很直接:不要只想著怎麼把限制加到 loss 裡,先想架構本身能不能把限制內建進去。這種做法通常更乾淨,也比較容易理解模型到底在學什麼。對需要凸性保證的任務來說,這點尤其重要,因為你不只是要輸出一個答案,而是要確保答案符合問題定義。

另外,這篇也提醒一個常被低估的事:架構選擇本身,可能比你想像中更影響效率。很多人會把注意力放在 optimizer、learning rate、regularization,但如果底層網路家族本身就不夠適合,後面再怎麼調也只是在補洞。HyCNNs 的論點就是,換一個更合適的架構,可能同時拿到更好的逼近效率與更好的實驗表現。

對 optimal transport 相關的開發者來說,這篇尤其值得注意。高維分佈映射本來就難,若再加上凸性或其他結構需求,傳統 ICNN-based 方法可能會顯得吃力。HyCNNs 的定位,就是在不放棄凸性保證的前提下,提供一個更可擴展的選項。

不過,實務上還是要保留一點距離感。摘要沒有提供完整訓練細節、參數量、消融實驗,也沒有把每個 baseline 的優勢拆得很清楚,所以目前還不能直接下結論說它一定能替代所有 ICNN。比較準確的說法是:它看起來是個值得關注的新方向,尤其適合那些同時在意凸性、表達效率與可擴展性的場景。

限制與還沒回答的問題

這篇摘要最明顯的限制,就是資訊還不夠完整。它有理論主張,也有實驗方向,但沒有公開完整 benchmark 細節,所以我們看不到精確數字、訓練成本、資料設定、或不同方法之間的誤差差距。對工程判斷來說,這些資訊都很重要,因為它們會影響你要不要真的把方法搬進自己的 pipeline。

理論部分也有範圍限制。作者證明的是二次函數的逼近效率,這很有代表性,但不等於所有凸學習問題都會有同樣的優勢。也就是說,HyCNNs 的強項目前是「在特定凸函數族上很有效率」,而不是「所有凸問題都全面碾壓」。

最後,摘要雖然提到在多個設定下表現不錯,但沒有提供足夠的消融資訊,讓我們看清楚到底是哪個設計元素帶來主要增益。是 Maxout 式設計的貢獻最大,還是深度、參數配置、或其他實作細節?目前從 raw 資料裡還看不出來。

所以,這篇論文最合理的讀法不是「ICNN 被取代了」,而是「凸函數學習又多了一個更有效率的架構選項」。如果你的問題需要凸性保證,而且又希望模型不要太肥、太難訓練,HyCNNs 這條路線值得放進觀察名單。

對台灣開發者來說,這種研究的價值不只是在論文分數,而是在提醒大家:當任務本身有明確結構時,模型架構就是產品能力的一部分。能不能把約束做進模型裡,常常決定了你最後做出來的是 demo,還是能持續維護的系統。