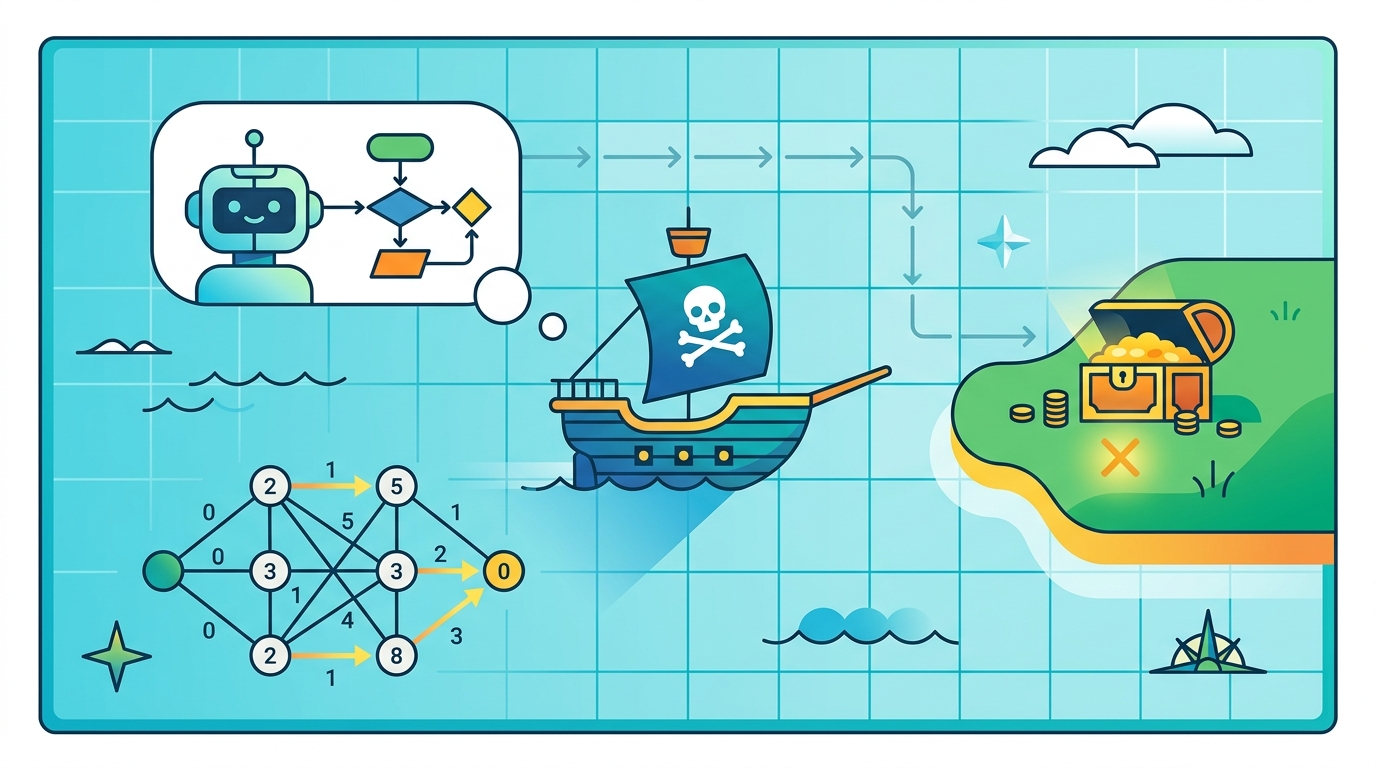

Pirate-AI:用 Q-learning 找寶藏

Pirate-AI 是一個 Jupyter Notebook 強化學習專案,用 deep Q-learning 訓練海盜代理去找寶藏,適合看懂 RL 的基本流程。

Pirate-AI 是一個 Jupyter Notebook 強化學習專案,用 deep Q-learning 訓練海盜代理去找寶藏。

說真的,這專案很小。GitHub 上只有 1 顆星,0 個 fork。可就是這種小專案,最適合拿來拆強化學習的骨架。

它不靠手寫路線。它靠 reward、state、episode。講白了,就是讓代理自己學會哪個動作比較划算。

| 指標 | 數值 |

|---|---|

| 專案 | questmcclure/Pirate-AI |

| Stars | 1 |

| Forks | 0 |

| 實作形式 | Jupyter Notebook |

| 方法 | Deep Q-learning |

這個專案在做什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這個 repo 的核心很直白。它要訓練一個海盜代理,去找寶藏。不是走固定腳本,也不是靠人工規則硬推。

它把問題變成強化學習。代理每做一次動作,就會收到回饋。回饋好,之後就多做。回饋差,就少做。

這類設計很適合拿來教人。因為你可以很清楚看到,LLM 之外的 AI 也是一堆數學和迭代,不是魔法。

- 目標很單純:找到寶藏。

- 方法很典型:deep Q-learning。

- 形式很輕量:Jupyter Notebook。

- 重點很實用:學 policy,不是背答案。

Q-learning 為什麼適合拿來教

Q-learning 的概念不難。你可以把它想成一張動作分數表。每個 state 下,往上、往下、往左、往右,都有一個估值。

代理每走一步,表格或神經網路就更新一次。它不是一次就學會。它要跑很多 episode,慢慢把高分動作留下來。

Deep Q-learning 再往前一步。它不用純表格,改用神經網路近似 Q 值。這樣 state 變大時,比較撐得住。

“Reinforcement learning is learning what to do—how to map situations to actions—so as to maximize a numerical reward signal.”

— Richard S. Sutton, Reinforcement Learning: An Introduction

這句話很經典,也很貼這個專案。RL 的重點不是分類,不是生成,而是選動作。你給它一個環境,它學的是長期報酬。

如果你做過遊戲 AI,這會很有感。因為很多問題本來就不是「答案在哪」,而是「下一步怎麼走才不會死」。

跟其他 RL 教學專案比

Pirate-AI 的優點是小。小到你可以直接在 notebook 裡看流程。這對初學者很友善,因為每一段程式都看得到。

但它也有侷限。它不像 Gymnasium 那種標準環境套件,也不像 Stable-Baselines3 那樣有完整訓練框架。你要自己多理解一點底層邏輯。

我覺得這反而是好事。因為很多人一開始就碰大框架,結果只會調參,不會理解 Q 值怎麼來。

- Pirate-AI:適合入門。

- Gymnasium:適合做標準環境。

- Stable-Baselines3:適合快速實驗。

- Keras:適合寫神經網路。

這類專案的資料脈絡

強化學習在業界沒有像 LLM 那麼吵。可是它一直都在。機器人控制、遊戲 AI、排程最佳化,都會碰到這套東西。

問題是,RL 很吃環境設計。reward 稍微寫歪,代理就會學歪。這也是為什麼很多 demo 看起來很猛,上線卻很容易翻車。

像 Pirate-AI 這種專案,價值不在規模。價值在它把整條訓練鏈攤開。你可以看見 state、action、reward、update,全部串在一起。

如果你是台灣開發者,這種專案很值得看。因為它能補上很多人只會用 API,不懂演算法的缺口。懂底層,才知道什麼時候該用,什麼時候別亂用。

我會怎麼看這個 repo

老實說,這 repo 不像產品。它比較像教具。可是教具做得好,反而比一堆花俏 demo 更有用。

如果你要學 RL,我會先看它怎麼定義環境,再看它怎麼更新 Q 值,最後才看模型結構。順序錯了,很容易只記住名詞。

我也會拿它跟 DQN、SARSA、policy gradient 做比較。因為你一旦懂了 Q-learning,就比較能看懂後面那些方法在解什麼問題。

- 先看環境怎麼設計。

- 再看 reward 怎麼給。

- 接著看 Q 值怎麼更新。

- 最後再看模型架構。

結尾:這個專案值不值得看

如果你想找一個很大的 AI 專案,這個不適合。它太小了,星數也不高。

但如果你想真的理解 deep Q-learning,這種 notebook 專案很值得。因為它不會把你丟進一堆抽象名詞裡。

我會建議你直接把它跑起來,再改 reward 或 state。你會很快發現,RL 最煩的地方,不是模型本身,而是環境和回饋怎麼設。這才是重點。