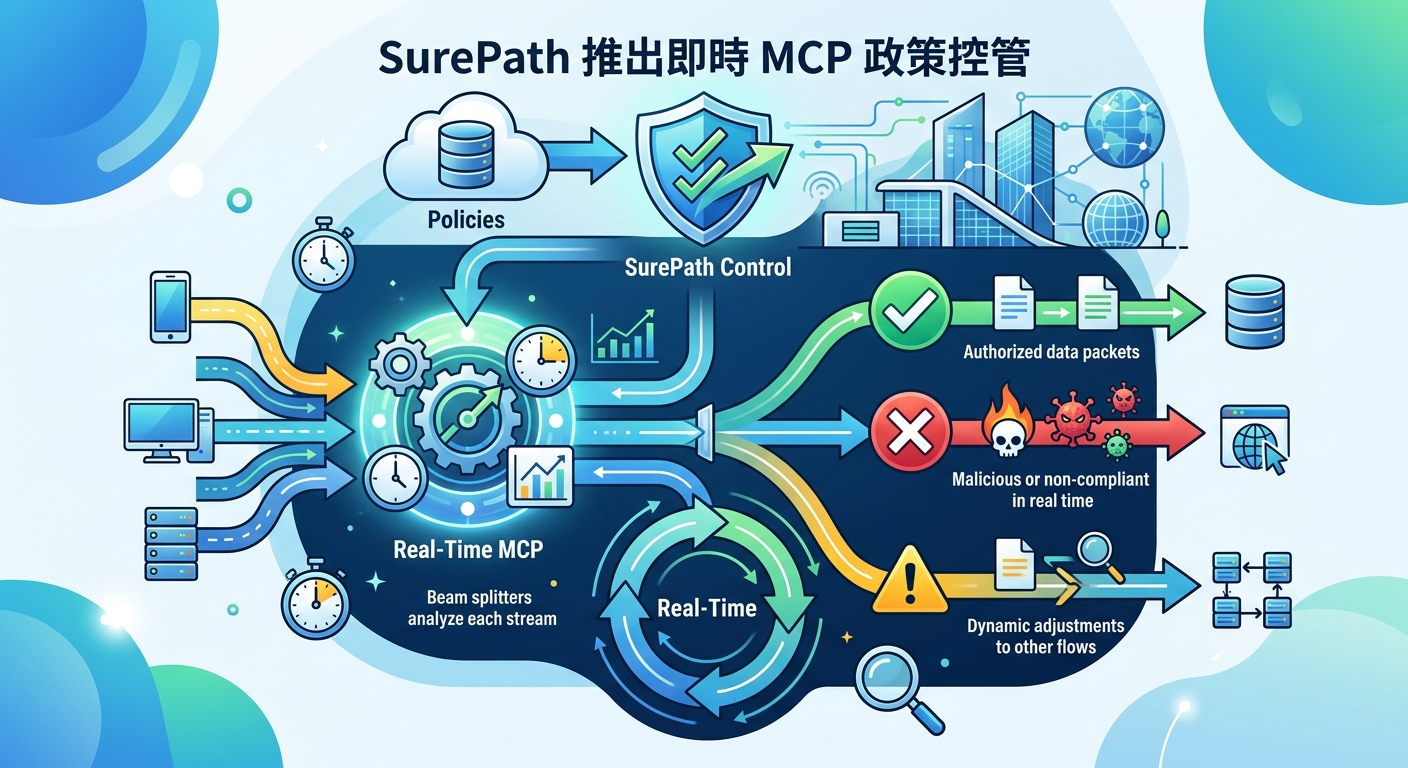

SurePath 推出即時 MCP 政策控管

SurePath AI 發表 MCP Policy Controls,主打在工具呼叫前即時判斷 AI app 可用哪些 MCP server 與工具。重點不在聊天內容,而在 AI 會不會拿著你的身分去動 Google Drive、Salesforce 或 AWS。

AI 助手現在不只會聊天。它還會幫你開工具、讀資料、改設定。這件事一旦接上 MCP,風險就跟以前完全不同。

SurePath AI 在 2026 年 3 月 12 日公布新功能「MCP Policy Controls」。講白了,就是在 AI app 真的呼叫工具前,先檢查這個工具能不能用。若違反規則,就直接擋掉,不讓請求送到後端。

這個題目很硬,但很實際。因為 ChatGPT、Claude、Cursor 這類支援 MCP 的客戶端,已經開始把聊天介面接到企業系統。你如果還把它當成單純問答工具,安全模型很可能早就過時了。

MCP 為什麼突然變成安全焦點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

MCP,也就是 Model Context Protocol,目標很單純。它想用一套標準方式,讓 AI 客戶端去呼叫外部工具和服務。文件看起來很乾淨,實際上卻代表一件事:AI 不只讀文字,它可以開始做事。

這個「做事」很要命。因為它可能用的是使用者自己的權限。像是讀 Google Drive 檔案、查 Salesforce 客戶資料,甚至打 AWS API 做管理操作。以前 prompt 送進去,回來的是一段文字。現在 prompt 送進去,可能換來一連串讀寫與管理動作。

更麻煩的是,MCP 工具不一定都在雲端。有些跑在員工筆電本機,有些放在遠端伺服器。桌面 AI app 還可能悄悄啟動本地工具。安全團隊如果只盯傳統網路流量,真的很容易漏掉。

- SurePath 指出,MCP 工具可在本機執行,桌面 AI app 可能靜默啟動。

- 官方點名 ChatGPT、Claude、Cursor 都能接 MCP 工具。

- 產品主打工具執行前的政策檢查,而且可細到單一工具層級。

- SurePath 也說自己維護已知 MCP server 與端點目錄,用來檢查遠端流量。

你可以把這件事想成權限外包。使用者原本自己點按鈕、自己查資料。現在是 LLM 幫你決定下一步該叫哪個工具。這時候風險不只是資料外洩,還有操作順序、存取範圍,以及誰在幫你做判斷。

我覺得很多公司卡在同一個盲點。他們有做 IAM、有做 DLP,也有防火牆。可是這些控制點大多不是為「AI 代理人會自己挑工具」這件事設計的。MCP 把這個缺口放大了。

SurePath 怎麼做:攔截、辨識、阻擋

SurePath 的做法很直接。它想站在受保護的 MCP 流量路徑上,檢查請求內容,理解這個工具到底要做什麼,再依照政策決定放行或封鎖。不是等事情做完才告警,而是在執行前先處理。

官方說法是它能看懂 MCP schema。也就是說,它不是只看目的地 IP 或網域,而是看 payload 裡的工具資訊。若工具屬於破壞性操作,像刪除、修改、提升權限,就能依規則擋掉。若只是唯讀查詢,則可選擇放行。

這裡最有意思的點,在於「修改 payload」。SurePath 不只記錄請求,也不只在事後跳警示。它宣稱能把不符合規則的工具,直接從 payload 裡移除。這代表後端服務在那次 session 根本看不到那個工具。

“MCP has quickly evolved from a buzz-acronym to the backbone in next-gen AI-powered workflows,” said Randy Birdsall, CPO and Co-Founder, SurePath AI.

這句話來自 SurePath 自家新聞稿。Randy Birdsall 是真實存在的人,也是 SurePath 的共同創辦人兼產品長。雖然這種引言多少有宣傳味,但核心判斷我認同:MCP 已經不太可能用全面封鎖解決。

原因很簡單。開發者會用,產品團隊也會推。尤其寫程式工具和桌面助理,本來就很適合接 MCP。你今天禁掉,明天就有人問為什麼不能讓 AI 幫忙查文件、讀 ticket、跑測試。全面禁止通常撐不久。

SurePath 還提到另一個點:它能辨識陌生 MCP 工具,包含假冒已核准工具,或試圖把資料送出核准範圍的工具。這很像供應鏈問題。MCP 把接工具的摩擦降很低,低摩擦通常也代表低審查。這不是陰謀論,是軟體世界的老毛病。

這個產品到底多了什麼

如果把行銷詞拿掉,SurePath 這次主打兩件事。第一是 Discovery,也就是看見員工到底用了哪些 MCP 工具。第二是 Blocking,也就是把你不想讓 AI 用的工具擋下來。這兩件事聽起來普通,但其實很務實。

安全產品的成熟路線大多差不多。先有可見性,才談得上控管。你連公司裡有哪些 AI client、接了哪些 MCP server、用了哪些工具都不知道,後面談政策都是空的。MCP 的可見性又比一般 SaaS 難,因為它可能同時跨本機與遠端。

另一個麻煩點是,使用者自己也不一定清楚 AI 在替他呼叫什麼。很多人只覺得我在問一個問題,卻不知道背後已經串了 CRM、文件庫、雲端儲存,甚至內部報表系統。這也是為什麼「看見工具層」這件事有價值。

- MCP Tool Discovery:監控員工 AI app 的 MCP 使用情況,辨識出現過的工具。

- Policy-based removal:若工具違反規則,直接從 payload 移除,例如只允許唯讀存取。

- MCP Tool Block List:讓團隊把已發現的特定工具加入封鎖名單。

- Remote traffic control:把受保護的 MCP 流量導向 SurePath,套用即時存取規則。

我覺得這裡最值得觀察的,是跨實作相容性。因為 MCP 雖然有標準,但不同 client、不同 server、不同工具包裝方式,細節不會完全一樣。SurePath 若要真的打進企業環境,不能只在 demo 場景順。它得在混亂的真實環境也能穩。

還有延遲問題。任何加在請求路徑上的控管,都會被問一句:慢多少?如果每次工具呼叫都多 200 毫秒,單次看不多,但 AI agent 一輪跑 10 次工具,體感就差很多。資安產品常常輸在這種很無聊但很真實的地方。

跟舊一代 AI 控制相比,差在哪

多數企業現在的 AI 控制,還是圍繞在聊天層。像是 prompt 過濾、模型存取限制、DLP 檢查回覆內容。這些都還是有用,但 MCP 多出了一個新平面:行動治理。問題不再只是「你問了什麼」,而是「系統實際做了什麼」。

這個差異很大。因為看起來無害的 prompt,也可能導出高風險的工具鏈。你問 AI 幫忙整理業績摘要,它可能先去 CRM 抓客戶紀錄,再去雲端硬碟拿報表,最後寫回內部系統。每一步如果都帶著你的身分,風險就不是單點,而是連鎖。

舊控制手段不是沒用,而是看不到工具層語意。防火牆知道你連去哪裡,IAM 知道你有沒有權限,DLP 知道內容裡有沒有敏感資料。但它們通常不知道這次 MCP 工具呼叫到底是唯讀查詢,還是刪除操作。

- Prompt filtering:重點在文字內容,檢查輸入輸出是否違規。

- IAM:決定使用者能碰哪些資源,但不一定理解 AI 挑了哪個工具。

- Firewall:能限制連線目的地,卻常看不懂工具能力差異。

- MCP policy controls:直接檢查工具層,並在執行前擋掉不允許的動作。

如果要拿市場上的舊類型產品來比,大概可以分成三群。第一群是 AI gateway,擅長管模型與 prompt。第二群是 SaaS 安全或 CASB,擅長看雲端應用流量。第三群是 IAM 與 PAM,擅長管身分與高權限操作。SurePath 想卡的位置,剛好在這三者中間。

這個位置有機會,但也不好做。因為它得同時理解協定、工具語意、身分脈絡,還要把例外處理做得不煩人。企業環境最怕的不是沒有規則,而是規則太多、誤擋太多,最後大家偷偷繞過去。

若看競品方向,很多廠商現在還停在「看見 AI 使用」或「阻止敏感資料貼進聊天機器人」。SurePath 這次往前一步,瞄準的是工具呼叫前的決策點。這個切入點比較貼近 agentic AI 的實際風險。講白了,AI 開始能做事後,光管它說什麼已經不夠了。

背後的產業脈絡,其實很清楚

MCP 近一年在開發圈很紅,不是沒有原因。它讓工具整合變簡單,讓 AI client 可以用比較一致的方法接外部能力。對開發者來說,這很省事。對企業來說,這也很危險,因為整合速度常常跑在治理前面。

你可以回想 SaaS 興起那幾年。先是大家自己註冊各種服務,後來才補上 SSO、CASB、稽核與權限治理。AI 工具現在很像重演一次,只是速度更快。以前是員工自己開服務,現在是 AI 幫員工去碰服務。控制難度直接加倍。

還有一個現實因素。企業內部最有價值的系統,像 CRM、工單、文件庫、雲端管理平台,通常都不是為 AI agent 設計的。它們原本假設操作的人類知道自己在按什麼。現在換成 LLM 代勞,錯誤模式就完全不同。權限沒變,風險模型變了。

所以我會把 SurePath 這類產品,看成企業 AI 治理的第二波。第一波是「別把機密貼進聊天框」。第二波是「AI 幫你動系統前,要先過規則」。這兩波都重要,但第二波更貼近實際營運風險。

給 AI 團隊的實際建議

如果你的公司正在試 MCP-enabled app,先不要急著買一堆新工具。第一步很簡單,盤點現在有哪些 AI client 在用。ChatGPT、Claude、Cursor、內部 Copilot,都算。接著確認它們能不能啟動本地或遠端 MCP 工具。

第二步,把工具分級。哪些只能唯讀,哪些可以寫入,哪些碰到財務、人資、正式環境就必須人工批准。你若現在沒有這張表,代表風險其實還沒被定義清楚。沒有定義,就不可能有像樣的治理。

第三步,要求供應商回答幾個很硬的問題。它能不能看懂不同 MCP 實作。會增加多少延遲。誤判時怎麼除錯。封鎖規則能不能跟身分、部門、裝置狀態一起判斷。這些比漂亮 dashboard 重要多了。

我的預測很直接。接下來 12 個月,企業採購 AI 平台時,會把 MCP 治理列成基本題。尤其是會把 CRM、雲端管理、工單系統、文件庫開給 AI 助手的公司。到時候大家問的,不會是「能不能用 MCP」。而是「哪些工具能用、誰能用、在什麼限制下用」。

如果你現在就在導入 AI agent,我建議今天就做一件事:抓一份實際工具清單,逐項標示唯讀、可寫、禁止。這張表雖然土,但很有效。很多資安問題,不是輸在技術不夠強,而是連最基本的邊界都還沒畫出來。