標籤

attention

注意力機制是大型語言模型的核心,決定模型如何在長上下文中檢索資訊、維持狀態與控制計算成本。這個主題涵蓋傳統 Transformer、KV cache、長上下文優化,以及把 attention 與 state-space、記憶模組結合的新設計。

3 篇文章

技術研究/5月4日

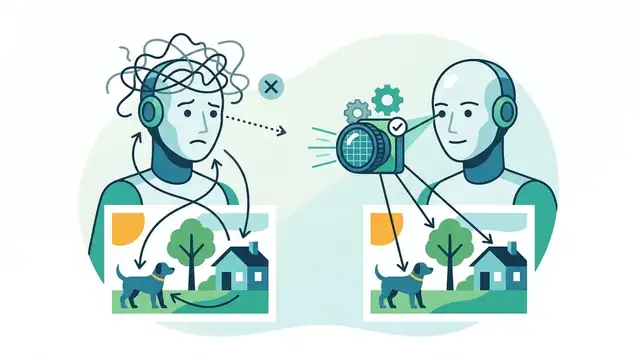

PVM 讓 LVLM 不再視覺漂移

Persistent Visual Memory(PVM)用輕量級平行模組,試圖讓 LVLM 在長篇生成時持續保留視覺資訊,減少視覺訊號隨文字變長而衰減的問題。

技術研究/4月21日

Sessa 把注意力放進狀態空間記憶

Sessa 把 attention 放進 state-space 的回饋路徑,想同時保留長上下文檢索與穩定記憶。摘要主打 power-law 記憶尾巴,並宣稱長上下文 benchmark 表現領先。

技術研究/4月2日

Sebastian Raschka 的 LLM 架構圖鑑

Raschka 的 LLM Architecture Gallery 把 GPT-2、Llama 3、OLMo 2、DeepSeek、Qwen 等模型的層數、注意力與 KV cache 數字攤開來比,工程師一眼就能看出部署差異。