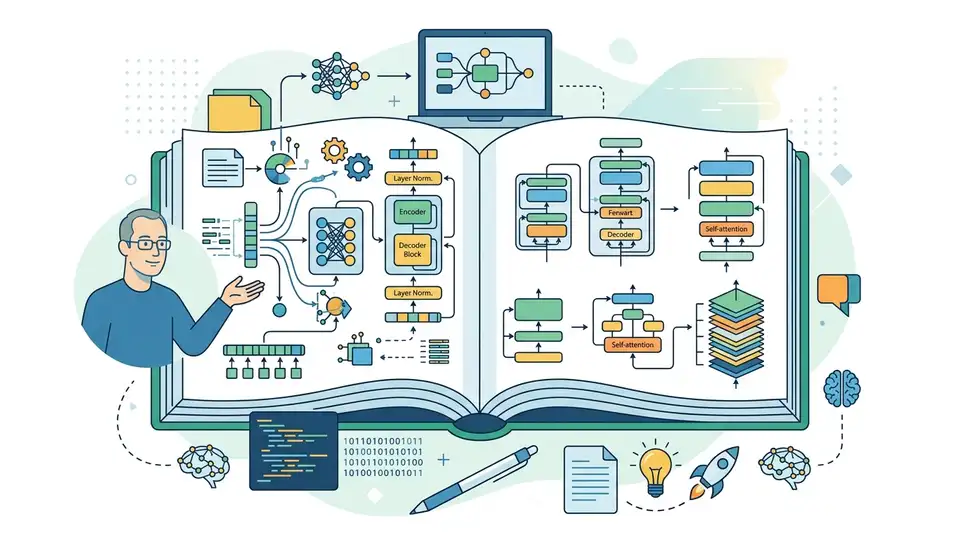

Sebastian Raschka 的 LLM 架構圖鑑

Raschka 的 LLM Architecture Gallery 把 GPT-2、Llama 3、OLMo 2、DeepSeek、Qwen 等模型的層數、注意力與 KV cache 數字攤開來比,工程師一眼就能看出部署差異。

Sebastian Raschka’s LLM Architecture Gallery 很像工程師的作弊表。它把 30 多個語言模型攤開來看。從 GPT-2 到 Llama 4,每個模型都有層數、上下文長度、注意力型態,還有 KV cache 數字。

這頁最猛的地方,是它不講空話。你只要看幾個欄位,就知道模型在伺服器上會多吃資源。像 Llama 3 8B 用 32 層,bf16 下每個 token 只要 128 KiB KV cache。OLMo 2 7B 也是 32 層,但每個 token 要 512 KiB。差了 4 倍,這種差距不是小事。

這頁到底在幹嘛

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

講白了,這是一個模型架構資料庫。不是宣傳頁,也不是 benchmark 排行榜。它把架構圖、設定檔、技術報告連在一起,讓你能追到原始資料。這對做軟體的人很重要,因為很多成本問題,都藏在看起來很無聊的細節裡。

像是 attention 用什麼形式、layer norm 放哪裡、layer 數多少、context 開多長。這些東西不會直接出現在行銷文案裡。可是它們會直接影響推論延遲、顯存壓力,還有一台卡能塞幾個 session。

Raschka 也把他自己的比較文章串進來。像 The Big LLM Architecture Comparison、From GPT-2 to gpt-oss,還有 From DeepSeek V3 to V3.2。你可以把它當成一個入口,直接跳去看原始脈絡。

- GPT-2 XL:15 億參數,1,024 token context,48 層 MHA,300 KiB KV cache

- Llama 3 8B:80 億參數,8,192 token context,32 層 GQA,128 KiB KV cache

- OLMo 2 7B:70 億參數,4,096 token context,32 層 MHA,512 KiB KV cache

- DeepSeek V3:6710 億總參數,370 億 active,61 層,68.6 KiB KV cache

架構差異,真的會影響部署

很多人看模型,先看參數量。說真的,這只看一半。真正決定你伺服器會不會爆掉的,常常是 cache 和 attention。Dense 模型比較好理解,但不一定好跑。MoE 模型參數很多,可是 active compute 可能低很多。

像 DeepSeek V3 和 Llama 4 Maverick 這類 MoE 架構,就是把容量分散到多個 expert。這樣做的好處很直接。總參數可以很大,但每次只喚醒一部分,推論成本不一定跟著爆。

注意力設計也很有戲。有人用標準 multi-head attention。有人用 grouped-query attention。有人加 QK-Norm。有人把長上下文切成 chunk,再混一點 full attention。Raschka 把這些設計放在同一頁,差異一眼就看得出來。

“The best way to understand a model is to look at its architecture.” — Sebastian Raschka, The Big LLM Architecture Comparison

這句話很直白,也很對。Benchmark 只告訴你結果。架構會告訴你,這模型為什麼能跑出這個結果。

我覺得這頁還有一個加分點。它不是一次性圖表。它把來源、版本、差異都整理起來。頁面也有 issue tracker,錯了可以回報到 Architecture Gallery issue tracker。在 LLM 世界,規格常常改很快。這種維護很實際。

- Llama 4 Maverick:4000 億總參數,170 億 active,1,000,000 token context,36 chunked + 12 full GQA layers

- Qwen3 235B-A22B:2350 億總參數,220 億 active,94 層,188 KiB KV cache

- Gemma 3 27B:270 億參數,128,000 token context,52 個 sliding-window + 10 個 global layers

- Mistral Small 3.1:240 億參數,128,000 token context,40 層 GQA,160 KiB KV cache

為什麼比對工具比海報更有用

這頁也有海報版,還能在 Redbubble 買到,或去 Gumroad 找可列印版本。拿來掛牆上很帥,這點我不否認。但真正有用的是比較工具。牆上海報是裝飾。比較工具才是工程師會一直開著的東西。

因為很多模型在參數大小上差不多,部署成本卻差超多。Llama 3 8B 每個 token 只要 128 KiB cache。OLMo 2 7B 卻要 512 KiB。這不是小差異。這會直接影響 batch size、吞吐量、延遲,還有你到底能不能在同一張卡上多開幾個 request。

更大的模型差異更明顯。DeepSeek V3 有 671B total parameters,但 active 只有 37B。這種配置很適合拿來討論 serving 策略。你不能只說它大。你要問的是,實際推論時到底啟動多少參數。

Llama 4 Maverick 更誇張。它把 context 拉到 1,000,000 token。這種數字很容易讓人喊哇塞,但工程師會先問另一件事:長上下文到底要多少記憶體,吞吐量會掉多少。這才是重點。

- Dense 8B 與 7B 模型,cache 差 4 倍

- DeepSeek V3 的 active 參數遠低於 total 參數

- 1,000,000 token context 會改變 serving 方式

- GQA 通常比傳統 MHA 更省記憶體

這頁放在產業脈絡裡怎麼看

LLM 這幾年很像從比誰大,變成比誰會省。早期大家在意參數量。後來大家開始看 context。現在更現實。大家在意的是,跑一次要多少顯存,能不能撐住長對話,API 成本會不會炸掉。

這也解釋了為什麼架構圖會越來越重要。當模型數量一多,單看排行榜很容易失真。你可能以為兩個模型差不多。結果一個是 dense,一個是 MoE。或是一個用 128K context,另一個只有 4K。部署上的麻煩完全不同。

對台灣團隊來說,這種資料很實用。很多新創和內部工具,不一定有超大 GPU 叢集。你更需要知道,哪個模型比較省 cache,哪個 attention 比較穩,哪個 stack 比較適合本地伺服器。這種時候,架構比行銷更誠實。

如果你想對照不同模型的新聞解讀,也可以看 OraCore 先前的整理,例如 Llama 4 Maverick architecture notes,還有 DeepSeek V3.2 breakdown。這些內容跟 Raschka 的圖鑑放在一起看,會更有感。

工程師該怎麼用這份圖鑑

如果你在做 LLM 產品,我會建議你直接把這頁存書籤。真的。你在選模型時,先看 layer、cache、attention,再看 benchmark。順序別顛倒。因為 benchmark 很容易讓人高潮,架構才會決定你能不能上線。

如果你在學 LLM,這頁也很適合拿來對照。你可以從 GPT-2 看起,接著看 Llama 3、OLMo 2,再看 DeepSeek 和 Qwen。你會很快發現,模型演進不是只靠參數變大。很多時候,差異來自更好的 attention、更聰明的 cache 設計,還有更務實的 serving 思維。

我的判斷很簡單。接下來幾個月,大家會更常用這種架構圖鑑來做模型選型。不是因為它很潮。是因為它真的省時間,也真的能少踩坑。你如果要選一個模型上線,先看這頁,再看文件,通常比較不會翻車。