標籤

KV cache

KV cache 是大型語言模型推論時最吃記憶體的部分之一,長上下文、低延遲服務與雲端部署都會直接受它影響。這個主題涵蓋量化、壓縮、HBM 容量與頻寬取捨,以及像 TurboQuant 這類降低 KV cache 成本的方法。

10 篇文章

為什麼 TurboQuant 重新定義 KV cache 辯論

TurboQuant 不是單純把 KV cache 壓小,而是把壓縮從工程技巧提升成可證明的效率方案。

TurboQuant:線上向量量化更接近最優

TurboQuant 提出可線上運作、適合加速器的向量量化方法,主打 MSE 與 inner-product 失真都能逼近近似最優,並鎖定 KV cache 與向量搜尋場景。

TurboQuant、EDEN 與引用爭議

TurboQuant 主打 KV-cache 6x 壓縮,卻被指和 DRIVE、EDEN 同源,還有 scale 選擇與 benchmark 公平性爭議。

NVIDIA B300 對 H200:DeepSeek 實…

B300 有 288GB HBM3e 和 8TB/s 頻寬。這篇直接比 H200,拆解 DeepSeek 推論、KV cache、雲端成本與部署取捨。

TurboQuant 是什麼?Google 新論文重點

Google 的 TurboQuant 盯上 LLM 的 KV cache 瓶頸,用低位元量化降低記憶體用量與推論成本。這篇帶你看它在解什麼問題、和其他優化法差在哪。

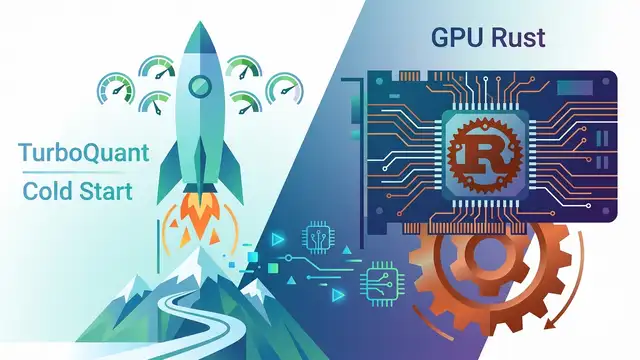

TurboQuant、冷啟動與 GPU Rust

TurboQuant 把 KV cache 壓到 4.6 倍,GPU state restore 盯上 32B 模型冷啟動,Rust 也更深入 CUDA 開發。

TurboQuant 解不了記憶體荒

Google 的 TurboQuant 可把 KV-cache 記憶體用量降到 6 倍,但更長上下文、更多 agent 與更高吞吐,可能把 DRAM 和 NAND 需求繼續往上推。

Sebastian Raschka 的 LLM 架構圖鑑

Raschka 的 LLM Architecture Gallery 把 GPT-2、Llama 3、OLMo 2、DeepSeek、Qwen 等模型的層數、注意力與 KV cache 數字攤開來比,工程師一眼就能看出部署差異。

Universal YOCO 想把深度做大但不爆 cache

YOCO-U 把 recursive computation 和 efficient attention 結合,想在推理時拉高有效深度,同時壓住 KV cache 成長與額外開銷。

2026 年 3 月 AI 模型新聞重點

2026 年 3 月的 AI 圈看起來很安靜,其實重點早就不在新模型。真正有料的是推論速度、KV cache 壓縮、Agent 權限控制,還有 OpenAI 內部重組。對開發者來說,這些變化比排行榜多 1 分更實際。