為什麼 TurboQuant 重新定義 KV cache 辯論

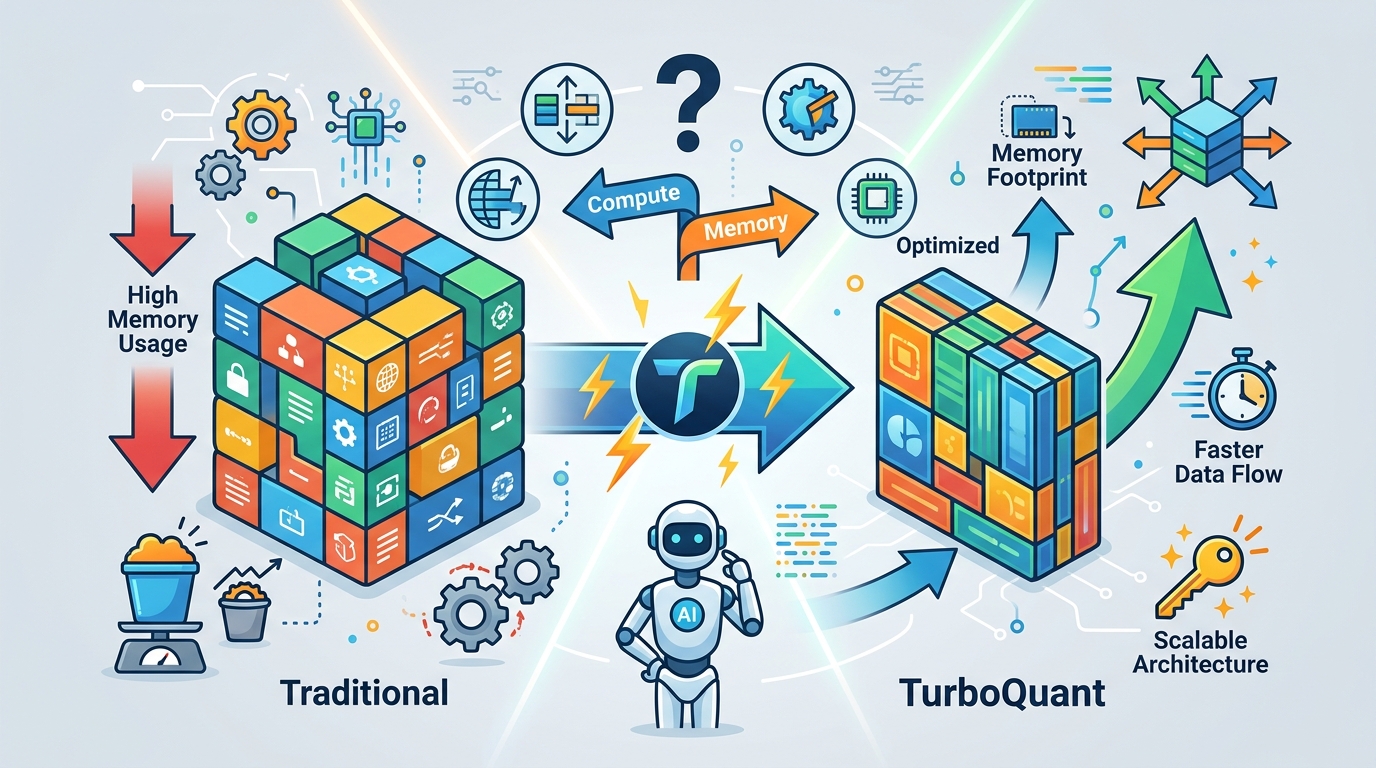

TurboQuant 不是單純把 KV cache 壓小,而是把壓縮從工程技巧提升成可證明的效率方案。

TurboQuant 不是單純把 KV cache 壓小,而是把壓縮從工程技巧提升成可證明的效率方案。

我認為 TurboQuant 會改寫 KV cache 的討論方式,因為它把焦點從「能不能再少幾個 bit」轉到「能不能在不付出額外代價下,穩定降低記憶體占用」。

第一個論點:它打中的不是壓縮率,而是隱藏成本

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

多數 KV cache 壓縮方案看起來很漂亮,實際上卻被 metadata 吃掉一部分收益。像是每個 block 的 scale、offset、或額外的正規化資訊,常常讓理論上的壓縮率在系統層面打折。TurboQuant 的價值就在於它把這些附加成本視為主要敵人,而不是把注意力只放在數字本身。

這件事在長上下文推理特別重要。當 context 長度從 8K 拉到 32K、64K 時,KV cache 的記憶體需求不是線性「變大一點」,而是直接決定你能不能把 batch 撐起來、能不能把延遲壓住。若一個方法能把儲存量逼近 3-bit 等級,同時不需要堆一堆輔助狀態,那它改變的是部署邊界,不只是論文表格。

第一個論點:它打中的不是壓縮率,而是隱藏成本

TurboQuant 的設計重點,不是把向量硬擠進更小的桶,而是重新定義表示法。這讓它的壓縮收益更接近「淨收益」,也就是扣掉額外 bookkeeping 之後,真正省下來的記憶體。對工程團隊來說,這比單看 bits per value 更有意義,因為真正影響 GPU occupancy 的,是最終落到顯存裡的總量。

這也是為什麼它比傳統 vector quantization 更值得重視。很多方法在 benchmark 上看起來很強,但一進到真實推理管線,就會碰到對齊、快取格式、kernel 融合等問題。TurboQuant 直接把 overhead 當成設計目標,等於承認 KV cache 壓縮不是純數學題,而是系統題。

第二個論點:PolarQuant 把幾何問題變成可壓縮問題

TurboQuant 的第一段核心是 PolarQuant。它先做隨機旋轉,再把向量轉到極座標表達,等於先把資料的幾何結構整理過,再做量化。這不是裝飾性的數學包裝,而是把原本難壓的座標表示,轉成更適合 scalar quantization 的形式,從源頭減少需要保存的資訊。

這種做法的實際意義很明確。KV cache 之所以難處理,是因為每一層、每一 token 都在累積記憶體壓力。若壓縮步驟本身還要依賴大量校正參數,那收益很快就被吃掉。PolarQuant 的好處是它讓壓縮更接近「結構性簡化」,而不是單純把誤差往外推。

第二個論點:PolarQuant 把幾何問題變成可壓縮問題

對 RAG 系統或長上下文 LLM 來說,這種幾何重整尤其關鍵。因為注意力機制看的是向量之間的相對關係,一旦表示法能保留主要語義,又不需要存太多額外資訊,模型就能在同樣顯存下服務更長文本或更多並發請求。這就是 TurboQuant 會被視為架構級改進的原因。

更直接地說,PolarQuant 提供的是一條比較乾淨的路徑:先把向量變得更容易量化,再把量化後的代表性保住。這比一開始就假設「壓小一點總會傷準確率」更成熟,因為它證明幾何設計本身就能幫忙降低損耗。

反方可能怎麼說

最強的反對意見是,這套方法再漂亮,也不代表能在真實系統裡落地。推理堆疊裡有 fused kernel、vendor 特化記憶體布局、不同 GPU 的吞吐差異,還有延遲 SLA 的限制。很多學術上成立的方法,最後輸給的是一個更粗糙、但更容易整合的方案。

這個質疑很合理,而且它指出 TurboQuant 的真正門檻不在論文,而在實作。若 kernel 沒寫好、資料搬運沒處理好、與現有 serving stack 的整合成本太高,理論優勢就會被工程摩擦抵消。

但這個反對意見不能推翻核心結論。因為 KV cache 本來就是長上下文推理的主要瓶頸,而 TurboQuant 解的正是現有方法最常忽略的兩件事:metadata 膨脹與壓縮偏差。也就是說,它不是在跟工程現實對賭,而是在更精準地對準痛點。部署難度存在,價值也同樣存在。

你能做什麼

如果你是工程師,先別只看壓縮比,請把 cache pipeline 裡的額外狀態、對齊成本、以及實際顯存佔用一起算進去。如果你是 PM,評估 KV cache 壓縮方案時,要用端到端延遲、吞吐與準確率退化三項一起看,不要被單一 benchmark 騙過。如果你是創辦人,現在就該認清一件事:AI 基礎設施下一階段的競爭,不是誰模型更大,而是誰能用更少記憶體把長上下文穩定跑起來。