標籤

prompt engineering

Prompt engineering 已從「把話說好」變成 AI 工作流程的一部分,涵蓋標準化提示、結構化輸出、代理迴圈、長上下文與治理需求。對開發者來說,它直接影響錯誤率、token 成本與可審核性。

11 篇文章

2026 還值得學 Prompt Engineering 嗎

2026 年的 prompt engineering 不是消失,而是融進 AI 產品、工程和營運職位。

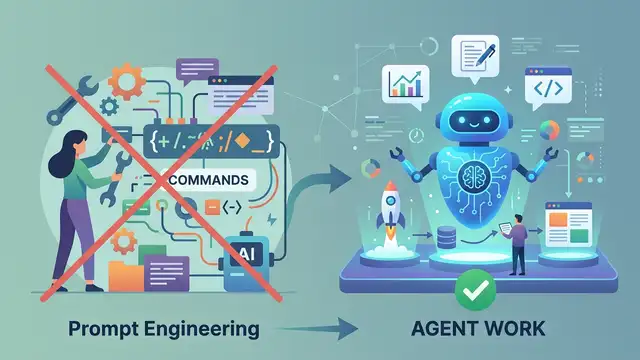

為什麼 AI Agent 時代,Prompt Engineering 已經死了

AI Agent 的關鍵不在於把提示詞寫得更漂亮,而在於把上下文選對、排好、壓縮好;context engineering 才是可靠性的核心。

為什麼 RAG 需要自癒層,而不只是更好的提示詞

RAG 應被視為會失敗的系統,真正該補的是即時自癒層,而不是繼續迷信提示詞調校。

Prompt 工程正在變成基礎設施

Springer 新章節指出,Prompt engineering 已不只是寫得巧,而是牽涉倫理、治理與領域知識的系統工作。

AI 工作為何需要提示標準

Springer 新章節主張提示工程需要共通標準,才能減少 Token 浪費、降低錯誤,並讓 AI 工作更好追蹤與審核。

從 Prompt 到 Harness 工程

OpenAI 透露,一個 3 人團隊用 Codex、5 個月,合併約 1,500 個 PR,做出超過 100 萬行程式碼的產品。重點不在寫 prompt,而是怎麼設計讓 AI 能穩定工作的 harness。

ChatGPT 廣告越來越一致

40,000 筆廣告版位分析顯示,ChatGPT 廣告正變得更短、更直白、更標準化。這反映 OpenAI 在優化轉換,也透露 LLM 使用習慣正在往任務導向收斂。

Agent 與結構化輸出提示詞實戰

LLM 進到生產環境後,提示詞不再是寫得漂亮就好。這篇拆解推理、長上下文、JSON 合約與 agent 迴圈,講清楚怎麼把 GPT、Claude 和本地模型用得更穩。

別把 Prompt Engineering 想太神

Prompt engineering 不是玄學。AWS 直接把方法、用途和取捨講清楚,重點是把模糊需求變成可用輸出,讓 LLM 更穩、更好控。

重複提示詞,準確率真的會上升

Google Research 研究發現,提示詞複製一次可讓 70 組模型與基準測試中的 47 組提升準確率,NameIndex 甚至從 21.33% 衝到 97.33%。

2026 提示工程:技能、工具,還是工作?

提示工程還有用,但已經不是單靠幾句 Prompt 就能拿高薪的神話。從工具鏈、評估流程到職缺變化,2026 年更像是把 Prompt 納進產品、軟體與營運流程的一項實用技能。