重複提示詞,準確率真的會上升

Google Research 研究發現,提示詞複製一次可讓 70 組模型與基準測試中的 47 組提升準確率,NameIndex 甚至從 21.33% 衝到 97.33%。

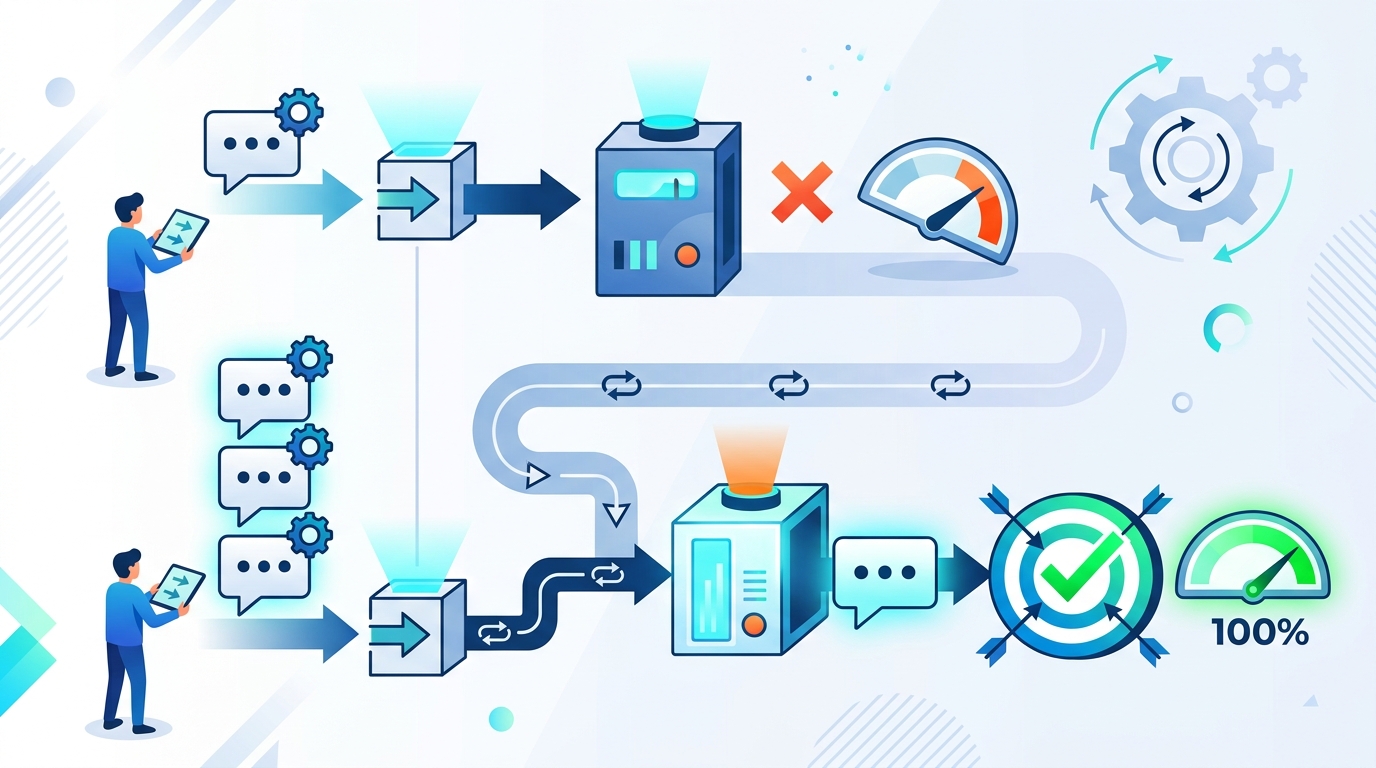

把提示詞複製一次,準確率真的可能上去。Google Research 的研究看了 7 個閉源模型,搭配 70 組模型與基準測試配對。結果有 47 組變好,NameIndex 甚至從 21.33% 飆到 97.33%。

講白了,這招很便宜。你不用改權重,也不用重訓模型。可問題也很現實。它不是萬用解,效果很吃任務類型、提示詞格式,還有模型是在做記憶,還是在做推理。

研究到底測了什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這篇研究不是在玩感覺分數。它直接看正確率。研究團隊把每個 prompt 原封不動複製一次,再去測常見基準。像 ARC Challenge、OpenBookQA、GSM8K、MMLU-Pro,還有 MATH,都有被拿來比。

這點很重要。很多 AI 報告愛講「看起來比較好」。但產品團隊最在意的是對或錯。只要是客服分流、資料擷取、欄位分類,正確率就是硬指標,不是裝飾品。

這次結果裡,有幾個數字很刺眼。不是因為它多炫,而是因為它夠實際,實際到你會想立刻開 A/B test。

- 70 組配對裡,有 47 組變好。

- 贏的案例裡,沒有顯著退步。

- Gemini Flash-Lite 在 NameIndex 從 21.33% 到 97.33%。

- 多數情況下,延遲幾乎沒變。

- 三次重複有時也會變好,但常常更慢。

研究還做了 padding 檢查。意思是,他們想確認不是單純因為 token 變多,模型就比較會答。這個細節蠻關鍵。因為它把焦點拉回模型怎麼讀上下文,而不是字數灌水。

如果你平常也在做 prompt 測試,這種研究很像提醒你一件事。先別急著怪模型爛。先看你的測法有沒有問題。很多時候,問題出在 prompt,不出在模型。

為什麼重複一次會有效

原因沒有想像中玄。LLM 在 prefill 階段會順序處理 token。當 prompt 被再送一次,後半段內容就能參照更完整的 key-value cache。簡單說,模型像是又看了一次同樣資訊,但這次上下文更完整。

這對某些任務很有幫助。像是資訊擷取、格式對齊、短答案分類,重複一次常常能把答案拉穩。因為這些任務吃的是回憶、比對、定位,不太吃長鏈推理。

“The model is a stochastic parrot.” — Emily M. Bender

這句話很多人聽到快爛掉了,但放在這裡還是很準。重複 prompt 不會讓模型突然變聰明。它只是改變模型怎麼看同一份輸入。說白了,就是把同一個 cue 再丟一次,讓模型有第二次對焦機會。

這也解釋了,為什麼有些任務效果很大,有些卻幾乎沒差。模型不是在「理解更多」。它比較像在「重新對齊注意力」。如果任務本來就靠記憶,這招就容易中。

但如果任務要一步一步推理,效果通常就縮水。因為重複資訊,不等於幫模型想得更好。你只是讓它更常看到同一段字,不是幫它補腦。

哪些任務最吃這一套

研究裡,最明顯的提升集中在記憶型任務。像是 NameIndex 這種長上下文記錄,或是偏向直接回憶的測試,重複 prompt 的效果特別明顯。這種任務很像在考「有沒有看懂題目」,不是在考「會不會解題」。

模型家族也不是只有一家受益。研究提到 OpenAI、Anthropic、Google DeepMind,還有 DeepSeek 的模型,都有不同程度的改善。這代表問題比較像模型行為,而不是單一廠商的實作毛病。

如果你想抓重點,可以直接看下面這幾個:

- 記憶型任務:最容易看到提升。

- 格式抽取:常常比原版更穩。

- 短分類:有機會變準。

- 多步推理:效果常常變小。

- 長輸入場景:要小心 token 成本。

像 GPT-4o mini 在 OpenBookQA 上,也有大約 12 個百分點的提升。Claude Haiku 則是沒有明顯輸掉,還有不少平手案例。這種結果很像在說,重複 prompt 不是神技,但它確實能把一些邊角任務拉回來。

我覺得這對產品團隊很有參考價值。因為很多 AI 功能,根本不是在做深度推理。它們只是做分類、萃取、排序、路由。這些地方,重複一次 prompt,可能比你花兩週調參更快見效。

和其他模型技巧比,這招算便宜嗎

如果拿來跟重訓、微調、RAG 比,重複 prompt 幾乎是最低成本的實驗。你不用碰資料管線,不用改 server,不用重新訓練。很多時候,只要改一行 prompt,就能先看結果。

但便宜不等於沒代價。輸入 token 變多,費用就會上去。延遲也可能上升,尤其是長 prompt。你如果本來就把上下文塞到快滿,這招可能直接把成本打爆。

下面這種比較,實務上很有感:

- 重複 prompt:改動小,驗證快。

- 微調模型:成本高,流程長。

- RAG:資料管線複雜,但可控性高。

- 規則引擎:快,但維護常常很煩。

- 人工後審:準,但吞吐量低。

所以這招比較像「先試再說」的工具。不是終局方案。你如果是在做客服工單分類,重複一次 prompt 也許就夠了。你如果是在做醫療摘要或財務推理,那就別太天真,還是得回到資料品質和驗證流程。

另外,這篇研究也提醒一件事。模型表現不是單看平均值。你要看任務切得夠不夠細。很多時候,平均分數沒變,但某個子任務直接爆升。這才是產品團隊真正會在意的地方。

這件事背後的產業脈絡

現在很多 AI 團隊都卡在同一個問題。模型越來越貴,大家卻還是想要更高準確率。於是,prompt engineering 又回到檯面上。不是因為它高級,而是因為它便宜,而且馬上能試。

這也反映出一個很現實的趨勢。很多企業不會一開始就去重訓模型。它們先做 prompt 調整,再做評測,再看要不要上 RAG,最後才考慮微調。這條路很務實。也很台灣。先求能用,再求漂亮。

如果你看開源陣營,像 Llama 和 Mistral 這類模型,社群也很愛測各種 prompt 技巧。原因很簡單。大家都想知道,模型到底是「真的懂」,還是只是「對格式很敏感」。

我自己的看法是,這篇研究最大的價值,不是告訴你重複一次就會贏。它是在提醒大家,很多 AI 系統其實還很脆弱。你只要換一種表達方式,結果就會飄。這種脆弱性,才是工程上最該處理的地方。

接下來該怎麼做

如果你現在手上有一個 LLM 功能,我會建議你先挑一個低風險任務試試。像是分類、抽欄位、比對標籤。把 prompt 複製一次,和原版做 A/B test。每組至少跑 1,000 次,才比較看得出差異。

接著,你要同時看三件事。準確率、延遲、token 成本。只看準確率很危險。因為你可能只是把錯誤換成更貴的錯誤。這種事在產品會議裡很常見,大家都愛看漂亮數字,卻沒人想看帳單。

我會直接下這個判斷:如果你的任務偏回憶,重複 prompt 值得試。如果你的任務偏推理,先別急著套用。這不是玄學。是工程判斷。

下一步很簡單。先把你手上的 prompt 分成兩類。哪一些在做資料擷取,哪一些在做推理。分完之後,你就知道這招該不該放進你的工具箱。