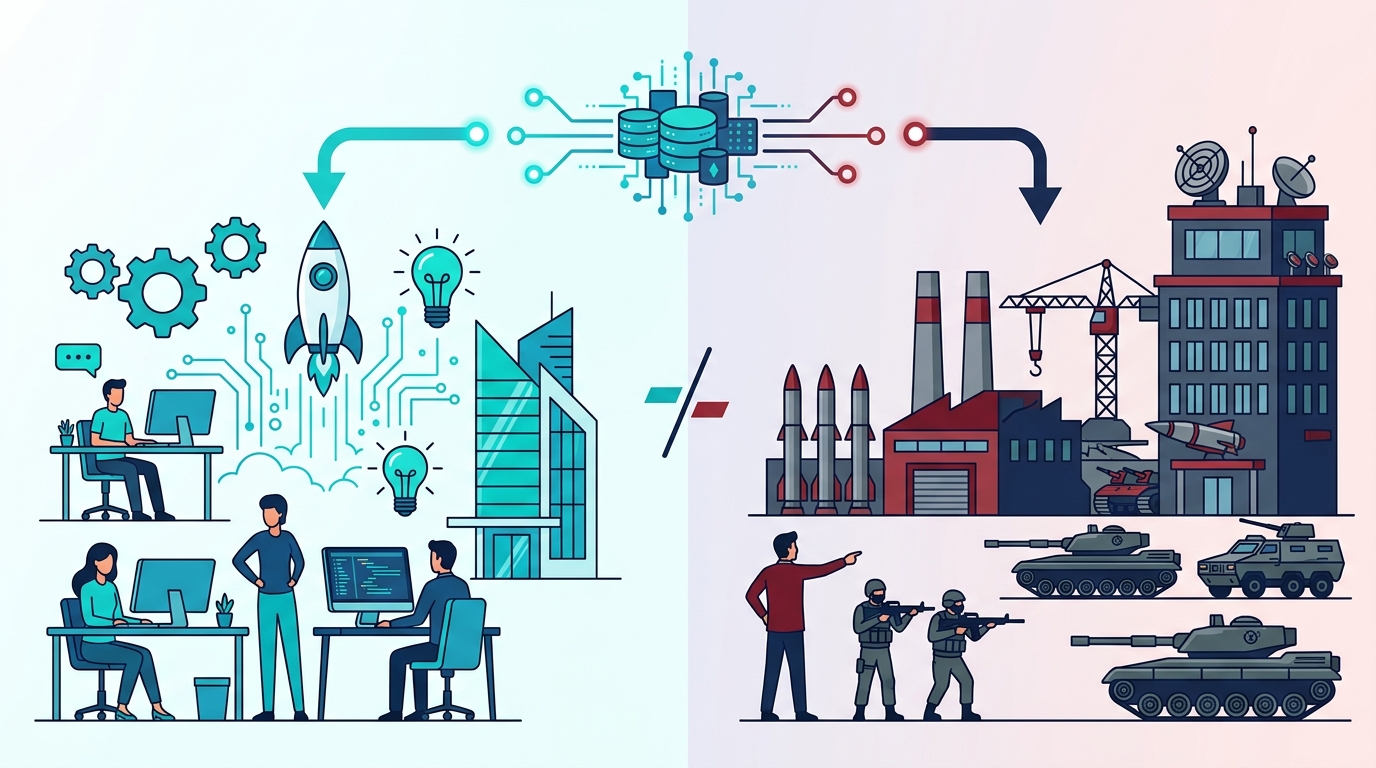

AI 戰爭公司不是新創,是軍火商

AI 目標系統在戰爭中生成數萬筆名單。真正該問的不是模型多強,而是誰在賣、誰在賺、又是誰在死。

一套系統在戰爭前幾週,產生超過 37,000 個目標。另一套每天能吐出 100 個轟炸點。這不是細節,這就是重點。當目標生成速度快到這種程度,賣軟體的公司,早就不是在做聊天 App。

講白了,它是在做殺傷鏈的一部分。這也是為什麼,軍事 AI 的討論常常歪掉。很多人還把 Palantir、Anthropic、OpenAI、Google、Amazon 當成一般 AI 供應商。這想法太天真了。它們更像軍工承包商,只是包裝比較潮。

《The Guardian》在 2026 年 3 月的報導,把這件事講得很直白。加薩的系統會把大量資料拿來排序,判斷誰像武裝份子。伊朗那邊,類似邏輯把打擊節奏壓到分鐘,甚至秒。結果就是,戰爭機器跑得比人工審查還快,卻還能說自己有人在把關。

數字比口號更誠實

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這場爭論最有意思的地方,不是 AI 有沒有參與。是它把規模放大到什麼程度。報導裡提到,一套系統在戰爭前幾週產生超過 37,000 個目標。另一套每天可產生 100 個轟炸點。還有一個審核窗口,大概只有 20 秒。這不是決策。這是流水線。

軍方和 AI 公司都愛講精準。可數字很誠實。當一個審核者只有 20 秒判斷一個目標,他根本沒時間確認資料是否過時,也沒時間查人員是否已經轉職、搬家、或被誤標。機器在分類,人類只是在按確認。

這種速度,會把風險藏起來。你看到的是「效率」,但背後其實是把判斷壓縮到極限。當資料量大到人類追不上,模型就不只是工具,而是篩選器。它決定誰進入名單,誰被排除,誰被標成可打擊。

- 戰爭前幾週產生超過 37,000 個目標

- 單日可生成 100 個潛在轟炸點

- 每個目標的人工確認約 20 秒

- 伊朗戰役首日據稱鎖定 1,000 個目標

- 加薩資料庫記錄超過 53,000 人死亡

這些數字合在一起,意思很清楚。模型不是旁邊的輔助工具。它已經在工廠線上。當這件事成立,賣模型的公司就不可能只說自己是軟體商。它已經進到軍事決策流程裡了。

我覺得這比很多人想像的更麻煩。因為軟體業習慣追求速度。軍方也愛速度。兩邊一拍即合,最後就會變成「先上線,再補規範」。但在戰爭裡,這種做法不是產品風險,是人命風險。

這些公司早就不是局外人

把它們叫 AI 公司,聽起來很乾淨。可實際上,這些公司早就在政府採購、雲端託管、模型存取、作戰規劃裡卡位。Palantir 長年賣資料基礎設施給政府和安全單位,報導也指出它的系統參與了伊朗戰役。Anthropic 曾經對五角大廈的壓力畫下倫理界線。Claude 也因此被拿來當對照。OpenAI 後來移除了軍事用途禁令。

Google 和 Amazon 則和 Project Nimbus 綁在一起。那份合約金額超過 10 億美元。它不是單純的雲端案子。它是雲端、AI、政府採購一起綁死的案例。

這裡的問題,不只是誰提供模型。還有誰提供運算資源,誰提供資料管線,誰提供 API,誰提供部署環境。當這些東西一起進到軍事系統,供應商就不再只是供應商。它在影響誰會被列入名單,誰會被追蹤,誰會被打擊。

“The world’s biggest technology companies are not neutral platforms. They are powerful actors with responsibilities.” — Tim Cook, Apple CEO

這句話原本是講平台。放到戰爭場景,意思更重。當公司的工具會影響誰被鎖定、誰被監控、誰被殺掉,中立就只是行銷詞。它不是一個可信的描述。

公司喜歡用「AI」這個詞,因為它聽起來抽象、技術、還帶點神秘感。可「defense contractor」就很刺耳。它讓人想到審查、預算、責任、法律。前者方便拿投資人錢。後者會讓國會、媒體、法院開始盯你。

AI 目標系統跟一般雙用途技術不同

沒錯,很多技術都能軍民兩用。無線電、衛星、地圖、雲端伺服器、電腦,全部都有民用和軍用場景。這是老問題了。可是 AI 目標系統不一樣。它不是只在旁邊幫忙。它直接參與誰該被打、為什麼該被打。

這差很多。因為國際人道法要求指揮官確認目標是不是合法軍事目標,還要採取可行措施保護平民。這些責任不能丟給一個黑箱模型。模型如果只吐出一個機率分數,卻說不清怎麼算出來,責任鏈就會變薄。最該變厚的地方,反而被磨平了。

很多工程師對這種情境其實不陌生。模型在 demo 裡很猛,到了 production 卻可能出事。放在消費產品,可能只是推薦失準或幻覺。放在戰爭裡,代價就是死人。這不是比喻,是真的會死人。

- 傳統雙用途工具是支援作戰

- AI 目標系統會排序人類名單

- 雲端基礎設施負責資料搬運

- LLM 會拿來摘要、分類、排序

- 軍事採購把這些變成作戰流程

報導還點出一個很刺耳的事實。當底層情報已經過時好幾年,問題不只是模型有 bug。更大的問題,是整個系統還繼續信它。這就是「human in the loop」最滑頭的地方。人如果根本沒辦法挑戰輸出,那只是掛名而已。

這點對台灣開發者其實很有感。你做過系統就知道,資料源、審核流程、回饋迴路,常常比模型本身更重要。模型只負責算。真正決定後果的,是誰把它接到哪裡。戰爭場景只是把這件事放大到最殘酷。

競品不是聊天機器人,是軍工供應鏈

如果把這些公司當一般 AI 新創,你就會看錯戰場。真正的競品,不是誰的 chatbot 比較會聊天。真正的競品,是誰能把模型接進國防採購、雲端部署、資料清洗、目標排序,最後變成可執行的軍事流程。

從這個角度看,Palantir、OpenAI、Anthropic、Google、Amazon 的位置都不一樣,但都踩進同一條線。有人賣資料平台。有人賣模型。有人賣雲端。有人賣 API。最後都可能進到武器系統裡。

這裡最值得比較的,不是品牌形象,是責任結構。當一家公司只賣工具,它還能說自己中立。當它知道工具會被拿去做目標排序,還持續供貨,那就不是單純做生意而已。它是在賣可用於殺傷的基礎設施。

- Palantir:資料整合與政府採購強項

- OpenAI:模型能力與 API 生態

- Anthropic:安全敘事較強,但仍面臨軍事用途壓力

- Google:雲端、搜尋、AI 研究與政府合作

- Amazon:AWS、算力與大型政府合約

如果拿台灣軟體業來比,差別也很明顯。一般 SaaS 出問題,最多是帳單、資安、營運卡住。軍事 AI 出問題,後果是誤殺、誤炸、誤判。這兩種產品,都叫 software。可風險等級差太多了。

所以真正該問的是:誰在簽合約,誰在驗收,誰在承擔法律責任。不要只看模型參數。要看採購文件、部署位置、資料來源、審核時間、人工覆核比例。這些才是決定生死的東西。

這其實是整個科技產業的老問題

軍事 AI 不是憑空冒出來的。它只是把科技業一貫的邏輯推到極端:先做出工具,再看誰買單。只是在一般市場,買單的是消費者或企業。到了戰爭場景,買單的人可能根本沒機會選。

這也是為什麼,很多科技公司愛講「中立平台」時,我都會皺眉。平台不會自己決定用途,但平台也不是空氣。當它掌握資料、算力、模型、部署權,還知道客戶是軍方,那它就不是旁觀者。它是供應鏈的一段。

而且這條線很容易越畫越淡。今天是資料整理。明天是目標排序。後天是自動化建議。再往後,就是把人類審核壓到只剩點頭。每一步看起來都很合理。合起來就很可怕。

接下來,該盯的是法規和採購

我覺得下一步不會是模型自己變善良。比較可能的是,政府繼續買更快的系統,廠商繼續說這只是 decision support,執行者繼續說最後決定還是人類。但如果審核時間還是 20 秒,名單還是幾萬筆,那人類其實只是儀式。

真正該做的,是把這些公司當武器供應鏈看。要查資料流向,要查採購紀錄,要查誰簽核致命決定。像 Palantir、OpenAI、Anthropic 這類公司,如果不公開系統部署在哪、吃了哪些資料、誰負責最後決策,那他們的「責任」就只是簡報上的字。

說白了,這場爭論不是 AI 夠不夠聰明。是社會要不要接受,軟體公司把殺人流程包裝成雲端服務。下次你看到有人把軍事 AI 講成創新案例,先問一句:它是產品,還是武器系統的一部分?