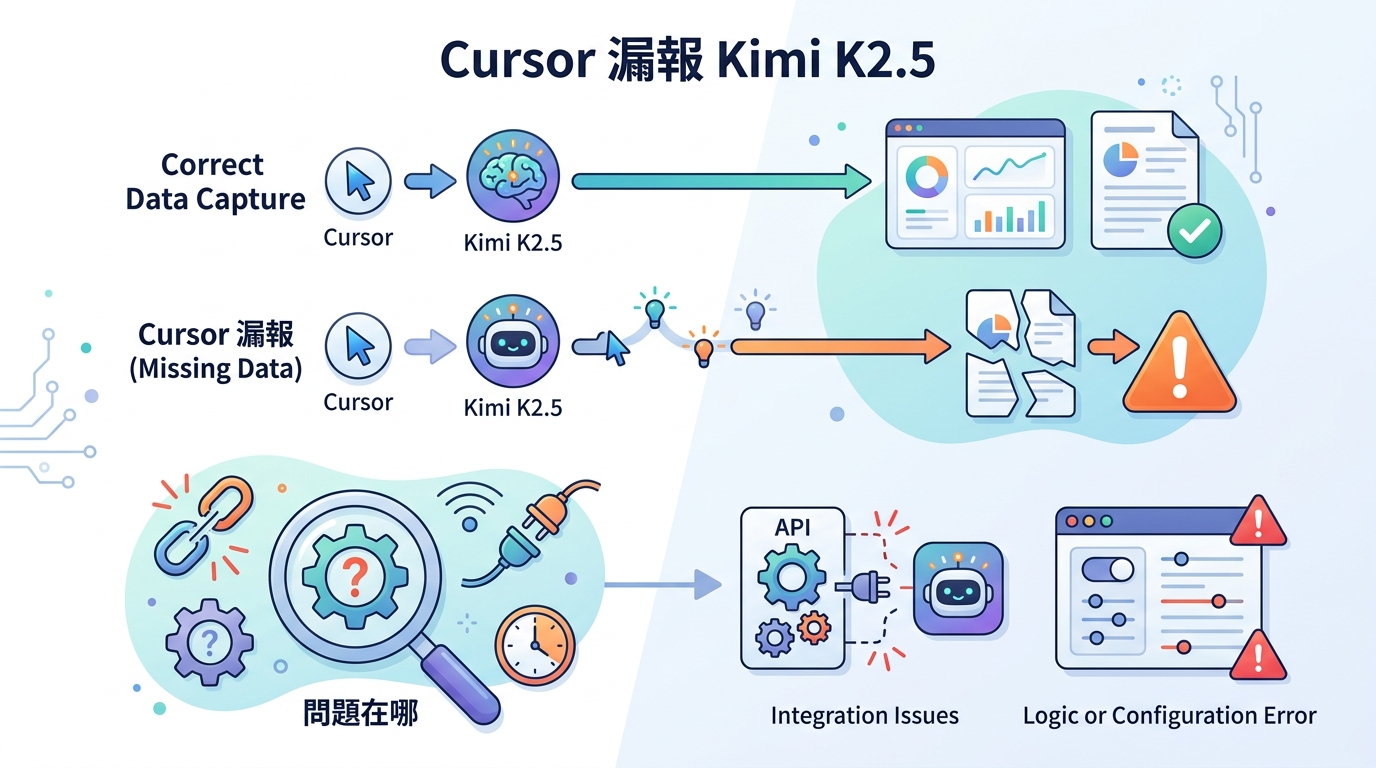

Cursor 漏報 Kimi K2.5,問題在哪

Cursor 的 Composer 2 宣稱自研,卻被發現底層其實是 Kimi K2.5。這次漏報不只影響信任,也牽涉授權、資料流向和企業採購判斷。

Cursor 先說 Composer 2 跑出 61.7% 的 Terminal-Bench 2.0。還說價格比 Claude Opus 4.6 低很多。結果有人抓 API 流量,直接看到模型 ID 指向 Moonshot AI 的 Kimi K2.5。說真的,這種落差很難裝沒事。

這件事不是少寫一行 credit 而已。它牽涉授權、供應商信任,還有一個很現實的問題:你把程式碼丟進 AI 助理時,底層到底是哪個模型在看?如果答案不清楚,企業法務和資安團隊就會開始皺眉頭。

Cursor 說了什麼,API 又揭露了什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

Cursor 在 3 月 19 日推出 Composer 2。官方文案寫得很像自家練出來的模型。它提到 continued pretraining、reinforcement learning,還有 frontier-level coding intelligence。這些詞都沒錯,數字也有兜住。

但問題出在出身。開發者 Fynn 看 Cursor 的 API 流量後,抓到一串很像線索的模型 ID:kimi-k2p5-rl-0317-s515-fast。這個命名很直白,幾乎就是把底牌攤開。它指向 Kimi K2.5、RL 微調、3 月 17 日訓練點,以及 fast 服務配置。

後來 Cursor 也承認,當初應該先講清楚 Kimi base model。Aman Sanger 直接說這是漏掉了。講白了,這就把故事從「我們自己做的」改成「我們在開放模型上再訓練」。兩者差很多,尤其在商業溝通上。

- 發表時間:2026 年 3 月 19 日

- Terminal-Bench 2.0:61.7%

- 價格主張:大約是 Claude Opus 4.6 的十分之一

- 模型 ID:

accounts/anysphere/models/kimi-k2p5-rl-0317-s515-fast - 公開討論:相關貼文衝到百萬級瀏覽

授權條款為什麼會卡住

Kimi K2.5 用的是改過的 MIT 授權。這種授權平常很寬鬆,商用也通常沒問題。可是它有一條很硬的條件。月活超過 1 億,或月營收超過 2,000 萬美元,產品介面就得明顯標示「Kimi K2.5」。

Cursor 的年經常性收入傳聞已超過 20 億美元。換算下來,大約每月 1.67 億美元。這個數字遠遠超過門檻。也就是說,這不是「要不要客氣一下」的層級,而是直接碰到授權義務。

後續還有一段小插曲。Moonshot AI 的員工先在網路上指出違規,之後又刪文。Moonshot 官方帳號後來說,這是透過 Fireworks AI 的授權商業合作。這可能解掉一部分法律問題,但不代表發表時沒漏報。

“It was a miss to not mention the Kimi base in our blog from the start.” — Aman Sanger, Cursor co-founder

這句話很直接,也很有用。因為它承認的不是技術錯誤,而是揭露不完整。對工程團隊來說,這種差別很重要。你可以接受供應商用別人的基座,但你不能接受供應商把這件事講得像沒發生過。

為什麼開發團隊應該在意

AI 產品現在都是疊起來的。行銷頁面看到的模型,只是最上層。下面可能還有開放權重基座、供應商微調、另一家推理服務商,最後才是你看到的 UI。每一層都有自己的 license 和資料路徑。

這對資安、採購、合規都很重要。你如果有 GDPR、HIPAA,或資料落地要求,就不能只聽一句「我們有合規」。你要知道 prompt 送去哪裡、誰在處理、log 存在哪裡。這些都不是細節,是基本盤。

信任也是同一件事。若供應商把 base model、訓練方式和推理位置講得很清楚,你至少能查證。若它把產品包裝成「自研」,卻不提底層模型,那你拿到的其實是行銷話術,不是技術事實。

- 先問 base model 是哪個

- 再問推理服務商是誰

- 再問資料和 log 存哪裡

- 最後問授權要求什麼標示

Kimi K2.5 跟西方選項怎麼比

Kimi K2.5 不是小玩具。它是 1 兆參數的 mixture-of-experts 模型,32 億 active parameters,context window 也有 256,000 tokens。這種規格很適合長程式碼編輯、整個 repo 上下文,還有 agent 型工作流。

西方開源陣營這陣子沒有那麼整齊。Meta Llama 4 Scout 和 Maverick 有出,但市場反應沒有很多人預期的強。Llama 4 Behemoth 也還沒公開發布日期。對想找強力開放基座的團隊來說,空窗期還在。

這也說明一件事。AI 模型市場早就不是單純的地緣站隊。Cursor 是美國公司,估值 500 億美元,結果底層用了北京公司的模型。這不是意外,而是性能導向下的正常選擇。講白了,誰好用就先上誰。

- Kimi K2.5:1 兆參數,32 億 active,256k context

- Llama 4 Behemoth:延後,沒有公開日期

- Cursor Composer 2:Kimi K2.5 基座再加 RL 訓練

- Cursor 自述:大約 25% 算力來自 base model,75% 來自自家訓練

這件事放在產業脈絡裡看

現在很多 AI 工具都在比誰更像「原生產品」。但實際上,模型供應鏈越來越像雲端服務堆疊。前端是產品,後端是 API,中間還有模型商、推理商、快取、評測和監控。你看到的品牌,不一定就是訓練那個品牌。

這種模式在 coding assistant 特別常見。因為工程師最在意的是延遲、上下文長度、錯誤率和價格。只要模型夠強,很多團隊不會先問它是不是自研。可是一旦進到企業採購,問題就會回來。法務和資安不看 benchmark,他們看合同和資料流。

所以這次事件真正的價值,是把「模型來源」這件事拉到台面上。以前大家只看分數。現在你還得看 provenance。這不是潔癖,是採購基本功。

開發者現在該怎麼做

如果你的團隊有在用 AI 寫 code,就把模型來源當成 dependency metadata。不要只看介面好不好用。先問清楚 base model、推理商、授權條件和資料保存方式。這些東西最好寫進採購清單。

供應商也該學軟體圈老方法。package 要列版本,container 要列 base image,AI 產品也該列模型卡和訓練說明。這不是裝模作樣。這是讓客戶知道自己到底買了什麼。

我自己的看法很簡單。下一次選 AI coding tool,先別看宣傳圖。先問一句:底層模型是誰?如果答案模糊,先當黑盒處理。等它把來源講清楚,再談要不要把 production code 交出去。

如果你想把這件事放進團隊流程,最實際的做法是:把模型名稱、授權條款、資料保留政策,全部寫進採購審查表。這樣至少下次出事時,不會只能靠社群抓包。