代理式 LLM 偏誤風險浮現

這篇論文把焦點放在代理式 AI 的偏誤風險,特別是已用在購物、影音與導覽等消費場景的 transformer-based 系統。

這篇在講 transformer-based 代理式 AI 的偏誤風險,重點是它已經進入購物、影音和導覽等消費場景。

論文 LLM Biases in Agentic AI Systems 盯上的不是抽象的學術問題,而是已經開始落地的產品行為。作者把焦點放在 transformer-based 的 agentic AI,這類系統被用在 major platforms 上,幫使用者買東西、看影片、找內容、做導覽。這代表模型不只是回一句話而已,它會參與決策,甚至直接影響使用者下一步看到什麼、選什麼、走哪條路。

這也是這篇題目最重要的地方。一般談 LLM bias,很多人會先想到輸出文字是否帶偏見。但在 agentic AI 裡,偏誤不只會出現在語氣或回答內容,還可能進一步滲進推薦、排序、動作選擇和流程引導。當模型開始替人做事,偏誤就不再只是模型品質問題,而是產品行為問題。

這篇在解哪個痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這篇摘要沒有把痛點寫成一套完整研究問題,但方向很清楚:作者在提醒大家,代理式 AI 的偏誤會直接進入消費者體驗。也就是說,當模型被放進購物、影音或導覽流程時,它的偏好不再只是實驗室裡的輸出差異,而是會變成實際的產品結果。

對開發者來說,這個差別很大。聊天機器人如果偶爾講得不平均,通常還停留在對話層。可是一旦同一個模型變成 agent,它可能會影響內容分發、商品曝光、使用路徑,甚至讓某些選項被系統性地放大或忽略。偏誤因此會被產品機制放大,而不是只停留在單次回應。

摘要裡也明講了這些系統是 transformer-based。這表示作者討論的不是某種邊緣型架構,而是目前最主流、最容易被整合進產品流程的 LLM 類型。換句話說,這不是遠方的研究議題,而是已經在平台上運作的工程風險。

不過,原始摘要沒有交代偏誤的具體類型。它沒有說是人口統計偏誤、偏好偏誤、安全偏誤,還是其他分類。也沒有說研究是針對哪個平台、哪個語言、哪個地區。就目前這份 raw 資料來看,能確認的是問題場景,不是偏誤細節。

方法到底怎麼運作

這部分摘要幾乎沒有展開,所以不能硬猜作者用了什麼資料集、訓練流程或評估框架。原始資料沒有提供方法段落,也沒有提到任何特定的干預手法、對照組或實驗設計。換句話說,這篇摘要沒有公開完整 benchmark 細節。

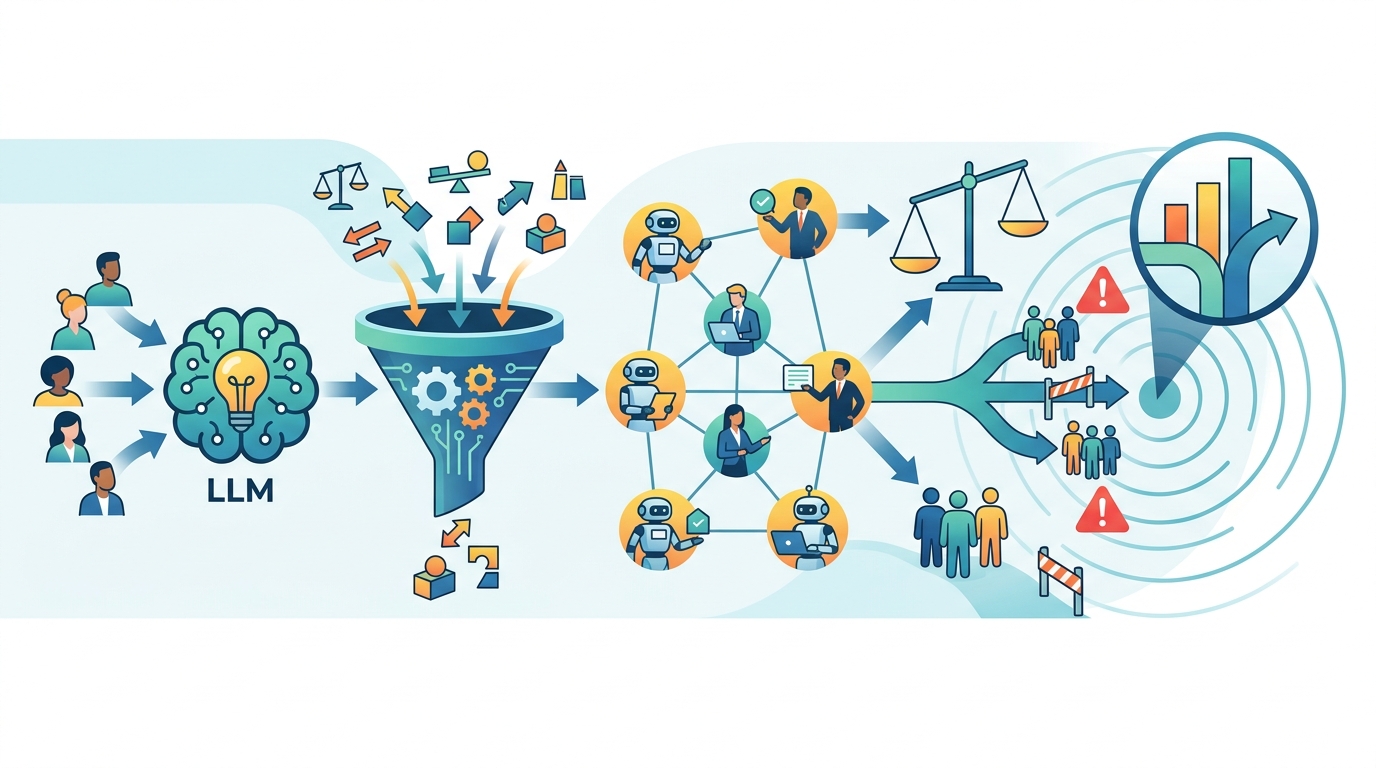

但從題目和摘要的語氣,可以看出作者關注的是「代理式行為中的偏誤」,而不是單純的文字生成偏誤。這代表如果真的有方法設計,重點很可能會落在端到端流程:模型如何接收任務、如何做決策、如何選擇動作、最後怎麼把結果呈現給使用者。這是 agentic 系統和一般 chatbot 最大的差異。

對工程實作來說,這種問題通常不能只看模型輸出一句話就結束。你得把 prompt、推理、工具使用、動作選擇、以及最終 UI 呈現放進同一個觀察範圍。雖然摘要沒有明講這套流程,但它所指向的問題型態,明顯比單輪問答更接近整個產品堆疊。

所以如果你是開發者,這篇最值得記住的不是某個特定算法,而是研究對象本身已經升級了:偏誤不只存在於模型字串輸出,而是可能存在於 agent 的整體行為。這會影響你怎麼設計測試,也會影響你怎麼定義「模型有沒有偏」。

論文實際證明了什麼

就 raw abstract 來看,這篇沒有公開具體 benchmark 數字,也沒有列出實驗結果表。沒有看到準確率、偏誤分數、比較組、或改善幅度,因此不能替它補上任何量化結論。

這也表示,目前能安全下的結論只有一個:作者把偏誤問題放到真實部署中的 agentic AI 場景來看,並且強調這些系統已經在 major platforms 上使用。這個論點本身就很重要,因為它把討論從「模型可能有偏」推進到「已上線的產品可能把偏誤擴散到大量使用者」。

但如果你想知道這篇是否證明了某種 mitigation 有效、某種模型更公平、或某種流程能降低偏誤,摘要沒有提供足夠資訊。也就是說,這份 raw 資料能支持的是問題意識,不足以支持效果判斷。

這種情況在 arXiv 摘要其實很常見。標題很直接,摘要也把應用場景講出來了,但真正的實驗設計、數據來源和結論,還是要看全文才知道。對新聞編輯來說,這時候最重要的原則就是不要補不存在的數字。

對開發者有什麼影響

這篇對開發者的提醒很實際:不要把 bias testing 只當成模型層的檢查。當 LLM 被包成 agent,偏誤可能出現在整個產品路徑裡,包括內容推薦、商品排序、導覽選擇、以及使用者被引導去看的下一個選項。

這意味著測試策略也要跟著變。你不能只問「模型這句回答有沒有偏」,還要問「這個 agent 在不同情境下會不會做出不同選擇」、「它是否偏向某類內容或動作」、「它在真實任務裡會不會把偏誤放大成可見的產品結果」。

對消費型產品尤其如此,因為這類系統常常直接連到使用者的決策路徑。當 agent 幫人找商品、看影片、或規劃導覽,偏誤可能不是一次性的錯誤,而是持續影響曝光和選擇的結構性問題。這也是為什麼這篇雖然摘要很短,但議題本身很重。

- 不要只測聊天輸出,要測 agent 的整體行為。

- 把推薦、排序、動作選擇一起納入偏誤檢查。

- 留意 orchestration layer 是否放大了 base model 的偏差。

- 在接近真實產品的購物、影音、導覽流程裡做驗證。

限制與未解問題

這篇最大的限制,不是研究方向,而是來源資訊太少。摘要沒有交代方法、沒有交代資料集、沒有交代評估指標,也沒有交代任何 benchmark 數字。對外部讀者來說,這代表目前無法判斷它是在診斷問題、提出解法,還是兩者都有。

未解問題也很多。它研究的是哪一種 bias?是針對特定平台流程,還是更泛化的 agentic 系統?它關注的是模型本身,還是整個產品編排層?它有沒有比較不同任務情境下的偏誤差異?這些都沒有出現在 raw abstract 裡。

但即使資訊有限,這篇仍然有價值,因為它對準的是一個正在擴大的工程面向:transformer-based LLM 已經不只在聊天,還在做事。當 AI 開始代替使用者執行動作,偏誤就會從輸出品質問題,變成系統設計問題。這是開發團隊不能忽視的地方。

所以如果要用一句話總結這篇的實際意義,就是:它把 LLM bias 從「文字回應是否公平」推進到「代理式產品行為是否公平」。摘要沒有給出完整實驗證據,但它已經很明確地指出,這類 bias 應該被當成上線風險來看,而不是只留在研究室裡討論。

對台灣開發者來說,這種提醒很重要。因為只要你的產品開始用 LLM 做推薦、導覽或自動化決策,你面對的就不只是模型準不準,而是它會不會在無形中改變使用者看到的世界。