用物理模擬器訓練 LLM 推理

研究者把物理模擬器變成強化學習資料來源,訓練 LLM 學會物理推理,並在 IPhO 題目上帶來 zero-shot 提升。

大型語言模型的推理能力一直在進步,但訓練資料很大程度還是靠網路上的問答對。這套做法在數學題特別吃香,因為結構化資料多;可是一碰到物理、化學這類科學推理,情況就卡住了。可用的高品質問答資料少,規模也不夠大,模型很難靠同一套網路資料一路往上堆。

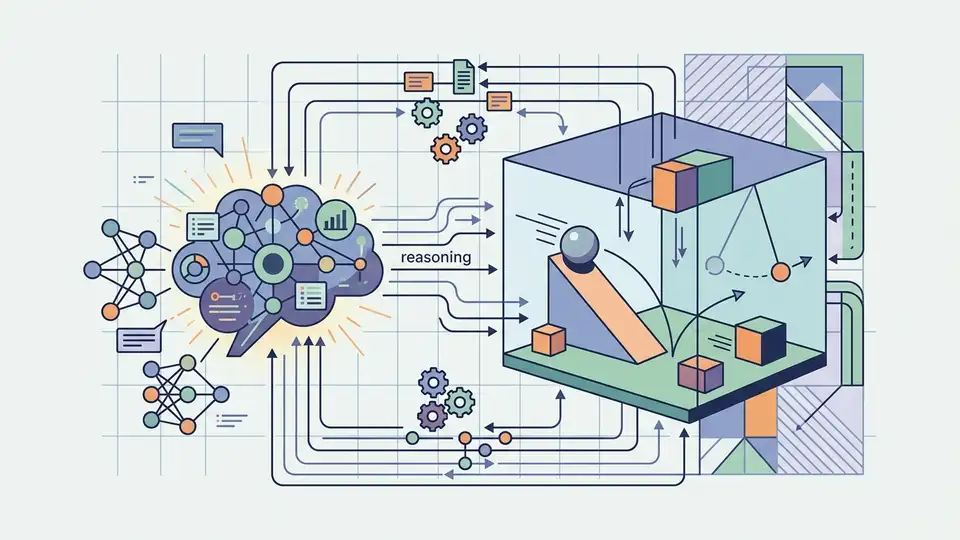

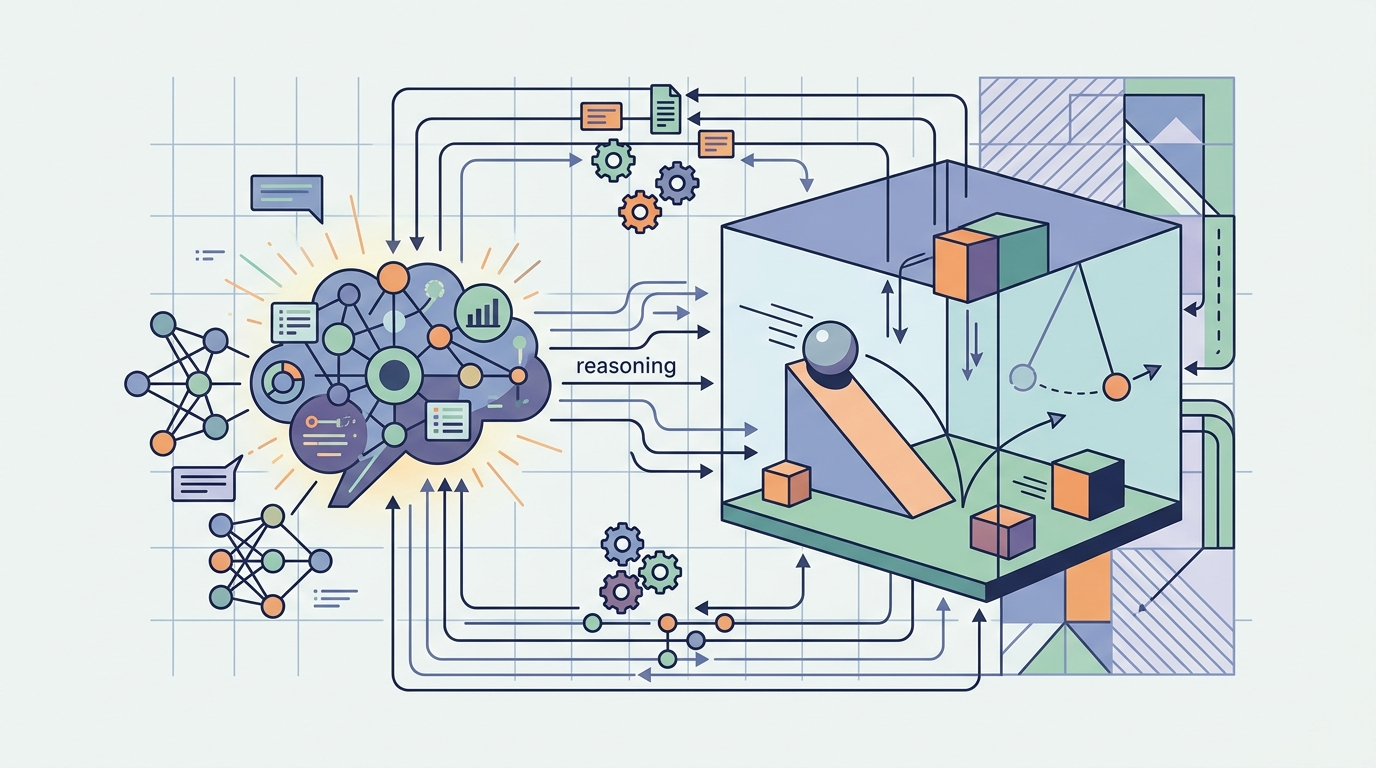

這篇論文 Solving Physics Olympiad via Reinforcement Learning on Physics Simulators 提出一個很直接的想法:既然真實世界的標註問答不夠,那就把物理模擬器變成資料工廠。研究者不是去找更多網路答案,而是從模擬環境裡產生合成互動,再拿來訓練 LLM 做物理推理。

這篇論文想解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這篇研究瞄準的是一個很現實的資料瓶頸。現在很多推理模型的進步,和資料量密切相關。問題是,網路上不是每個領域都有足夠的問答對。物理就是典型例子:你可以找到很多介紹概念的文章,但要拿來訓練模型解奧林匹亞等級題目,資料密度往往不夠。

對研究者來說,這代表一個尷尬的落差。模型架構可以繼續疊,但如果訓練訊號來源只剩網路 QA,科學領域就會一直被卡住。這篇論文的核心不是去改善模擬器本身,而是把模擬器升級成一條可擴充的訓練管線。換句話說,重點在資料生成,不在物理引擎的娛樂效果。

這個方向的意義很明確:如果某個領域的規則可以被模擬,就有機會不用等人手一題一題寫答案,也能做出可訓練的推理資料。這對開發者很重要,因為它把「資料從哪來」這件事,從網路搜尋題目,改成設計環境。

方法到底怎麼運作

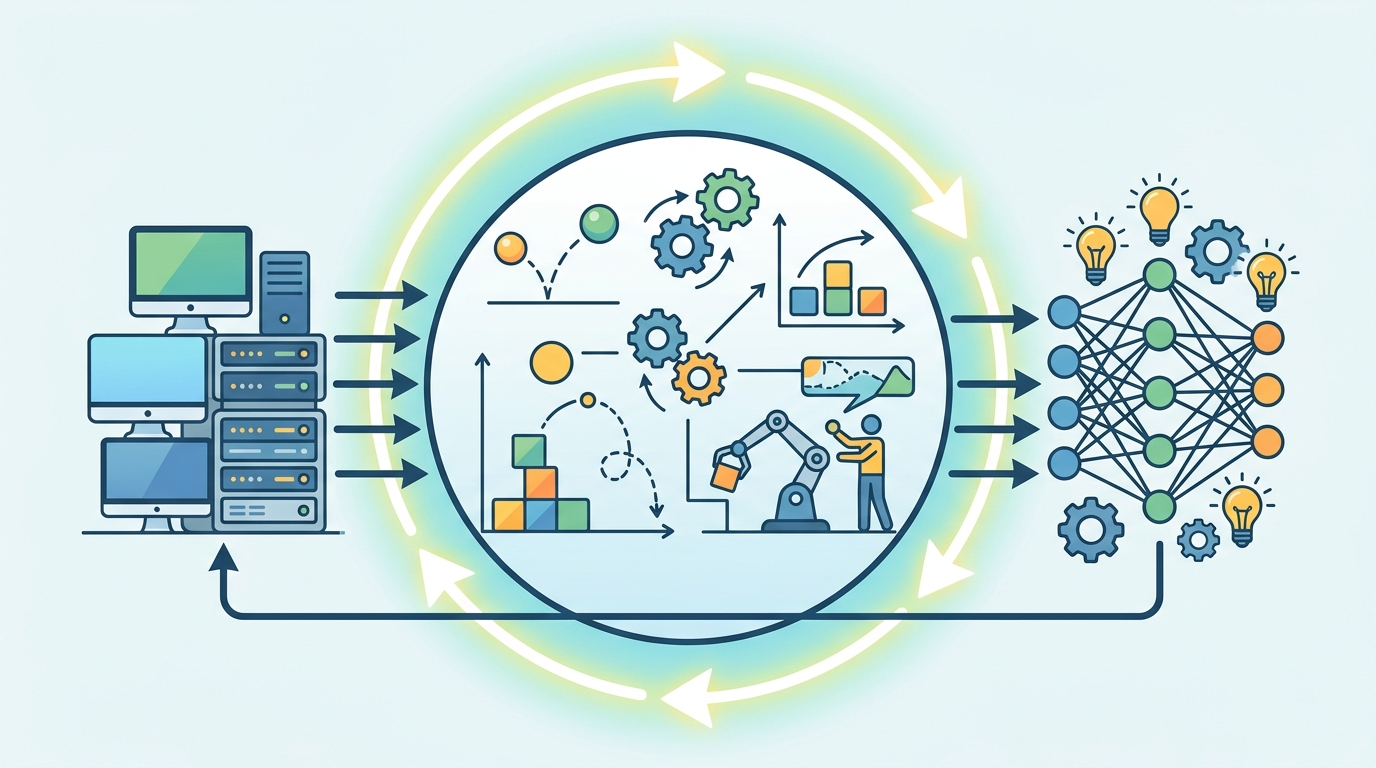

論文的方法可以用一句話講完:先在物理模擬器裡隨機生成場景,再把這些場景轉成合成問答,最後用強化學習訓練 LLM。模型學到的不是人類手寫解答,而是模擬環境裡的物理互動模式。

這裡的關鍵在於資料來源。傳統做法常常依賴人工整理的題解、教材內容,或從網路上爬來的問答。這篇研究則把 supervision 建在模擬互動上。只要模擬器能持續產生新的場景,訓練分布就能持續擴大,不必被固定資料集綁死。

作者把這件事描述成一種 sim-to-real transfer,但對象不是機器人控制,而是語言模型的推理能力。模型先在合成世界裡學,之後再拿去測真實世界的物理題。這個概念在機器人領域不陌生,但搬到 LLM 上,重點就變成:模型是否真的能從模擬資料中抽出可泛化的推理規則。

如果把流程拆開看,可以整理成這樣:

- 在物理模擬器中隨機生成場景

- 把模擬互動轉成合成問答資料

- 用強化學習訓練 LLM

- 測試模型能不能零樣本泛化到真實物理題

這套流程聽起來簡單,但它背後其實是在改寫推理模型的資料供應鏈。不是等人類標註者慢慢產出答案,而是讓環境本身變成資料生產器。

論文實際證明了什麼

這篇摘要裡最重要的結果,是訓練只靠合成模擬資料,就能讓模型在 IPhO,也就是國際物理奧林匹亞 benchmark 上提升 5 到 10 個百分點,而且是跨不同模型大小都看得到的改善。作者把這描述為 zero-shot sim-to-real transfer,意思是模型沒有先看過該 benchmark 的真實問答資料,就直接拿去測試。

對研究新聞來說,這個數字很值得注意。它不是只在玩具題目上多答對幾題,也不是單純做出一個更會背公式的模型。它是在一個難度很高的物理推理 benchmark 上,看到可量化的提升。這代表合成物理資料不只是「看起來合理」,而是真的能推動模型表現往上走。

但這裡也要講清楚,摘要沒有公開完整 benchmark 細節。也就是說,我們看不到完整表格、具體模型名稱、訓練算力、資料量,或更細的 ablation 分析。光從摘要,還無法判斷提升主要來自哪一段流程,也無法確定這個效果在其他物理任務上是否同樣穩定。

即便如此,論文至少證明了一件事:物理模擬器可以不只是測試工具,也可以是訓練資料來源。這件事本身就很有分量,因為它把「合成資料能不能用」從猜測,往前推到實證。

對開發者有什麼影響

如果你在做 AI 系統,這篇論文給了一個很實際的方向:當真實標註資料稀缺時,可以考慮先建一個可控的合成環境。尤其是在物理、機器人、控制,或其他規則明確的科學領域,模擬器可能比網路更適合當訓練資料來源。

對 LLM 開發者來說,這不只是物理題的故事,而是資料策略的改變。過去大家常把 web QA 當成推理模型的主要燃料;這篇研究則暗示,推理能力未必只能從網路問答裡長出來。只要能生成有效互動,就能做出另一種 supervision,而且還可能更貼近特定領域的規則。

這也會影響資料設計的思路。以前的問題是「還能不能多找一些標註例子?」;現在可能要改成「能不能把產生例子的環境先做出來?」。對想把模型用在科學推理的團隊來說,這是一個很值得重看的方向。

限制和還沒回答的問題

這篇研究的方向有說服力,但摘要也留下不少空白。首先,我們不知道模擬器的具體設定,也不知道合成問答是怎麼從互動中生成的。強化學習的目標函數、資料分布、以及場景隨機化方式,摘要都沒有交代。

其次,sim-to-real 本來就有一個老問題:模擬世界再好,還是近似世界。如果模擬場景太乾淨、太單一,模型可能學到的是某種捷徑,而不是通用的物理理解。這篇論文雖然在 IPhO 上看到 zero-shot 提升,但這不等於模型已經掌握更廣義的物理直覺。

另外,摘要也沒有回答這個方法能不能往更模糊的領域延伸。物理之所以適合,是因為規則比較清楚,模擬器比較容易定義正確互動。到了 ground truth 沒那麼明確的領域,這套方法未必一樣好用。

所以,這篇論文最值得記住的,不是它已經把所有問題解完,而是它把一個新方向講得很清楚:當網路上的乾淨答案不夠用時,合成世界可能就是下一個訓練資料來源。對正在思考 LLM 下一階段資料策略的人來說,這是一個很值得放進工具箱的想法。

總結來說,這篇研究不是在做更華麗的物理解題器,而是在證明一件更底層的事:模擬器可以變成推理模型的資料引擎。這個觀點如果成立,影響的就不只是物理,而是整個依賴結構化規則的 AI 訓練方式。