別把 Prompt Engineering 想太神

Prompt engineering 不是玄學。AWS 直接把方法、用途和取捨講清楚,重點是把模糊需求變成可用輸出,讓 LLM 更穩、更好控。

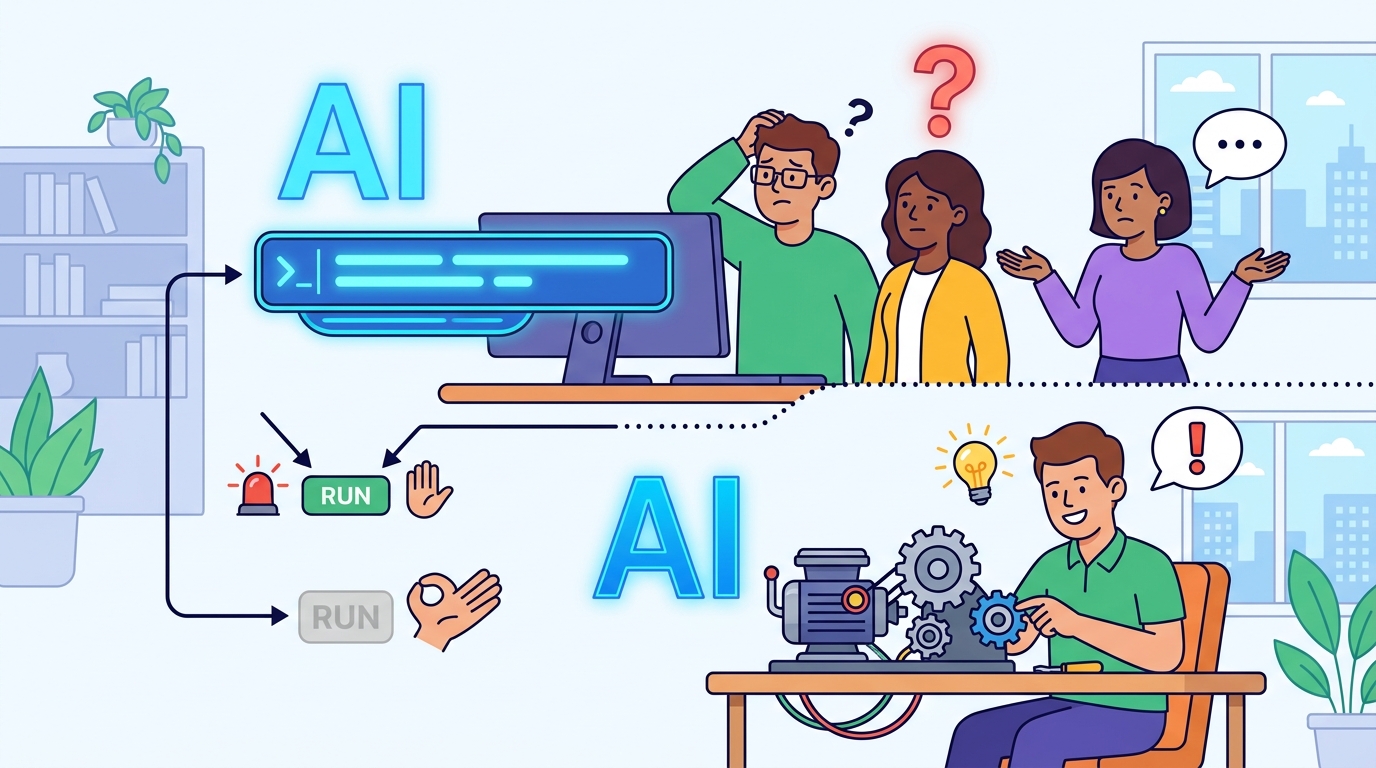

生成式 AI 很會接話。可是一個字丟給它,常常只會拿到一段空話。AWS 說,prompt engineering 就是用更清楚的指令,去導引模型吐出更有用的答案。

講白了,這是把模糊需求,改成可用輸出。對開發者來說,這不是玄學。這是把 LLM 從「會講」變成「能用」的基本功。

Prompt engineering 到底是什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

AWS 對 prompt engineering 的定義很直接。它就是用輸入內容,引導生成式 AI 產生想要的結果。

翻成台灣話,就是你怎麼跟模型講話,模型就怎麼回你。你給它角色、任務、限制、格式,它通常就比較不會亂飄。你只丟一句「幫我整理」,它很可能回你一坨看似有內容的文字。

這件事的本質,不是文筆好不好。重點是結構。你要讓模型知道,自己是誰,要做什麼,要給誰看,最後要長什麼樣子。

實務上,好的 prompt 常會包含這幾項:

- 角色設定,例如客服、工程師、分析師

- 任務範圍,例如摘要、翻譯、分類、寫 code

- 限制條件,例如字數、語氣、禁止內容

- 輸出格式,例如表格、條列、JSON

這些東西看起來很瑣碎。可是對 LLM 來說,差很多。模型是根據 token 機率往下接,不是人類那種先理解再思考。

所以同一個模型,換個 prompt,表現就可能差一截。這也是為什麼 prompt engineering 會變成 AI 應用裡很實際的一環。

為什麼 prompt 會差這麼多

問題不在模型不會答。問題在它太容易答歪。你給的上下文越少,它就越愛自己補腦。這在 demo 階段還好,真的上線就很煩。

像 AWS 舉的例子很實際。使用者問「哪裡可以買襯衫」,這句話本身太空。是要網購,還是找附近門市?是男裝、女裝,還是童裝?如果 prompt 沒把條件寫進去,模型只能猜。

我覺得這也是很多 AI 產品卡住的地方。團隊以為是模型不夠強,其實是輸入太爛。你要模型穩,先把 prompt 寫穩。

“Prompt engineering is the process where you guide generative artificial intelligence solutions to generate desired outputs.” — AWS

這句話很平,但很準。prompt 不是包裝紙。它就是控制面板。你想要什麼答案,最好先把規則講清楚。

對產品團隊來說,這件事還有一個現實好處。prompt 可以重複使用。你不用每次都從零開始寫。把常見場景做成模板,客服、搜尋、摘要、分類都能共用一套骨架。

- 降低使用者重試次數

- 讓輸出格式更穩定

- 減少不相關回答

- 讓團隊更好維護 AI 功能

但別把它想成一次寫好就結束。prompt engineering 本來就要反覆測。改一個字,結果可能差很多。這很像除錯,只是你除的是語意,不是 syntax。

實際產品裡,prompt 怎麼用

AWS 把 prompt engineering 的用途分成幾類。像是專業知識、批判思考、創意發想。這些分類看起來很學院派,但其實對應到很多真實產品。

例如醫療場景,模型可以根據症狀摘要,幫忙整理可能方向。客服場景,prompt 可以要求模型只根據政策回答,不准自由發揮。內容工具則可以把語氣鎖成正式、口語,或偏技術寫法。

這就是 prompt engineering 好玩的地方。它不是只會「聊天」。它可以把同一個模型,調成不同工作模式。差別就在 prompt 寫得夠不夠準。

下面幾個對比,最容易看出差異:

- 「摘要這份文件」很容易變成泛泛而談;加上重點、風險、下一步,就會實用很多

- 「哪裡買襯衫」太空;加上地點、價格帶、通路,就能變成可執行建議

- 數學題如果要求先拆步驟,通常比直接要答案更穩

- 創意 brief 如果寫明受眾、情緒、格式,產出通常更接近需求

這裡要講白一點。prompt engineering 不會讓模型變聰明。它只是讓模型更容易被控制。這個差別很重要,因為你在分配工程時間時,就知道該修模型,還是修輸入。

AWS 提到的幾種 prompting 方法

AWS 列了幾種常見方法。像 chain-of-thought、tree-of-thought、maieutic、complexity-based、generated knowledge、least-to-most、self-refine。名字很長,概念其實很直白。

Amazon Bedrock 是 AWS 做生成式 AI 應用的服務。這些 prompt 技巧放進去,就很像給 foundation model 裝上不同操作模式。你不是只跟模型聊天,你是在設計它怎麼想。

幾個常見方法,可以這樣理解:

- chain-of-thought:把問題拆成小步驟

- tree-of-thought:同時試幾條路,再選一條

- generated knowledge:先產出相關知識,再拿去回答

- least-to-most:先解簡單子題,再往上疊

這些方法的目的,不是炫技。是減少模型亂猜。尤其在多步推理、分析、規則很多的任務上,效果通常比較穩。

如果你在做產品,這種穩定性很重要。因為使用者不在乎你的 prompt 多漂亮。他只在乎答案對不對,格式有沒有跑掉,能不能直接拿去用。

這裡也可以順手比一下不同 AI 產品的思路。像 ChatGPT 偏通用對話,Claude 很強調長文與上下文,Gemini 則和 Google 生態整合很深。底層都是模型,但 prompt 寫法會直接影響體驗。

這件事為什麼現在更重要

幾年前,大家還在拼模型參數。現在很多團隊發現,光有大模型不夠。真正上線後,常常是 prompt、資料、流程、權限一起決定結果。

這也解釋了為什麼 prompt engineering 會從「技巧」變成「工程」。你要版本控管,要測試,要比對輸出。最好還要能回溯,知道哪版 prompt 讓客服回答開始亂飄。

產業脈絡也很明顯。企業導入 AI 後,第一個痛點通常不是模型太弱,而是輸出不穩。今天回得像樣,明天又開始胡扯。這時候,調 prompt 往往比換模型更快。

如果你要做更完整的 AI 系統,通常還會搭配 function calling、RAG、權限控管,還有輸出驗證。prompt 只是第一層,但它常常是最先出問題的一層。

所以我會說,prompt engineering 不是浪漫的創作。它比較像工程現場的校正工作。很土,但很有效。

結語:先把 prompt 當成程式碼

如果你現在有在做 AI 產品,我會建議一件事:把 prompt 當成程式碼管理。版本要留。測試要做。常見場景要模板化。

下一步也很明確。不要只看模型會不會答。要看它在 100 次測試裡,能不能穩定輸出同一種格式。能不能少講廢話。能不能守住限制條件。

說真的,這才是 prompt engineering 的價值。不是把 AI 變神。是讓它少出包,讓你少收爛尾。

如果你的團隊還在手動複製貼上 prompt,現在就該整理了。先從 3 個高頻場景開始。把角色、任務、格式寫死。再看結果有沒有真的穩下來。