TurboQuant、EDEN 與引用爭議

TurboQuant 主打 KV-cache 6x 壓縮,卻被指和 DRIVE、EDEN 同源,還有 scale 選擇與 benchmark 公平性爭議。

TurboQuant 一開始很吸睛。它主打 KV-cache 6x 壓縮。這種數字很容易讓人停下來看。因為在 LLM 推論裡,記憶體和延遲都很貴。

但話題很快歪掉。爭議不在壓縮比,而在引用。EDEN 團隊直接說,TurboQuant 很像舊方法的縮小版。這種說法很刺耳,但也很常見。

講白了,這不是只有學術圈在吵。KV-cache 壓縮會影響推論成本。也會影響 token throughput。對跑服務的團隊來說,差一點點就可能差很多。

TurboQuant 到底在做什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

先講技術本體。TurboQuant 是拿來壓縮 transformer 推論時的 KV-cache。KV-cache 會存過去 token 的 key 和 value。這樣模型不用每次重算前文。

問題是,context 越長,cache 就越大。這會吃掉更多顯存。也會讓推論成本往上跑。於是大家開始玩量化,想把記憶體壓下來。

TurboQuant 的爭議點,在於它看起來不像全新量化器。批評者說,它比較像舊方法的組合。只是寫法更簡單,說法更好懂。

這裡的重點很現實。方法可以舊,但應用可以新。這沒問題。問題是,你不能把舊骨架包成新發明。尤其在 AI 論文裡,這種包裝太常見了。

更麻煩的是,這種方法很難只看標題判斷。壓縮比看起來漂亮,不代表細節也漂亮。scale 怎麼設。bit 怎麼分。誤差怎麼累積。這些都會影響最後結果。

所以,TurboQuant 真正讓人皺眉的,不是它有沒有用。是它到底新在哪裡。這個問題沒講清楚,後面所有數字都會變得很尷尬。

為什麼 EDEN 團隊會不爽

這場爭議的核心,是引用順序。DRIVE 早在 2021 年就做了 post-rotation 的 distribution-aware quantization。後來的 EDEN 又把這套想法往前推。

EDEN 團隊的說法很直接。他們認為 TurboQuant 只是更受限的版本。scale 選擇也比較弱。殘差量化的處理方式,還可能讓誤差更大。

這種爭議在 ML 圈不稀奇。但它每次都會讓人火大。因為大家都知道,citation 不是裝飾品。它決定誰被看見。

“We were the first to introduce post-rotation distribution-aware quantization in 2021.”

這句話出自 HN 討論。意思很清楚。先做的人,想要被正確記住。這很合理。你辛苦寫出來的公式,不該被後來的包裝吃掉。

我覺得這裡最刺的是,很多人會把「能跑」和「原創」混在一起。其實兩者差很多。能跑是工程。原創是論文脈絡。

如果 TurboQuant 真的只是 EDEN 的變體,那它就應該老實寫成變體。這不是小氣。這是基本職業道德。

而且這件事不只關乎名聲。還關乎後面誰會接著做。引用錯了,研究路線也會跟著歪。

數字怎麼看才不會被帶風向

爭議裡最常被拿來講的,是 6x 壓縮。這個數字很大聲。可是大聲不等於公平。你要先看測試條件,再看比較對象。

在 HN 討論裡,有人指出 TurboQuant 的 benchmark 不太對等。像是某些比較用了單核心 CPU。TurboQuant 那邊卻跑在 A100 GPU 上。這種比法很容易把結果弄歪。

另外,社群也提到 KIVI、HIGGS,還有 Cache Me If You Must。這些方法都在不同面向處理 KV-cache 或量化問題。

- TurboQuant 主打 6x 壓縮。

- 有說法稱 2-bit EDEN 在某些情境贏過 3-bit TurboQuant。

- 也有人指出 EDEN 的 unbiased 設計更準。

- benchmark 可能混用了 CPU 和 GPU。

這些數字放在一起看,味道就變了。若一個方法只是在特定硬體上贏,那它的實用價值就要打折。工程師最怕這種 paper win。

再來是 reproducibility。OpenReview 上如果有人重跑不出來,那就很麻煩。因為推論系統不是寫作文。你不能只看圖漂亮。

我自己的判斷很簡單。若 2-bit EDEN 在你的情境裡比 3-bit TurboQuant 還穩,那就別被標題騙了。實測比較重要。論文標語不會幫你省顯存。

這件事其實很像 AI 圈老毛病

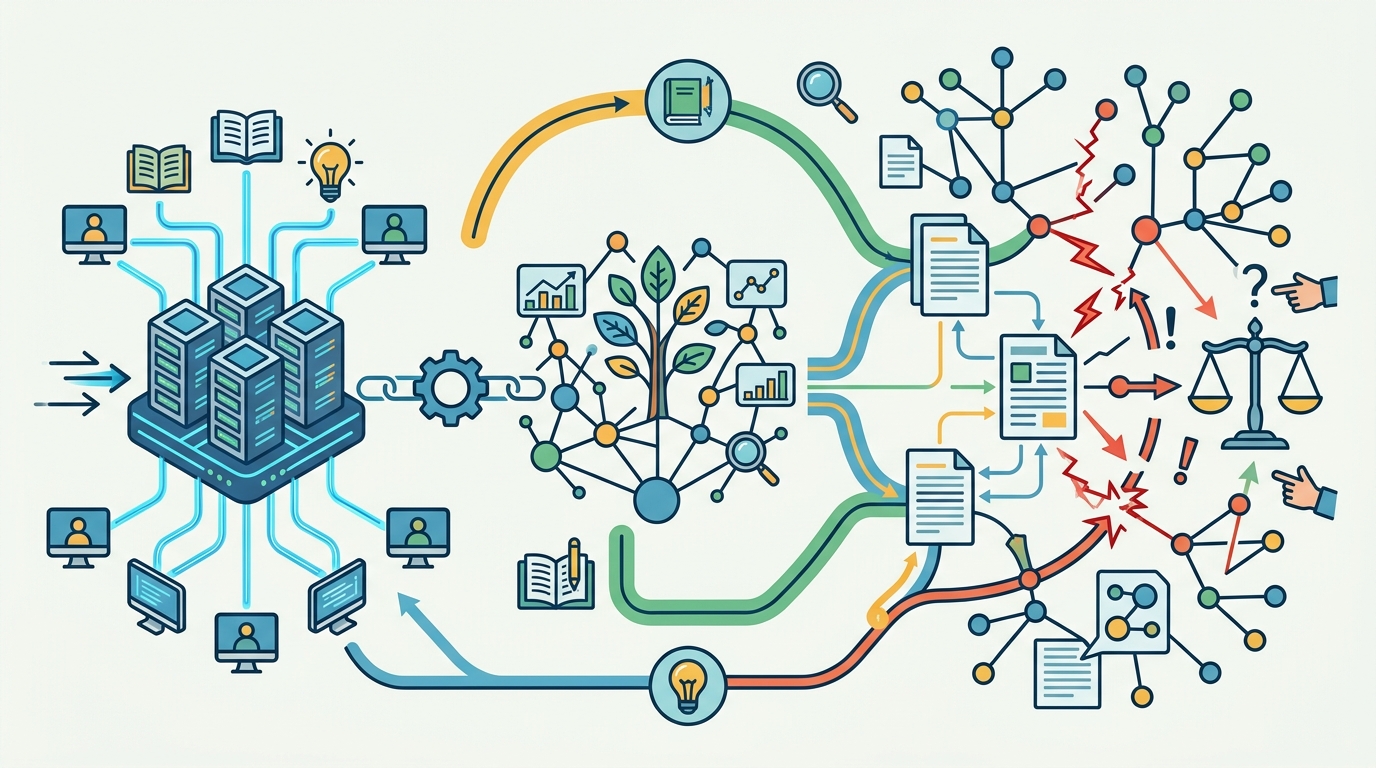

TurboQuant 不是孤例。AI 圈很常把舊點子重新包裝。換個名字。換個圖表。換個 benchmark。然後大家又開始轉貼。

這種現象之所以多,是因為論文和產品節奏太快。研究者想發表。工程師想上線。新創想講故事。三方需求不一樣。

結果就是,真正重要的內容常被包裝蓋掉。原始方法可能沒那麼會講故事。可是它可能更完整,也更值得引用。

如果你是台灣的開發者,這件事很實際。你在選 LLM 推論方案時,不能只看壓縮比。還要看硬體、延遲、吞吐量、準確率,還有實作成本。

像 vLLM 這種推論框架,會把方法放進真正的服務路徑。這時候,理論上的小差異,會變成機房裡的電費差異。

所以我會說,TurboQuant 的價值不一定在原創。它比較像一個案例。提醒大家:論文名字很會唬人,但資料和 benchmark 不會說謊。

接下來該怎麼看這類論文

如果你在評估 KV-cache 壓縮,先回頭看舊論文。先看 DRIVE。再看 EDEN。你會更容易看出 TurboQuant 到底改了什麼。

接著,把比較條件對齊。相同 GPU。相同 bit width。相同 accuracy target。相同 context length。少一項,結果都可能變味。

最後,別只看壓縮比。要一起看 latency、throughput、顯存占用,還有實作複雜度。講白了,能進 production 的方法,才算真的有用。

我的預測很直接。這類爭議只會越來越多。因為 LLM 基礎設施越來越成熟,大家開始更在意 citation、benchmark 和 reproducibility。你下次看到一個很猛的數字時,先問一句:這是新東西,還是舊東西換包裝?