為什麼 LLM 排行榜常常選錯模型品質

LLM 排行榜有參考價值,但不適合拿來決定生產環境要用哪個模型。

LLM 排行榜有參考價值,但不適合拿來決定生產環境要用哪個模型。

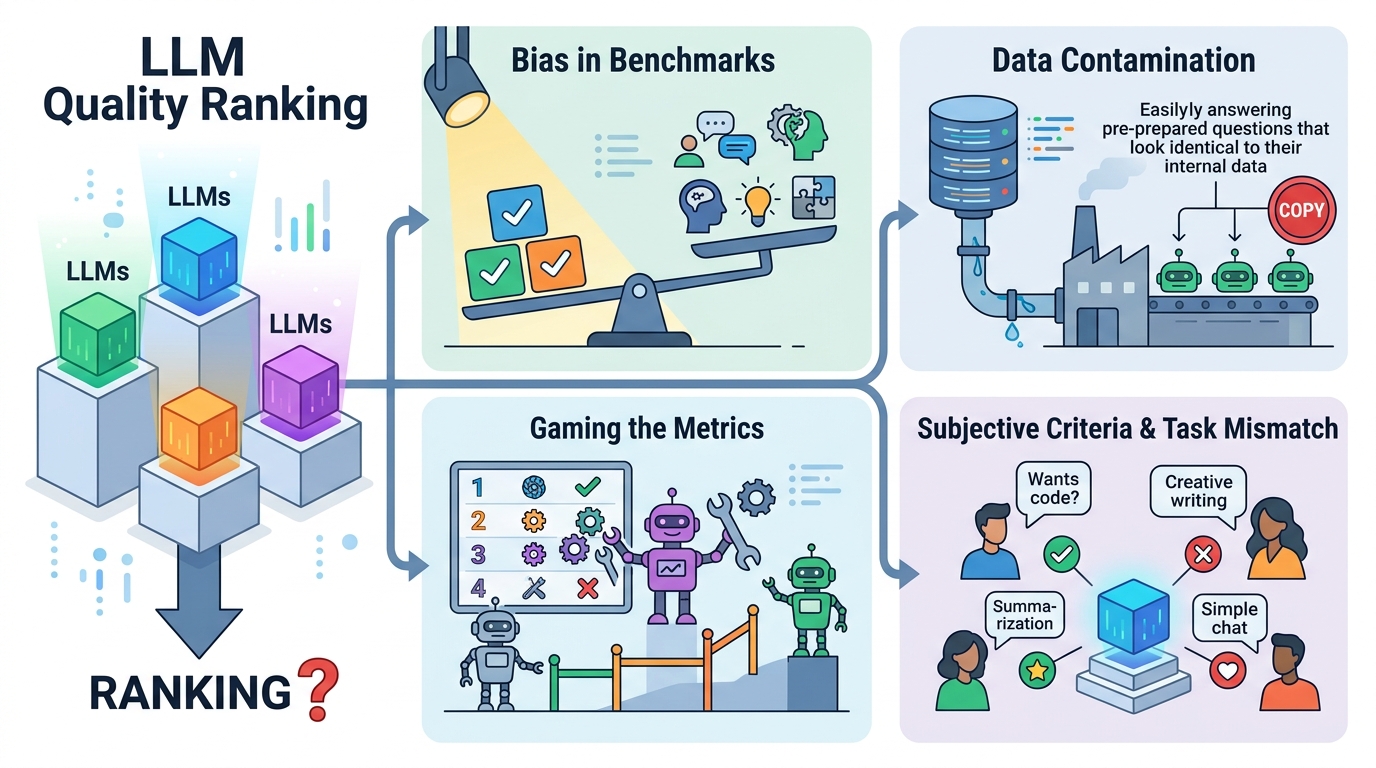

我認為,LLM 排行榜最常犯的錯,不是數字算錯,而是拿錯了問題。GPT-5 可以在 AIME 拿滿分,Claude Mythos Preview 能在 GPQA Diamond 領先,Gemini 3.1 Pro 以成本見長,Grok 4 甚至把上下文拉到 2M token,但這些都不能直接回答同一個問題:哪個模型最適合你的客服、程式審查或文件流程。排行榜告訴你模型在狹窄測試框架下能做到什麼,卻不告訴你在真實產品裡,提示詞混亂、延遲受限、工具呼叫失敗、使用者需求超出題庫時會發生什麼。

第一個論點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

排行榜獎勵的是局部優秀,不是整體可用。模型在 GPQA Diamond 或 AIME 上稱霸,代表它在特定題型很強,但不代表它能穩定遵守產品規格、維持格式、或在工具回傳錯誤後自我修正。這也是為什麼你會看到 GPT-5 主攻數學、Claude Mythos Preview 主攻科學、Gemini 3.1 Pro 主攻價格,這不是單一「最強模型」的排名,而是一張權衡地圖。

真實系統會很快揭露這些權衡。SWE-Bench Verified 之所以比一般編碼題更有意義,是因為它測的是模型能不能修真實 GitHub issue,而不是回答編程冷知識。當任務需要跨檔案導航、產生 patch、再根據測試結果修正時,很多在通用榜單上看起來很亮眼的模型都會掉分。若你的產品依賴這種行為,單看 Elo 或總分就是偏題。

第二個論點

排行榜本身也會改變遊戲規則。LMSYS Chatbot Arena 用盲測的人類兩兩比較和 Elo 分數,Artificial Analysis 則把 benchmark、吞吐量與價格混成一個綜合指標。這兩者不是同一件事的不同呈現,而是兩種不同的「最佳」定義。模型可能在一個平台排前 3,在另一個平台掉到前 10,原因不是誰造假,而是每個平台衡量的東西不同。

這不是小技術差異,而是決策風險。若你在意對話品質,Arena 有價值,因為它捕捉了大規模的人類偏好;若你在意部署經濟性,Artificial Analysis 更有用,因為它把速度和成本算進去;若你只看開源權重,Hugging Face 的榜單才有參考性。問題在於,很多團隊把其中一張圖當成宇宙真理。事實上,沒有任何一張榜單可以代表全部。

反方可能怎麼說

最強的反對意見是:排行榜至少比廠商話術可靠。它提供公開、可重複、快速的比較方式,讓買家不用相信行銷文案就能先縮小選項。它也能很快揭露有用訊號,例如 Arena 累積超過 100 萬場盲測、Artificial Analysis 持續做價格校正、BenchLM 定期跑季度掃描,這些都能減少猜測。對於急著做 shortlist 的團隊來說,排行榜確實是一個實用濾網。

這個說法沒有錯,但只對到一半。排行榜非常適合做初篩、找出前沿變化、抓明顯退步;它不適合做最後決策。原因很簡單:生產成功取決於你的工作負載,不是網路平均使用者的偏好,也不是 benchmark 套件的平均分數。排行榜可以告訴你哪些模型值得進入 pilot,卻不能告訴你哪一個能撐住你的提示詞、工具鏈、合規規則與延遲 SLA。

你能做什麼

如果你是工程師,先把排行榜當成篩選器,再針對你的真實任務做私有評測:檢索、工具使用、格式穩定性、拒答行為、延遲、失敗恢復都要測。如果你是 PM,別再問「哪個模型最好」,改問「哪個模型最適合哪條使用者旅程、成本多少、延遲多少」。如果你是創辦人,請把模型策略做成兩層:先用公開排行榜縮小供應商,再用內部驗收測試決定是否上線。這樣你買到的是性能,不是名氣。