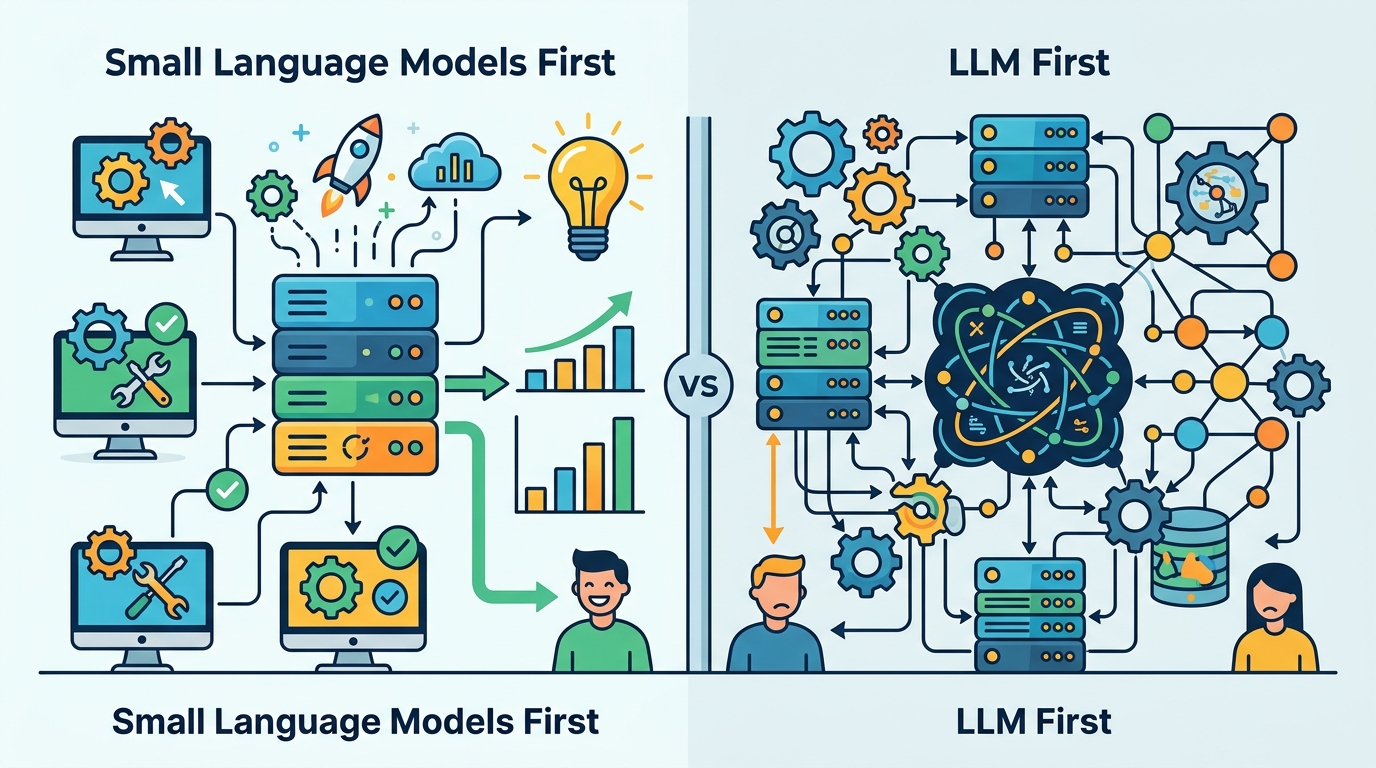

為什麼企業 AI 應該先用小型語言模型,而不是 LLM 優先

企業 AI 的預設架構應該是小型語言模型,而不是大型 LLM,因為多數工作更便宜、更快,也更容易控管風險。

企業 AI 應該先用小型語言模型,而不是把大型 LLM 當預設。

企業 AI 架構該停止把大型語言模型當成萬用起點。對多數重複、窄範圍、可定義的工作,小型語言模型更符合成本、速度與治理需求。Info-Tech 指出,高頻且重複的工作不值得交給龐大模型;Gartner 也預期,到 2027 年,企業採用小型任務模型的比重會是 LLM 的三倍。這不是技術潮流,而是對錯誤設計習慣的修正。

第一個論點:多數企業工作根本不需要巨型模型

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

企業裡最常見的任務,不是寫小說,而是分類、抽取、比對、摘要與路由。客服系統把工單分到 200 多個類別、法務團隊抓合約條款、財務團隊掃描異常交易,這些工作要的是穩定、快速、便宜,不是跨領域的廣泛推理。把這些任務交給大型 LLM,就像用貨車送一封信,能做,但不合理。

真正有效的架構不是單一大模型,而是分工。Info-Tech 的 Thomas Randall 提到,較好的做法是由路由器先判斷:簡單問題交給專門的小模型,複雜推理才升級到大模型。這種設計把 AI 從「一個巨獸」變成「一個系統」,直接降低雲端成本,也減少每次查詢都打到最昂貴層級的浪費。

第二個論點:隱私與部署限制更偏向 SLM

企業 AI 不只是算力問題,也是控制權問題。小型語言模型可以在裝置端、內網或邊緣環境執行,敏感遙測、客戶資料、受管制紀錄不必離開既有環境。對醫療、金融、法律這些高合規產業來說,這不是加分項,而是基本門檻。把資料送去外部 LLM,再回傳結果,常常是治理風險先於效益出現。

另一個被低估的現實是延遲。小模型需要的運算量更少,回應往往更快,這會直接影響使用體驗與營運效率。客服分流、現場設備、離線工具、即時風控,這些場景要的是毫秒級反應與本地可用性,而不是理論上更強、實際上更慢的推理。對生產環境來說,快且可控,通常比「更聰明但更重」更有價值。

反方可能怎麼說

支持 LLM 優先的人有一個很強的論點:大型模型覆蓋面更廣,能處理開放式推理、陌生領域與混亂邊界案例。對缺乏 AI 成熟度的團隊來說,先接一個通用 LLM,看起來比建立路由層、資料管線與治理流程更快,也更像是一條可直接上線的捷徑。

這個說法不是錯的,因為確實有些工作只有大型模型能扛下來,尤其是長上下文、跨域推理、需求模糊的場景。問題在於,這些情況不構成「預設架構」的理由。更合理的做法是編排,而不是一刀切:把 LLM 留給真正需要廣泛推理的任務,其餘流程交給 SLM。複雜度應該放在系統設計,不該塞進每一次推理呼叫。

你能做什麼

如果你是工程師,先做路由層,讓高頻、低風險、定義清楚的任務優先走小模型,只有在信心不足或需要更廣泛推理時才升級;如果你是 PM,請把成功指標定成延遲、每次任務成本、窄流程準確率,而不是模型參數數量;如果你是創辦人,別再賣「一個模型解決所有問題」,改成設計模型組合。企業 AI 的贏法不是預設更大,而是該小就小、該大才大,並且全程可控。