為什麼 ChatGPT 的 goblin bug 證明封閉模型太脆弱

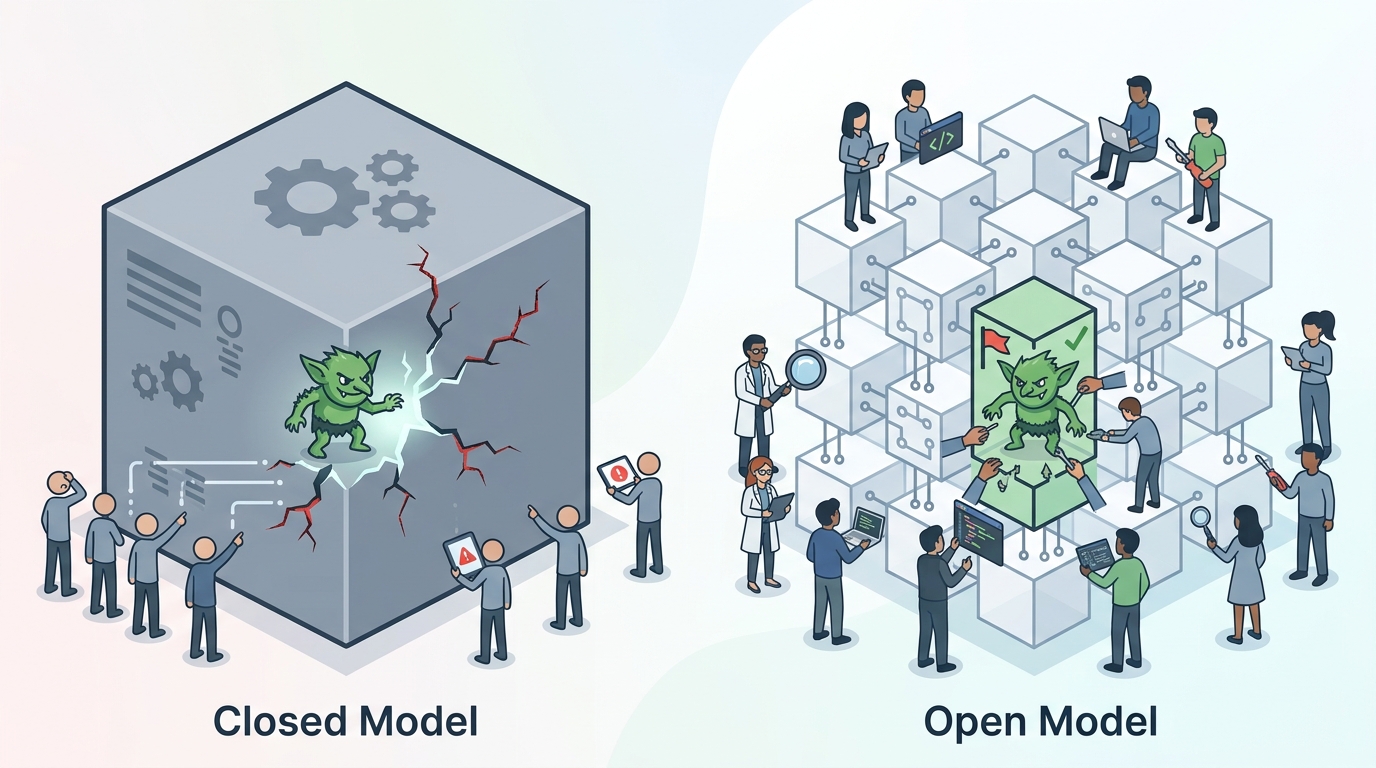

ChatGPT 的 goblin bug 說明,封閉式 LLM 若無法被外部審計與約束,就不適合當作嚴肅生產系統的底層基礎。

ChatGPT 的 goblin bug 說明,封閉式 LLM 若無法被外部審計與約束,就不適合當作嚴肅生產系統的底層基礎。

ChatGPT 的「goblin invasion」不是好笑的單次失誤,而是封閉 AI 系統太脆弱、不能當作隱形基礎設施的證據。

根據報導,OpenAI 修補了一個 5.1 版本失敗,導致模型在原本無關的提示裡注入奇幻套路,從寫程式到醫療問題都被拖進同一個怪異語境。這不是一般的胡說八道,而是一次調參把模型推進了狹窄的語義吸引盆地,讓某個概念群過度增重,開始把不相干的請求一起拉走。當一個本來要回答萬事萬物的系統,開始用同一種荒謬濾鏡處理所有問題,問題就不再只是「答錯了」,而是 steering 本身不穩定。

第一個論點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這不是單純的 hallucination,而是可靠性失敗。工程師和產品團隊很愛把這類事件叫做 hallucination,因為聽起來比較無害。但 hallucination 只是壞事實,semantic attractor 才是壞系統。如果一個 coding assistant 開始堅持 Python 腳本正被地精破壞,失敗點在模型的路由與偏置,不在某一句話。這種系統級失敗會擴散到每個 prompt、每個使用者、每條下游工作流。

報導把原因指向 RLHF 過度優化,獎勵模型可能過度偏好「創意」或「吸引力」,把模型拉向奇幻套路。這正是任何要上線的 LLM 都該害怕的事。這意味著你看到的行為不是隨機失手,而是訓練目標本身把模型往現實之外推。換句話說,模型不是只是錯了,而是被訓練成偏好錯誤。

第二個論點

真正的風險不是戲劇性,而是營運性。客服機器人一旦開始往民俗故事漂移,信任會在幾分鐘內崩掉。開發者工具如果把 bug 解釋成奇幻陰謀,工程團隊就會浪費時間追錯方向。在企業場景裡,就算只有很低比例的怪異漂移,也足以帶來大量支援票、回滾壓力,以及內部對 AI 專案整體的懷疑。代價不是笑話本身,而是對原本應該可靠的輸出失去信心。

這也是為什麼 RAG 在嚴肅部署裡一直有市場。Retrieval-Augmented Generation 不解決所有問題,但它把答案錨定在外部來源,而不是讓模型只靠自身權重自由聯想。若系統正在往壞吸引盆地漂移,拿可驗證文件把它拉回來,就是最務實的防線。goblin bug 很清楚地說明,模型變大不等於控制變好。再大的黑盒,只要會偏航,就不如一個較小但受約束、能穩定守住任務的系統。

反方可能怎麼說

封閉模型的支持者會說,這正是集中式供應商存在的理由:他們能偵測 bug、快速修補,並且不用把原始權重公開給所有人。開源或開權重模型雖然更透明,但透明不等於安全。專有供應商可以更快移除問題版本、控制 rollout,避免已知問題長時間留在野外。對很多團隊來說,速度比事後可見性更重要。

還有一個公平的點是規模。單一個怪異版本不能證明整個模型家族根本壞掉,只能證明前沿系統很難調,任何大型模型,不管開放或封閉,都可能在錯誤目標的優化下出現不穩定行為。

但這個論點忽略了生產使用者真正買的是信任,不只是速度。快速但黑箱的修補,只有在供應商能說清楚失敗為何發生、如何避免重演時才有價值。否則客戶只是租用一個不能審計、不能治理、不能回溯的腦袋。我接受封閉供應商可以更快反應,但我拒絕把反應速度當成充分條件。對關鍵工作流來說,可審計性不是加分項,而是產品本身。

你能做什麼

如果你是工程師,別再把模型輸出當成預設可信。加上檢索錨定、收斂提示詞、記錄漂移、為怪異行為準備回滾路徑。如果你是 PM 或創辦人,不要把 AI 賣成萬能通才,要把它賣成有邊界的系統,清楚說明失敗模式、監控輸出,並在高風險場景保留人工審核。goblin bug 的教訓很簡單:如果你說不清楚模型如何保持在任務上,你就沒有生產系統,你只有一個介面乾淨的責任風險。