新詞初始化別再只取平均

GTI 在微調前先把新詞錨定到有意義的嵌入位置,避免平均初始化讓 token 擠成一團,進而影響生成式推薦的表現。

語言模型一直在擴 vocab。問題是,新加進去的 token 通常沒有預訓練基礎,只能靠後續微調慢慢學。這篇論文要修的,就是這個看起來很小、實際上很關鍵的起點:新 token 到底該怎麼初始化。

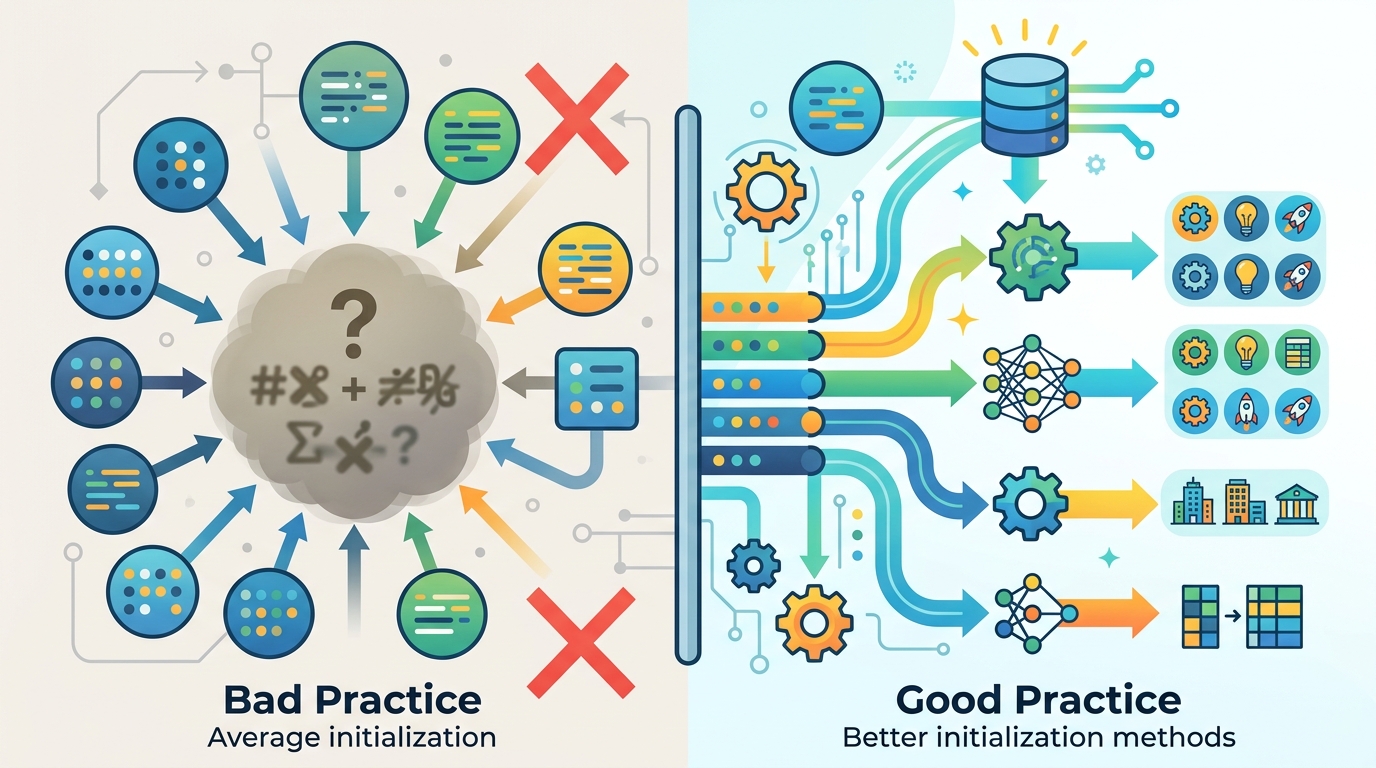

作者鎖定的是生成式推薦(generative recommendation)場景,像 Semantic-ID 這類新詞彙會被加進語言模型,拿來表示領域內的物件或概念。業界常見做法很直接:把新 token 初始化成既有詞向量的平均值,再交給 supervised fine-tuning。論文認為,這種做法雖然方便,卻可能把新 token 的差異直接抹平。

這篇工作的核心,不是再發明一個更大的模型,而是把「新詞怎麼站上起跑線」這件事講清楚。作者主張,若新 token 在微調前先被放到一個有語意基礎的位置,模型後面就比較能沿用預訓練時學到的結構,而不是從一個過度扁平的起點重新掙扎。

這篇論文在解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

在生成式推薦裡,新 token 不是一般文字。它們常常代表商品、項目、實體,或某種領域內的離散符號。這些 token 的角色很像模型和資料庫、商品庫之間的介面。介面如果一開始就太粗糙,後面再怎麼訓練,模型都得先花力氣把它們拆開。

作者指出,常見的平均初始化有一個隱性代價:所有新 token 一開始都被放到差不多的位置。從幾何上看,這會把它們壓進一個退化的子空間。白話講,就是 token 彼此太像,原本應該保留的區別被消掉了。

論文用光譜與幾何診斷來看這件事,結論是平均初始化不只是「不夠好」,而是可能直接限制新 token 後續能學到多少東西。因為微調要先把這些 token 從同一團裡拆開,才有辦法學到真正有用的區分。

這個觀點對開發者很實際。很多時候大家會把初始化視為工程細節,覺得反正最後都會 fine-tune,差一點沒關係。但這篇論文的訊息很明確:起點本身就會改變模型後面能不能把新詞學好。

GTI 到底怎麼做

作者提出的想法叫做 Grounded Token Initialization Hypothesis。重點是:如果新 token 在微調前先被「語言上錨定」到預訓練 embedding 空間裡,模型就能更好地重用原本的通用知識。這不是重新設計整個訓練流程,而是先把新 token 放進一個比較有結構的位置。

實作方法叫 GTI,Grounded Token Initialization。論文把它描述成一個輕量的 grounding 階段,會在 fine-tuning 之前先跑一次,把新 token 映射到 pretrained embedding space 裡不同、而且有語意意義的位置。它使用的監督訊號是 paired linguistic supervision。

和平均初始化相比,GTI 的差別很直觀。平均初始化是把每個新 token 都放到一個模糊、沒有區別的平均點;GTI 則希望每個 token 都先站到一個能反映其語意關係的位置。換句話說,GTI 不是只求「能用」,而是先讓 token 之間的相對結構存在。

這種設計的重點在於,它把「新 token 的表示學習」拆成兩段。第一段先做 grounding,第二段才是 supervised fine-tuning。作者的假設是,只要第一段把幾何結構保住,第二段訓練就比較不會把所有差異磨平。

論文實際證明了什麼

這篇摘要沒有公開完整 benchmark 數字,所以不能從 abstract 直接列出具體提升幅度。不過作者明確表示,GTI 在多數評估設定中,表現都優於平均初始化,也優於現有的 auxiliary-task adaptation 方法。

評估範圍涵蓋多個 generative recommendation benchmarks,而且同時包含 industry-scale 與 public datasets。這點很重要,因為它代表作者不是只在單一資料集上做局部優化,而是在不同規模的推薦場景裡檢驗同一個觀念:新詞初始化會不會真的影響結果。

除了效能比較,論文還特別看了 embedding 的內部幾何。作者報告說,grounded embeddings 會形成更豐富的 token 間結構,而且這種結構在 fine-tuning 後仍然保留下來。這表示 GTI 的價值不只是在起跑時比較漂亮,而是它建立的結構真的撐到了訓練後期。

對實作的人來說,這是很關鍵的訊號。很多方法看起來有效,但只在初始化那一瞬間有差,幾個 batch 之後就被訓練沖掉。這篇論文想傳達的是,GTI 不是短暫的裝飾,而是會影響後續學習路徑的前置步驟。

這對開發者有什麼影響

如果你在做 LM-based recommendation,或任何需要把新詞塞回既有 vocab 的系統,這篇論文的提醒很直接:初始化不是可有可無的細節。它會影響新 token 的可分性,也會影響模型到底能不能有效利用這些 token。

特別是在推薦系統裡,token 往往不只是分類標籤,而是承載了 item、entity、catalog structure 之類的資訊。一旦新 token 在表示空間裡太擠、太像,模型就更難把候選項目拉開,也更難保留細粒度差異。

GTI 還有一個工程上的吸引力:論文把它描述成 lightweight。從摘要看起來,它不像是要把整個訓練架構翻掉,也不像是要多掛一個很重的輔助系統。它比較像是微調前的一個 grounding 步驟,先把 vocab extension 的品質拉高。

- 平均初始化可能會讓新 token 的差異被過度壓縮。

- 先把 token 錨定到 pretrained embedding space,有機會保留更有用的結構。

- 作者聲稱這個效果在多個 generative recommendation benchmark 都看得到。

- 摘要沒有提供完整 benchmark 數字,所以無法從這裡判斷實際提升幅度。

限制與還沒回答的問題

這篇摘要給了很清楚的高層故事,但也留下不少開發者會在意的細節。首先,沒有 benchmark 數字,就沒辦法直接比較 GTI 到底贏多少。其次,摘要沒有交代訓練成本、實作複雜度,或 grounding 階段需要多少額外資源。

另外,GTI 依賴 paired linguistic supervision,但摘要沒有說這種監督訊號的品質、數量,或來源會不會影響效果。這對實務很重要,因為如果 supervision 不穩,grounding 的品質也可能跟著波動。

還有一個關鍵問題是泛化範圍。這篇論文的動機很明顯是針對 generative recommendation 與 Semantic-ID tokens,摘要沒有直接證明它能無痛移植到其他 LM 擴 vocab 的場景。它可能有啟發性,但不能只看 abstract 就當成通用解法。

不過,論文傳達的主軸仍然很有價值:當你替 pretrained LM 加新 token 時,初始化不是小事。它會影響 embedding geometry、token separability,以及 fine-tuning 能不能把新詞的結構保留下來。

對台灣做推薦、搜尋、或任何需要擴充 vocab 的團隊來說,這篇 paper 的實用訊息很簡單:別只把新 token 當成「等一下再學」的東西。它們從一開始站在哪裡,會直接影響模型後面能學到多少。A Better Way to Seed New LM Tokens 想講的,就是這個被很多 pipeline 默默略過的起點,其實可能是整個效果差距的來源。