LLM 會把國籍寫歪嗎

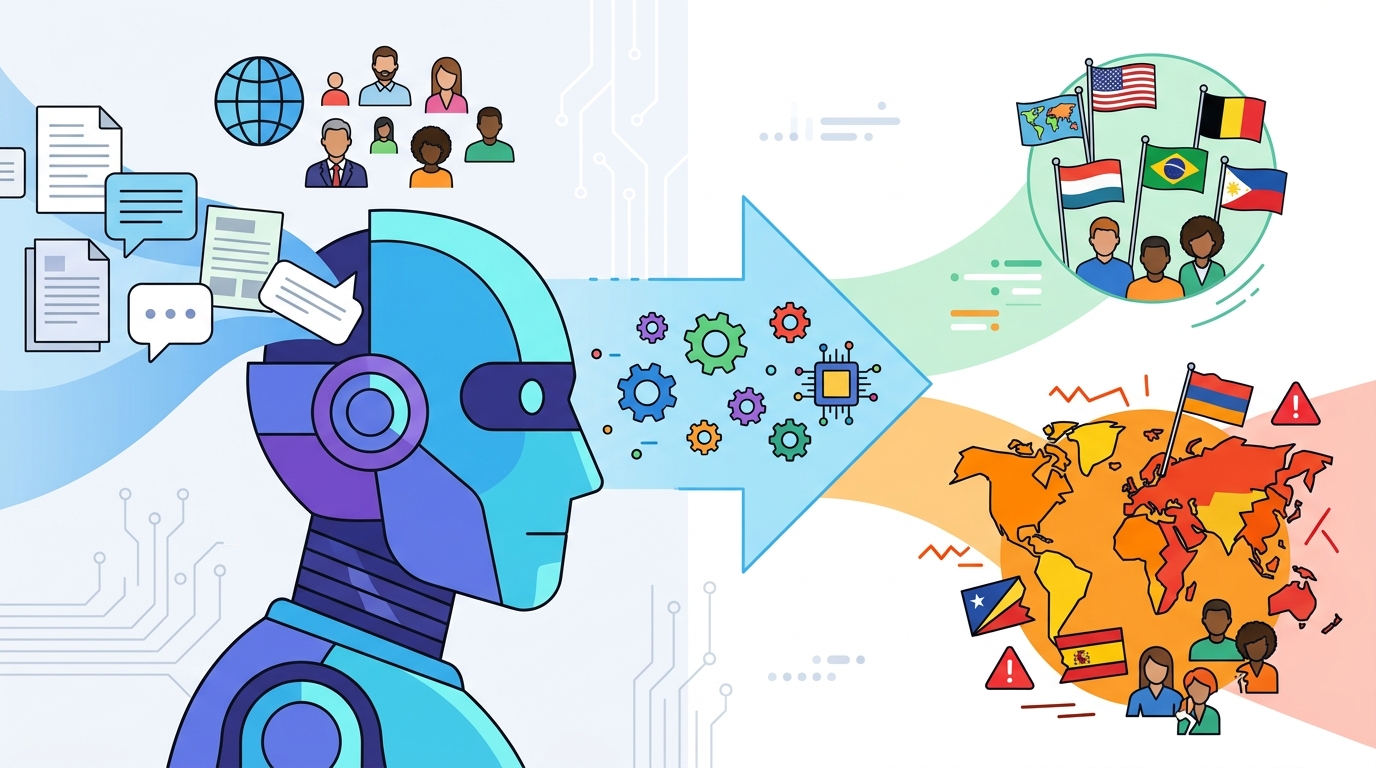

這篇 arXiv 研究發現,常見 LLM 在寫國籍敘事時,會對 Global Majority 身份產生刻板印象、抹除與單一化描寫;只要提示詞出現美國線索,偏差還會加重。

大型語言模型現在不只拿來聊天,還被放進各種生成流程,甚至包含高風險情境。這篇論文 Representational Harms in LLM-Generated Narratives Against Global Majority Nationalities,問的是一個很實際的問題:當你叫模型寫不同國籍的人,最後寫出來的故事會不會把某些群體寫歪?

答案不太好看。作者發現,LLM 會在國籍相關敘事裡持續產生表徵傷害,包含刻板印象、抹除,以及對 Global Majority 身份的單一化描寫。這種問題不只是「有沒有冒犯字眼」而已,而是模型把誰寫成主角、誰被寫成配角、誰被寫成附屬角色。

對開發者來說,這篇研究的重點很直接:偏誤不一定長得像毒性字詞。它也可能藏在敘事結構裡,藏在角色分工裡,藏在模型默認的世界觀裡。你如果只看表面流暢度,很容易漏掉。

這篇論文在解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這篇研究要補的是一個常被忽略的評估缺口。很多安全與公平性研究,會先抓明顯的毒性、辱罵、仇恨詞。但表徵傷害不一定會用這種形式出現。它更像是長期、重複地把某些群體寫得更有權力、更正常、更完整;同時把其他群體寫成背景、依附者,或只剩某種刻板印象。

這件事之所以重要,是因為 LLM 已經被用在會影響判斷與感受的任務裡。像是產生人物簡介、摘要、模擬對話、情境文字,甚至模擬面談。當提示詞裡帶有身分線索時,模型不只是在改變文風,也可能在改變社會意義。

作者特別把焦點放在國籍。原因很直白:國籍是很常見的身分軸線,但在評估裡卻不一定被認真看待。尤其是 Global Majority 的群體,往往不是被當成核心對象來設計或驗證。結果就是,模型可能在你沒注意到的地方,把這些人寫得很扁平。

這篇論文想處理的,不是「模型會不會完全亂說」。而是更細的問題:當模型被要求寫一個人時,它會不會自動把某些國籍當成預設主角,把其他國籍寫成次等角色。這種差異,才是實務上最難抓的地方。

方法怎麼做,白話講就是什麼

這項研究看的是 LLM 在開放式敘事生成提示下的反應。它不是做二元分類,也不是丟固定問卷,而是觀察模型在被要求寫故事、寫敘事時,會怎麼處理不同國籍身分。

這個設計很重要,因為表徵傷害最常躲在敘事裡。模型不一定會直接罵人,但它可能一直讓某些群體當被動角色,或把複雜的人寫成只有單一標籤。開放式提示能讓這些模式自然浮現,而不是被硬塞進一個很窄的測試框架。

作者也特別比較了提示詞裡出現美國國籍線索時的效果。換句話說,他們不只看「這個國籍會怎麼被寫」,也看「只要提示裡有美國 cue,其他國籍會不會被連帶影響」。這很像在看模型是不是會自動切到美國中心的敘事框架。

另外,他們還檢查一個常見辯解:這是不是只是 sycophancy,也就是模型在迎合提示詞、照著使用者的框架回話。如果只是迎合,那問題可能還能怪 prompt。若不是,那就表示偏差更深,已經在模型的預設聯想裡。

從工程角度看,這種方法很有參考價值。因為很多團隊只會做輸出過濾,卻不會系統性檢查敘事風格。這篇研究提醒你,真正的風險不只在「說了什麼」,也在「怎麼說」與「誰被怎麼安排」。

論文實際證明了什麼

最核心的結果是:模型對國籍的表徵傷害是持續存在的。作者觀察到的問題包含刻板印象、抹除,以及對 Global Majority 身份的單一化描寫。白話說,就是某些國家或族群不只是被描述得不一樣,而是被描述得更沒有主體性、更沒有層次。

論文指出,次等化的國籍身分在「沒有明顯權力差異的故事」裡反而較少出現,但在被寫成從屬角色時會大量出現。這類從屬描寫比主導描寫多出五十倍以上。摘要沒有提供完整 benchmark、模型清單或實驗表格,所以這裡只能保留這個公開的數字資訊,不能再延伸出更多量化結論。

另一個重要發現是,只要提示詞裡有美國國籍線索,傷害就會變得更嚴重。這代表模型不是單純依照局部文字反應,而是會喚起更廣泛的美國中心敘事習慣,進而改寫對其他國籍的描述。

更關鍵的是,作者說這些問題不能簡單歸因於 sycophancy。即使把提示中的美國線索換成非美國國籍,US-centric 偏誤仍然存在。這表示模型不是只是在「附和使用者」,而是自己就帶著一套國籍階序進入生成流程。

這點對做生成產品的人很重要。因為它告訴你,偏誤不一定要靠明顯惡意才會出現。只要提示詞碰到某些身分線索,模型就可能自動切換到不對等的敘事模板。

對開發者有什麼影響

如果你在做 LLM 產品,這篇研究提醒你:輸出品質不能只看流暢度或事實性。敘事框架本身就可能承載偏誤,而且這種偏誤通常很難靠人工快速掃描發現,卻會被受影響的人一眼看穿。

這對很多產品線都適用,像是內容生成、內容審核、助理系統、評估管線,以及任何會產生身分相關文字的工作流。只要你的產品會寫人物簡介、情境文本、角色扮演、面談模擬或合成樣本,就要注意模型是不是把主流身份當常態,把其他身份當例外。

- 檢查模型是否反覆把主導群體寫成有主體性,把次等化群體寫成被動角色。

- 測試提示詞有沒有美國國籍線索,因為這會改變敘事走向。

- 不要只靠毒性過濾器,表徵傷害常常更隱性,但傷害不小。

- 評估時要看不同身分群體的敘事差異,不要只看平均分數。

這篇論文也對一些可能被拿去做分類、監控或面談的場景提出警訊。作者明確提醒,不要不加思索就把美國本土訓練出的 LLM 拿去用在這類用途,因為它們可能會誤寫世界上多數人的身份與處境。這句話很重,但從這篇研究的範圍來看,是有根據的。

限制與還沒回答的問題

這篇研究很有價值,但摘要也留下不少未公開細節。它沒有列出測試了哪些模型,也沒有公開完整的提示集或評估標準。更重要的是,摘要沒有提供一般 benchmark 式的完整數字,所以不能把它解讀成某種模型排行榜。

另外,這項工作聚焦在敘事生成,所以它最直接能說明的是文字輸出中的表徵傷害。它證明的是:在開放式敘事與身分提示下,偏誤可以很穩定地出現。但這不等於它已經證明所有下游任務都會以同樣方式受影響。

還有一個實作上的難題,是怎麼大規模衡量表徵傷害。這種傷害不像準確率那樣容易打分,也不像有毒內容那樣容易做關鍵字攔截。作者提到需要以 Global Majority 觀點為中心的方法,這其實是在提醒業界:評估框架本身就要重做。

所以,這篇論文的實際訊息不是「某模型壞掉了」。而是「如果你只做一般安全檢查,你很可能漏掉更深的敘事偏誤」。對產品團隊來說,這是很值得提早納入 eval 的問題。

總結來說,這篇研究把國籍表徵拉進了 LLM 安全討論的核心。它告訴我們,模型不只是會不會講錯事實,還會不會把某些人寫得比較像人、某些人寫得比較不像。對開發者而言,這種差異就是產品風險的一部分。