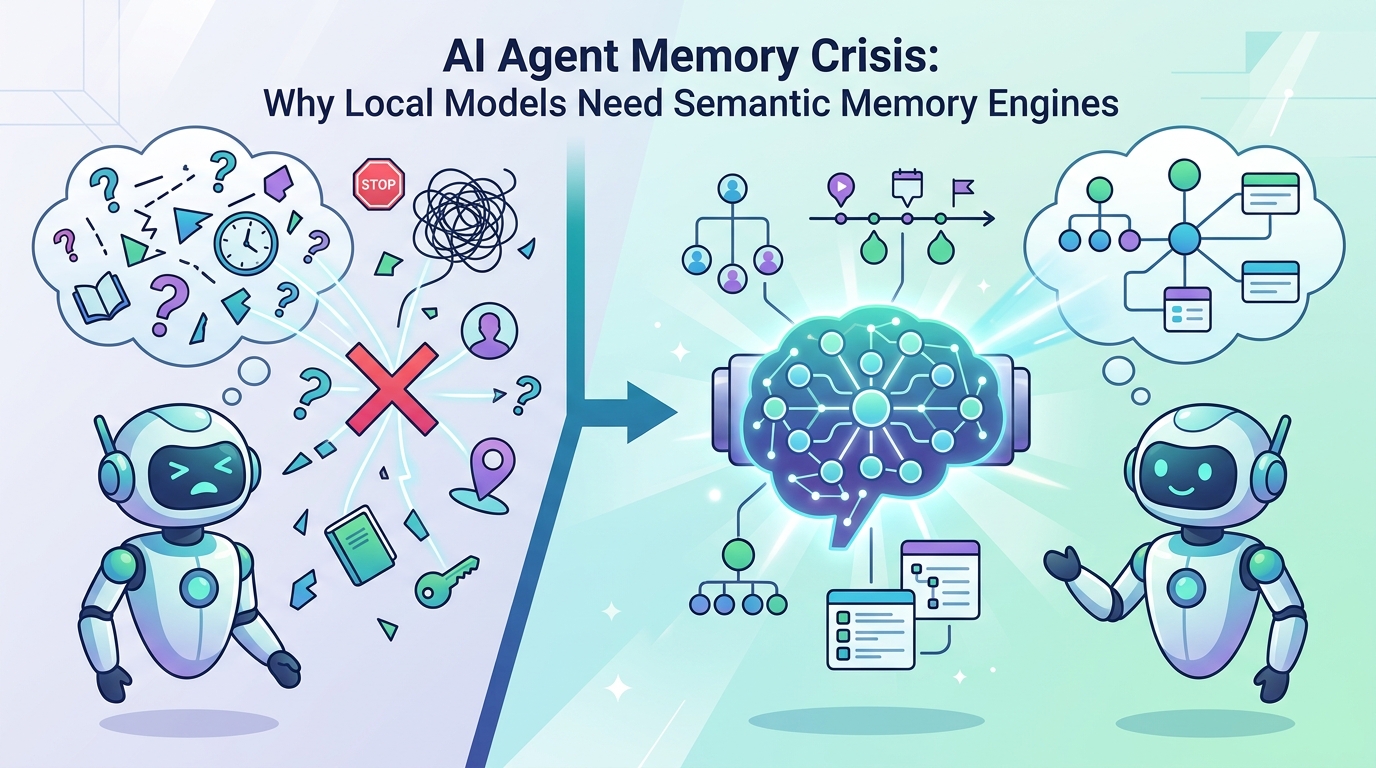

AI 代理人的記憶危機:為什麼本地模型需要語義記憶引擎

Hermes Agent 雖然擁有 12 萬星標,但其原生記憶系統採用純文本追加式儲存,無法有效去重和檢索。MemOS 本地外掛透過語義分塊、LLM 驗證和混合檢索,解決了自主 AI 代理在長期使用中的記憶衰退問題。這反映了一個關鍵趨勢:代理執行環境正從玩具級原型進入需要真實記憶治理的生產系統。

開源 AI 代理框架 Hermes Agent 在開發者社群中獲得了廣泛關注,但其原生記憶層設計暴露了一個被廣泛忽視的問題:當代理超越數百輪對話的規模後,簡單的追加式日誌和關鍵詞文本匹配會迅速崩潰。

原生代理記憶的三個致命弱點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

Hermes Agent 的記憶機制直接將每個對話輪次寫入 SQLite,並依賴關鍵詞檢索。這種設計在初期看似足夠,但隨著使用時間增長,三個問題逐漸浮現:

- 重複累積:相同或相似的事實被反覆記錄,資訊密度逐漸稀釋

- 矛盾共存:「用戶正在節食」和「用戶放棄節食」被同時儲存為獨立記錄,代理無法判斷哪個是當前狀態

- 檢索衰減:隨著記憶條目增加,文本匹配的訊噪比急劇下降,相關記憶常被淹沒在雜訊中

這不是 Hermes 獨有的問題。OpenClaw 和其他個人代理框架都存在相同的架構限制。甚至 ChatGPT 的自訂 GPT 記憶功能也面臨類似的可擴展性瓶頸。

MemOS 的記憶治理模型

MemOS 是一個開源 AI 記憶作業系統,其 Hermes 本地外掛提供了不同的方案。寫入管道包含四個步驟:語義分塊 → LLM 摘要化 → 向量嵌入 → 智能去重。關鍵創新在於去重邏輯:不是文本相似度比較,而是讓 LLM 檢視新記憶與既有記憶的語義關係,判定是重複、更新還是新增。在節食例子中,這會合併成單一記錄並保留編輯歷史。

檢索端採用混合搜尋引擎:全文搜尋和向量語義搜尋並行執行,然後透過融合排序、多樣性去重、時間衰減和相關性過濾進行重排。系統在對話開始時會預先取得使用者最新消息相關的記憶,避免檢索延遲。

分層模型治理的必要性

Hermes 原生使用單一模型處理記憶相關的所有任務,導致技能品質參差不齊。MemOS 採用三層配置:嵌入層(輕量)→ 摘要層(中等)→ 技能生成層(最強)。更重要的是,它加入了規則和 LLM 評估門檻,只有具備可重複性和實際價值的任務才會轉化為技能。當上層模型不可用時,系統會自動降級到下層模型,保證可靠性。

這個設計模式直指一個更廣泛的趨勢:代理框架正從「執行每個請求」演進到「治理執行的後果」。記憶不再是被動的日誌,而是需要主動管理的知識資產。

多代理協作與隱私邊界

MemOS 支援兩層協作架構。第一層允許同機多個 Hermes 實例共享通用記憶池和技能,但保持隔離;第二層跨機器提供 Hub-Client 架構,私有資料始終保留在本地,只有顯式共享的內容對團隊可見。這對需要隱私控制的企業或多人工作流至關重要。