微軟與 NVIDIA 想用 AI 解核能卡關

微軟與 NVIDIA 把 AI 帶進核能許可、設計與施工流程。Aalo Atomics 稱許可作業加快 92%,每年可省 8000 萬美元。重點不在花俏模型,而是把文件、模擬與審查流程接到同一套數位底座。

核能產業最痛的地方,很多時候不是反應爐本身,而是文件。微軟點得很直接:光是許可流程就可能拖好幾年,成本上看數億美元,而且那時候工地可能連第一車混凝土都還沒進場。

所以這次微軟和 NVIDIA 的合作,講白了就是拿 AI 去砍文書、審查、交叉比對和重工。Aalo Atomics 還丟出一個很猛的數字,說它把一段許可流程加快了 92%,一年可省約 8000 萬美元。

你可能會想問,這是不是又一篇企業 AI 行銷稿。老實說,有這個味道。但核能剛好是很適合 AI 先落地的場景,因為它文件超多、流程超硬、每一步都要留下證據鏈,這種地方比起聊天機器人,更需要能追溯的工作流工具。

核能專案為什麼常卡在開工前

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

微軟的論點很清楚。核能專案卡住,很多時候不是因為物理做不到,而是流程太慢。先進反應爐再怎麼會發電,從概念走到核准,還是得穿過一大堆法規、審查和工程文件。

這些工作包含工程設計包、安全分析、環評、授權申請,還有大量互相引用的技術文件。團隊常常要花上幾千小時,處理撰寫、排版、搜尋、審稿、修正。文件一多,只要某個數字前後不一致,就可能再跑一輪審查。

更麻煩的是,很多資料根本沒放在同一個地方。有些在 PDF,有些在 Excel,有些在 CAD,有些在 email 附件。工程、法規、施工、營運各看各的版本,最後重工不是意外,是日常。

微軟想做的是把這些東西拉到 Azure 上,用同一套數位底座串起設計資料、模擬結果、證據文件和法規材料。目的不是把核能變成全自動,而是讓流程少一點混亂,多一點可重複。

- 許可流程可能拖好幾年。

- 前期成本可能高達數億美元。

- 工程師常花幾千小時做文件處理。

- 專案文件可能累積到數萬頁。

這件事很重要,因為核能專案失敗,常常不是缺技術,而是時程失控。文件品質不穩、版本對不上、證據鏈不完整,最後都會變成成本。AI 不會幫你跳過法規,但可以把很多低價值的文書工作砍掉。

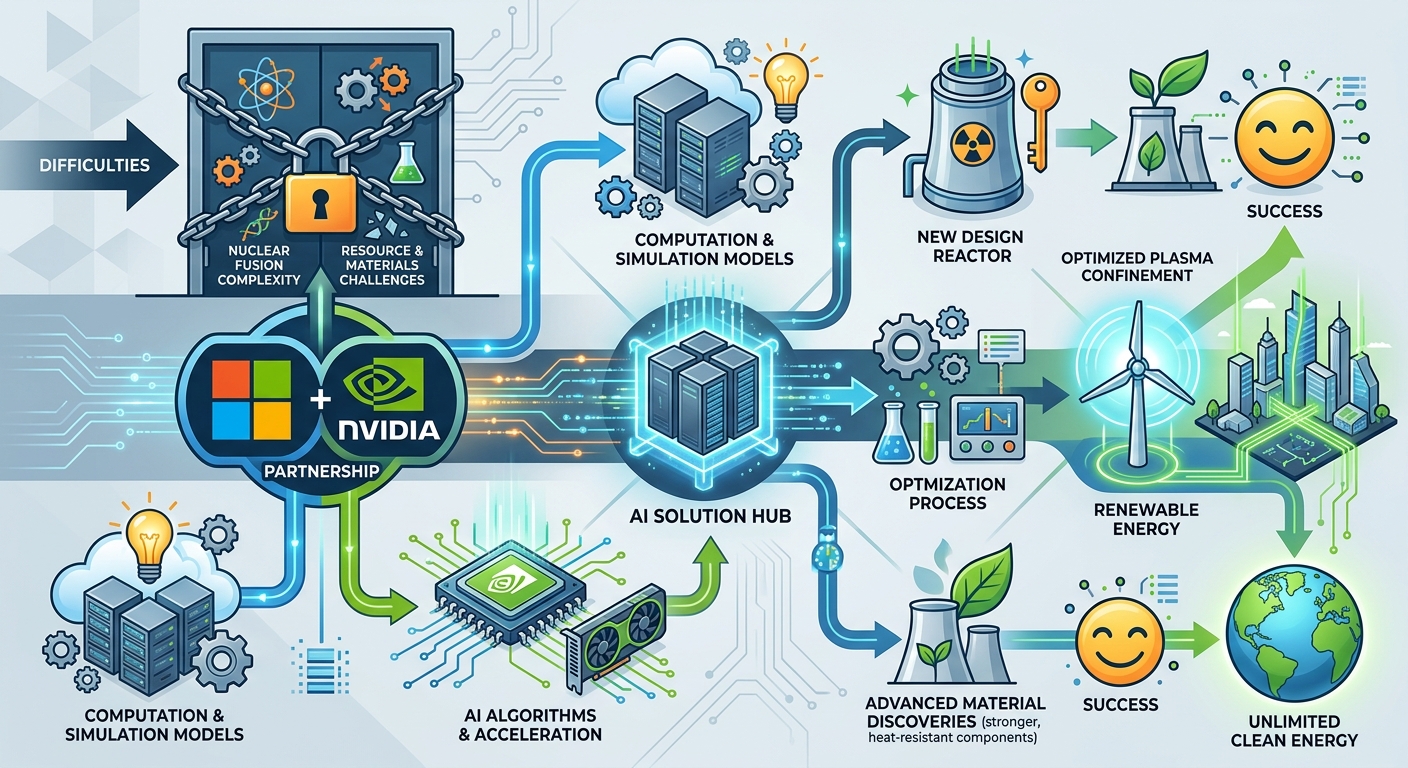

微軟和 NVIDIA 到底在做什麼

這次合作不是丟一個模型出來就收工。它比較像一整疊工具的組合。微軟拿出 Generative AI for Permitting Solution Accelerator、Planetary Computer 和 Azure,NVIDIA 則放上 Omniverse、Earth-2、CUDA-X、AI Enterprise、PhysicsNeMo、Isaac Sim、Metropolis。

名字很多,看起來有點像簡報灌水。直接翻成人話,就是微軟想把 Azure 變成核能專案的資料中台,NVIDIA 提供模擬、數位分身、AI 基礎設施和一些物理建模能力。兩邊合起來,想把設計、審查、施工、營運接成一條線。

實際用途其實比品牌名稱務實很多。在設計階段,數位分身和模擬可以先測試變更,避免現場施工才發現不對。在授權階段,生成式 AI 能先草擬文件,拿過去提交過的材料做比對。在施工階段,4D、5D 模型可以先看時程和成本。在營運階段,感測器資料配 AI 可以提早抓異常,安排預測性維護。

“The nuclear industry has been bottlenecked by documentation burden and regulatory complexity for decades.”

— Kevin Kong, Chief Executive Officer, Everstar

Kevin Kong 這句話其實把整件事講完了。核能不是沒有技術,而是長期卡在文件負擔和法規複雜度。AI 在這裡的價值,不是替代核能工程師,而是幫他們少做重複整理、比對和查找。

微軟也一直強調 traceability,也就是可追溯性。這不是附加功能,而是核能場景的基本門檻。你如果只讓 AI 吐出一份漂亮報告,卻說不清資料從哪來、哪條規則支持這個結論,監管單位大概不會買單。

所以這套方案的核心,不是「AI 很會寫」。而是 AI 產出的每一段內容,都要能連回原始資料、工程決策和適用法規。說真的,這比做一個會聊天的 Copilot 難多了,但也更有商業價值。

目前案例不大,但數字很有殺傷力

這波公告裡,最有用的地方是微軟沒有只講願景,它有點名客戶。名單包括 Aalo Atomics、Southern Nuclear、Idaho National Laboratory、Everstar、Atomic Canyon。每一家用法不同,成熟度也差很多。

最吸睛的是 Aalo Atomics。微軟說,Aalo 用了 Generative AI for Permitting 之後,把一段高工時的許可流程加快 92%,而且估計一年能省 8000 萬美元。這個數字很大,我覺得一定要保留懷疑,因為「某段流程」和「整個核准流程」差很多。

但換個角度看,至少它不是那種空泛的「效率提升很多」。有具體百分比,也有金額。即使外界還看不到完整方法論,這種說法還是比一般企業簡報有料。

Southern Nuclear 正在把 Microsoft Copilot agents 用到工程和授權工作流。Idaho National Laboratory 則用 AI 自動組裝工程與安全分析報告,目標是整理出監管單位也能安全採用的方法。Everstar 把核能專用 AI 工作流帶到 Azure。Atomic Canyon 的 Neutron 平台則上架到 Microsoft Marketplace。

- Aalo Atomics:某段許可流程加快 92%,估年省 8000 萬美元。

- Southern Nuclear:把 Copilot agents 用於工程與授權流程。

- Idaho National Laboratory:用 AI 組裝複雜工程與安全分析報告。

- Atomic Canyon:Neutron 平台已進入 Microsoft Marketplace。

這些案例不能混著看。Marketplace 上架,和實際營運省下多少時間,完全不是同一件事。內部報告自動組裝,也不等於整個反應爐授權流程已經自動化。

但整體方向很明顯。微軟想吃下雲端層和工作流層,讓核能軟體廠商、開發商和營運商都繞著 Azure 轉。NVIDIA 則補上模擬和 AI 算力。這種組合很合理,因為核能客戶通常要的不是單點工具,而是能治理、能審計、能接既有系統的整包方案。

競品、數據與市場現實

如果把這件事放到更大的市場來看,微軟不是唯一盯上能源和工業 AI 的公司。Google、Amazon、Palantir、Siemens、Bentley、Autodesk,甚至一堆專攻工業軟體的新創,都在搶設計資料、模擬、維運和文件治理這塊。

差別在於,核能的門檻高很多。一般工廠的數位轉型,文件錯一點可能只是返工。核能文件錯一點,可能就是審查延期、成本爆掉,甚至整個案子卡住。所以誰能把 AI 產出和審計需求綁得最緊,誰就比較有機會拿到長約。

微軟這次的優勢,在於它手上已經有 Azure、Copilot、生態系夥伴和企業採購關係。NVIDIA 的優勢則是模擬、GPU 和數位分身。兩家合起來,對核能開發商來說很有吸引力,因為他們不想自己拼一堆散裝工具。

- 微軟:強在 Azure、Copilot、企業採購與資料治理。

- NVIDIA:強在 GPU、模擬、Omniverse、AI 基礎設施。

- Siemens / Bentley:強在工業設計、工程軟體與數位工程流程。

- Palantir:強在資料整合、工作流與高治理需求場景。

如果只看公開數字,目前最亮眼的還是 Aalo 的 92% 和 8000 萬美元。問題是,外界還不知道這 92% 是縮短哪一段流程,原本多久,改完之後還需要多少人工覆核。這些細節很重要,因為核能案子最怕 KPI 漂亮,落地卻不耐看。

另一個現實是,AI 在核能不太可能先從「自主控制反應爐」開始。那太敏感,也太難過審。比較實際的切入點,還是報告組裝、設計驗證、法規對照、時程模擬、維護規劃。這些地方本來就靠大量知識工作,AI 進去比較容易看出效果。

講白了,核能 AI 的第一桶金,不會來自科幻片式的自動駕駛反應爐。比較可能來自幫工程團隊少熬夜改文件,幫法規團隊少做重複比對,幫專案經理少遇到版本地獄。

為什麼現在大家又盯上核能

這波動作背後,還有一個更大的背景:AI 資料中心真的很耗電。大型模型訓練、推論叢集、GPU 伺服器,全都在吃電,而且要的是穩定供電,不是只有白天有、晚上沒有。

所以你會看到科技公司近兩年重新談核能。微軟、Google、Amazon 都在找可長期供應的 firm power,也就是穩定、可預測的電力來源。風電和太陽能很重要,但資料中心需要的是 24 小時都能撐住的基載或接近基載供電。

在這個脈絡下,核能不再只是政策圈的慢題目,而是科技公司的基礎設施題目。誰能讓核能專案更快過審、更快設計完成、更少重工,誰就可能間接影響下一波 AI 基礎建設的速度。

還有一點常被忽略。核能產業的人口結構偏老,很多流程知識掌握在少數資深工程師手上。AI 如果能把這些 know-how 整理成可查詢、可追溯、可重用的資料資產,對組織傳承也有幫助。這部分沒那麼好拿來做行銷,但對企業其實很實在。

接下來該看什麼

我覺得接下來最該看的,不是哪家模型參數更多,而是監管單位買不買單。AI 草擬文件很容易,真正難的是讓監管流程接受 AI 輔助,而且不要因為多了一層 AI,反而增加新的審查摩擦。

第二個觀察點,是案例能不能複製。Aalo 的 92% 如果只適用某一段內部流程,那參考價值有限。如果未來 12 個月內,微軟再拿出 2 到 4 個有外部可驗證的案例,這個類別就會從試點工具,變成核能開發商採購會議上的固定選項。

第三個重點,是資料治理。核能客戶不會只問模型準不準,他們會問版本控管怎麼做、來源怎麼追、誰改過內容、誰批准、怎麼留稽核紀錄。能把這些事情做好,產品才有機會進到正式流程。

如果你在做能源軟體、工業 SaaS,或 AI 工作流產品,我的建議很直接:盯緊 permitting stack。誰能把核能文書做得更快、可追溯、對監管友善,誰就可能比那些只會秀反應爐渲染圖的公司更早賺到錢。

再講白一點,核能現在最缺的,可能不是更多漂亮簡報,而是更少混亂的文件流程。這件事聽起來不浪漫,但通常就是最能省時間、也最能省錢的地方。