多模態 MoE 為何會分心

這篇研究指出,多模態 MoE 不是只卡在看圖,而是路由把輸入送錯專家。作者提出 routing distraction,並用路由引導介入提升 domain expert 啟動與推理表現。

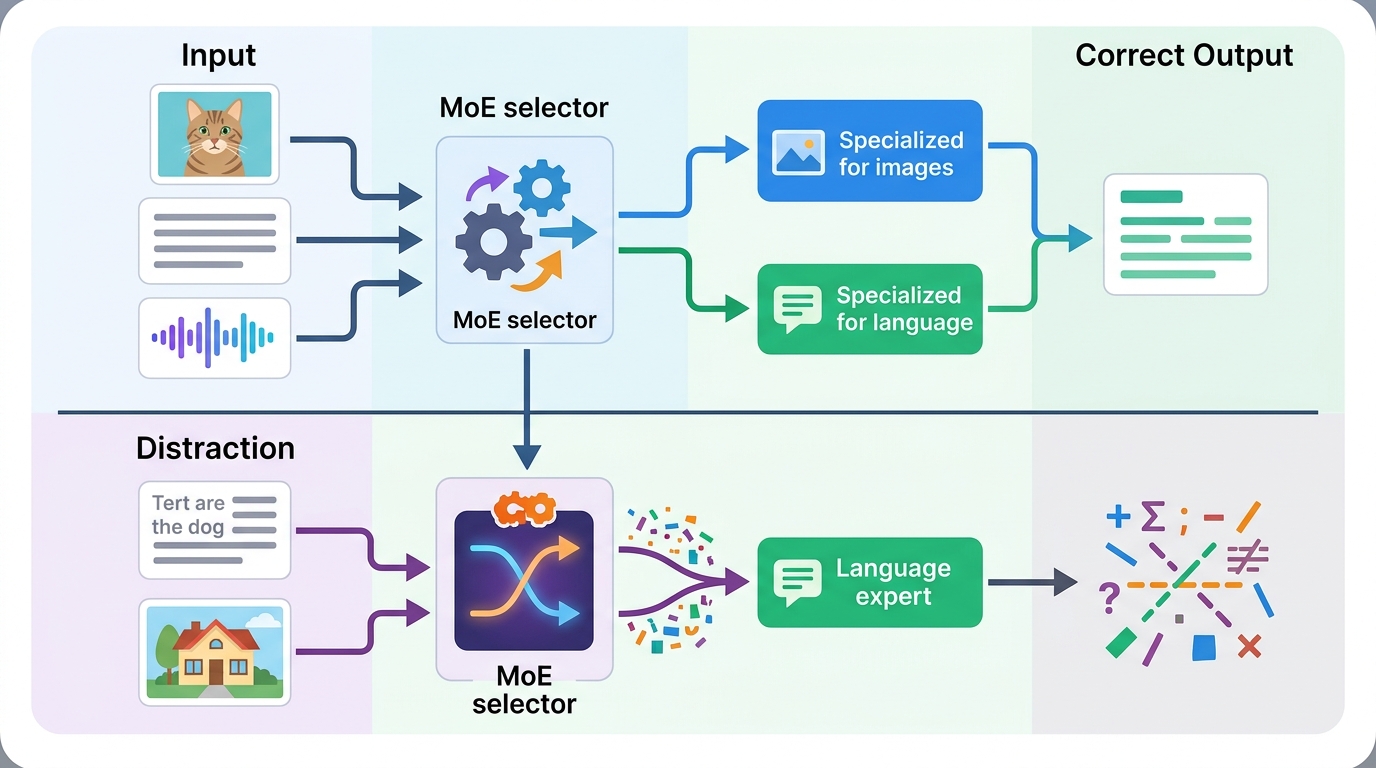

多模態 MoE 模型常見一種很怪的失誤:圖看得懂,推理卻答錯。Seeing but Not Thinking: Routing Distraction in Multimodal Mixture-of-Experts 這篇 arXiv 研究,重點不是在說影像和文字語意對不對得上,而是把矛頭指向「路由」:當輸入變成圖片時,模型內部的 expert 選擇可能被帶偏,沒有把計算送到真正負責推理的專家上。

這個觀點很實用。因為在開發 vision-language 系統時,大家常先懷疑感知能力不夠、對齊不穩,或 prompt 寫得不好。但這篇論文提醒一件事:有些情況下,模型不是「看不懂」,而是「看懂了還是走錯內部路徑」。

對台灣開發者來說,這代表 debug 的方向要更細。當同一個問題用純文字可以答對,換成圖片就掉分,瓶頸不一定在影像編碼器,也可能在 MoE 的 routing 機制本身。這是多模態系統很容易被忽略的痛點。

這篇論文在解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

論文先抓出一個具體失敗模式:多模態 MoE 模型雖然能正確辨識圖像內容,但接下來的推理步驟卻常常失手。作者把這種現象稱為「Seeing but Not Thinking」。意思很直白,就是模型有看到,卻沒有真的想。

作者認為,過去很多分析會把焦點放在影像和文字表示是否對齊。但這篇研究說,問題不只在語意對齊。即使跨模態語意共享存在,模型仍可能在圖像輸入時表現變差。也就是說,語意層面看起來沒壞,內部計算路徑卻已經歪掉。

這種問題在產品場景裡很麻煩。因為同一個任務,文字版和圖片版會出現不同答案,讓系統行為變得不穩定。對使用者來說,這會像是模型「突然變笨」;對工程團隊來說,則是很難單靠 prompt 或資料清洗就修好的問題。

方法到底怎麼運作

這篇論文的做法不是單純看最終準確率,而是分析 multimodal MoE 在各層的 routing 行為。作者先確認一件事:跨模態語意共享確實存在。這一步很關鍵,因為它先排除了「圖片和文字根本不在同一個語意空間」這種最直覺的解釋。

接著,研究者去看不同 expert 在各層被啟動的情況。他們發現,視覺專家和 domain expert 之間有明顯分工,而圖片輸入會在中間層造成和文字輸入不同的 routing 走向。問題就出在這裡:中間層正是 domain experts 集中的地方,但圖片進來時,模型沒有穩定把訊號送過去。

作者因此提出「Routing Distraction」假說。白話講,就是模型的 router 被模態本身分心了。當輸入是視覺訊號時,路由機制沒有充分喚起那些真正需要用來推理的 expert,結果就是看圖的能力還在,思考的能力卻沒被正確調起來。

為了驗證這個假說,論文設計了一個 routing-guided 的介入方法。摘要只說這個方法能提高 domain expert 的啟動比例,沒有公開更細的實作流程,所以比較保守的解讀是:它是透過引導 router,把計算往推理專家那邊推,而不是去改變任務本身或直接動影像內容。

論文實際證明了什麼

作者把方法放到三個 multimodal MoE 模型上測試,總共跑了六個 benchmark。這代表觀察到的現象不是只出現在單一架構或單一資料集上,至少在這個研究範圍內,routing distraction 具有一定的可重現性。

不過,摘要沒有公開完整 benchmark 名稱,也沒有列出每個任務的詳細分數。所以就這份原始資料來看,我們只能確認它有做跨模型、跨任務的評估,不能補寫成某些特定 benchmark 的表現細節。

研究給出的主要結果是:routing-guided 介入能帶來一致改善,在複雜視覺推理任務上,最高提升到 3.17%。這個數字很重要,因為它不是只說「有變好」,而是明確指出改善幅度確實存在。不過論文也沒有說每個 benchmark 都同樣受益,因此比較合理的說法是:整體趨勢一致,但幅度會依模型與任務而變。

另一個有意思的結論,是作者認為 domain expert identification 捕捉到的是 cognitive functions,而不是 sample-specific solutions。這句話換成白話,就是這些 expert 看起來不像只記住某一題的答案模板,而比較像是代表某種可重用的推理角色。這會讓 routing 分析不只是「看模型在哪裡活化」,而是有機會看出它內部到底是怎麼分工思考的。

這也解釋了為什麼作者會強調,視覺輸入造成的不是單純感知失誤,而是推理路徑被干擾。模型不是完全沒有能力,而是能力沒有被送到對的地方。

對開發者有什麼影響

如果你在做多模態助理、文件理解、圖像問答或 vision-language agent,這篇研究提供了一個很實際的 debug 視角。當模型在文字情境下表現正常,但換成圖片就開始失常,原因不一定是 perception 不夠好,也可能是 routing 沒有把輸入導到適合推理的 expert。

這會直接影響你怎麼排查問題。以前可能先看影像編碼器、資料標註、對齊損失,或是 prompt 是否清楚;但這篇論文提醒,還要看 expert activation 有沒有因為模態切換而改變。也就是說,模型的內部選路,可能就是掉分的根源。

對 MoE 架構來說,這是一個很重要的設計提醒。若系統的目標不只是「看懂」,而是要「看懂後會推理」,那 router 本身就不該只是被動分配流量,而應該被明確引導,讓視覺輸入也能喚起 domain experts。這篇論文的介入方法,就是在朝這個方向做。

從工程角度看,這也意味著 expert selection 本身可能是一個 first-class optimization target。不是只有模型大小、資料量、或單一模態編碼品質重要,路由策略也可能決定最後的實用性。尤其在多模態應用裡,使用者常常不在乎模型內部怎麼分工,只在乎同一件事用文字和圖片輸入時,答案能不能一致。

- 圖片可能改變 routing 行為,即使跨模態語意共享存在。

- 推理失敗不一定是感知差,也可能是 expert 選錯。

- domain expert 的活化可以反映較抽象的 cognitive function。

- 要改善多模態推理,可能得直接調 router,而不只是放大模型。

限制與還沒回答的問題

這篇研究的方向很清楚,但摘要沒有給出完整的工程細節。像是 routing-guided 介入到底怎麼做、實驗設定怎麼安排、六個 benchmark 分別是什麼,原始摘要都沒有交代。所以如果你想直接把方法搬進 production,還需要看完整論文才知道可不可行、成本高不高。

另外,研究雖然測了三個 multimodal MoE 模型,但這還不能直接推論到所有多模態架構。它比較像是對這一類模型提出強證據,而不是宣告一條普遍定律。不同模型的 routing 設計、expert 配置和訓練方式都可能不一樣,結果未必完全相同。

還有一個實務問題摘要沒有回答:如果你刻意提高 domain expert 的啟動,會不會反過來傷到某些真的需要視覺專精的任務?這種 trade-off 在真實系統很重要,因為你不會只想讓某一類問題變好,卻讓其他輸入型態變差。但這篇摘要沒有提供這方面的資訊。

即便如此,這篇論文的核心訊息仍然很有價值。多模態 MoE 裡的問題,可能不是「看」和「想」各自出了什麼大錯,而是中間那個路由步驟把訊號帶偏了。對開發者來說,這提醒我們:當模型看起來懂圖卻答不對時,先別急著只怪感知層,router 也可能才是真正的瓶頸。