為什麼 OpenAI 的 cyber model 會比 Anthropic 的…

OpenAI 把 GPT-5.5-Cyber 做成受限的實用資安工具,這比追求更大範圍的自治更正確,也更可能先做出真正有用的產品。

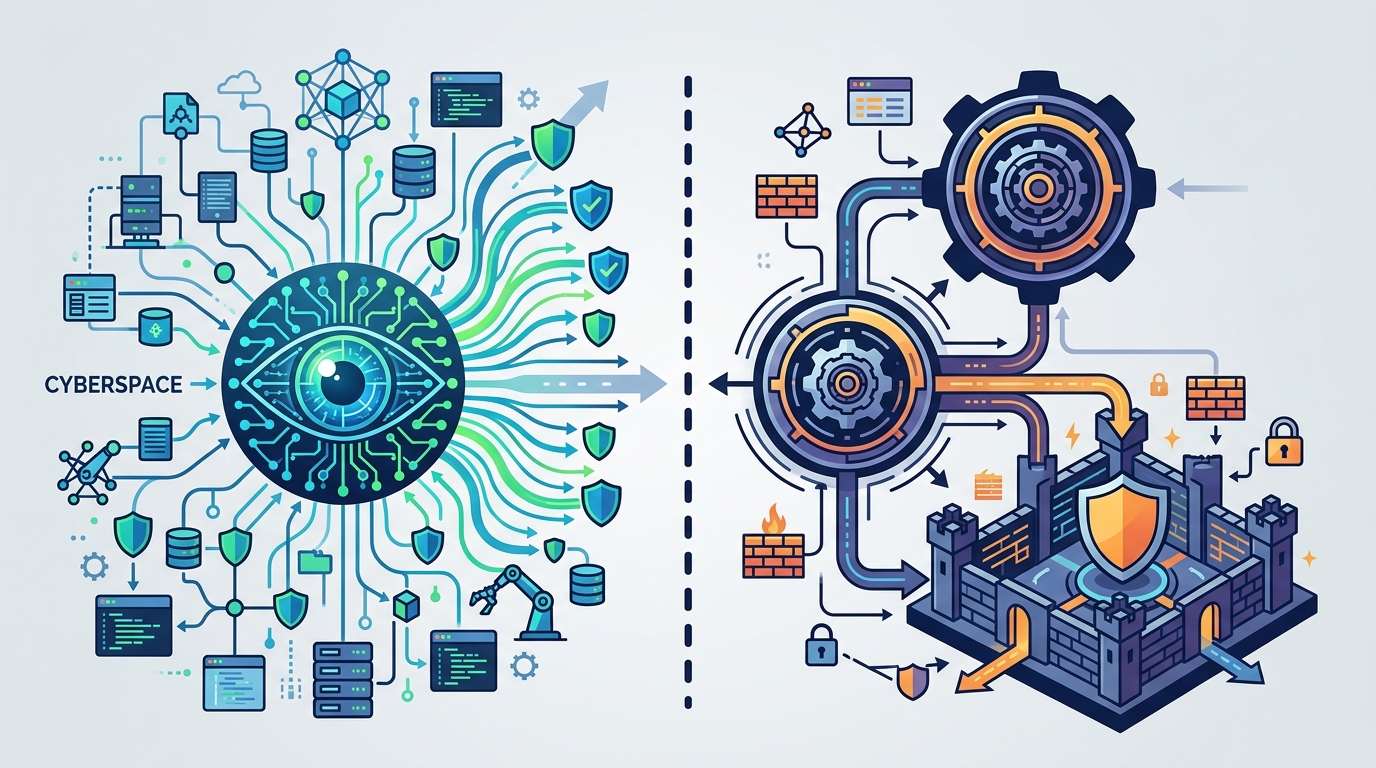

OpenAI 的 GPT-5.5-Cyber 是一個受限的資安工具,重點在協助可信任專業者找出並修補漏洞。

OpenAI 這次把 GPT-5.5-Cyber 做成只給受審核資安專業人士使用的工具,是對的。資安產品最先需要的不是全民可用,而是可控、可稽核、能直接進工作流。Politico 的報導指出,這個模型初期只開放給經過驗證的資安專業人士,目標是協助找出並修補資安問題。這種產品形狀才符合現實:在資安領域,存取控制不是附加功能,而是產品本體。

第一個論點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

資安模型先求窄分發,再求大規模,這不是保守,而是產品基本功。能協助找漏洞、分析設定、修補風險的模型,如果一開始就對所有人開放,等於同時降低防守與攻擊的門檻。OpenAI 先鎖定 vetted users,代表它承認這類工具的價值建立在責任鏈上,而不是單純的可用性上。

過去業界已經看過太多反例。許多通用模型一開始先衝曝光與規模,之後才補 guardrails、權限、審計紀錄,結果是安全團隊先被迫承擔風險,再慢慢修洞。資安產品不能走這條路,因為一次錯用就可能造成真實損害。若模型能幫忙 triage、patch recommendation、弱點驗證,那它從第一天就該被放進受控環境,而不是先公開再補救。

第二個論點

這場競爭真正比的不是誰回答得更像樣,而是誰能拿下安全團隊的工作流。OpenAI 若能讓分析師在同一介面裡完成告警判讀、根因分析與修補建議,它得到的不是一個 benchmark 勝利,而是一個工作入口。安全團隊買的是時間,不是 demo。

「find and patch」這個定位很關鍵,因為多數資安工具只停在偵測或解釋。真正的價值在於把流程閉環:找出問題、驗證風險、提出修補方式、把下一步交給人。根據 IBM 近年的資安成本研究,資料外洩的平均成本已經高到數百萬美元等級,團隊最缺的不是更多警報,而是更快把警報變成可執行修補。能參與這個閉環的模型,才有機會成為安全團隊的作業系統。

反方可能怎麼說

最強的反對意見是:受限發佈會拖慢採用,讓更敢推廣的競爭者先拿走市場。資安團隊本來就忙,若工具部署複雜、可用人數少、擴散速度慢,即使模型很強,也可能因為價值證明太慢而失去機會。

另一個合理疑慮是,「只給 vetted professionals」可能只是包裝成安全的行銷話術。如果底層只是一般大模型外加 cyber 標籤,那限制存取只是在做姿態。真正能贏的,會是那些把權限、稽核、日誌、工作流整合做扎實的產品,而不是只會強調自己很謹慎的模型。

這些批評成立,但不足以推翻 OpenAI 的路線。資安市場本來就把信任、來源、權限當成產品功能,而不是流程負擔。OpenAI 不需要第一天就拿下所有人,它需要先在真正能驗證模型的人手上證明自己。若 GPT-5.5-Cyber 真的能穩定找出並修補問題,受限發佈反而是優勢,因為它同時降低濫用風險,也提高早期回饋品質。

你能做什麼

如果你是工程師、PM 或創辦人,做資安 AI 產品時不要先追求最大曝光,而要先設計可控的有效性。從一開始就內建存取控制、審計紀錄、角色權限與 human-in-the-loop 流程,先解決一個高痛點任務,像是弱點 triage、修補建議或設定檢查,證明它真的能讓團隊更快、更準、更可追蹤,再談擴大開放。在資安裡,信任不是 go-to-market 手段,信任就是產品。