2026 年企業 AI 為何更靠 RAG

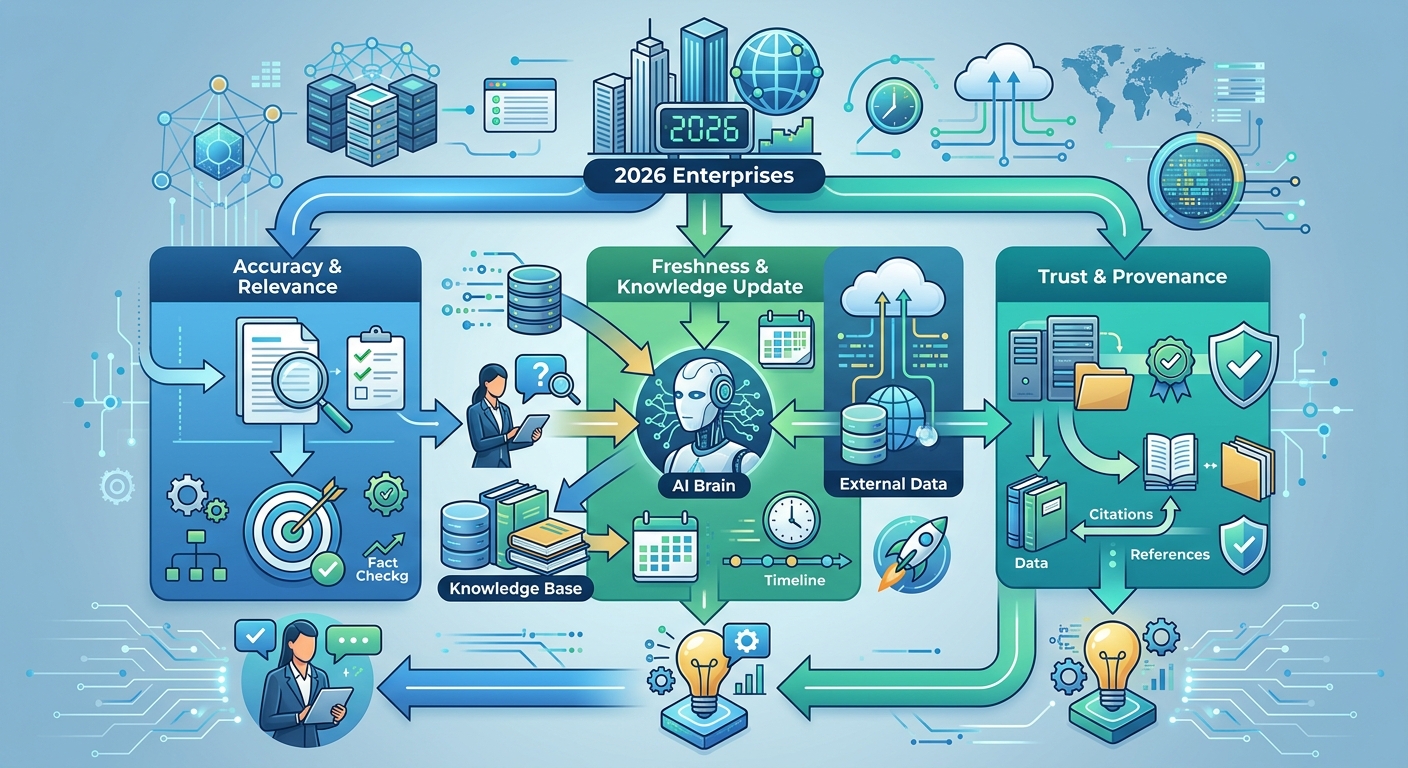

RAG 已從展示用技術走進企業預算。原因很直接:公司要的是能讀取最新內部資料、可追溯、可控權限的 AI,而不是只會背舊訓練資料的聊天模型。到了 2026 年,真正有用的重點在檢索品質、權限治理、即時資料連接與合規設計。

RAG,也就是 retrieval-augmented generation,現在已經不是拿來 demo 的花招。它開始變成企業 AI 專案裡,真的要編預算的那一層。講白了,企業要的不是會聊天的 LLM,而是能根據最新內部資料回答問題的系統。

Squirro 對 2026 年的看法很直接。企業 AI 的難題,不在模型會不會寫漂亮句子,而在答案能不能跟上今天的政策、今天的庫存、今天的合約版本。這件事靠重新訓練模型,通常很慢,也很貴。

所以 RAG 變成熟,不是因為概念更新鮮。是因為它更符合企業資料運作方式。內規可能每週改一次,產品文件可能每天更新,法遵團隊還要求每個答案能追來源。這些需求,剛好都是 RAG 比純模型更適合處理的地方。

為什麼單靠 LLM 在公司裡常出包

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

基礎 LLM 很會寫。它能摘要政策、回客服問題、整理會議內容。問題出在你要求它回答「昨天剛改過的規則」時,它很可能還活在舊世界。

原因不複雜。訓練資料是靜態的,企業知識是動態的。模型再大,也不可能每天重訓一次來追公司內部變化。說真的,這在實務上根本不划算。

RAG 的做法比較務實。先找文件,再生成答案。也就是先從內部文件、資料庫、知識庫抓到相關內容,放進 prompt 裡,接著讓模型根據這些上下文回答。這樣至少不是純靠記憶亂猜。

但很多人把 RAG 想得太簡單,以為「向量搜尋加 LLM」就結束了。其實差得遠。真正影響答案品質的,常常是前面那堆看起來很無聊的資料工程細節。

- 資料匯入要接文件、郵件、資料庫、聊天紀錄等來源。

- 前處理要去重、清洗格式、修掉雜訊。

- Chunking 要切得剛好,太大太小都會出事。

- Embedding 要能保留語意,不然找不到重點。

- Indexing 要夠快,不然線上查詢延遲會爆。

- Metadata 要完整,像作者、日期、部門、分類。

- 權限模型要跟原系統同步,不能亂漏資料。

- 檢索品質要持續驗證,不是上線一次就算了。

這些東西聽起來很工程。可是一個 chunk 切錯,可能就把最重要的那段條文埋掉。Metadata 少一欄,系統可能把 2024 年的政策拿來回答 2026 年的問題。

更麻煩的是權限。如果檢索層沒做好 ACL,同一個提問,不同角色本來就該看到不同答案。企業 RAG 的核心,其實不是 prompt 技巧,而是資訊架構夠不夠紮實。

到了 2026 年,RAG 變了什麼

2024 年很多人談 RAG,重點都放在降低 hallucination。到了 2026 年,大家比較清楚了:只靠基本版 RAG,還是不夠。高風險場景需要更穩定的檢索、更明確的規則,還有更少的即興發揮空間。

新一代做法,是在檢索和生成外面再包一層結構。不是把所有希望都丟給模型,而是把關係、分類、限制條件先整理好。這也是為什麼 GraphRAG 這類方法開始被企業拿來認真評估。

GraphRAG 把向量搜尋和 taxonomy、ontology、knowledge graph 結合。簡單說,系統不只知道哪些文字看起來像,也知道實體之間有什麼關係。像是某產品線屬於哪個事業部、某政策適用哪個地區、兩個不同部門的術語其實在講同一件事。

“The hottest new programming language is English.” — Andrej Karpathy

Karpathy 這句話是 2023 年講的,到現在還是很準。如果英文真的成了操作軟體和資料的介面,那檢索層就是安全閥。模型講得再流利,抓錯資料,一樣會害人。

Squirro 也提到另一個重點,就是 guardrails 要直接放進生成流程。這代表 prompt 和輸出內容,都得經過角色權限、政策限制、法務要求、品牌規範等檢查。對銀行、保險、醫療、製造這種產業來說,這不是加分題,是基本門檻。

- GraphRAG 強調關係理解,不只比對相似文字。

- Guardrails 直接卡在流程裡,不是事後補救。

- 檢索需要更穩定,不能每次問都飄來飄去。

- 高風險場景重視可解釋性與來源追蹤。

你可能會想問,這樣會不會很複雜?答案是會。可是企業本來就複雜。拿消費級聊天機器人的玩法,硬套到法遵和內部知識管理,通常都會撞牆。

企業真正在意的功能,不是聊天介面多漂亮

現在 AI 平台的行銷資料很多。每家都說自己快、準、聰明。可是真正有營運價值的功能,其實很少,而且都很務實。

第一個是 knowledge graph。Squirro 提到,當 taxonomy 和 ontology 整理得夠好時,graph-powered retrieval 的搜尋精準度最高可到 99%。這數字當然要看資料治理成熟度,但方向很清楚:如果資料關係能明確表示,檢索就不只靠語意相似碰運氣。

第二個是直接讀取 operational data。很多企業 AI 到現在還在吃快照資料,像昨天匯出的 CSV、上週同步的 CRM、每月一次的 ETL。這種架構做報表還行,拿來做即時助理就很尷尬。

第三個是模型彈性。2024 年綁死單一供應商的團隊,後來不少都後悔。價格、延遲、資料外流風險、地端部署需求,這些變化都很快。檢索層如果能跟不同 LLM 配合,採購和架構才有轉身空間。

- Knowledge graph:適合處理部門術語不一致、實體關係複雜的場景。

- 即時資料連接:透過 API 直接讀取結構化資料,比等批次同步更實用。

- 模型可替換:可依價格、延遲、安全需求切換 GPT、Claude 或本地模型。

- 部署彈性:地端、私有雲、混合雲、air-gapped 都有企業需要。

- 存取控制:ACL、RBAC、audit trail 缺一個都麻煩。

我覺得最容易被低估的,是即時資料連接。因為很多團隊還停在「把知識庫餵進去」這一步,卻忘了企業很多關鍵答案根本不在 PDF 裡,而在 ERP、CRM、工單系統、訂單系統裡。

另一個現實是,模型本身越來越像可替換零件。今天某個模型每百萬 Token 便宜 40%,明天另一個模型在延遲上少 30%。如果你的整套系統全綁在單一模型家族,後面調整成本會很高。

RAG 跟 fine-tuning,到底怎麼選

很多企業一開始碰到知識準確度問題,直覺反應就是 fine-tuning。這做法不是完全不行,但常常用錯地方。若你要的是最新事實,fine-tuning 往往不是最省錢的答案。

fine-tuning 比較適合固定任務。像分類、抽取、固定格式寫作、客服回覆語氣控制,這些都很適合調整模型行為。可是如果底層事實天天變,重訓就像一直追著資料跑,跑不完。

RAG 的優勢在於資料一更新,理論上檢索層就能立刻用到。你不用等下一輪訓練。也比較容易附上來源連結,讓使用者自己核對。對法遵、採購、客服、內部 IT 支援這些場景,這差很多。

- 資料新鮮度:RAG 可在來源更新後立刻反映,fine-tuning 反應慢。

- 成本結構:fine-tuning 吃算力與維運,RAG 偏向索引與檢索成本。

- 可追溯性:RAG 能附 citation,fine-tuning 很難指出來源。

- 安全性:RAG 可在查詢時套用文件級權限,fine-tuning 若處理不當,敏感資訊可能混進模型行為。

- 可攜性:檢索層做得好,換模型相對容易;fine-tuning 常綁特定模型家族。

如果硬要用一句話總結,我會說:需要最新資料時,先想 RAG;需要固定行為時,再看 fine-tuning。兩者不是互斥,而是分工。

實際上,最穩的企業架構通常是混搭。RAG 負責抓最新事實,小型調校模型負責特定任務,外面再包政策檢查、權限控制、輸出過濾。這比聊天 demo 複雜很多,但比較像真實上線環境。

這裡還有一個採購上的現實。若你把所有知識問題都丟給大型模型重訓,成本很容易失控。反過來說,把大部分知識更新交給檢索層,再把高價模型留給少數高價值步驟,帳會好看很多。

背後其實是企業資料治理問題

RAG 之所以在 2026 年更重要,還有一個根本原因:多數企業的資料環境本來就很亂。文件散在 SharePoint、Confluence、雲端硬碟、客服系統、郵件、資料庫。格式不一,命名混亂,版本滿天飛。

過去這些問題可以先擺著,因為搜尋不好用,大家還是靠同事口耳相傳。現在企業想讓 AI 直接回答問題,這些舊帳就全冒出來。你資料治理差,RAG 就會把混亂放大,而不是自動幫你修好。

所以很多團隊做到最後會發現,最花時間的不是選 GPT 還是 Claude,也不是 embedding 模型要哪一家。最花時間的是清來源、補 metadata、定權限、整理 taxonomy、建立評測集。這聽起來很土,但真的有用。

接下來要看什麼

到了 2026 年,問題已經不是「要不要用 RAG」,而是「你的檢索層夠不夠格進正式環境」。如果你今年在評估企業 AI,我建議直接問供應商四件事:檢索精準度怎麼量、權限怎麼同步、答案能不能附來源、能不能連即時資料。

如果對方一直講模型參數、聊天介面、Agent 會不會自動做事,卻講不清楚 retrieval precision、ACL、audit trail、資料更新延遲,那就要小心。因為真正決定員工敢不敢信任答案的,通常不是模型多大,而是後面的資料層多扎實。

我自己的判斷是,接下來 12 個月,受監管產業的採購團隊會把檢索品質和權限控制,排在純模型 benchmark 前面。這很合理。模型答對 85% 的公開題目,跟它能不能安全回答你公司內部問題,根本是兩回事。

如果你正在做內部知識助理,先別急著追最新模型。先把資料來源、metadata、權限同步、評測流程補起來。這些做好後,你再換模型,效果通常都看得到。反過來做,常常只是把錯答案講得更順而已。