RefDecoder 讓影片解碼器吃參考圖

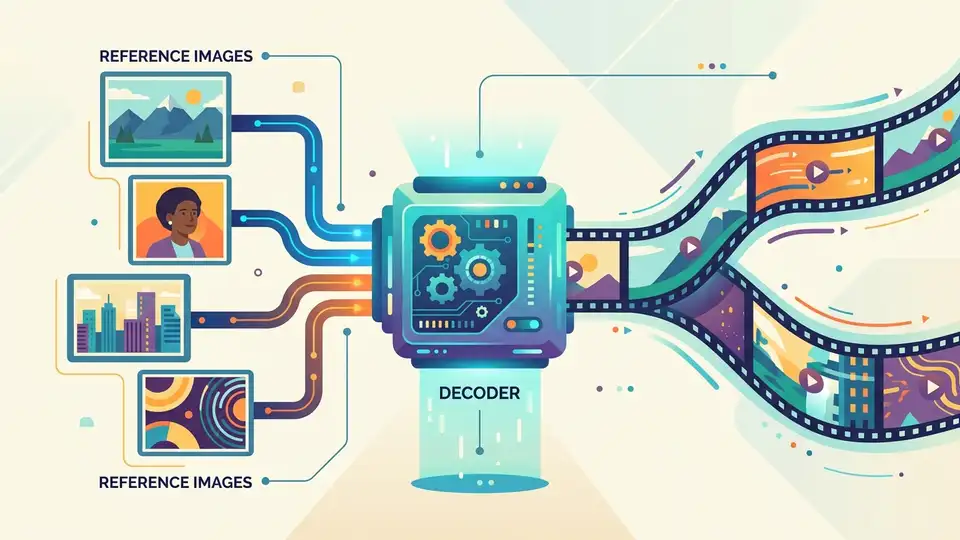

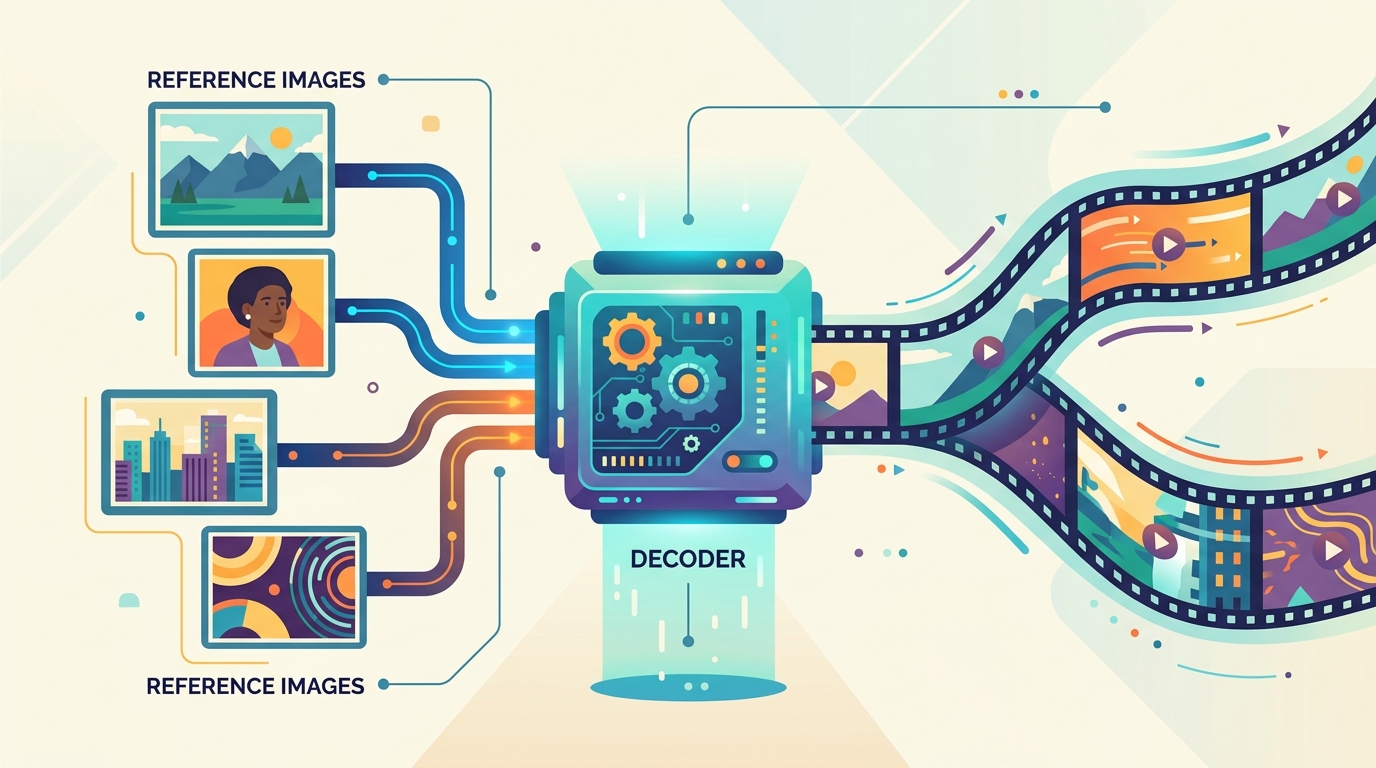

RefDecoder 把參考圖直接送進影片解碼器,補上傳統流程只在去噪端做條件控制的缺口,目標是提升重建細節、一致性與可用性。

RefDecoder 讓影片解碼器直接參考輸入影像,改善重建細節與畫面一致性。

在影片生成和編輯流程裡,條件訊號通常集中在去噪網路,真正把 latent 還原成畫面的 decoder 卻常常是無條件的。這篇論文認為,這種設計落差,正是生成影片容易丟細節、也容易在重建時偏離原始影像的原因之一。

作者提出的解法叫 RefDecoder。它不是去重寫整個影片生成系統,而是把參考影像直接注入解碼路徑,讓 decoder 在還原畫面時也能看到高保真 reference frame。對做 image-to-video、影片編輯,或任何需要貼近原圖的工作流來說,這種做法很實際:不用整套重訓,也有機會把輸出品質往上拉。

這篇在修哪個痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這篇論文盯上的,是目前影片生成堆疊裡一個很典型的結構問題。latent diffusion 類方法通常會把大部分條件控制放在 denoising network,讓模型在去噪時盡量遵守輸入影像或提示詞;但到了 decoder 這一步,條件訊號卻常被拿掉。

問題就在這裡。decoder 才是把細節真正補回來的地方。如果這一段不看 reference,它就只能靠 latent 自己猜,結果常見的就是結構變形、紋理糊掉,或是和原始影像的內容慢慢走樣。論文把這種不對稱視為 detail loss 和 inconsistency 的來源。

RefDecoder 的目標,就是把這個缺口補起來。它不把 decoding 當成單純的還原步驟,而是把參考影像當成 decoder 的一部分輸入,讓還原過程一路都能對照原圖。

RefDecoder 怎麼做

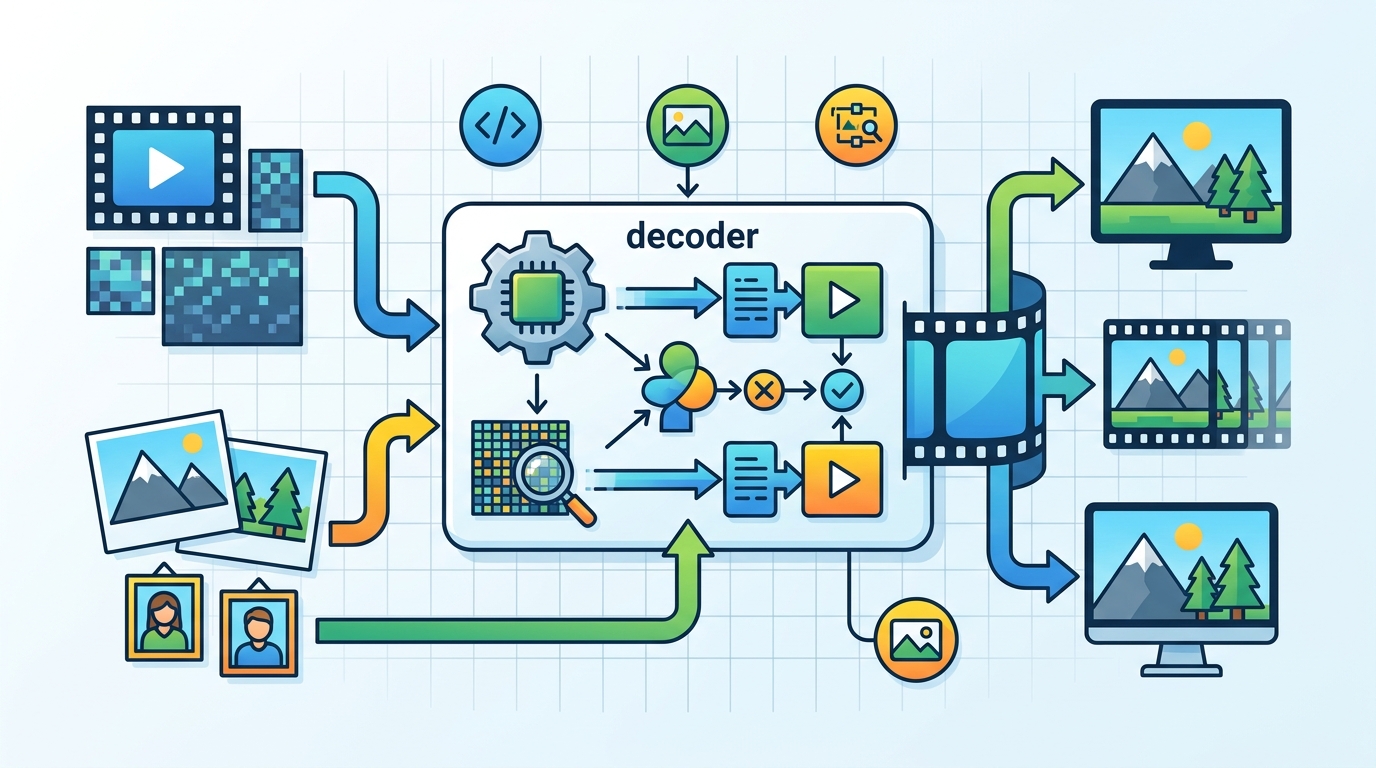

它的核心概念其實很直白:在 denoised video latents 之外,再把 reference image 一起送進 decoder。論文使用的是 reference attention,讓 decoder 在每個 up-sampling stage 都能同時處理兩種訊號。

更具體一點,系統先用一個輕量的 image encoder,把參考影像轉成高維 tokens。接著,這些 tokens 會和影片 latent tokens 在 decoder 裡合併。這樣一來,decoder 在補細節時不是只靠 latent 猜測,而是有原始 reference 可以對照,能更穩定地恢復結構與紋理。

這個設計的重點,是它把改動侷限在 decoder 端。論文明講,RefDecoder 可以直接插進既有的影片生成系統,而且不需要額外 fine-tuning。這代表它比較像一個可替換元件,而不是要你把整條訓練管線砍掉重來。

對工程團隊來說,這種局部升級很有吸引力。你可以保留原本的 latent video generator,只調整最後的解碼階段,先看畫質和一致性有沒有改善,再決定要不要進一步改架構。

論文實際證明了什麼

根據摘要,作者把 RefDecoder 放到多個 decoder backbone 上測試,包括 Wan 2.1 和 VideoVAE+,結果都看到一致改善。這表示方法不是只對單一架構有效,而是有一定的可移植性。

論文也提到,它在多個 reconstruction benchmarks 上表現更好,包括 Inter4K、WebVid 和 Large Motion。不過摘要沒有公開完整 benchmark 表格,所以目前能確認的只有這些資料集名稱與整體趨勢,細部數字沒有完整展開。

摘要裡唯一明確的量化數字,是相較於 unconditional baselines,PSNR 最多提升 +2.1 dB。PSNR 是重建品質常看的指標,這個結果代表 RefDecoder 在像素層級上更能貼近 reference input,也就是說畫面更不容易在還原時失真。

除了重建,作者也說它在 VBench I2V 上有更好的成績,尤其是在 subject consistency、background consistency 和 overall quality 這幾項。這點很重要,因為 image-to-video 不只是要單張帧清楚,還要讓主體和背景在時間上維持穩定。

另外,論文還提到 RefDecoder 能 generalize 到 style transfer 和 video editing refinement。這表示它不只是一個單一任務的小技巧,而是可能對多種需要保留來源內容的影像生成任務都有幫助。不過摘要沒有提供這些延伸場景的獨立數字,所以目前只能把它視為能力上的延伸,而不是已被完整量化的結論。

- 可套用到 Wan 2.1、VideoVAE+ 等不同 decoder backbone

- 在 Inter4K、WebVid、Large Motion 上都有改善

- PSNR 最多提升 +2.1 dB

- VBench I2V 的 subject consistency、background consistency、overall quality 也更好

- 宣稱可直接替換進既有系統,不需要額外 fine-tuning

對開發者有什麼影響

如果你在做影片生成、image-to-video,或是影片編輯工具,這篇論文的訊號很明確:decoder 不是只是把 latent 轉成像素的最後一步,它本身就是影響品質的關鍵位置。很多團隊會把注意力放在 denoiser 或 prompt conditioning,但這篇提醒你,最後的重建階段也一樣重要。

這對需要高度貼近來源影像的工作流特別有用。像是產品展示、角色動畫、style transfer、影片修飾這類場景,只要結構或背景有一點偏差,使用者就會很快看出來。RefDecoder 的思路,是把 reference 直接帶進最後一段,降低這種偏移。

另一個實務優點,是它主打不用額外 fine-tuning。對工程團隊來說,這意味著可以先把它當成 decoder-level 的替換方案來評估,而不是先投入大規模重訓成本。若現有系統已經穩定,這種 drop-in 式的改動通常更容易進行 A/B 測試。

但這篇摘要也留下不少工程面問題。它沒有提到 runtime cost、記憶體開銷、延遲影響,也沒有說 reference attention 會不會讓推論更重。對實際部署來說,這些資訊很關鍵,因為畫質提升如果換來太高成本,未必適合線上服務。

摘要也沒有把所有 benchmark 的完整數字公開,所以目前只能看出方向是正面的,還不能直接推論它在每個資料分佈上都同樣有效。實作上,團隊還是得用自己的內容分佈去驗證,尤其是主體類型、動作幅度、背景複雜度不同時,效果可能會有差。

這篇論文真正的意義

RefDecoder 的價值,不在於它提出了一個很複雜的新生成框架,而在於它指出一個常被忽略的事實:條件控制如果只做一半,最後的 decoder 還是會把資訊弄丟。把 reference conditioning 往後推到解碼端,可能就是補上畫面一致性的關鍵一步。

對台灣開發者來說,這類研究很值得注意,因為它比較接近「怎麼把現有系統做得更穩」而不是「重新發明一套模型」。如果你已經在用 latent video generation 流程,這種局部模組升級的思路,往往比全面重建更容易落地。

總結來看,RefDecoder 想解決的是影片生成裡的最後一哩路問題:不是讓模型更會猜,而是讓它在把畫面還原出來的那一刻,還記得原圖長什麼樣。對重建、編輯和 image-to-video 來說,這個差異可能比想像中更大。