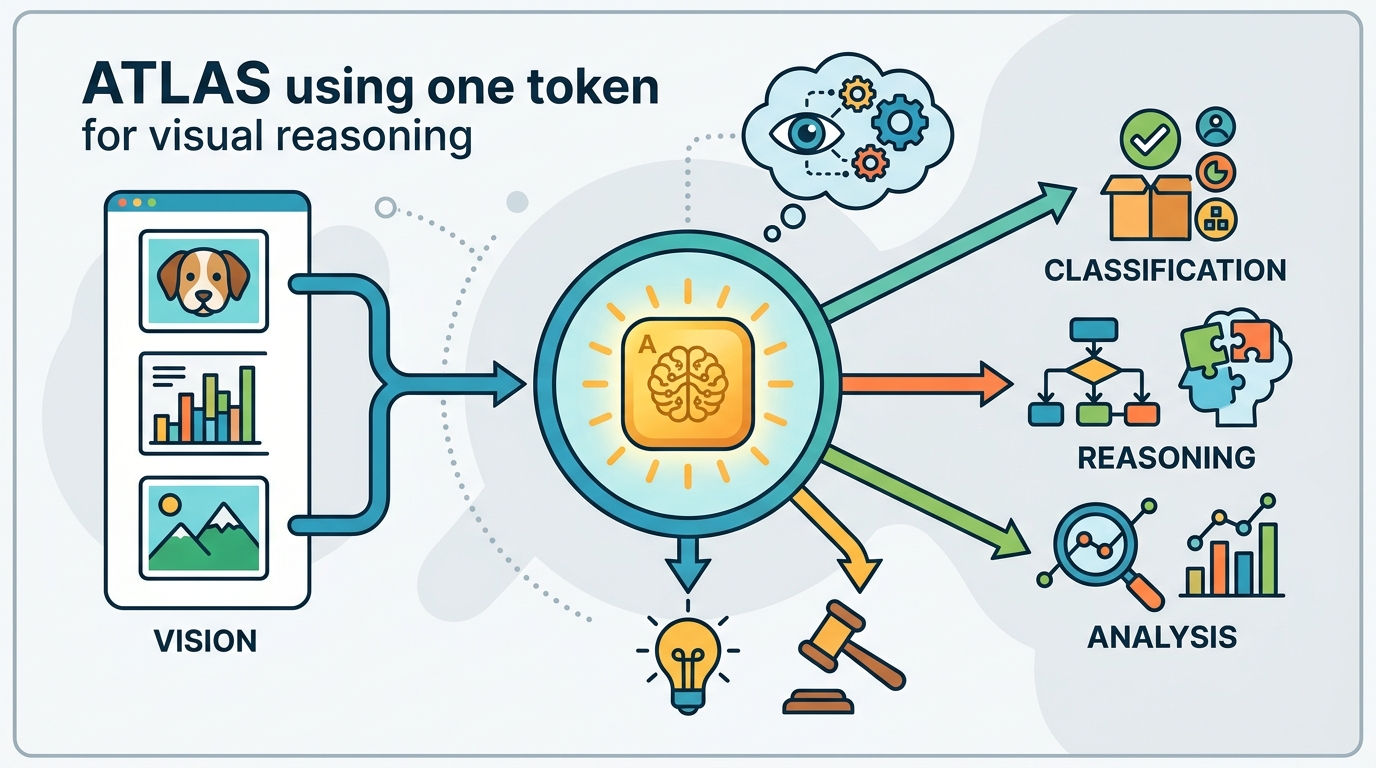

ATLAS 用一個 token 做視覺推理

ATLAS 提出用單一離散 token 同時承擔 agentic 與 latent 視覺推理,想降低中間步驟成本,並維持標準 next-token 訓練流程。

ATLAS 用一個離散 token,把 agentic 和 latent 視覺推理合在一起,想減少中間步驟成本。

ATLAS: Agentic or Latent Visual Reasoning? One Word is Enough for Both 盯上的,是多模態模型裡一個很實際的痛點:視覺推理一旦牽涉到中間狀態,系統就容易變得又重又難訓練。你可能要讓模型吐出中間影像、呼叫外部工具,或在隱藏空間裡維持一串 latent 狀態。這篇論文的主張很直接:不一定要為每種推理方式都做一套機制,或許一個 token 就夠了。

這個想法的重點,不是把模型變得更會講話,而是把視覺推理壓縮成更乾淨的介面。對開發者來說,這種設計如果真的站得住腳,代表模型可以少吐很多冗長的中間內容,也不用為了視覺推理另外拉一條複雜管線。更重要的是,它希望維持標準的 next-token prediction 形式,不必為了新的推理模式改掉整個訓練框架。

這篇論文想解什麼問題

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

論文先把視覺推理拆成兩條常見路線。第一條是 agentic reasoning,也就是透過程式碼或工具呼叫來做推理。第二條是 latent reasoning,讓模型在可學習的隱藏嵌入裡處理視覺資訊。兩種做法都能做事,但代價不一樣,而且各自有明顯缺點。

agentic 路線的問題,主要是 context-switching latency。因為它要依賴外部執行,所以模型和工具之間來回切換會拖慢速度。latent 路線則避開了外部執行的開銷,但論文指出它常常缺乏任務泛化能力,而且在 autoregressive parallelization 的訓練方式下不太好搞。至於直接在統一模型裡生成影像,論文也把它描述成計算成本高、架構上也不簡單。

ATLAS 要處理的,就是這種「每條路都能走,但每條路都不夠順」的狀況。它不是再加一個新的推理模組,而是把一個離散詞元當成共同單位,讓同一個 token 同時扮演 agentic 操作與 latent 視覺推理單元。這個方向很像是在問:如果最後都要進到 token 流裡,能不能乾脆把推理也收斂到 token 層級?

ATLAS 的方法到底怎麼運作

ATLAS 的核心概念叫做 functional token。你可以把它想成 tokenizer 字典裡的一個標準 token,但它不只是文字單位,還內含一個視覺操作。論文的說法是,這個 token 可以同時對應 agentic operation 與 latent visual reasoning unit,也就是說,一個 token 可以同時承擔「動作」和「隱藏式視覺運算」兩種角色。

這裡最關鍵的地方,是它仍然走一般的 next-token prediction。換句話說,模型不需要一條特殊的解碼路徑,也不需要為了這種推理方式另外設計一個全新的架構。論文強調,這讓它能和 vanilla 的 scalable supervised fine-tuning,以及 reinforcement learning 相容,而且不用做架構或方法上的修改。這點對工程實作很重要,因為很多多模態新方法最後卡住的不是效果,而是怎麼塞進既有訓練流程。

另一個值得注意的地方,是這些 functional tokens 不需要 visual supervision。這代表訓練資料不一定要有額外的視覺標註來教模型這個 token 該做什麼。從多模態資料製作的角度看,這是很吸引人的設計,因為視覺標註通常比純文字標註更麻煩,也更貴。ATLAS 想做的,就是讓離散 token 成為視覺推理的共同接口,減少對複雜中間表示的依賴。

如果用白話講,ATLAS 的策略不是讓模型「多想一點」,而是讓模型「用更少的東西想」。它想避免生成冗長的中間視覺內容,也不想把推理拆成太多外部步驟。這種設計的野心很明確:保留結構化推理能力,但把推理成本壓到 token 層級。

論文實際證明了什麼

從摘要能看到的結果是,作者做了 extensive experiments and analyses,並聲稱 ATLAS 在具挑戰性的 benchmark 上拿到更好的表現,同時還保有清楚的 interpretability。不過,摘要沒有公開完整 benchmark 細節,也沒有列出具體數字、測試集名稱或比較對象,所以目前只能確認它有正向結果,不能從這份 raw 資料推導出更細的排名或分數。

摘要裡另一個很重要的資訊,是作者也碰到了訓練上的真問題:functional tokens 在 reinforcement learning 中是 sparse 的。這種稀疏性會讓訓練變難,因為 token 出現頻率低,梯度訊號就容易不穩。這不是理論上的小瑕疵,而是足以影響方法能不能訓練起來的實務問題。

為了解這個問題,論文提出 Latent-Anchored GRPO,簡稱 LA-GRPO。它的作用是用一個 statically weighted auxiliary objective 來錨定 functional tokens,讓這些特殊 token 在 RL 裡能得到更穩定的更新。白話一點說,就是當主要獎勵訊號太稀疏、太飄的時候,作者額外加了一個固定權重的輔助目標,幫這些 token 抓住訓練方向。

這個設計透露出一件事:ATLAS 不是那種「丟一個漂亮概念就結束」的方法。它在 representation 上很乾淨,但在 optimization 上仍然有明顯難度。也就是說,單一 token 的想法雖然簡潔,卻還是得靠額外訓練技巧把它扶起來。對研究者或工程師來說,這通常意味著方法的優點和成本是綁在一起的。

論文也一直強調 interpretability。因為 functional token 本身還是 token,所以推理過程不會完全沉到黑盒 latent 裡。這不代表它就能被人類完全看懂,但至少比起純 hidden pipeline,表面上更容易檢查。對需要做模型分析、debug 或安全審視的人來說,這是很實際的差異。

對開發者有什麼影響

如果你在做多模態系統,ATLAS 最有意思的地方,是它試圖把高階視覺推理塞回一般語言模型的工作流裡。這代表它想降低架構特殊化的程度,讓模型訓練還是沿用標準的 SFT 和 RL,而不是每次都為了視覺推理重寫整套 pipeline。對團隊來說,這種兼容性通常比單次 demo 的華麗更重要。

從實作角度看,這篇論文至少帶來幾個值得注意的方向:

- 它可能減少中間推理內容的冗長度,讓輸出更精簡。

- 它把推理維持在 token stream 裡,較容易接到既有 LLM 工具鏈。

- 它試著避開外部工具執行帶來的 latency。

- 它提供一種不靠 visual supervision 的訓練思路。

但這不代表問題都解了。摘要自己就點出,functional tokens 在 RL 中很稀疏,還需要 LA-GRPO 這類輔助目標來穩定訓練。這表示方法在概念上很俐落,實際上卻可能對訓練設定相當敏感。尤其當資料分布、任務型態或獎勵設計變動時,這種稀疏 token 的穩定性很可能是關鍵風險。

另一個限制,是摘要沒有提供完整 benchmark 細節。雖然作者說有更好的表現,但我們從這份 raw 資料裡看不到哪些任務最受益、差距多大、或在哪些情境下表現會掉下來。對開發者來說,這意味著你現在還不能只憑摘要就判斷它是否適合自己的產品場景。

這篇研究真正值得注意的點

ATLAS 的價值,不只是「用一個 token 做很多事」,而是它把視覺推理重新定義成 token 設計問題。這個角度很有意思,因為它把 agentic 路線和 latent 路線拉到同一個框架下比較,最後用單一離散單位把兩者合併。對關心模型介面設計的人來說,這是一種很乾淨的抽象。

不過,乾淨不等於容易落地。摘要已經明講,稀疏性會讓 RL 訓練變難,所以作者才需要 LA-GRPO。這也提醒我們,很多多模態方法的真正瓶頸不是推理概念,而是怎麼讓它在訓練中穩定出現、穩定學到、穩定泛化。ATLAS 在這裡提供了一個方向,但還不是終局答案。

如果把這篇論文濃縮成一句話,就是:它想讓視覺推理像普通語言建模一樣運作,卻又保留足夠的結構與可解釋性。這個方向對未來的多模態模型很有吸引力,特別是當大家都在想怎麼降低推理成本、維持訓練相容性、又不要把系統做得太複雜時。

目前能確定的只有這些:ATLAS 提出單一 functional token 來統一 agentic 與 latent 視覺推理,使用 next-token prediction 保持訓練相容,並用 LA-GRPO 處理 RL 下的稀疏性問題。至於它在更完整的實際場景裡能走多遠,還得看完整論文的實驗細節。