Server Learning 讓聯邦學習更抗攻擊

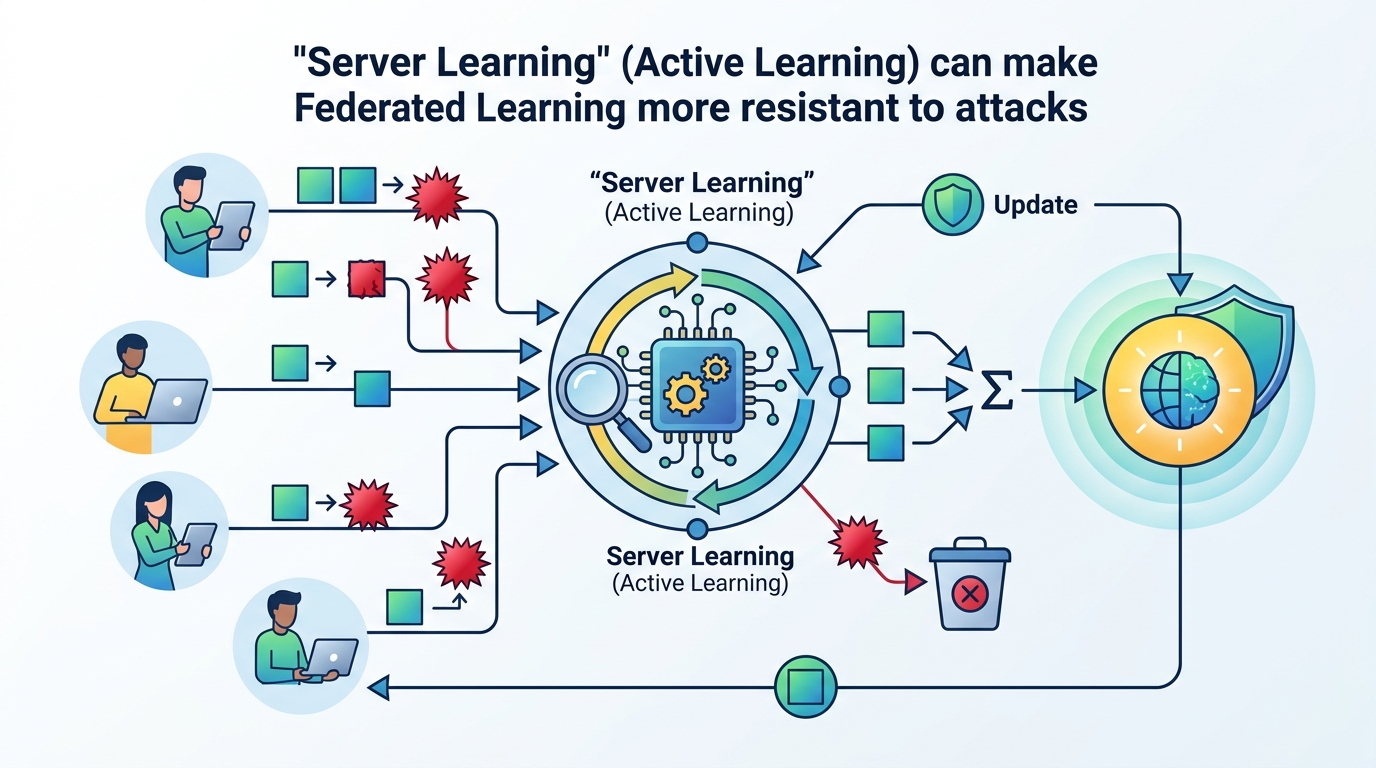

這篇論文把伺服器拉進聯邦學習防禦鏈:用小型伺服器資料、過濾可疑更新,再搭配 geometric median 聚合,目標是在非 IID 與惡意客戶同時存在時,提升訓練穩定性。

聯邦學習常被視為「資料留在裝置上」的隱私友善做法,但這不代表它天生安全。這篇 Server Learning Hardens Federated Learning 想處理的,就是一個很現實的問題:當客戶端資料分布不一致,還混進惡意更新時,單靠一般聚合方法很容易被帶偏。

作者的方向很直接。不要只把希望放在客戶端回傳的更新上。伺服器自己也要參與學習,手上要有一小份資料,再搭配更新過濾與更抗離群值的聚合方式,讓整個聯邦訓練流程更難被攻擊者操控。這篇摘要沒有把完整 benchmark 細節公開出來,但方法輪廓已經很清楚:它不是想發明一個全新訓練框架,而是把防禦做得更主動。

這篇論文在解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

聯邦學習的理想很漂亮:資料不集中,模型照樣能訓練。問題是,真實世界裡的客戶端幾乎不會長得一樣。每個裝置看到的資料都只是世界的一小塊,這就是所謂的 non-IID。對優化來說,這已經夠麻煩了,因為每輪回傳的更新方向可能彼此差很多。

再把惡意客戶端加進來,麻煩就升級了。攻擊者可以送出有毒更新、誤導全域模型,甚至在訓練過程中慢慢把模型推歪。很多防禦方法的前提,是客戶端大致上是誠實的,或至少更新分布還算接近。這篇論文鎖定的,就是更硬的情境:non-IID 資料加上惡意攻擊同時存在。

作者的核心判斷是,伺服器不應該只是被動收更新。只要伺服器自己有一小份資料,就能拿來做額外判斷,或至少當成穩定訓練的參考訊號。這個想法很務實,因為它承認了一件事:在真實部署裡,信任客戶端本來就不是理所當然。

換句話說,這篇不是在問「怎麼讓所有客戶端都更乖」,而是在問「如果有人不乖,伺服器還能不能自己撐住訓練」。這個問題,對很多分散式訓練系統都很重要。

方法到底怎麼運作

這篇論文提出的是一個 heuristic algorithm,重點由三個部分組成:server learning、client update filtering、以及 geometric median aggregation。摘要沒有把每一步的實作細節完整展開,所以不能把它講成一個已經完全定義好的標準流程;但高層設計意圖是明確的。

第一步是伺服器自己也學。伺服器端有一小份資料,可以是 synthetic,而且作者特別指出,這份資料的分布不需要和客戶端聚合後的分布很接近。這點很關鍵,因為它降低了實作門檻。意思是,伺服器不必先蒐集一大包完美代表真實世界的資料,才有資格參與防禦。

第二步是過濾客戶端更新。概念上,就是先把看起來可疑的更新擋掉,或至少降低它們的影響力,再讓它們進入後續聚合。這種做法的價值,在於先做一道門檻,避免明顯異常的訊號直接污染全域模型。不過摘要沒有說明具體的過濾規則,所以這裡只能把它視為一個啟發式防禦,而不是一個已經公開完整形式化保證的機制。

第三步是 geometric median aggregation。白話來說,傳統平均很容易被極端值拉歪;幾個惡意更新只要夠猛,就可能把整體平均推走。幾何中位數的想法比較像是找更新群的「中心」,對離群值比較不敏感。這讓它很適合用在有少數壞更新、甚至可能很多壞更新的場景。

把三者放在一起,這套設計的邏輯就很清楚:伺服器先用自己的資料建立一點穩定基準,再把可疑客戶端更新先篩掉,最後用更抗離群值的方式做聚合。它不是單靠某一招硬扛,而是把多層防線疊起來。

如果用工程角度來看,這種做法的好處是概念單純。它沒有要求伺服器去理解每個客戶端的完整資料,也沒有要求客戶端額外配合太多複雜協議。防禦的重心,放在伺服器端的判斷與聚合策略上。

論文實際證明了什麼

摘要中最明確的結果,是這個方法能在惡意攻擊下提升模型準確率,而且在某些情況下,惡意客戶端比例可以超過 50%,方法仍然能帶來顯著改善。這是目前原始資料裡最具體的實驗結論。

但也要講清楚,摘要沒有公開完整 benchmark 細節。它沒有列出資料集名稱、攻擊類型、準確率數字、消融實驗,或不同設定下的完整比較表。所以我們可以說它在實驗中表現更好,但不能從這份摘要直接推導出它在哪些資料集上贏多少、對哪些攻擊最有效,或和哪些基線相比最有優勢。

另一個值得注意的點,是伺服器資料的要求並不高。作者說這份資料可以很小,也可以是 synthetic,而且不必和客戶端資料分布很接近。這代表它不是一種只適合「伺服器本來就握有大量高品質資料」的防禦。相反地,它比較像是一個可落地的折衷方案:不求完美代表性,只求提供足夠的穩定訊號。

不過,因為論文把它描述為 heuristic algorithm,所以我們也要保留一點距離。這樣的結果代表它在實驗場景有效,不代表它對所有攻擊都能保證成功,更不代表它已經是最優解。尤其在對手知道防禦策略的情況下,攻擊者可能會想辦法繞過過濾,或設計更隱蔽的更新來影響幾何中位數的結果。

簡單說,這篇論文證明的是「伺服器主動參與防禦」這條路有實用價值,而不是宣稱聯邦學習從此就萬無一失。

對開發者有什麼影響

對做聯邦學習系統的人來說,這篇最重要的訊號是:伺服器不必只是收資料、做平均。只要有一小份可用資料,哪怕是 synthetic,伺服器就可能成為防禦的一部分,而不是單純的協調者。這會改變很多系統設計的思路。

尤其是在客戶端信任度不高的場景,這種設計很有吸引力。像是消費型裝置、邊緣運算環境,或跨組織訓練,都可能遇到資料分布很不一致、參與者品質參差不齊,甚至有人故意搗亂。這篇論文提供的方向是:不要假設所有更新都值得信任,伺服器要有自己的判斷能力。

從實作角度看,小型伺服器資料的門檻也很重要。很多防禦方法理論上很漂亮,但一落地就卡在資料蒐集成本。這篇的設定比較友善,因為它允許伺服器手上只有少量資料,而且不要求它和客戶端世界高度一致。對工程團隊來說,這比「先準備一個完美伺服器資料集」更接近現實。

當然,這不代表可以直接把它當成現成解法上線。摘要沒有提供過濾規則、額外計算成本、或對伺服器資料敏感度的完整分析。這些都會影響真正部署時的可行性。尤其是過濾步驟,如果太嚴格,可能誤殺正常更新;如果太寬鬆,又可能讓惡意更新混進來。

限制與還沒回答的問題

這篇摘要留下不少工程上很關鍵的空白。首先,我們不知道它測了哪些 attack setting。是資料投毒、模型投毒,還是其他形式的惡意更新?摘要沒有說。其次,也不知道過濾是怎麼定義的。是根據距離、分數、門檻,還是別的規則?這些細節都會直接影響防禦效果。

第三,伺服器資料到底要多小才夠?摘要只說 small,而且可以是 synthetic,但沒有給出最小需求。這代表實務上仍然要自己試。對不同模型、不同任務、不同非 IID 程度,這個門檻可能差很多。

第四,計算與通訊成本沒有被量化。server learning 會增加伺服器端的處理量,geometric median aggregation 通常也比單純平均更貴。摘要沒說 overhead,所以還不能判斷這套方法在大規模聯邦系統裡是否划算。

最後,這種 heuristic 防禦通常還有一個老問題:對自適應攻擊者不一定穩。只要攻擊者知道你在做過濾和幾何中位數聚合,他們就可能調整更新方式,讓自己看起來更像正常客戶端。這不是這篇論文獨有的問題,但它確實是這類方法普遍要面對的現實。

即便如此,這篇論文還是有價值。它提醒大家,聯邦學習的安全性不能只靠「資料不出裝置」這句話來保證。當客戶端資料本來就非 IID,又可能有惡意參與者時,伺服器需要更主動的角色。把 server learning 納入防禦鏈,至少是一個很實際、也很值得繼續追的方向。

如果你在做分散式訓練或聯邦學習系統,這篇的啟發很直接:不要把聚合當成唯一防線。讓伺服器學一點、看一點、篩一點,再用更抗離群值的方式整合更新,可能就是把系統從「容易被帶歪」拉回「至少比較穩」的差別。

- 核心組合:server learning、client update filtering、geometric median aggregation。

- 適用情境:non-IID 客戶端加上惡意更新的聯邦學習。

- 實務亮點:伺服器資料可以很小,也可以是 synthetic。

- 已公開結果:在某些情況下,惡意客戶端比例超過 50% 仍可提升準確率。

- 目前限制:摘要沒有公開完整 benchmark、攻擊設定與過濾細節。

總結來說,這篇不是在賣一個炫技模型,而是在補聯邦學習很現實的一塊短板:當客戶端不可信時,伺服器要有自己的防禦能力。這個想法不花俏,但很有工程味。