為什麼 AI 基礎設施才是真正的護城河

AI 競爭的核心已經從模型展示轉向算力、分發與產品限制,誰能穩定拿到資源並大規模交付,誰才有護城河。

AI 競爭的核心已經從模型展示轉向算力、分發與產品限制,誰能穩定拿到資源並大規模交付,誰才有護城河。

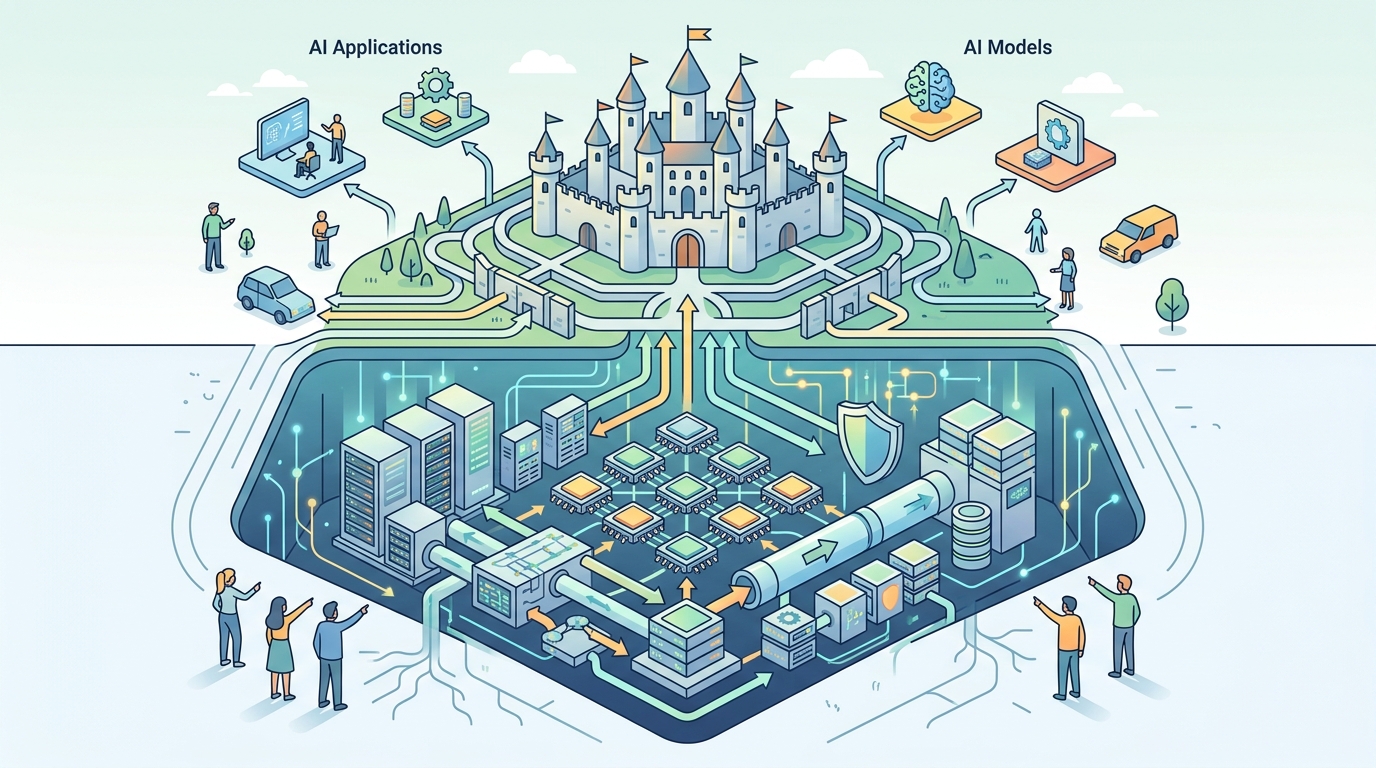

我認為,AI 的真正護城河已經不是模型本身,而是基礎設施。最新一輪產業動態很直白:Anthropic 擴張 300MW 算力、Doubao 推出多模態升級、各家新模型發得比用戶測得還快。這不是誰的 demo 更炫,而是誰能先拿到電力、機房、推理容量,並把能力穩定變成產品。

第一個論點:算力已經是最硬的稀缺資源

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

Anthropic 與 SpaceX 據傳合作擴充 300MW 算力,這種規模不是「想做更大」而已,而是需求已經逼近供給上限。300MW 代表的不是一台更快的 GPU,而是一整套電力、散熱、土地、網路與資本配置的能力。當競爭進入這個層級,模型好不好只是一部分,能不能持續供得上才是更大的問題。

這也解釋了為什麼很多 AI 產品看起來技術很強,卻很難長期維持體驗。推理成本一高,延遲就上來;流量一爆,配額就縮;企業客戶一多,SLA 就變成硬門檻。對工程團隊來說,算力不再是後台成本,而是產品能否成立的前提條件。

更重要的是,算力會直接改寫競爭節奏。過去一家新創只要模型漂亮,就能靠口碑打開市場;現在若沒有足夠的基礎設施,成長反而會拖垮服務品質。這也是為什麼大型玩家越來越像雲端公司,因為真正的壁壘已經從參數數量,轉向可持續供應能力。

第二個論點:多模態與產品化能力比單點模型名聲更重要

Doubao-Seed-2.0-lite 加上完整多模態支援,看似只是功能更新,實際上是產品價值的躍遷。使用者不會為「文字理解很強」單獨付費,他們要的是能看圖、讀文件、理解語音、串接工作流的系統。當模型跨過多模態門檻,它就能直接進入客服、搜尋、內容生成與辦公流程。

這種變化在市場上已經很明顯。很多團隊會把注意力放在某個 benchmark 分數,但真正決定留存的,是產品能不能在真實場景裡穩定工作。假設一個模型在理論推理上領先 5%,但在上傳圖片、處理長文、或多輪任務上不穩,那它在企業採購時就會輸給一個更好用、整合更完整的對手。

Zyphra 的 ZAYA1-8 上線也說明同一件事。市場已經不缺「又一個模型」,缺的是能快速包裝成工作工具的能力。當多模態變成標配,差異化就不再來自單次發布的驚喜,而是來自誰能把能力做成穩定、低摩擦、可擴張的使用路徑。

第二個論點:分發與限制機制,才決定商業化深度

AI 產品真正難的,不是把功能做出來,而是把功能賣出去,還能賺錢。這裡的關鍵常常是使用限制、價格設計、流量入口與整合位置。很多模型公司在技術上很接近,但最後只有少數能變成默認工具,原因就在於誰掌握了分發,誰就掌握了使用頻率。

例如,若一個模型能直接嵌進既有雲平台、辦公軟體或開發者工具,它就不需要教育市場太久。相反地,就算模型能力更強,只要使用流程更長、成本更高、或部署更麻煩,企業採購就會轉向更容易落地的方案。這也是為什麼產品限制本身不是缺點,而是商業化的控制閥。

從這個角度看,AI 競爭已經很像基礎設施競爭加平台競爭的混合體。模型只是入口,真正的護城河來自供應鏈、渠道、開發者生態與使用上限的設計。當這些條件疊在一起,誰能長期提供穩定服務,誰才有真正的定價權。

反方可能怎麼說

最強的反對意見是,模型能力終究還是第一性原理。若某家公司真的做出明顯更強的推理、更低的幻覺率,或更高效的訓練方法,市場最後還是會跟著它走。這個觀點有道理,因為歷史上很多技術勝出者,起初就是靠核心能力拉開差距。

另一個合理批評是,基礎設施會快速商品化。算力可以租,雲可以買,機房可以外包,最後大家都能接近同樣的硬體條件。若是如此,真正的差異還是會回到模型研究與應用創新,而不是誰先蓋了更多資料中心。

但我不接受「基礎設施不重要」這個結論。算力、電力與分發雖然部分可外包,卻無法完全外包掉規模優勢、供應穩定性與成本控制。更現實的是,當模型迭代越快、推理越重、企業需求越高,誰能承受更大的基礎設施負擔,誰就能更快把研究成果變成收入。模型能力重要,但它已經不是單獨決定勝負的那個因素。

你能做什麼

如果你是工程師,優先做能承受高流量、低延遲、可觀測的系統,並把多模態能力當成架構前提,不要等需求爆了才重寫。若你是 PM,把成本、配額、延遲與失敗恢復納入核心指標,因為這些不是營運細節,而是產品體驗的一部分。若你是創辦人,別再只講「我們的模型更強」,你應該回答的是:你的算力從哪裡來、你的分發在哪裡、你的使用限制怎麼設計,還有你怎麼在規模化時不被成本反噬。