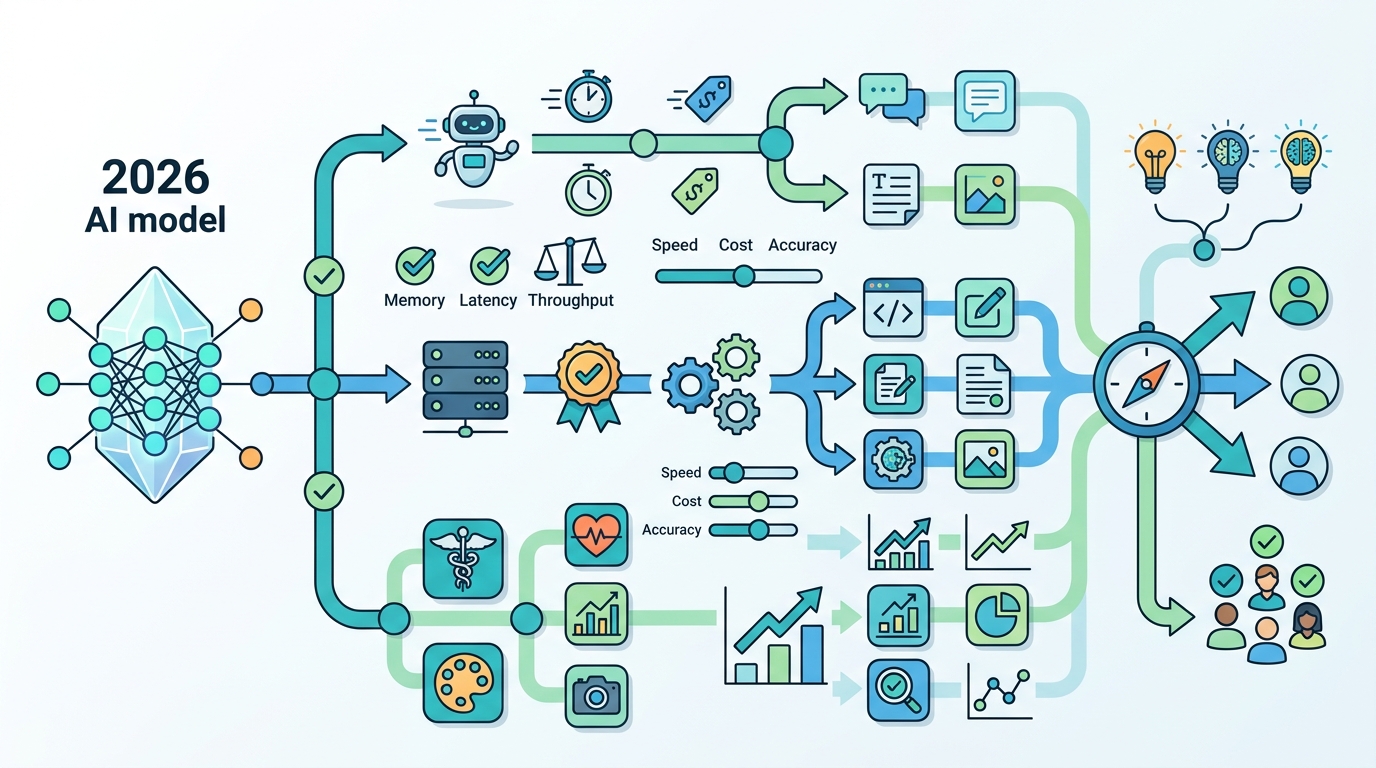

2026 AI 模型怎麼選

2026 年選 AI 模型要看任務。Gemini 3.1 Pro 偏推理,Claude 寫作最穩,Grok 在部分 coding 測試領先。

2026 年選 AI 模型要看任務。Gemini 3.1 Pro 偏推理,Claude 寫作最穩,Grok 在部分 coding 測試領先。

說真的,2026 的 AI 模型選擇很像選工具。沒有一個模型包辦全部。OpenAI、Anthropic、Google DeepMind、xAI 都有各自拿手的地方。

這篇要講的很直接。你如果在挑 GPT、Claude、Gemini、Grok,重點不是誰最強。重點是誰最適合你的工作流。下面這些數字,差距其實蠻明顯。

| 模型 | Coding | Reasoning | Writing | 每 1M tokens API 價格 |

|---|---|---|---|---|

| GPT-5.4 | 74.9% SWE-bench | 92.8% GPQA | Canvas 編輯 | $2.50 / $15 |

| Claude Opus 4.6 | 74%+ SWE-bench | 91.3% GPQA | 128K 輸出,文筆自然 | $15 / $75 |

| Gemini 3.1 Pro | 63.8% SWE-bench | 94.3% GPQA | Docs 整合 | $2 / $12 |

| Grok 4 | 75% SWE-bench | 表現有競爭力 | 風格較不受限 | $2 / $15 |

2026 的重點是分工,不是通吃

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

以前很多人買模型,想找一個萬用解。現在這套思路開始失靈。模型能力拉開後,最佳選擇會跟任務綁死。你寫程式、做研究、寫文件、跑客服,答案都可能不同。

這件事對開發者很重要。因為你不是只在選一個聊天機器人。你是在選 API、延遲、價格、上下文長度,還有整個產品體驗。模型分工越細,團隊越不能只看排行榜第一名。

從資料看,coding、reasoning、寫作這三條線已經分開了。Grok 4 在 SWE-bench 看到 75%。GPT-5.4 是 74.9%。Claude Opus 4.6 也有 74%+。這三個數字很接近,代表實作細節會放大差異。

- Grok 4:SWE-bench 75%

- GPT-5.4:SWE-bench 74.9%

- Claude Opus 4.6:SWE-bench 74%+

- Gemini 3.1 Pro:GPQA 94.3%

Claude 為什麼常被拿來寫文件

如果你的工作是長文件、提案、報告、產品規格,Claude 很常是第一個值得試的模型。原因很簡單。它的文字比較順,段落結構也比較穩。講白了,就是比較像人寫的,不容易一段一段散掉。

Claude Opus 4.6 的 128K 輸出也很實用。這代表它能一次處理更長的內容。對團隊來說,這種能力會直接影響編輯成本。少一次重寫,就少一次人力浪費。

Anthropic 也不是只靠模型分數吃飯。它已經深度進入開發者工具圈。像 Cursor、Windsurf 都跟 Claude 的使用情境很貼近。模型好不好是一回事,工具順不順又是另一回事。

“Claude is the best model for writing and coding assistants.” — Andrew Ng

推理能力這條線,Gemini 很強

如果你在做數學、研究、分析、資料整理,Gemini 3.1 Pro 很值得看。它在 GPQA 拿到 94.3%。這個數字比 GPT-5.4 的 92.8% 還高,也比 Claude Opus 4.6 的 91.3% 高一截。

這種差距在日常聊天不一定看得出來。可是在需要多步推理的場景,差 1% 到 3% 就可能影響答案品質。尤其是你把模型接進內部知識庫、研究助理、文件摘要流程時,穩定性比嘴快重要。

Gemini 3.1 Pro 的另一個優勢是價格。表格裡它是最便宜的那個,輸入 $2、輸出 $12,都是每 1M tokens。對要大量跑資料的團隊來說,這種差異會直接反映在帳單上。

- Gemini 3.1 Pro:GPQA 94.3%

- GPT-5.4:GPQA 92.8%

- Claude Opus 4.6:GPQA 91.3%

- Gemini 3.1 Pro:$2 / $12

寫作、coding、推理,三者差很多

很多人會把模型當成同一種東西。其實不是。寫作看的是語氣、結構、長文一致性。coding 看的是修 bug、理解 repo、補測試。推理看的是多步思考和錯誤控制。這三件事根本不是同一個考題。

所以你看 benchmark 時,不能只盯一個分數。Grok 4 在 SWE-bench 領先,GPT-5.4 在推理和整體平衡上很強,Claude 則在長文和自然語氣上更穩。每個模型都像有自己的主場。

如果你是產品經理或技術主管,最好先問自己三件事。你的任務是產文、寫 code,還是做分析。你的資料是不是很長。你的成本能不能撐住高用量。這三題比「哪個模型最強」更有用。

- 寫作:Claude 通常最穩

- 推理:Gemini 3.1 Pro 很突出

- coding:Grok 4 和 GPT-5.4 很接近

- 成本:Gemini 3.1 Pro 最便宜

企業買單時,別只看聊天畫面

企業場景最常踩雷的地方,是把模型和系統混為一談。客服機器人、內部知識助理、銷售輔助工具,真正決定效果的,常常不是模型本體,而是檢索、路由、權限和人工接手。

講白了,模型只是大腦的一部分。你還要有資料來源、上下文管理、錯誤回復機制。沒有這些,換再強的 LLM 也只是換一個比較會講話的前端。

這也是為什麼很多 SaaS 公司在做 AI 功能時,會把重點放在工作流。模型負責生成,系統負責控管。這種架構才有機會把 AI 真正接進日常營運。

- 檢索比單純聊天更重要

- 路由決定答案是否對題

- 人工接手仍然必要

- 成本要看整體流程,不只看 token 單價

如果是我,我會這樣選

如果只想先挑一個通用模型,我會先看 GPT-5.4。理由很現實。它的生態系最大,文件多,工具多,整合也最方便。對多數團隊來說,這種省事很值錢。

如果是寫作導向,我會先試 Claude。你要寫長文、提案、產品說明、內部文件,它通常比較不會讓你改到懷疑人生。如果是研究、分析、數學題,我會先試 Gemini 3.1 Pro。

如果是 coding,我會看你用哪個編輯器。因為 Claude Code、Cursor、Windsurf 這些工具,會直接影響你實際感受到的速度。模型分數很重要,但工作流更重要。真的。

這個市場接下來會怎麼走

我覺得 2026 之後,模型市場會更像資料庫或雲端服務。大家不會只問誰最大。大家會問,誰最適合這個工作。這種分化會讓產品設計更細,也會讓採購更務實。

對台灣開發者來說,最實際的做法不是追每一次發表會。是把你的任務拆開。先看寫作、推理、coding、客服四種情境,再各自做測試。你會很快發現,最貴的不一定最好,最強的也不一定最省事。

如果你現在就在選模型,我的建議很簡單。先用一週做 A/B 測試。再看準確率、人工修改時間、每月 token 成本。最後才決定要不要換。別被排行榜帶著走,因為你的產品不是排行榜。