MiniMax-M1:開源 1M Token 推理模型

MiniMax 推出 M1 開源推理模型,主打 100 萬 Token 上下文、8 萬 Token 輸出與低價 API。

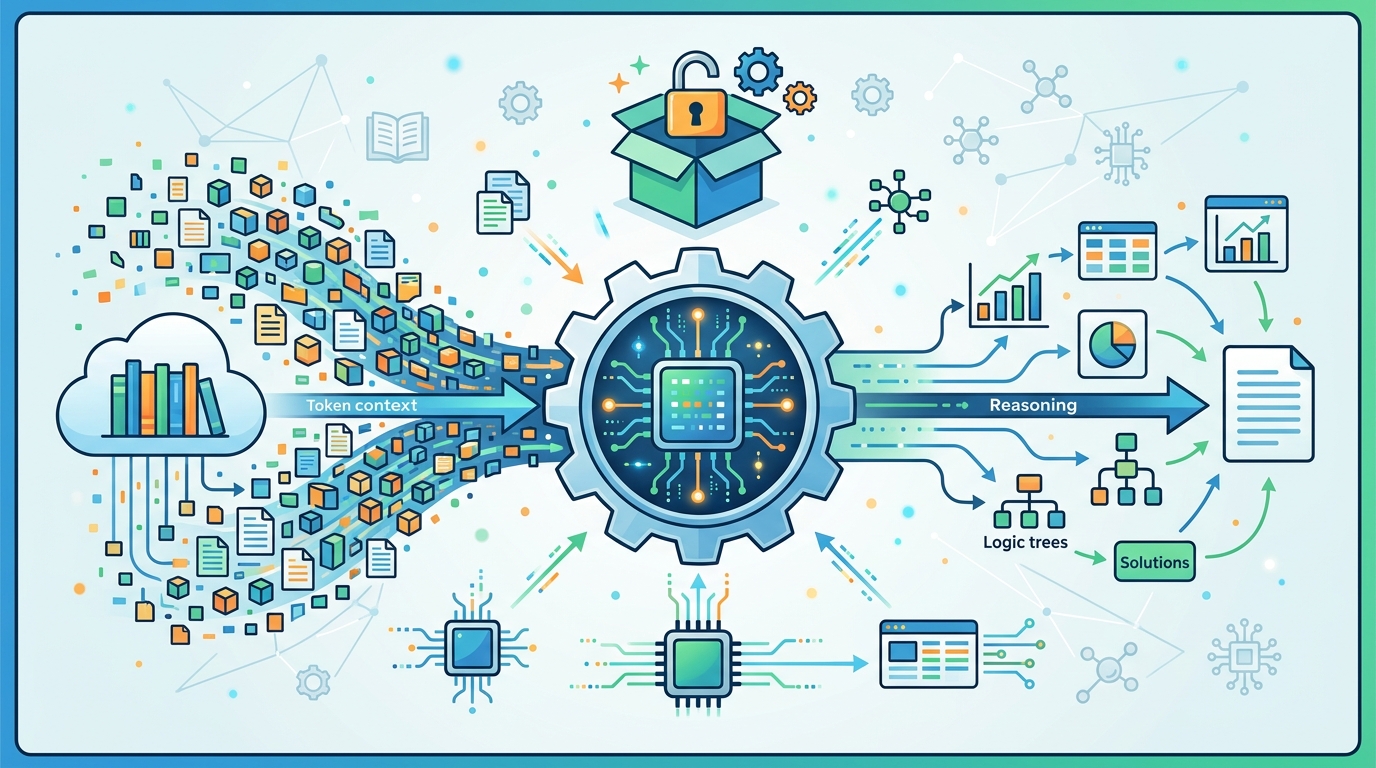

MiniMax-M1 是一款開源推理模型,主打 100 萬 Token 上下文、8 萬 Token 輸出,還把 API 價格壓得很低。

MiniMax 在 2025 年 6 月 16 日推出 MiniMax-M1。這次最吸睛的不是模型名字,而是數字。100 萬 Token 上下文、8 萬 Token 推理輸出,還有 512 張 H800 跑了 3 週的訓練設定。

更狠的是成本。MiniMax 說,整段強化學習只花了 534,700 美元。講白了,這是在告訴大家:大模型不一定非得燒到像失火一樣。它也可以很大,還可以算得精。

對開發者來說,這種模型值不值得玩,重點不在宣傳詞。重點在它能不能真的讀長文件、看大程式碼庫、跑長 agent 流程。MiniMax 把它放進 MiniMax App、網頁版和 API,也接上 vLLM、SGLang、Hugging Face 與 GitHub,就是想讓人直接上手。

| 指標 | MiniMax-M1 | 代表意義 |

|---|---|---|

| 上下文長度 | 1,000,000 tokens | 可處理超長文件與程式碼庫 |

| 推理輸出 | 80,000 tokens | 適合長鏈思考與多步驟任務 |

| RL 訓練算力 | 512 H800 × 3 週 | 顯示訓練規模很大 |

| RL 成本 | 534,700 美元 | MiniMax 主打效率 |

| SWE-bench validation | 55.6% 到 56.0% | 軟體工程能力有競爭力 |

| API 價格 | 每百萬 tokens $0.4 / $2.2 | 輸入與輸出都偏低價 |

MiniMax 為什麼要做這種模型

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

我覺得這題很直白。現在大家都在比誰的模型更會講,MiniMax 直接改比誰能記更多。100 萬 Token 的上下文,不是拿來唬人而已。它能把長文件、長對話、長程式碼一起塞進去。

這對實務工作很有感。你在做 code review、法務文件摘要、客服知識庫查詢,或者 agent 反覆呼叫工具時,模型常常不是不會想。它是前面內容太長,後面就忘了。長上下文就是在補這個洞。

MiniMax 說 M1 用的是混合注意力設計,裡面有 Lightning Attention。意思很簡單。它想把長序列的計算壓下來,讓模型在吃大資料時,不要把伺服器搞得像在烤肉。

- 100 萬 Token 上下文

- 8 萬 Token 推理輸出

- 512 張 H800 參與訓練

- RL 成本 534,700 美元

這些 benchmark 到底怎麼看

先講結論。MiniMax-M1 不是只會秀參數。它把重點放在軟體工程、長上下文理解,還有工具使用。這三個方向都很實際,因為現在很多 AI 工作流,最後都會碰到程式、文件和工具鏈。

在 SWE-bench validation 上,MiniMax 公布 M1-40k 是 55.6%,M1-80k 是 56.0%。這個數字沒有把 DeepSeek 的 R1-0528 拉下來,後者是 57.6%。但它還是站在開源模型第一梯隊。

長上下文部分就更有看頭。MiniMax 說,M1 在開源模型裡表現很強,甚至把 OpenAI o3 和 Claude 4 Opus 也拉進比較。它自家說法是,M1 在這項測試排到第二,只輸給 Gemini 2.5 Pro。

“This feature gives us a substantial computational efficiency advantage in both training and inference.” — MiniMax

這句話很重要。因為大家都知道長上下文很香,但也很貴。模型如果只會吃記憶體,最後還是沒人敢用。MiniMax 想說的是,它不只大,還想讓訓練和推理都算得過去。

- SWE-bench:55.6% 到 56.0%

- DeepSeek-R1-0528:57.6%

- 長上下文排名:第二,僅次於 Gemini 2.5 Pro

- 工具使用測試:MiniMax 宣稱領先多數開源模型

價格才是這次的殺手鐧

很多模型一出來就愛講能力,價格卻藏到最後。MiniMax 這次反過來,把價格放得很前面。它的 API 在 0 到 20 萬 Token 區間,輸入每百萬 Token 只要 0.4 美元,輸出是 2.2 美元。

如果輸入超過 20 萬、到 100 萬 Token,輸入價格變成每百萬 Token 1.3 美元,輸出還是 2.2 美元。這個設計很有意思。它等於在說,長上下文可以用,但不是叫你亂塞資料。

這種定價對開發者很實際。你要跑長文件摘要、程式碼 refactor、知識庫問答,或者 agent 反覆讀寫資料,成本會直接影響你要不要上線。MiniMax 這次就是在搶這塊。

- 0 到 20 萬輸入:每百萬 Token 0.4 美元

- 0 到 20 萬輸出:每百萬 Token 2.2 美元

- 20 萬到 100 萬輸入:每百萬 Token 1.3 美元

- 20 萬到 100 萬輸出:每百萬 Token 2.2 美元

更麻煩的是,這還不是只有 API 的事。MiniMax 說 M1 已經能在 App、網頁和開發工具鏈裡用。對團隊來說,工具先接得上,才有機會真的進 production。只會發 paper 的模型,通常都活不久。

跟其他模型比,差在哪裡

如果只看 100 萬 Token,上下文這件事其實已經不是 MiniMax 獨有。Gemini 2.5 Pro 也有 100 萬 Token 級別的上下文。差別在於,MiniMax 把價格壓得更明顯,還把開源和部署支援一起端出來。

再看開源陣營。DeepSeek 的 R1 系列在推理圈很有名,Meta Llama 系列則有更大的生態。MiniMax 的打法比較像是:我不一定要在所有榜單都第一,但我要在長上下文、成本、工具使用這幾個點很能打。

這種策略其實很合理。現在企業採購 AI,不會只看單一 benchmark。你還得看部署難度、推理速度、價格、以及能不能接到既有的伺服器和軟體堆疊。M1 的優勢,就是它把這幾件事綁在一起賣。

- Gemini 2.5 Pro:同樣主打超長上下文

- DeepSeek R1:推理能力強,SWE-bench 更高

- Meta Llama:開源生態成熟,但長上下文不是唯一賣點

- MiniMax-M1:價格和長上下文一起打

這代表整個 AI 產業什麼事

我覺得這波很像一個轉向。前兩年大家在拼參數和聊天能力,現在開始拼「你到底能不能真的做事」。做事就會碰到長文件、長流程、長記憶,還有工具呼叫。這些都很吃上下文。

所以 100 萬 Token 不只是規格表上的數字。它其實在暗示一件事:模型會越來越像工作引擎,不只是聊天機器人。你丟進去的不是一句 prompt,而是一整包資料、規則、歷史紀錄和程式碼。

MiniMax 這次還把訓練成本講得很細。512 張 H800、3 週、53.47 萬美元。這些數字的用意很明顯。它想讓市場相信,超長上下文不是只能靠超大預算堆出來。

但我也不會把話說滿。模型規格漂亮,不等於每個工作都適合。真正的考驗,是你的資料格式、你的 prompt 工程、還有你的延遲需求。別忘了,Token 再大,回應慢到像在等公車,也沒人想用。

接下來可以怎麼看 M1

如果你是開發者,我會建議你先拿它測三件事。第一是長文件摘要。第二是大程式碼庫問答。第三是多步驟 agent 任務。這三個場景最容易看出模型有沒有真材實料。

如果你是產品或 AI 工程師,就該盯成本。API 價格低,代表你有機會把更長的上下文塞進產品,但前提是你要算得出 ROI。不是每個功能都值得開到 100 萬 Token。很多時候,20 萬就夠了。

MiniMax-M1 這次給市場的訊號很清楚。開源模型的競爭,已經不是單純比誰更會講。接下來更重要的是,誰能把長上下文、推理品質和成本一起做平衡。你如果正在選模型,這會是很值得實測的一個選項。