為什麼 Claude 的「無限」上下文窗口,仍然不會讓 AI 自主運作

Claude 的新上下文、協作與基礎設施升級都是真的進步,但它們不等於 AI 自主運作。

Claude 的上下文、協作與基礎設施升級都是真的進步,但它們不等於 AI 自主運作。

Anthropic 把 Claude 的最新更新包裝成邁向自主的里程碑,但我認為這是誇大解讀。更大的上下文窗口、更好的多代理協調、更多算力,解決的是持續性與吞吐量,不是判斷、驗證與責任歸屬。這一點很重要,因為「無限上下文」聽起來像推理能力的突破,實際上更像是記憶能力的擴張。

第一個論點:更多上下文,修的是記憶,不是理解

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

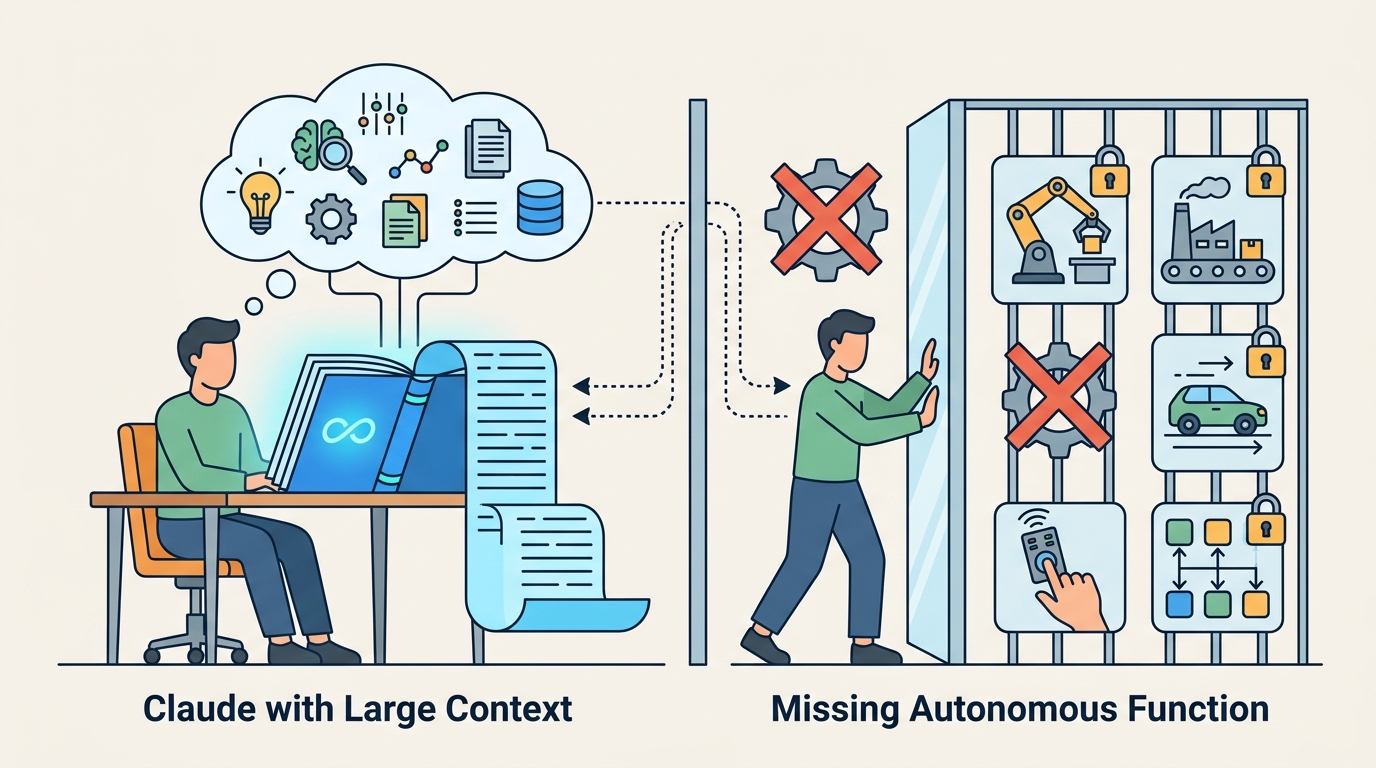

長上下文確實有用。做程式碼審查、需求整理、研究彙整時,模型常常不是不會想,而是忘得太快。若它能同時保留設計討論、 bug 追蹤與產品需求,像 Claude 這類模型就能少犯很多「因為失憶而犯的低級錯誤」。這對工程團隊是實質改善,不是行銷話術。

但記得住,不代表懂得對。模型可以把更多舊資訊帶進後續回答,卻仍然可能誤解任務、沿用過時指令,甚至把一個錯誤假設持續放大好幾個小時。2023 年不少團隊已經看過這種現象:上下文拉長後,模型更像一個「會持續犯錯的記錄器」,而不是會自我校正的工程師。記憶降低摩擦,判斷才決定品質。

第一個論點:更多上下文,修的是記憶,不是理解

對軟體工作來說,最危險的不是短暫失誤,而是持久失誤。假設一個模型在第 2 小時把架構方向帶偏,之後它又能把這個錯誤一路延伸到測試、文件、重構與部署,最後你得到的不是「更聰明的系統」,而是「更有效率地擴大錯誤」。這也是為什麼長上下文能提升生產力,卻無法單獨構成自主。

換句話說,Claude 的上下文升級解決的是連續性,不是理解力。它讓模型更像一個不容易斷線的助手,但還不是一個能自己判斷何時該停、何時該改、何時該升級給人的系統。若沒有外部驗證,持續性只會把錯誤做得更完整。

第二個論點:多代理協調,擴的是工作,不是信任

多代理協調是這次更新裡更值得注意的部分,因為它更接近真實團隊分工。有人負責草稿、有人負責測試、有人負責摘要,這種平行處理確實能加速分析。對工程師與研究者來說,這不是抽象概念,而是能直接縮短 cycle time 的工具。Anthropic 若把這條路走深,生產力會明顯上升。

問題在於,分工越多,越需要一個可靠的監督者。多個代理如果共享同一個模型家族與同一套偏誤,就可能把同一個盲點同步擴散到整條工作流。這在實務上很常見:一個代理誤判需求,另一個代理沿用錯誤假設,第三個代理再把它整理成看起來很完整的結論。2024 年許多團隊在內部試驗裡都看過類似情況,系統很忙,卻不一定可信。

第二個論點:多代理協調,擴的是工作,不是信任

Anthropic 同時強調更高 API 限額、更多算力與更大的 GPU 資源,這些都是真正的基礎建設進步。因為開發者要的不只是「更聰明的模型」,還要能在高負載下穩定運作、能處理更大任務、能在真實工作量下不中斷。對把 Claude 當生產工具的團隊來說,這些升級很有價值。

但基礎設施變強,不等於產品已經自主。更多 GPU 只能讓系統服務更多請求,不能替它補上需求邊界、驗收測試、回滾方案與人工簽核。市場很容易把容量當能力,把吞吐量當智慧;這是錯的。容量只代表系統能做更多事,也代表它能在更大規模下犯更多錯,前提是流程沒有設計好。

反方可能怎麼說

最強的反方論點是:自主不是開關,而是連續體。當模型能記得更多、協調更多、在工具鏈裡自我修正、甚至透過 webhook 持續工作,它顯然正在往「少介入、長任務」的方向前進。若再加上迭代式自我反思與持續狀態保存,這已經不像傳統聊天機器人,而更像一個會自己跑流程的系統。

這個說法不是空話。能跨 session 保留狀態、能根據輸出再修正自己的模型,確實比每次對話都重置的聊天機器人更接近實用自動化。把這些能力全部串起來,確實能讓 AI 在更多場景中減少人工介入。

但從「更好的工作流自動化」跳到「自主軟體工程師」,距離仍然太大。自我修正只有在模型知道什麼叫正確時才有效;而在開放式工程任務裡,正確的訊號常常不清楚,甚至彼此衝突。它可以迭代很多輪,卻仍然優化錯的目標。這就是我為什麼接受它在進步,卻拒絕把它叫做自主。

你能做什麼

如果你是工程師,把 Claude 當成高吞吐量協作者,而不是獨立操作者。用長上下文保存專案記憶,用多代理做平行分析,用 webhook 減少人工黏合,但把人類審查放在需求轉成程式碼的那一刻,並讓自動化測試當最後裁判。若你是 PM 或創辦人,不要先相信「自主」敘事,而要先建立能量測正確率的流程。真正有效的模式不是讓模型做完一切,而是讓模型做更多,同時讓系統持續盯住它。