2025 年 CUDA 為何還是強

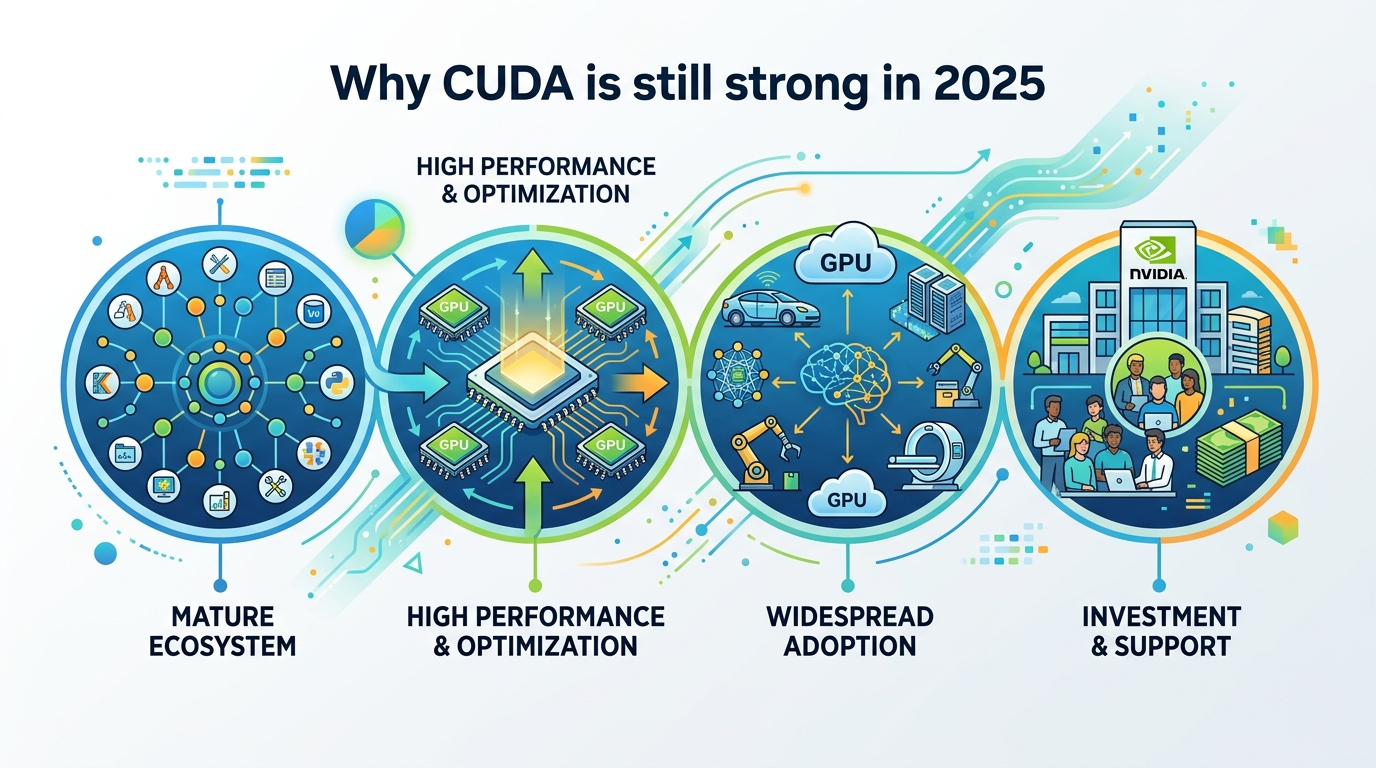

CUDA 已經 18 年,卻仍是 NVIDIA GPU 的核心軟體堆疊。從 AI 訓練、氣象模擬到蛋白質計算,這套工具鏈為何還是開發者首選?

CUDA 已經 18 年了,還是很有存在感。NVIDIA 曾提到,全球有數億顆 CUDA 相容 GPU 在跑。現代叢集也能把數萬個 GPU 核心丟進同一個工作負載。

講白了,這就是為什麼它會出現在氣象模型、蛋白質模擬,還有 LLM 訓練裡。你如果看過一個任務,從幾小時縮到幾分鐘,八成就懂這種吸引力。

CUDA 的重點不是新。它厲害的是,在 2025 年,它幾乎成了加速運算的預設答案。從 NVIDIA 資料中心硬體,到 PyTorch 和 TensorFlow 內部的函式庫,都躲不掉它。

CUDA 怎麼走到今天

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

CUDA 在 2007 年公開。那時 NVIDIA 已經花了好幾年,把 GPU 從圖形晶片,改造成能直接寫程式的運算平台。更早以前,做通用 GPU 計算很麻煩。很多人只能硬拗 OpenGL 或 DirectX shader。

CUDA 直接給開發者一個比較正常的模型。你可以用 C 或 C++ 寫程式,再把 kernel 丟到 GPU 上跑。幾千個 thread 同時處理資料,這件事終於不必靠圖形 API 繞路。

時間點也很剛好。2007 年的 CPU 還在進步,但核心數增加不夠快。科學運算後來的深度學習,也都嫌 CPU 不夠力。GPU 本來就擅長平行運算,CUDA 只是把這件事變得好用。

- 首次公開時間:2007 年

- 早期支援硬體:GeForce 8 系列

- 目前工具鏈:CUDA 13.0

- 支援架構包含 Hopper 與 Blackwell

真正讓它黏住市場的,是 NVIDIA 一直更新工具鏈。不是發完就放生。你一旦開始依賴 CUDA 函式庫,搬家成本就很高。這點很現實,也很殘酷。

很多團隊不是因為喜歡 CUDA,才用 CUDA。是因為整個專案、測試、部署流程,都已經長在這套堆疊上了。要換,得先付出一筆很痛的工程費。

CUDA 到底做了什麼

CUDA 是一種異質運算模型。CPU 是 host,GPU 是 device。工作會被拆開。CPU 負責排程和控制,GPU 負責那些能拆成很多小塊、一起跑的部分。

最重要的單位是 kernel。它是一個在 GPU 上執行的函式。很多 thread 會一起跑它。thread 會組成 block,block 再組成 grid。這種結構很重要,因為它讓開發者能直接控制工作怎麼分配。

記憶體也很關鍵。CUDA 有 global memory、shared memory、constant memory、texture memory,還有 unified memory。global memory 容量大,但慢。shared memory 快很多,但只給同一個 block 用。unified memory 讓 CPU 和 GPU 看起來像共用一個位址空間,但它不會魔法般修好爛掉的存取模式。

“The GPU is a very different kind of processor than the CPU. It is optimized for throughput, not latency.” — Ian Buck

這句話很直白。GPU 不是拿來拚單一請求延遲。它是拿來拚吞吐量。你的工作如果夠平行,GPU 就很猛。你的工作如果很串行,那它幫不上太多。

所以 CUDA 程式設計,某種程度上像性能解謎。你要讓資料搬得少一點。你要讓 memory access 夠整齊。你也要避免 warp 裡面分支太亂。這些都很吃功力。

CUDA 在真實世界怎麼贏

最能說服人的,不是簡報。是大家真的在用什麼。像 GROMACS 這類分子動力學工具,就用 CUDA 跑生物分子模擬。規模可以到上百萬顆粒子。這種工作 CPU 跑得動,但會慢很多。

氣象預報也很吃 CUDA。像 WRF 這類模型,GPU 版在某些數值計算上可以到 10 倍速度提升。這不是小修小補。這是直接改變排程和算力成本。

AI 更不用說。訓練神經網路,本質上就是大量矩陣運算。cuBLAS 和 cuDNN 幫忙扛掉很多底層工作。你看到很多 deep learning 框架跑得快,背後常常就是這些庫在撐。

- GROMACS 可用 CUDA 做大規模分子模擬

- WRF 的 GPU 版本可達 10 倍速度提升

- PyTorch 與 TensorFlow 都深度依賴 CUDA 生態

- Python 也能透過 Numba 與 CuPy 進入 CUDA 世界

CUDA 也不只出現在 AI 新聞裡。金融團隊拿它做風險分析。基因體學管線用它跑序列工作。自駕系統也靠它處理即時感知。共同點很簡單,就是資料量大,而且答案不能拖太久。

我覺得這才是 CUDA 最強的地方。它不是只服務某一種熱門應用。它是把很多高算力需求,變成可以工程化落地的工具。

CUDA 跟替代方案比什麼

CUDA 最大的優勢,是成熟。它的函式庫最完整。開發者最多。從原型到正式上線的路也最清楚。這點很現實,因為性能優化本來就很燒工時。

但它不是唯一選項。OpenCL 比較強調跨廠牌。Intel oneAPI 主要對準 Intel 軟硬體堆疊。AMD ROCm 則是 AMD 在 GPU 計算上的主力方案。

差別很直接。你要更好的可攜性,通常就得接受更少成熟函式庫,或更多移植工作。你要最高機率拿到穩定效能,CUDA 還是很難繞開。

- CUDA:NVIDIA GPU 上最完整,AI 生態最深

- OpenCL:跨廠牌,適合硬體不固定的團隊

- Intel oneAPI:適合 Intel 為主的 CPU/GPU 混合環境

- AMD ROCm:AMD GPU 的主要路線,研究圈較常見

實務上,很多團隊根本不是在選信仰。是在選採購單。機房如果已經是 NVIDIA,CUDA 幾乎就是最省事的路。若是混合硬體,移植和維護就會變得很煩。

還有一個很現實的詞,叫 lock-in。CUDA 會把你綁住。不是只有 API 綁住。還有教學、範例、函式庫、團隊習慣,全都會把人往同一條路推。

2025 年還要怎麼看 CUDA

CUDA 不會消失,但它的角色在變。現在最大的問題,不是它能不能跑。是 AI 和 HPC 會不會繼續綁死在 NVIDIA 的工具鏈上。更多廠商都在推自己的堆疊,更多團隊也開始在意可攜性。

對開發者來說,答案其實很務實。你的工作如果是平行運算、記憶體密集,而且已經在 NVIDIA GPU 上,那 CUDA 還是最快的路。你要的是結果,不是辯論。

如果你現在要做新平台策略,我會建議你先想清楚。你是要吃下 NVIDIA-first 的最佳化,還是要留一層抽象,讓未來比較好搬?這題沒有標準答案,但拖著不想,通常最貴。

我的判斷是,接下來幾年 CUDA 還會主導高效能 AI 和科學運算。只是更多團隊會在上層包一層薄抽象,降低對單一硬體的依賴。你該問的不是 CUDA 還重不重要,而是你的程式要不要直接講 CUDA。

如果你正在評估 GPU 軟體堆疊,可以再看我們對 LLM inference 成本 的整理。硬體選擇,真的會直接寫進你的預算裡。

結論:先看工作負載,再看工具

結論很簡單。先看你的工作是不是平行。再看資料是不是夠大。最後才看要不要用 CUDA。順序搞反,通常就會花冤枉錢。

如果你的團隊已經在 NVIDIA 上跑 AI、模擬或影像處理,那 CUDA 仍然是很實際的選擇。反過來說,如果你從第一天就想保留跨硬體彈性,那就該從抽象層開始設計,而不是事後補救。

我會押注一件事:接下來 2 到 3 年,CUDA 還是會很強。真正的變化,不是它會不會被取代,而是更多團隊會把它藏在更上層的框架後面。你如果現在要開新案,最好直接決定:你要跟 GPU 說話到多底層。