怎麼選第三方 AI 給 Apple Intelligence

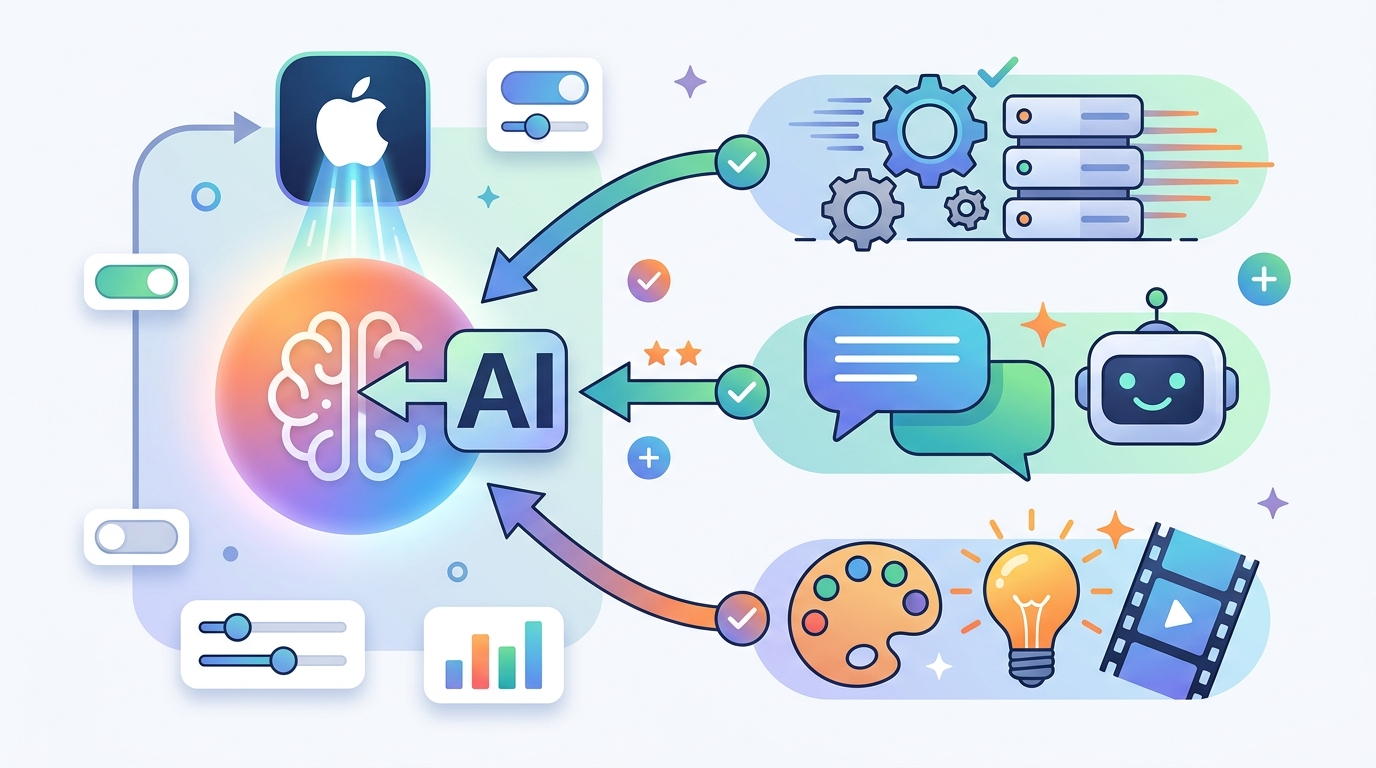

這篇教你理解 Apple Intelligence 的第三方 AI 擴充模式,並把 Claude 或 Gemini 類服務準備成可被系統選用的提供者。

這篇教你理解 Apple Intelligence 的第三方 AI 擴充模式,並把 Claude 或 Gemini 類服務準備成可被系統選用的提供者。

這篇給 iPhone、iPad、Mac 開發者看,目的是讓你用一步一步的方式掌握新模型、準備整合、驗證系統能否把你的 AI 服務列為可選項目。照做完,你會得到一份可落地的導入清單,知道該先做什麼、要交付什麼,以及怎麼在測試機上確認結果。

你也會看懂 Siri、Writing Tools、Image Playground 的新選擇流程,方便你在 iOS 27、iPadOS 27、macOS 27 上線前完成註冊、授權與路由設計。

開始之前

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

- Apple Developer Program 會員資格

- Xcode 27 beta 或更新版本

- iOS 27、iPadOS 27 或 macOS 27 beta 測試裝置

- AI 服務帳號,例如 Claude 或 Gemini

- API key 或 OAuth 憑證

- Swift 6 與最新 Apple SDK

- 熟悉 Apple Intelligence、Siri 與 app extension

Step 1: 釐清 Apple Intelligence 擴充模型

目的:先弄清楚第三方 AI 會出現在哪些系統入口,避免後面做錯整合方向。依目前公開訊息,Apple 會讓已安裝的 app 透過 Extensions 參與 Siri、Writing Tools、Image Playground 等系統體驗。

先讀 Apple Intelligence 與 app extension 的官方文件,並對照新聞報導理解目前的產品方向;Apple Developer 文件可從 Apple Developer 入口查起,外部脈絡可參考 MacRumors 報導。這一步的重點不是寫程式,而是畫出你服務會被呼叫的位置。

驗收:你應該能說出哪些系統功能會呼叫第三方模型,以及使用者在哪裡完成選擇。

Step 2: 建立 AI 服務擴充項目

目的:做出一個 Apple 能辨識的提供者條目,讓系統有機會把你的服務列進選單。若你的產品只是一個獨立聊天 app,通常還不夠,必須有正式的 extension 入口與對應設定。

建立 app target、extension bundle、entitlements 與必要的 Info.plist 欄位,並把服務名稱、支援能力、授權方式與後端端點整理成一份清楚的設定檔。下面是結構示意,實作時要依 Apple 最終 API 調整。

// 結構示意,不是最終 Apple API 語法

{

"providerName": "Example AI",

"capabilities": ["writing-tools", "image-playground", "siri-response"],

"auth": "oauth2",

"endpoint": "https://api.example.com/apple-intelligence"

}驗收:你應該能安裝 app,並在測試環境的 AI provider 選擇介面看到你的 extension。

Step 3: 接上驗證與請求路由

目的:把 Apple 系統請求安全地送到你的模型端點,且能辨識不同來源。因為 Siri、Writing Tools、Image Playground 可能都會走同一個提供者,你需要穩定的登入流程、token 更新機制與請求分類。

在後端加入 request type、locale、內容政策與 prompt context 的欄位,並為不同裝置與不同能力設計路由規則。若你有多個模型等級,應該在後端自動分派,不要把模型選擇暴露給 Apple 的使用者介面。

驗收:你應該看到帶有正確 metadata 的已驗證請求進入服務,token 過期時也能回到重新授權流程,而不是直接失敗。

Step 4: 分離 Siri 與第三方語音

目的:讓使用者一聽就知道是 Siri 還是第三方 AI 回答,避免混淆。公開資訊指出,Apple 會讓使用者為 Siri 選擇第三方 AI 的聲音,而 Siri 本身與外部 AI 回應會維持不同的語音識別。

在 app 或後端建立 voice mapping 表,為每個 provider 指派不同的 voice profile 或 spoken-response label。這不只是 UI 問題,也是信任問題,因為使用者需要知道現在是 Apple 的助理在說話,還是外部模型在回應。

驗收:你應該能聽到或看到第三方 provider 與 Siri 使用不同的語音標示,兩者不會混成同一種身份。

Step 5: 在 beta 裝置測試系統入口

目的:確認你的 provider 在 Apple 自己的介面中真的能工作,而不是只在單獨 app 裡正常。請在 iPhone、iPad、Mac 的 beta 裝置上測試 Siri、Writing Tools 與 Image Playground,提早找出能力不符、權限錯誤與延遲問題。

建立一份測試矩陣,至少涵蓋已登入與未登入、低網路品質、以及不支援的 prompt 類型。若你的服務不支援圖片任務,系統應該優雅降級,而不是讓整個 Apple Intelligence 流程中斷。

驗收:你應該能從每個支援的 Apple 入口叫出 extension、收到有效回應,並在能力不足時看到正確的 fallback 行為。

| 指標 | 基準/優化前 | 結果/優化後 |

|---|---|---|

| AI provider 選擇 | 只有單一預設服務 | 可列出 Claude、Gemini 等支援提供者 |

| 語音身份 | 單一路徑回應 | Siri 與第三方語音分離 |

| 系統入口覆蓋 | 有限的系統整合 | Siri、Writing Tools、Image Playground 都可測試 |

常見錯誤

- 漏掉 extension 中繼資料。修法:補齊 bundle identifier、entitlements 與 capability 宣告,讓系統能發現你的 provider。

- 所有請求共用同一條路由。修法:把 Siri、寫作、圖片三種流程分開,讓每個入口拿到正確的 prompt 與回應格式。

- 把 Siri 和第三方語音混在一起。修法:為不同 provider 指派明確的 voice profile 或標示,避免使用者分不清來源。

接下來可以看什麼

等 Apple 公布正式的 iOS 27 extension API 後,下一步就該做一個最小可用的 provider 原型,先在 beta 裝置上驗證授權、路由與回應格式,再逐步擴到你最在意的 Apple Intelligence 入口。