Mistral Voxtral TTS瞄準語音AI開發者

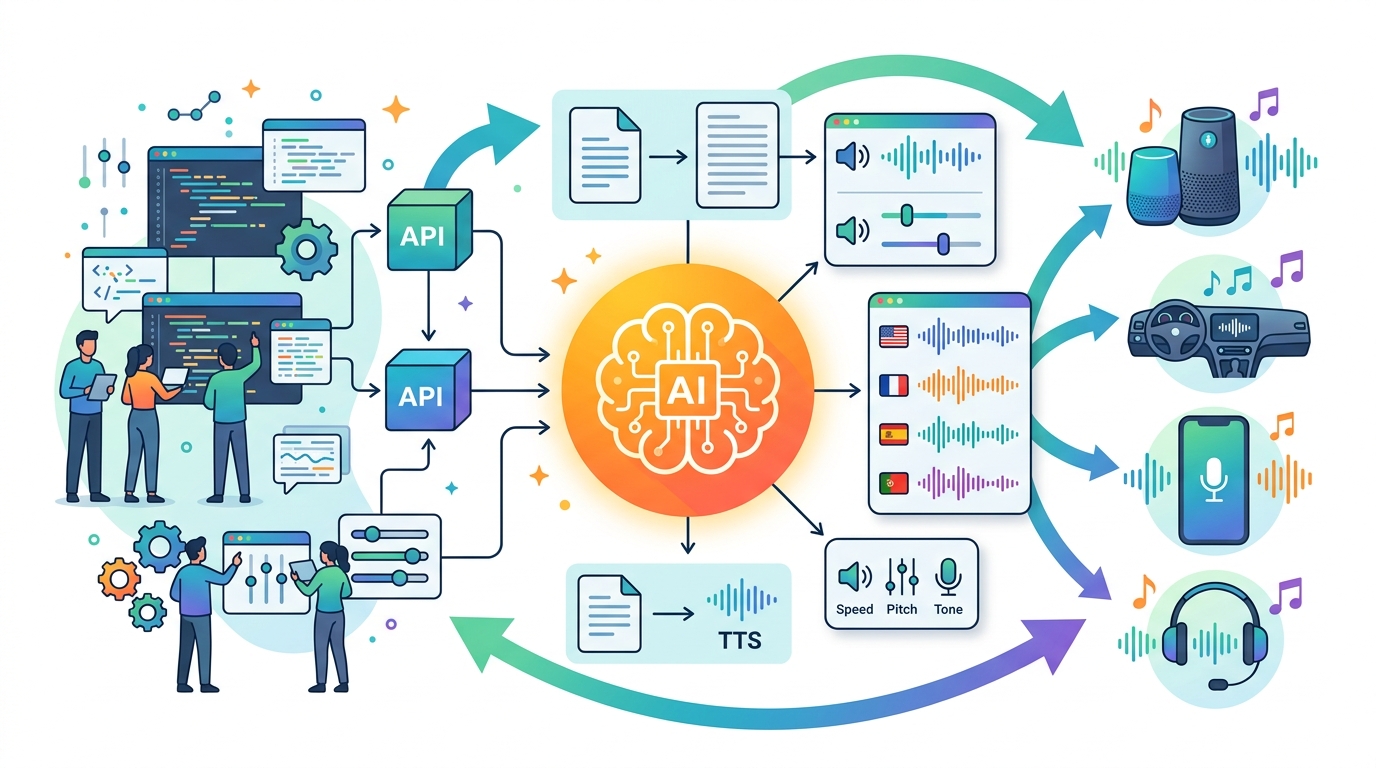

Mistral 推出 Voxtral TTS,支援 9 種語言、不到 5 秒音檔做聲音複製,TTFA 只有 90 ms。這款開源語音模型,直接對準語音助理、客服與即時翻譯場景。

Mistral AI 又丟出一個很會打的語音模型。這次是 Voxtral TTS,主打 9 種語言、不到 5 秒音檔做聲音複製,還有 90 ms 的 time-to-first-audio。講白了,這種數字不是拿來炫技,是拿來讓使用者少等。

如果你做過語音助理,就知道延遲有多煩。文字看起來再漂亮,只要開口慢半拍,整個體驗就像卡住。Mistral 把這個痛點直接拿來打,還說它能跑在 smartwatch、手機、筆電,甚至邊緣裝置上。

我覺得這招很實際。現在語音 AI 不缺 demo,缺的是能上線的軟體。真正讓團隊掏錢的,通常不是聲音有多像人,而是成本、速度、控制權三件事能不能一起過關。

Voxtral TTS 到底做了什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

先講最核心的。Voxtral TTS 是一個文字轉語音模型。Mistral 把它放進開源陣營,這點對開發者很重要。因為你不是只能呼叫雲端 API,還可以自己部署、自己調參、自己看資料流。

它的定位也很明確。Mistral 說這模型是給企業做語音代理、客服、銷售、配音,還有即時翻譯用的。這些場景有個共同點,就是不能慢。客戶講完一句,你如果隔很久才回,對話感直接掉一半。

這個模型是基於 Ministral 3B。Mistral 也說它能保留聲音特徵,還能在不同語言間切換。這對多語系產品很重要,因為很多模型一換語言,聲線就像換了個人。

- 支援語言:English、French、German、Spanish、Dutch、Portuguese、Italian、Hindi、Arabic

- 聲音複製:少於 5 秒音檔

- TTFA:90 ms

- Real-time factor:6x,10 秒音檔約 1.6 秒可跑完

這些數字不是裝飾。90 ms 的 TTFA,對語音互動很有感。人耳對 100 ms 左右的等待很敏感。超過去,使用者就會開始覺得「怎麼還沒講」。

另外,6x 的 real-time factor 也很有意思。它表示模型生成速度明顯快過即時播放需求。對於要批次產生配音、客服回覆,或是邊緣裝置上的本地推論,這種餘裕很重要。

這會怎麼壓到其他語音廠商

語音 AI 這塊現在很擠。ElevenLabs 已經把合成語音做成很多產品團隊的預設選項。Deepgram 則在語音基礎設施上很積極。OpenAI 也有自己的語音與多模態布局。Mistral 的打法不一樣,它想用開源、低延遲、可自架來切市場。

這種組合對企業很有吸引力。因為很多公司不是不想做語音,而是不想把敏感資料全丟到外部 API。尤其是客服、醫療、金融這類場景,資料控管常常比聲音自然度還重要。

再來是部署彈性。你要跑在雲端可以。你要靠近使用者、跑在邊緣伺服器也可以。你要做品牌專屬聲線,也比較容易自己調。這些都是 hosted-only 方案比較難給的自由。

“Our customers have been asking for a speech model. So we built a small-sized speech model that can fit on a smartwatch, a smartphone, a laptop, or other edge devices. The cost of it is a fraction of anything else on the market, but it offers state-of-the-art performance,” Pierre Stock, VP of science operations at Mistral AI, told TechCrunch.

這段話很直白。Mistral 想賣的不是單純的音質,而是「小、快、便宜、能放哪都行」。如果這個敘事成立,它壓力最大的不是單一模型,而是那些只靠雲端收費的語音 API 供應商。

對開發者來說,這會改變選型方式。以前你可能先看音質。現在你還得看延遲、授權、部署位置、硬體需求、以及能不能自己微調。說真的,這才像工程問題。

數字怎麼看,跟競品差在哪

如果只看宣傳詞,大家都很會講。真正要比的是幾個硬指標。Mistral 這次丟出 90 ms TTFA、6x real-time factor、不到 5 秒做聲音複製,這三個參數很有殺傷力。因為它們都直接對應到產品體驗。

拿語音助理來說,TTFA 影響第一句話有多快出來。拿客服系統來說,real-time factor 影響同時處理多少請求。拿配音平台來說,少量音檔就能複製聲線,會直接降低素材門檻。這些都不是學術分數,是成本與效率。

再看競品。ElevenLabs 強在聲音自然度和產品成熟度。OpenAI 的 TTS 走的是整合式 API 路線。Coqui TTS 則是開源社群常見方案,但商用整合與維運成本要自己扛。Mistral 這次想卡的位置,就是開源加上企業可用。

- Mistral Voxtral TTS:開源、9 語言、90 ms TTFA

- ElevenLabs:聲音擬真度高,產品化成熟

- OpenAI TTS:API 整合方便,適合快速上線

- Coqui TTS:開源彈性高,但維運要自己處理

如果你是新創團隊,我會這樣看。要快上線,就先看 API 方案。要控成本、控資料、控部署,就看開源模型。Mistral 的優勢在於它把這兩條路拉近了,讓你有機會先試,再決定要不要全自架。

比較麻煩的是品質一致性。語音模型最怕的是 demo 很像人,上線後卻在不同語言、不同口音、不同長度下表現飄掉。這種問題一出來,客服和品牌聲音就會一起翻車。

這件事放到產業脈絡裡怎麼看

語音 AI 這兩年變得很實用,原因很簡單。LLM 讓對話內容更自然,TTS 讓輸出更像人。兩邊一接起來,語音助理就不再只是電話總機,而是能真的做事的軟體。

但語音產品要落地,還是逃不掉幾個老問題。第一是延遲。第二是成本。第三是資料治理。第四是多語系支援。只要其中一個卡住,產品就會變得很難賣。Mistral 這次的訊號,就是它想把這四件事一起處理。

還有一個背景很重要。現在很多企業開始把模型往內部搬。不是每家公司都想把客服音檔、品牌聲線、內部知識,全交給外部平台。這也是為什麼開源模型最近特別有市場。大家要的不是浪漫,是可控。

從這個角度看,Voxtral TTS 不只是單一模型。它更像是 Mistral 在語音堆疊上的一塊拼圖。先有轉錄,再有生成,再往多模態走。這種布局很務實,也很符合企業採購邏輯。

我會怎麼建議開發者看這波

如果你現在就在做語音產品,建議你直接拿自己的資料測。不要只看官方 sample。把你最常見的 30 段句子丟進去,測三件事:延遲、斷句、情緒穩定度。這三件事比行銷頁面重要太多。

如果你是做 SaaS 或客服系統,也可以先想清楚部署路線。你要的是雲端 API 的省事,還是自架模型的控制權。這題沒有標準答案,但 Mistral 這種模型會讓「自架」變得比較像選項,不再只是理想。

我自己的判斷是,接下來 6 到 12 個月,語音 AI 會更像基礎設施。不是每家公司都要自己訓模型,但很多團隊會開始把 TTS 當成可替換元件。誰能在速度、成本、品質三邊都站住腳,誰就比較有機會被放進正式產品。

所以問題其實很簡單。你的產品,現在還能忍受 90 ms 以上的等待嗎?如果不能,那 Voxtral TTS 這種模型,就真的值得你先跑一輪實測。