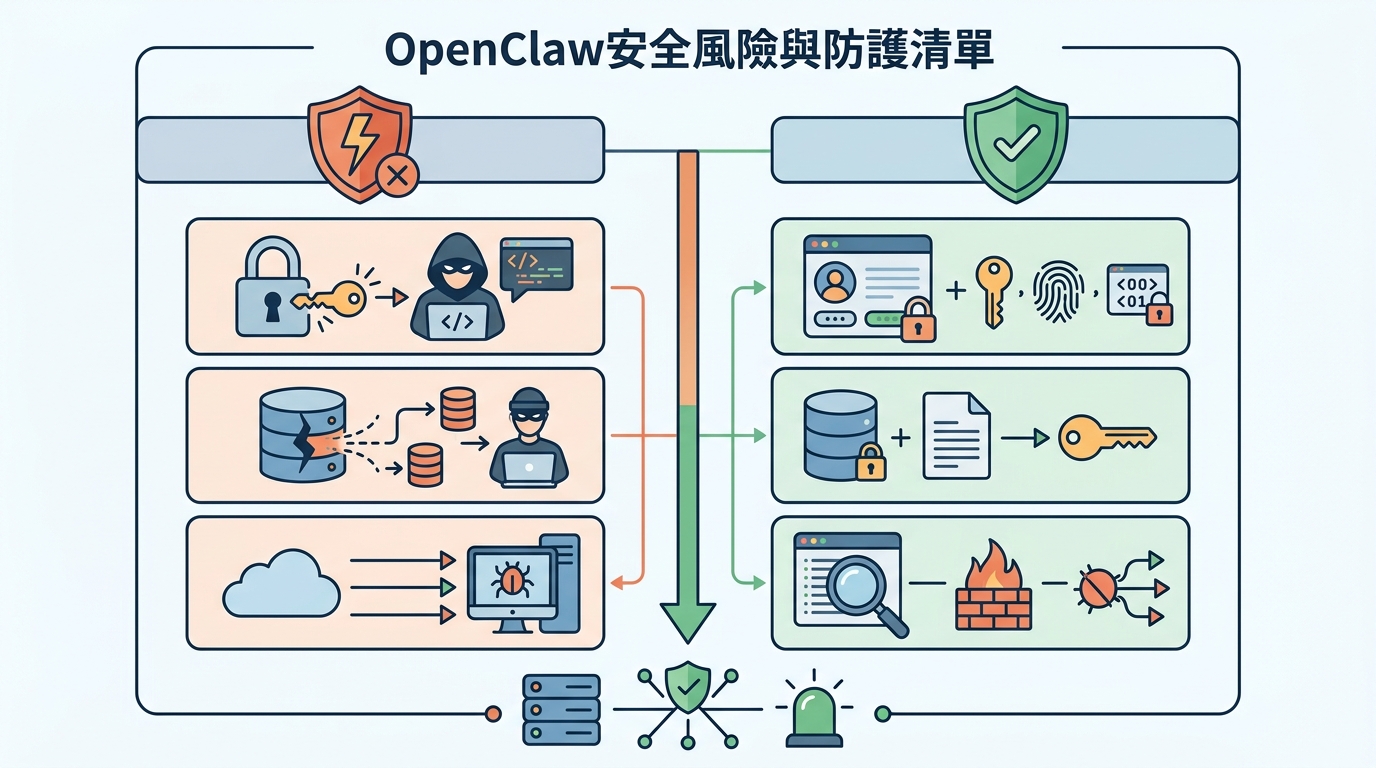

OpenClaw安全風險與防護清單

OpenClaw曝出1184個惡意技能包,23萬+實例暴露公網。本文拆解風險、漏洞、擴充生態與防護清單,給開發者可直接落地的檢查重點。

OpenClaw 這類本地 AI Agent,正在把聊天模型變成執行工具。安天披露的分析裡,單一平台就抓到 1184 個惡意技能包。全球還有 23 萬+ 實例,因預設配置不當暴露在公網。

講白了,這不是一般軟體風險。它會讀檔、跑命令、連外網。你一旦把它放進辦公機、伺服器,或接上企業資料源,安全邊界就會變得很薄。

我覺得這類工具很猛,也很危險。因為它不是只回答問題。它還會替你做事。這種能力一旦配上高權限,事情就會變得很難收拾。

OpenClaw 是什麼,為什麼風險高

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

OpenClaw 是一個開源 AI 智能體。它把 LLM、終端、檔案系統和第三方技能包綁在一起。它能自動處理文件整理、郵件、腳本和資料清理。

這種設計很方便。開發者可以少寫很多膠水碼。使用者也能把重複工作交給 Agent。

但問題也很直接。當它拿到系統權限後,它就不只是聊天機器人。它會碰到憑證、瀏覽器 session、內網 API,甚至整台機器的控制權。

安天提到的核心問題很明確。OpenClaw 與主機系統深度整合。權限邊界模糊。隔離不足。第三方擴充也缺少一致審核。這些點疊在一起,攻擊面就很大。

- 2026 年 2 月,ClawHub 出現大規模技能包投毒

- 單一平台檢出 1184 個惡意技能包

- 單一攻擊者最高上傳 677 個毒化插件

- 全球 23 萬+ 實例暴露公網

- 部分實例已出現敏感資料外洩

這些數字不是拿來嚇人。它們是在說一件事:AI Agent 的風險,不只在模型本身。更在它連到哪裡、能做什麼、誰能塞進去什麼東西。

最危險的是擴充生態,不是模型回答錯

OpenClaw 真正的風險中心,常常是 Skills 生態。Skills 本來是加功能的。可是一旦缺少審核,它也能變成加後門。

安天提到的「利爪浩劫」就是典型案例。攻擊者把惡意技能包包裝成工具。再透過說明文件,誘導使用者執行終端命令,或下載未知二進位檔。

使用者以為自己在安裝插件。其實是在幫攻擊者開門。這種手法很老,但放到 AI Agent 身上就很有效。因為使用者會更信任「看起來像官方工具」的東西。

“The absence of trust boundaries between the agent, the user, and external content creates a new class of security problem.” — Zenity Labs

這句話很貼切。信任鏈條太長,就容易出事。使用者信任 Skills。Skills 信任腳本。腳本信任網路。模型又把這些內容塞進同一個上下文。

最後,外部輸入就會被當成內部指令。這不是單點漏洞。這是整條流程都太鬆。

再看供應鏈。Node.js 和 npm 依賴很多。只要上游套件被污染,安裝時就可能靜默執行惡意腳本。對 AI Agent 來說,這比傳統桌面軟體更麻煩,因為它通常權限更高,還會自動化執行。

- Skills 可被包裝成正常工具

- 安裝說明可夾帶惡意命令

- npm 依賴可能在安裝時執行腳本

- 模型會把外部內容納入推理上下文

- 使用者很難肉眼看出差異

說真的,這就是 AI Agent 安全的老問題新包裝。你不是在審一個 app。你是在審一個會自己動手的執行體。

和傳統軟體比,OpenClaw 暴露面大多少

如果把傳統桌面軟體、瀏覽器插件、AI Agent 放一起比,OpenClaw 的攻擊面更大。傳統軟體多半只做一件事。AI Agent 卻會同時碰檔案、命令列、網頁和第三方服務。

安天引用的統計也很直接。CNNVD 在 2026 年 1 月到 3 月 9 日之間,收錄了 82 個 OpenClaw 漏洞。其中 12 個超危,21 個高危,47 個中危。

這種漏洞密度不算低。尤其對一個還在擴張的開源專案來說,更不能只看功能表現。你還得看它的部署方式、預設權限和外部暴露面。

更麻煩的是,很多人會直接把它放到聯網主機。預設配置沒改。驗證沒開。結果原本應該在本機跑的 Agent,變成互聯網上可掃描、可接管的入口。

- 漏洞總數:82

- 超危漏洞:12

- 高危漏洞:21

- 中危漏洞:47

- 公網暴露實例:23 萬+

如果你是開發者,這裡有個很現實的對照。傳統 SaaS 外洩,常常是資料問題。AI Agent 外洩,常常連執行權都一起送出去。這差很多。

你可以把它想成一個會聊天的自動化工作站。只要它能下命令,風險就不只在資料被看見,而是資料被改掉、被刪掉、被轉出去。

防護怎麼做,先收權限,再收插件

如果你真的要部署 OpenClaw,第一步不是裝更多 Skills。第一步是收權限。最小權限原則在這裡不是教科書口號,而是底線。

不要直接給管理員權限。不要讓 Agent 預設可刪檔、改設定、對外連線。你只要一開始放太鬆,後面就很難補。

第二步是隔離。把它放進容器、虛擬機,或單獨執行環境。不要讓它跟核心業務主機共用高價值憑證。高風險動作最好加人工確認。

第三步是控管來源。官方渠道、可信倉庫、經過審計的技能包,優先順序都要高於社群轉貼連結。只要它要求你下載 ZIP、執行 Shell 腳本、輸入帳密,你就先停一下。

安天給的防護方向也很實際。只啟用必要 Skills。關掉不需要的擴充。定期掃漏洞。即時更新補丁。開啟完整日誌。把可疑技能送去做靜態檢查和行為分析。

- 只開啟真正需要的 Skills

- 把 OpenClaw 放進隔離環境

- 對 SKILL.md 與安裝腳本做審計

- 盤點公網暴露端口

- 接入端點防護與惡意檔案檢測

我會再補一條。高風險操作要加人工核准。像刪檔、外發、下載、執行腳本,這些都不該完全自動化。少一步自動化,通常就少一個事故點。

哪些工具先上,哪些檢查先做

安天提到的終端防護產品 安天智甲,重點在主機防護、行為管控、介質管控、郵件防護和動態備份。對會直接讀寫本地檔案、呼叫命令列的 Agent 來說,這類主機側防線很有用。

另一個方向,是針對 Skills 的專項排查工具。你可以先把本地技能包批量掃過一輪。可疑檔案再送去做分析。像 計算機病毒百科 這類入口,就適合拿來做初步比對。

如果你在企業環境部署,還要順手看漏洞公告。像 CNVD、CNNVD、NVDB,都值得納入例行檢查。

再加上 OpenClaw 官方安全更新。還有你自己的資產清冊。這些東西一起看,才知道哪些節點真的暴露在外面。

如果你問我,哪個最先做。我會選三件事。先盤點暴露面。再收緊預設權限。最後才談擴充生態。順序錯了,後面都白忙。

AI Agent 的安全,不是買一套工具就結束。它比較像持續維運。你要一直看、一直改、一直驗證。

背景脈絡:為什麼這類風險會越來越常見

這幾年,AI 工具從聊天介面,走向工作流自動化。大家不想只問答案。大家想要它直接幫忙做事。這就是 Agent 會紅的原因。

但能力一多,風險也會一起長。以前模型只會回文字。現在它會碰檔案、API、瀏覽器、CLI。每多一個介面,就多一個攻擊面。

開源生態也讓這件事更快。社群可以很快做出插件。問題是,審核通常跟不上。你會看到功能長得很快,安全流程卻還停在很早以前。

這不是 OpenClaw 才有的問題。只要是會執行動作的 AI 工具,幾乎都會碰到同一套難題。差別只在於,誰先把權限、來源和隔離做好。

結尾:先做一個很務實的決定

我給的建議很簡單。先把 OpenClaw 當成高風險執行體,不要當一般工具看。你只要還沒做完權限盤點、插件審核、公網暴露檢查,就別急著上正式環境。

如果你已經在用,今天就先檢查三件事:預設帳號有沒有關、Skills 來源乾不乾淨、主機有沒有直接暴露到公網。這三項先過,再談自動化。這樣比較像在做工程,不像在賭運氣。