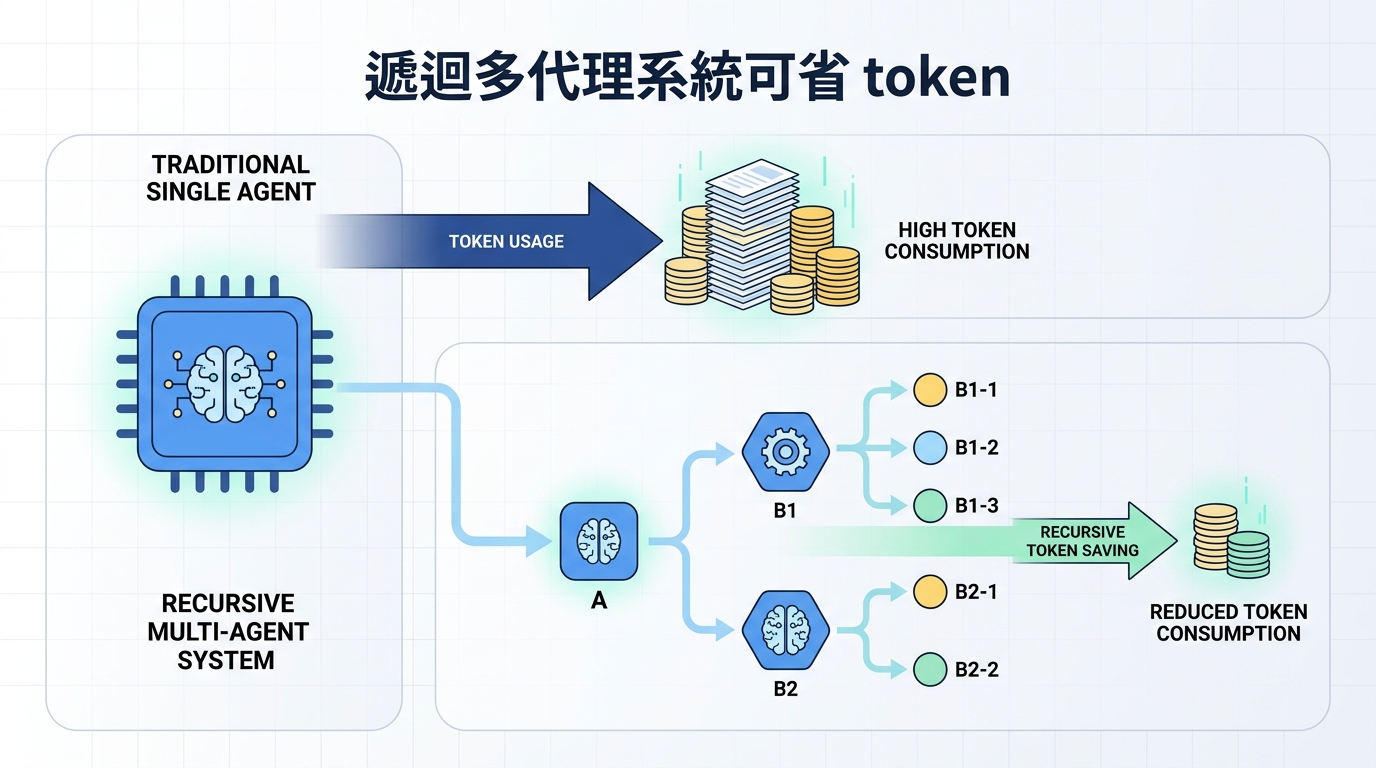

遞迴多代理系統可省 token

RecursiveMAS 把多代理協作改成潛在空間的遞迴計算,主打更少 token、更快推論,摘要宣稱平均準確率提升 8.3%。

多代理系統現在很常見,但大多還是靠文字來回傳訊。這種做法直觀,卻也很耗 token。每一輪協作都要把資訊說清楚、讀進去、再重寫一次,過程中不只成本上升,原本有用的結構也可能被文字稀釋掉。Recursive Multi-Agent Systems 這篇論文想解的,就是這個痛點。

作者提出的方向不是再多加幾個 agent,而是把整個協作流程改寫成一個遞迴的潛在計算。簡單講,系統不必一直把內部思考翻成自然語言,再讓下一個 agent 讀回去;它可以在 latent space 裡持續修正自己,讓多代理協作變成一個可遞迴、可訓練、也更省 token 的整體流程。

這篇論文在修哪個瓶頸

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

傳統多代理系統常見的設計,是把多個模型或多個角色串成鏈,或者做成迴圈。這種架構能工作,但代價很明顯:每一步都要產生文字,每一步都要消耗 token。當協作輪次變多時,延遲、冗餘和成本也一起上升。

作者把這個問題看成一種結構性瓶頸。不是單一 agent 不夠強,而是協作層本身太依賴文字。也就是說,系統花了很多 token 在「溝通」,卻不一定把這些 token 轉成更好的推理品質。這正是 RecursiveMAS 想要改掉的地方。

論文的出發點還有一層背景:遞迴語言模型已經證明,反覆在 latent state 上精煉同一個計算,可以成為新的 scaling axis。作者進一步追問,這個概念能不能從單一模型擴展到多代理協作。換句話說,不只是模型本身可以遞迴,多個 agent 的互動也可以被視為一個遞迴計算。

RecursiveMAS 到底怎麼運作

這套框架叫 RecursiveMAS。它的核心不是把 agent 變少,而是把 agent 之間的交換方式換掉。作者把整個多代理系統視為一個統一的遞迴計算,讓各個 agent 在 latent space 裡交換「想法」,而不是一直用完整文字訊息互傳。

中間的關鍵元件叫 RecursiveLink。論文把它描述成一個輕量模組,用來連接異質 agent。它支援兩件事:一是 in-distribution 的 latent thought generation,二是 cross-agent latent state transfer。白話說,就是某個 agent 可以把壓縮過的內部狀態交給另一個 agent,而不需要把整段推理全部寫成文字。

這個設計的重點在於「協作資訊」不再完全依賴自然語言。自然語言適合人看,但不一定適合機器之間高頻交換。RecursiveMAS 想保留協作中的結構資訊,同時減少文字搬運的開銷。對多輪推理、長鏈協作來說,這種差異可能很大。

訓練方式也和一般多代理 pipeline 不太一樣。作者提出一個 inner-outer loop learning algorithm,做的是 iterative whole-system co-optimization。這表示模型不是只各自訓練單一 agent,而是把整個遞迴協作流程一起優化,讓梯度能跨越多個 recursion rounds 做 credit assignment。

這一點對實作很重要。很多多代理系統難在「到底誰貢獻了結果」。如果每個 agent 都只是各說各話,事後很難知道哪一步有用、哪一步只是增加噪音。RecursiveMAS 的思路,是把整個協作 loop 變成可訓練的單一過程,讓系統學會怎麼在每一輪遞迴中修正自己。

論文實際證明了什麼

從摘要來看,作者有做理論分析,也有做實驗。理論部分涵蓋 runtime complexity 和 learning dynamics。摘要的說法是,這些分析顯示 RecursiveMAS 比標準的文字型多代理系統更有效率,而且在遞迴訓練時能維持穩定的 gradients。

實驗部分,作者把 RecursiveMAS 套到四種代表性的 agent 協作模式上,並在九個 benchmark 上測試,範圍涵蓋數學、科學、醫療、搜尋與 code generation。可惜摘要沒有公開完整 benchmark 細節,也沒有列出每個測項的名稱與分數,所以目前只能看到總結性的結果。

摘要給出的重點數字有三個。第一,和進階的 single-agent、multi-agent 以及 recursive computation baselines 相比,RecursiveMAS 的平均準確率提升 8.3%。第二,端到端推論速度提升 1.2× 到 2.4×。第三,token 使用量下降 34.6% 到 75.6%。

這組結果的意義很直接。8.3% 的平均準確率提升,代表它不只是省 token,還真的有把效能做上去。更重要的是 token 節省幅度很大,最低也有三成多,最高接近四分之三。對需要多輪推理、多人協作、或高頻呼叫 agent 的系統來說,這會直接影響成本和延遲。

- 平均準確率提升:8.3%

- 推論速度提升:1.2× 到 2.4×

- token 使用量下降:34.6% 到 75.6%

- 測試範圍:9 個 benchmark

- 涵蓋任務:數學、科學、醫療、搜尋、code generation

- 協作模式:4 種代表性 agent pattern

對開發者代表什麼

如果你在做 agentic system,這篇論文最值得注意的,不只是「遞迴」這個名詞,而是它把協作層當成一個可以優化的核心計算。過去很多團隊會把多代理系統想成 prompt 的堆疊,重點放在角色設計、提示詞和訊息格式。RecursiveMAS 的觀點比較像:協作本身就是模型的一部分,應該用訓練和結構來一起解。

這會帶來幾個實務上的吸引力。首先,token 降低通常意味著成本下降,也可能帶來更低延遲。其次,latent state transfer 有機會保留更多中間結構,不必把每一步都展開成長篇文字。第三,whole-system co-optimization 讓你有機會調的是「整個協作流程」,而不是只調單一 agent 的表現。

對做 orchestration 的團隊來說,這也暗示一種新的介面想像。未來的 agent bus 不一定只傳訊息,也可能傳遞學習過的內部狀態。當然,這種設計是否適合所有場景,還要看更完整的實作與評估,但方向已經很清楚:多代理協作可以不只是文字接龍。

這篇摘要沒說完的事

雖然摘要很有說服力,但它也留下不少空白。首先,沒有完整 benchmark 名單,所以我們不知道九個測試各自是什麼,也看不到每個任務的細節表現。其次,摘要沒有交代模型大小、訓練成本、資料配置,這些都會影響結果能不能複製。

另外,latent space 協作雖然更省 token,但也可能更難觀察。文字型 agent trace 很好 debug,開發者可以直接看每輪說了什麼、哪裡出錯。若協作過程更多藏在內部狀態裡,效率可能上升,但可解釋性和除錯難度也可能一起提高。摘要沒有處理這個問題。

還有一個實際問題是泛化。這篇論文測了數學、科學、醫療、搜尋與 code generation,範圍不算窄,但摘要沒有說它在更長鏈的 planning、工具使用,或更吵雜的真實工作流裡表現如何。這些場景往往才是多代理系統最容易卡住的地方。

即便如此,這篇工作的訊號還是很明確:它把多代理系統的效能瓶頸,從「每個 agent 能不能說得好」推進到「整個協作機制能不能更有效率」。如果完整論文能支撐摘要宣稱的結果,那 RecursiveMAS 可能代表一條很實際的路線——用更少的文字,換更快的推論和更好的整體表現。

對台灣開發者來說,這類研究最有意思的地方,在於它不是只談模型能力,而是直接碰到部署成本。當 agent 系統越來越常進到產品、工具鏈和內部工作流,token、延遲、可訓練性都會變成硬指標。RecursiveMAS 提醒我們,下一波優化不一定只在更大的模型,也可能在更聰明的協作結構。